Do estúdio ao streaming: AI na evolução da música e seu impacto no mercado

A primeira apresentação ao vivo documentada que combinou AI generativa AI um músico ocorreu em novembro de 2022, quando o pianista David Dolan (Guildhall School of Music and Drama) improvisou em diálogo com um AI semiautônomo projetado pelo compositor Oded Ben-Tal (Kingston University). Esse concerto inovador demonstrou as possibilidades criativas da AI parceira colaborativa na música. Desde então, músicos e até mesmo não músicos têm adotado AI generativa, produzindo composições completas com vocais, instrumentos e até sons de instrumentos inexistentes. Isso marca o início de uma nova era em que AI remodelando a criação e a produção musical. À medida que artificial intelligence a transformar setores, o mundo da música está passando por sua própria revolução. De amadores a grandes gravadoras, os atores de todo o setor estão lidando com as implicações dessa tecnologia.

A indústria musical, historicamente moldada pelos avanços tecnológicos, está entrando em uma nova fase de transformação. Com o amplo impacto da indústria musical no entretenimento, na mídia e nas plataformas de streaming que hospedam milhões de faixas, a integração da AI redefinir a forma como a música é criada, produzida e consumida.

AI generativa, a tecnologia por trás dessa mudança revolucionária, evoluiu rapidamente da pesquisa acadêmica para aplicações práticas. Modelos como o Music Transformer e o MusicLM estão ampliando os limites do que é possível, traduzindo conceitos abstratos em composições harmoniosas. Esses AI , treinados com vastos conjuntos de dados de peças musicais, agora são capazes de gerar melodias, harmonias e até mesmo canções inteiras com uma proficiência surpreendente.

No entanto, como acontece com qualquer revolução tecnológica, o avanço da AI música traz tanto entusiasmo quanto ansiedade. Artistas e profissionais do setor estão divididos quanto ao seu impacto potencial. Alguns a veem como uma ferramenta poderosa para a criatividade e a democratização, enquanto outros se preocupam com as implicações para a expressão artística humana e a estabilidade no emprego.

O panorama da indústria musical já está mudando. As plataformas de streaming estão utilizando AI criar playlists personalizadas, enquanto os softwares de produção incorporam ferramentas de mixagem e masterização AI. Até mesmo as grandes gravadoras estão explorando o potencial AIpara a descoberta de novos talentos e a previsão de tendências.

À medida que nos adentramos nesta nova era, surgem inúmeras questões. Como AI irá AI os papéis dos artistas, produtores e engenheiros? Que considerações legais e éticas devemos abordar? E, talvez o mais importante, como essa tecnologia afetará a conexão emocional entre os músicos e seu audience?

Neste artigo, exploraremos o estado atual da AI generativa AI música, suas aplicações em diferentes setores da indústria e o futuro promissor que ela anuncia. Desde a tecnologia por trás desses AI até os desafios práticos de levá-los ao mercado, examinaremos como essa inovação está prestes a transformar uma das indústrias criativas mais queridas e influentes do mundo.

À medida que a indústria musical entra nesta era AI, fica claro que os compositores do futuro podem não ser apenas humanos, o que marca uma mudança significativa à medida que o setor explora essa nova fronteira.

1. A tecnologia por trás AI generativa AI música

Da composição ao código: os avanços da AI generativa AI música

A trajetória da composição tradicional até a música AI tem sido verdadeiramente revolucionária. Estamos familiarizados com a geração de texto usando o ChatGPT e a geração de imagens com o Stable Diffusion e o MidJourney. Os principais avanços na geração de música residem na adaptação desses poderosos modelos às especificidades dos data musicais.

I. GPT para Música (geração discreta)

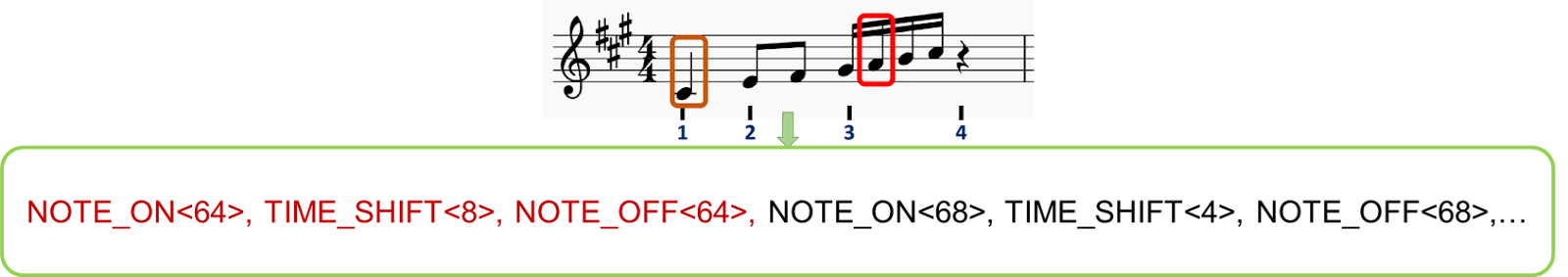

Assim como os modelos GPT processam a linguagem, princípios semelhantes podem ser aplicados aos elementos musicais. O segredo está na tokenização — a divisão da música em unidades discretas e manejáveis. O processo de aplicar modelos GPT à música por meio da tokenização é um passo crucial para permitir AI compreenda e gere música. Aqui está uma explicação mais detalhada:

1. Tokenização na música: assim como os modelos GPT dividem o texto em tokens (palavras ou subpalavras), a música precisa ser dividida em unidades discretas que a AI processar. A seguir, exploramos dois métodos de tokenização:

i. As notas podem ser vistas como elementos distintos que contêm várias informações:

a) Altura: A nota específica que está sendo tocada (por exemplo, Dó, Ré, Mi, etc.)

b) Duração: Por quanto tempo a nota é mantida (por exemplo, semínima, mínima)

c) Intensidade: Com que volume a nota é tocada

d) Instrumento: Qual instrumento está tocando a nota

ii. Exemplo: uma nota em C4 tocada durante um quarto de compasso pode ser representada pelos símbolos: ; ; , enquanto uma nota em G3 tocada durante meio compasso pode ser representada por: ; ;

(podemos adicionar símbolos para velocidades, estruturas de compassos, instrumentos, gêneros, etc.)

iii. Criação de sequências numéricas:

Essa série de tokens de notas é então concatenada e organizada em sequências, de forma semelhante à maneira como as palavras formam frases nos modelos de linguagem. A cada token é atribuído um ID numérico exclusivo, permitindo que o modelo GPT receba uma entrada semelhante à utilizada na geração de texto.

iv. Exemplo: Uma frase musical tem o seguinte formato: [123; 8; 456; 118; 12; 451;…] onde cada número representa um evento musical específico.

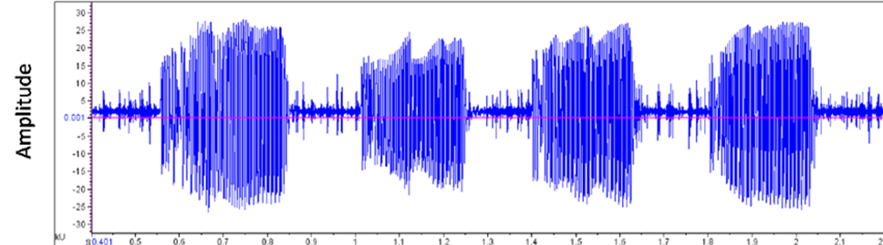

i. Os arquivos de áudio são armazenados em computadores no formato WAV, representando a amplitude do sinal ao longo do tempo. Isso proporciona uma representação mais rica do que as simples partituras musicais.

ii. Essa onda pode ser dividida em segmentos que representam o “significado da música” por meio de um modelo treinado (semelhante ao BERT para vetores de palavras), que cria uma versão tokenizada da entrada de áudio.

iii. Os vetores resultantes podem ser condicionados por uma incorporação conjunta de áudio e texto, criando tokens que representam tanto as características do áudio quanto a descrição textual, permitindo que o usuário utilize um prompt de texto como entrada durante a inferência.

2. AI :

3. Geração:

O Music Transformer, desenvolvido pelo projeto Magenta do Google, marcou um marco significativo nessa área. Ao ser um dos primeiros a aplicar o mecanismo de atenção do Transformer — um pilar dos modelos de linguagem — a sequências musicais, ele alcançou uma coerência notável em composições de longa duração. Outros modelos seguiram o exemplo, cada um ampliando os limites do que AI realizar na criação musical.

II. Modelos de difusão para música (Geração contínua)

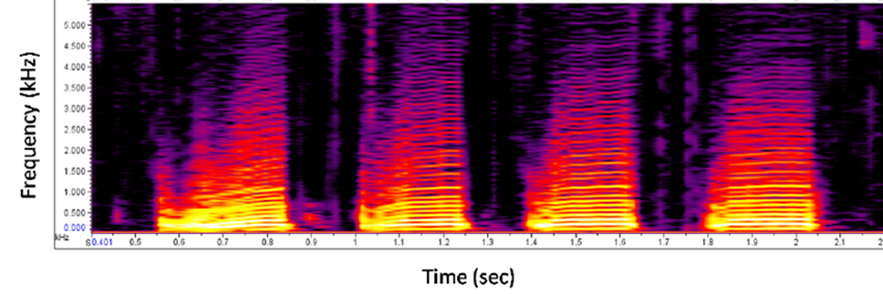

Modelos de difusão, como o MidJourney ou o Stable Diffusion, têm sido amplamente adotados e utilizados para a geração de imagens. As imagens geradas estão se tornando cada vez mais detalhadas e personalizáveis, apresentando grande consistência ao adicionar detalhes de estilo ou resolução em um prompt. Essa personalização é um recurso interessante também para a geração de música. Como podemos transformar música em uma imagem?

A música como uma imagem:

Ao considerar os espectrogramas como imagens e associá-los a uma descrição textual, é possível obter um controle eficaz sobre a geração, permitindo que os usuários solicitem a música desejada da mesma forma que fariam com imagens no MidJourney.

Preenchendo a lacuna entre a inovação e a indústria: desafios na geração AI :

Exploramos duas maneiras diferentes de gerar música usando AI. Todas essas tecnologias resultaram em demonstrações impressionantes e divertidas. No entanto, o caminho das experiências de laboratório até produtos prontos para o mercado está repleto de desafios. Os obstáculos técnicos são muitos, desde garantir uma qualidade consistente em vários estilos musicais até gerenciar as demandas computacionais da geração em tempo real. Os desafios de mercado são igualmente assustadores, à medida que os desenvolvedores lutam para encontrar o audience certo audience os casos de uso adequados para seus AI .

Considerações gerenciais e jurídicas adicionam ainda mais complexidade. Construir e liderar equipes na interseção entre música e AI uma combinação única de habilidades. Enquanto isso, o panorama ético e jurídico permanece em grande parte inexplorado, levantando questões sobre direitos autorais, autoria e a própria natureza da criatividade na era da AI.

À medida que nos aprofundamos nas aplicações e produtos atuais que emergem dessa revolução tecnológica, fica claro que o impacto da AI indústria musical será de longo alcance, afetando todas as partes interessadas, desde os ouvintes até as grandes gravadoras.

2. Aplicações e produtos atuais

À medida que AI generativa AI a se desenvolver, surgiram diversas plataformas e ferramentas na indústria musical. Essas inovações estão passando de conceitos experimentais para aplicações práticas, cada uma oferecendo diferentes recursos e possibilidades de uso.

I. O mais utilizado atualmente: Suno.AI

No panorama da geração AI , a Suno.AI atraído bastante atenção. A plataforma permite que os usuários criem músicas a partir de prompts de texto, gerando canções completas, incluindo vocais, instrumentação e letras, em vários gêneros e estilos.

AI Suno.AI uma base de usuários de 12 milhões e concluiu rodadas de financiamento bem-sucedidas, atingindo uma avaliação de US$ 500 milhões. A plataforma oferece planos gratuitos e pagos, sendo que a versão gratuita permite aos usuários criar um número limitado de músicas por dia. Suas aplicações vão desde maquetes de trailers de filmes até trilhas sonoras para videogames.

Um cineasta trabalhando em um curta-metragem pode usar a Suno.AI gerar uma trilha sonora personalizada quando não for possível contratar um compositor. Agências de publicidade estão explorando a plataforma para criar rapidamente jingles e música de fundo para comerciais, o que pode alterar seu fluxo de trabalho em relação à música na publicidade.

II. Outras plataformas AI

Embora a Suno.AI chamado a atenção, ela faz parte de um ecossistema crescente de plataformas AI .

À medida que essas plataformas evoluem e novas plataformas surgem, as aplicações da AI música continuam a se diversificar. De criadores independentes a grandes corporações, as possibilidades de uso abrangem uma ampla gama, indicando um futuro em que AI desempenhar um papel cada vez mais significativo na criação e produção musical.

3. Impacto sobre as diferentes partes interessadas

À medida que AI generativa AI a evoluir, seu impacto se reflete em todas as facetas da indústria musical. Dos ouvintes às grandes gravadoras, cada grupo está passando por uma mudança em sua relação com a criação e o consumo de música. Enquanto alguns encaram essas mudanças com apreensão, outros as veem como a evolução natural de uma indústria que sempre foi moldada pelos avanços tecnológicos.

I. Ouvintes

A trajetória dos consumidores de música tem sido marcada por uma personalização e uma descoberta cada vez maiores. Antes AI, os ouvintes contavam com DJs de rádio, revistas de música e o boca a boca para descobrir novas músicas. As playlists eram cuidadosamente selecionadas manualmente, muitas vezes limitadas às bibliotecas musicais pessoais.

Com o advento da AI, plataformas como o Spotify lançaram recursos como o Discover Weekly em julho de 2015, utilizando algoritmos para analisar hábitos de escuta e sugerir novas faixas. Isso representou um avanço significativo na descoberta personalizada de músicas, expondo os ouvintes a uma gama mais ampla de artistas e gêneros.

Agora, com AI generativa, estamos prestes a ter uma experiência ainda mais personalizada. O LifeScore é um sistema que não apenas recomenda músicas já existentes, mas também cria novas composições com base no humor, na atividade ou até mesmo data biométricos do ouvinte. Um corredor pode ter uma trilha sonora personalizada gerada em tempo real, que se adapta ao seu ritmo e frequência cardíaca, combinando seus gêneros favoritos em algo totalmente novo.

II. Artistas

Para os músicos, o processo criativo sempre foi influenciado pelas ferramentas e tecnologias disponíveis. Antes AI, a composição dependia fortemente de instrumentos tradicionais e técnicas de gravação. A introdução dos sintetizadores e das estações de trabalho de áudio digital (DAWs) no final do século XX já começou a remodelar a forma como a música era criada. Como observou Jean-Michel Jarre, um dos primeiros pioneiros da música eletrônica: “A tecnologia sempre ditou os estilos, e não o contrário. Foi porque inventamos o violino que Vivaldi compôs a música que compôs… Para mim, AI não AI necessariamente um perigo se for bem utilizada”.

Os softwares de composição podem sugerir progressões de acordes ou melodias, atuando como parceiros colaborativos no processo criativo.

Com AI generativa, estamos vendo o surgimento da AI . Agora, os artistas podem inserir uma melodia básica ou uma ideia para a letra, e um AI gera elementos complementares, o que pode inspirar novas direções criativas. Alguns músicos estão até mesmo experimentando a adaptação de estilo em tempo real durante apresentações ao vivo, usando AI transformar seu som na hora, com base audience .

Para artistas amadores, diversos aplicativos de treinamento estão fazendo bom uso da AI oferecer experiências de aprendizagem em tempo real, interativas e personalizadas. Com outras ferramentas que permitem simular arranjos e bandas, o custo de aprendizagem da criatividade é reduzido, permitindo que mais pessoas toquem e apreciem música.

III. Engenheiros

O papel dos engenheiros de áudio tem sido marcado por uma adaptação constante às novas tecnologias. Tradicionalmente, a mixagem e a masterização eram processos inteiramente manuais, exigindo um ouvido apurado e anos de experiência. Entrevistado para este artigo, Marius Blanchard, Data do Spotify, mencionou:AI nãoAI aqui para substituir os músicos, mas para capacitá-los. É uma ferramenta que pode ajudar os artistas a explorar novos territórios criativos e ampliar os limites da criação musical.”

AI já AI ganhando espaço nesse campo, com ferramentas como o Neutron, da iZotope, que oferecem assistência inteligente à mixagem. Esses sistemas podem analisar uma faixa e sugerir configurações de equalização, níveis de compressão e outros parâmetros, simplificando o processo de mixagem.

À medida que AI generativa AI mais sofisticada, poderemos ver sistemas de mixagem e masterização totalmente automatizados, capazes de processar um álbum inteiro com intervenção humana mínima. No entanto, muitos profissionais do setor argumentam que o toque humano sempre será necessário para captar as nuances emocionais de uma performance.

IV. Empresas de música e plataformas

As gravadoras e editoras musicais há muito tempo contam com a intuição humana e pesquisas de mercado para identificar tendências e descobrir novos talentos. Os executivos de A&R (Artistas e Repertório) vasculhavam clubes e fitas demo em busca do próximo grande sucesso.

A integração da AI esse processo em uma tomada de decisão data. As plataformas analisam data em tempo real, o engajamento nas redes sociais e outras métricas para identificar artistas em ascensão e prever o potencial de sucesso.

Com AI generativa, as empresas do setor musical estão explorando possibilidades ainda mais radicais. Algumas estão testando AI capazes de gerar músicas adaptadas a segmentos de mercado ou grupos demográficos específicos. Outras estão utilizando modelos preditivos para prever quais estruturas musicais ou temas líricos provavelmente terão repercussão junto ao público nos próximos meses.

Enquanto o setor lida com essas mudanças, a questão central permanece: como evoluirá o equilíbrio entre a criatividade humana e AI ? Enquanto alguns temem a perda do toque humano na criação musical, outros veem AI uma ferramenta que, em última análise, irá potencializar a criatividade humana, abrindo novos caminhos para a expressão e a colaboração.

4. Visões futuras e oportunidades

À medida que AI generativa AI a remodelar a indústria musical, os envolvidos enfrentam um panorama complexo de questões jurídicas, econômicas e éticas. Essa tecnologia transformadora promete democratizar a criação musical, ao mesmo tempo em que desafia as noções tradicionais de criatividade artística e direitos autorais.

I. Considerações jurídicas e de mercado

1. Os direitos autorais na era da AI

Antes do surgimento AI, as leis de direitos autorais na música eram relativamente simples. Compositores e intérpretes detinham os direitos sobre suas obras originais, com diretrizes claras sobre sampling e uso justo. No entanto, a introdução da música AI tornou essas fronteiras significativamente mais difusas.

Nos Estados Unidos, a proteção dos direitos autorais abrange obras originais de autoria, enquanto a doutrina europeia enfatiza o toque pessoal do criador. Essa distinção torna-se crucial quando se trata de música AI. O Escritório de Direitos Autorais dos Estados Unidos declarou que não registrará obras produzidas por uma máquina ou por um mero processo mecânico que opere de forma aleatória ou automática, sem contribuição criativa ou intervenção de um autor humano.

Em 2023, pelo menos um caso de grande repercussão destacou as preocupações relacionadas aos direitos autorais em torno da música AI que imita artistas populares. Uma faixa chamada “Heart on My Sleeve”, que usava AI imitar as vozes de Drake e The Weeknd, foi enviada para serviços de streaming e logo removida. A Universal Music apresentou uma reclamação no YouTube, e o vídeo da faixa foi retirado do ar. Esse incidente levantou questões sobre direitos de personalidade e o uso não autorizado das vozes dos artistas, mesmo que criadas por meio de AI ação estabeleceu um precedente sobre como a indústria poderia lidar com conteúdo AI que se assemelha muito ao trabalho de artistas existentes.

Para os artistas, AI uma faca de dois gumes. Alguns adotam a tecnologia como uma ferramenta de colaboração, enquanto outros temem que ela possa desvalorizar seu ofício.

As empresas do setor musical enfrentam seus próprios desafios.

2. Projeções de mercado

AI mercado musical está prestes a registrar um crescimento significativo. Analistas do setor projetam que o setor alcance US$ 38,7 bilhões até 2033, contra US$ 3,9 bilhões em 2023. Esse aumento de dez vezes reflete a adoção generalizada prevista de AI em vários aspectos da produção, distribuição e consumo de música. Curiosamente, os artistas estão mais interessados em ferramentas AI para produção e masterização musical (66%) do que na geração AI (47%). Ferramentas que estimulam a criatividade são consideradas mais importantes do que as ferramentas AI puramente AI, mesmo que tenhamos que nos preparar para ouvir cada vez mais trechos musicais AI.

II. Possíveis transformações

1. Democratização da produção musical

AI reduzindo as barreiras à criação musical. Ferramentas que antes exigiam estúdios caros e anos de treinamento agora estão acessíveis por meio de aplicativos fáceis de usar. Essa democratização pode levar a uma explosão de novos estilos musicais e vozes.

Alex Mitchell, fundador de uma startup de tecnologia musical e CEO da Boomy, imagina um futuro em que qualquer pessoa possa ser compositor. “Atualmente, vemos pessoas em todo o mundo criando músicas instantaneamente com a Boomy, lançando-as e até mesmo recebendo uma parte dos royalties. Pela primeira vez, a expressão musical está ao alcance de um tipo totalmente novo de criador e audienceEssa acessibilidade pode alterar fundamentalmente o panorama musical, revelando potencialmente talentos que, de outra forma, poderiam ter passado despercebidos.

2. NovasAudience eAudience

AI , de fato, transformando a forma como os artistas se conectam com seu audience. Alguns artistas e plataformas musicais já estão experimentando chatbots AI que permitem aos fãs interagir com seu catálogo musical de maneiras inovadoras. Por exemplo, o Spotify lançou um chatbot AI dentro de seu aplicativo que interage com os usuários para entender suas preferências musicais, estados de espírito e hábitos de escuta. Isso permite que o chatbot crie playlists personalizadas e sugira novas faixas adaptadas ao gosto único de cada usuário.

Esses AI estão sendo usados para aumentar o envolvimento dos fãs, oferecendo recomendações personalizadas, atualizações em tempo real e experiências interativas. Eles podem fornecer novidades sobre os artistas, recomendar playlists, facilitar a compra de ingressos e responder às dúvidas dos fãs, promovendo conexões mais profundas entre os artistas e seu audience.

Holly Herndon, uma artista com visão de futuro, lançou recentemente uma AI de sua voz AI com a qual os fãs podem colaborar para criar faixas personalizadas. Essa combinação entre a criatividade humana e AI aponta para um futuro em que a fronteira entre artista e audience cada vez mais difusa.

Uma conclusão multifacetada

I. O papel AIna criatividade

A integração da AI criação musical levanta questões profundas sobre a natureza da arte. Enquanto alguns argumentam que AI apenas uma ferramenta, semelhante a um novo instrumento, outros temem que ela possa diminuir o elemento humano que torna a música emocionalmente comovente.

Marius Blanchard, Data da Universidade de Columbia que atua na indústria musical, oferece uma perspectiva equilibrada: “Não acredito que AI substituir os artistas; […] a conexão audience se manifesta em muitos níveis diferentes, além da música. Em vez disso, espero que AI o acesso à produção sonora de qualidade e estimule a criatividade de cada vez mais artistas para que possam expressar e compartilhar suas criações.”

II. Impacto nos empregos do setor

À medida que AI aumentam, certas funções na indústria musical podem evoluir ou tornar-se obsoletas. Os engenheiros de som, por exemplo, podem precisar adaptar suas habilidades para trabalhar em conjunto com ferramentas AI e masterização AI . No entanto, é provável que surjam novas categorias profissionais, como programadores AI ou AI de ética AI para as indústrias criativas.

III. Autenticidade e conexão emocional

Talvez a questão mais importante que a indústria enfrenta seja se a música AI é capaz de estabelecer as mesmas conexões emocionais com os ouvintes que as obras criadas por seres humanos. Embora AI analisar padrões e criar composições tecnicamente proficientes, a qualidade indescritível da experiência humana que muitas vezes permeia a grande música continua sendo um desafio a ser reproduzido.

A musicista eletrônica e AI Holly Herndon apresenta uma visão otimista: “Acho que o melhor caminho a seguir é os artistas se envolverem nos avanços do aprendizado de máquina”, disse ela, sugerindo que “pensem em maneiras de convidar outras pessoas, de forma condicional, a experimentar com eles”.

Referências

Jeff Ens e Philippe Pasquier, (2020). MMM: Explorando a geração condicional de múltiplas faixas de música (

)

com o Transformer. Pré-impressão arXiv arXiv:2008.06048 https://arxiv.org/abs/2008.06048

Andrea Agostinelli et al. (2023). MusicLM: Geração de música a partir de texto. Pré-impressão do arXiv arXiv:2301.11325 https://arxiv.org/abs/2301.11325

Huang et al. (2018). Music Transformer: Geração de música com estrutura de longo prazo. Pré-impressão do arXiv arXiv:1809.04281 https://arxiv.org/abs/1809.04281

Ke Chen et al. (2023). MusicLDM: Aumentando a originalidade na geração de música a partir de texto por meio de estratégias de mixagem sincronizadas com a batida. Pré-impressão do arXiv arXiv:2308.01546 https://arxiv.org/abs/1809.04281

BLOG

BLOG