Vom Studio zum Streaming: Der Einfluss der KI auf die Gestaltung der Musik und ihre Auswirkungen auf den Markt

Die erste dokumentierte Live-Performance, bei der generative KI und ein Musiker zusammenkamen, fand im November 2022 statt, als der Pianist David Dolan (Guildhall School of Music and Drama) im Dialog mit einem halbautonomen KI-System improvisierte, das vom Komponisten Oded Ben-Tal (Kingston University) entwickelt wurde. Dieses bahnbrechende Konzert demonstrierte die kreativen Möglichkeiten der KI als Kooperationspartner in der Musik. Seitdem haben sich Musiker und sogar Nicht-Musiker die generative KI zu eigen gemacht und ganze Kompositionen mit Gesang, Instrumenten und sogar Klängen von nicht existierenden Instrumenten produziert. Dies markiert der Beginn einer neuen Ära, in der KI die Musikkreation und -produktion umgestaltet. Während artificial intelligence weiterhin die Industrie umgestaltet, erlebt die Musikwelt ihre eigene Revolution. Vom Hobbyisten bis hin zu den großen Plattenfirmen setzen sich die Akteure der Branche mit den Auswirkungen dieser Technologie auseinander.

Die Musikindustrie, die seit jeher von technologischen Fortschritten geprägt ist, tritt nun in eine neue Phase der Transformation ein. Angesichts des großen Einflusses der Musikindustrie auf Unterhaltung, Medien und Streaming-Plattformen mit Millionen von Titeln verspricht die Integration von KI, die Art und Weise, wie Musik geschaffen, produziert und konsumiert wird, neu zu definieren.

Die generative KI, die Technologie hinter diesem seismischen Wandel, hat sich schnell von der akademischen Forschung zu praktischen Anwendungen entwickelt. Modelle wie Music Transformer und MusicLM verschieben die Grenzen des Möglichen und übersetzen abstrakte Konzepte in harmonische Kompositionen. Diese KI-Systeme, die an riesigen data-Sets von Musikstücken trainiert wurden, können jetzt mit erstaunlicher Kompetenz originelle Melodien, Harmonien und sogar ganze Songs erzeugen.

Doch wie jede technologische Revolution ist auch der Aufstieg der KI in der Musik sowohl aufregend als auch beunruhigend. Künstler und Branchenexperten sind geteilter Meinung über die möglichen Auswirkungen. Einige sehen darin ein mächtiges Werkzeug für Kreativität und Demokratisierung, während andere sich Sorgen über die Auswirkungen auf die menschliche Kunst und die Sicherheit der Arbeitsplätze machen.

Die Landschaft der Musikindustrie ist bereits im Wandel begriffen. Streaming-Plattformen nutzen KI für personalisierte Wiedergabelisten, während Produktionssoftware KI-gestützte Tools zum Mischen und Mastern enthält. Sogar große Plattenfirmen erforschen das Potenzial der KI für das Talentscouting und die Trendvorhersage.

Während wir in diese neue Ära eintauchen, tauchen viele Fragen auf. Wie wird die KI die Rollen von Künstlern, Produzenten und Ingenieuren verändern? Welche rechtlichen und ethischen Überlegungen müssen wir anstellen? Und was vielleicht am wichtigsten ist: Wie wird sich diese Technologie auf die emotionale Verbindung zwischen Musikern und ihren audience auswirken?

In diesem Artikel befassen wir uns mit dem aktuellen Stand der generativen KI in der Musik, ihren Anwendungen in verschiedenen Bereichen der Branche und der potenziellen Zukunft, die sie ankündigt. Von der Technologie, die hinter diesen KI-Modellen steckt, bis hin zu den praktischen Herausforderungen bei der Markteinführung untersuchen wir, wie diese Innovation eine der beliebtesten und einflussreichsten Kreativindustrien der Welt verändern wird.

Mit dem Eintritt der Musikindustrie in die KI-gesteuerte Ära ist es offensichtlich, dass die Komponisten der Zukunft nicht mehr nur Menschen sein werden, was einen bedeutenden Wandel in der Branche darstellt.

1. Die Technologie hinter der generativen KI für Musik

Von der Komposition zum Code: Die Durchbrüche der generativen KI in der Musik

Der Weg von der traditionellen Komposition zur KI-generierten Musik war geradezu bahnbrechend. Wir kennen die Texterzeugung mit chatGPT und die Bilderzeugung mit Stable Diffusion und MidJourney. Der große Durchbruch bei der Musikgenerierung liegt in der Anpassung dieser leistungsstarken Modelle an die Besonderheiten der Musik data.

I. GPT für Musik (diskrete Generation)

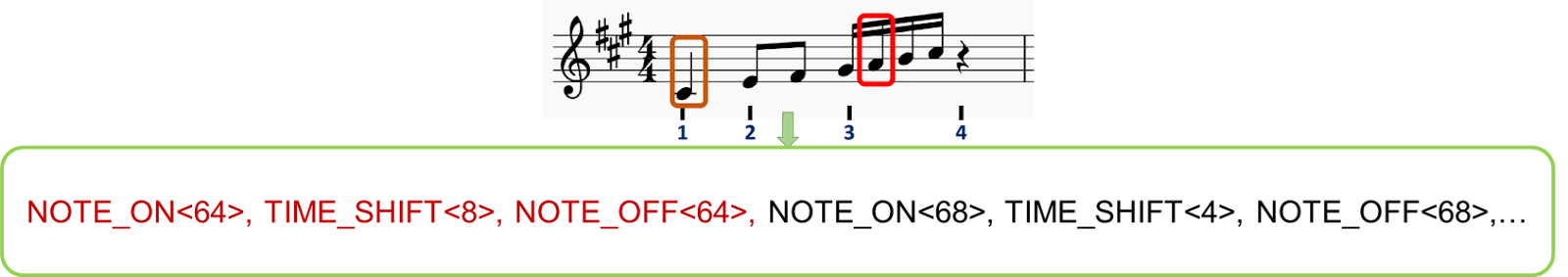

So wie GPT-Modelle Sprache verarbeiten, können ähnliche Prinzipien auf musikalische Elemente angewendet werden. Der Schlüssel liegt in der Tokenisierung - dem Zerlegen von Musik in diskrete, handhabbare Einheiten. Der Prozess der Anwendung von GPT-Modellen auf Musik durch Tokenisierung ist ein entscheidender Schritt, um KI in die Lage zu versetzen, Musik zu verstehen und zu erzeugen. Hier finden Sie eine ausführlichere Erklärung:

1. Tokenisierung in der Musik: Genauso wie GPT-Modelle Text in Token (Wörter oder Unterwörter) zerlegen, muss Musik in diskrete Einheiten zerlegt werden, die die KI verarbeiten kann. Wir untersuchen im Folgenden zwei Tokenisierungsmethoden:

i. Notizen können als diskrete Elemente betrachtet werden, die mehrere Informationen enthalten:

a) Tonhöhe: Die spezifische Note, die gespielt wird (z.B. C, D, E, etc.)

b) Dauer: Wie lange die Note gehalten wird (z. B. Viertelnote, halbe Note)

c) Anschlagsstärke: Wie laut oder leise die Note gespielt wird

d) Instrument: Welches Instrument spielt die Note

ii. Beispiel: eine C4-Note, die über einen Viertelschlag gespielt wird, könnte mit den Token : ; ; dargestellt werden, während eine G3-Note, die über einen halben Schlag gespielt wird, mit ; dargestellt werden könnte; ;

(wir können Token für Geschwindigkeiten, Taktstrukturen, Instrumente, Genres,... hinzufügen)

iii. Erstellung numerischer Sequenzen:

Diese Serien von Notizen und Token werden dann verkettet und in Sequenzen angeordnet, ähnlich wie Wörter in Sprachmodellen Sätze bilden. Jedem Token wird eine eindeutige numerische ID zugewiesen, so dass das GPT-Modell eine ähnliche Eingabe wie bei der Texterstellung erhält.

iv. Beispiel: Eine musikalische Phrase sieht so aus: [123; 8; 456; 118; 12; 451;...], wobei jede Zahl ein bestimmtes musikalisches Ereignis darstellt.

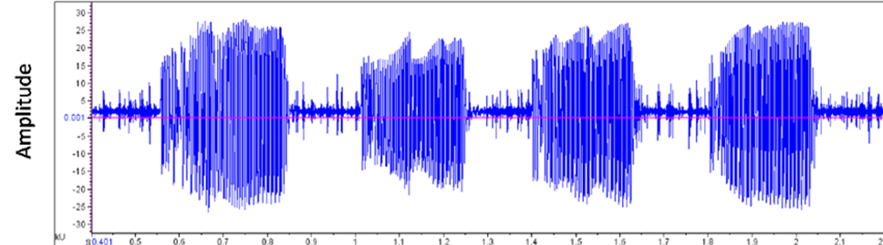

i. Audiodateien werden in Computern in einem Wellenformat gespeichert, das die Amplitude des Signals über die Zeit darstellt. Dies bietet eine umfassendere Darstellung als einfache Notenblätter.

ii. Diese Welle kann mit Hilfe eines trainierten Modells (ähnlich wie BERT für Wortvektoren) in Segmente unterteilt werden, die die “Bedeutung der Musik” repräsentieren und eine tokenisierte Version des Audioinputs erstellen.

iii. Die resultierenden Vektoren können durch eine gemeinsame Audio- und Texteinbettung konditioniert werden, wodurch Tokens entstehen, die sowohl Audiomerkmale als auch Textbeschreibungen repräsentieren, so dass der Benutzer während der Inferenz einen Text-Prompt als Eingabe verwenden kann.

2. KI-Training:

3. Generation:

Der Music Transformer, der vom Magenta-Projekt von Google entwickelt wurde, war ein wichtiger Meilenstein auf diesem Gebiet. Er war einer der ersten, der den Aufmerksamkeitsmechanismus des Transformers - ein Eckpfeiler von Sprachmodellen - auf musikalische Sequenzen anwandte und so eine bemerkenswerte Kohärenz in langen Kompositionen erreichte. Andere Modelle folgten diesem Beispiel, wobei jedes die Grenzen dessen, was KI in der Musikproduktion leisten kann, erweitert hat.

II. Diffusionsmodelle für Musik (Kontinuierliche Erzeugung)

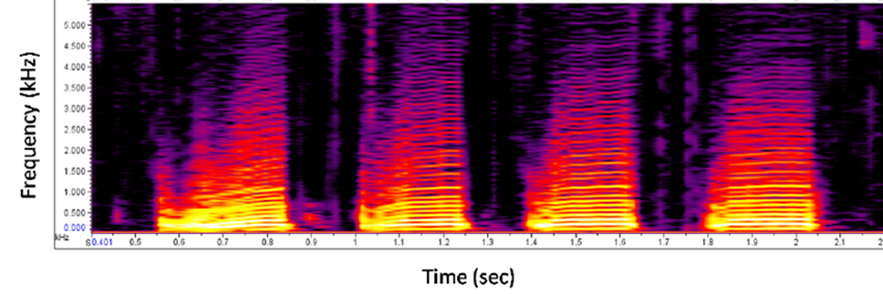

Diffusionsmodelle, wie z.B. MidJourney oder Stable Diffusion, wurden weitgehend übernommen und für die Bilderstellung verwendet. Die generierten Bilder werden immer detaillierter und anpassbarer und weisen eine große Konsistenz auf, während sie in einer Eingabeaufforderung Details zum Stil oder zur Auflösung hinzufügen. Diese Personalisierung ist auch für die Generierung von Musik ein interessantes Merkmal. Wie können wir Musik in ein Bild verwandeln?

Musik als Bild:

Indem man Spektrogramme als Bilder betrachtet und sie mit einer Textbeschreibung verbindet, ist es möglich, eine starke Kontrolle über die Generierung zu haben, so dass die Benutzer ihre gewünschte Musik wie bei Bildern mit MidJourney eingeben können.

Überbrückung der Kluft zwischen Innovation und Industrie: Herausforderungen bei der KI-Musikproduktion:

Wir haben 2 verschiedene Möglichkeiten zur Erzeugung von Musik mithilfe von KI erforscht. Alle diese Technologien haben zu beeindruckenden und unterhaltsamen Demos geführt. Der Weg vom Laborexperiment zum marktreifen Produkt ist jedoch voller Herausforderungen. Es gibt viele technische Hürden, von der Sicherstellung einer konsistenten Qualität über verschiedene Musikstile hinweg bis hin zur Bewältigung der rechnerischen Anforderungen der Echtzeitgenerierung. Die Herausforderungen des Marktes sind ebenso beängstigend, da die Entwickler damit zu kämpfen haben, die richtigen audience und Anwendungsfälle für ihre KI-Komponisten zu finden.

Management und rechtliche Erwägungen machen die Sache noch komplexer. Der Aufbau und die Leitung von Teams an der Schnittstelle von Musik und KI erfordert eine einzigartige Mischung von Fähigkeiten. Gleichzeitig bleibt die ethische und rechtliche Landschaft weitgehend unerforscht und wirft Fragen zum Urheberrecht, zur Urheberschaft und zum Wesen der Kreativität im Zeitalter der KI auf.

Wenn wir uns näher mit den aktuellen Anwendungen und Produkten befassen, die aus dieser technologischen Revolution hervorgehen, wird klar, dass die Auswirkungen der KI auf die Musikindustrie weitreichend sein werden und alle Interessengruppen vom Hörer bis zu den großen Plattenfirmen betreffen.

2. Aktuelle Anwendungen und Produkte

Im Zuge der Weiterentwicklung der generativen KI ist in der Musikindustrie eine Vielzahl von Plattformen und Tools entstanden. Diese Innovationen entwickeln sich von experimentellen Konzepten zu praktischen Anwendungen und bieten jeweils unterschiedliche Fähigkeiten und Einsatzmöglichkeiten.

I. Die heute am häufigsten verwendeten: Suno.AI

In der Landschaft der KI-Musikgenerierung hat Suno.AI große Aufmerksamkeit erregt. Die Plattform ermöglicht es Nutzern, Musik anhand von Textaufforderungen zu erstellen. Dabei werden komplette Songs mit Gesang, Instrumenten und Texten in verschiedenen Genres und Stilen erzeugt.

Suno.AI hat eine Nutzerbasis von 12 Millionen und erfolgreiche Finanzierungsrunden mit einer Bewertung von $500 Millionen abgeschlossen. Die Plattform bietet sowohl kostenlose als auch kostenpflichtige Versionen an, wobei die kostenlose Version den Nutzern erlaubt, eine begrenzte Anzahl von Songs pro Tag zu erstellen. Die Anwendungen reichen von Filmtrailer-Mockups bis hin zu Soundtracks für Videospiele.

Ein Filmemacher, der an einem Kurzfilm arbeitet, könnte Suno.AI nutzen, um einen individuellen Soundtrack zu erstellen, wenn er keinen Komponisten engagieren kann. Werbeagenturen erforschen die Plattform, um schnell Jingles und Hintergrundmusik für Werbespots zu erstellen und damit möglicherweise ihren Arbeitsablauf für Musik in der Werbung zu verändern.

II. Andere KI-Musikplattformen

Suno.AI hat zwar Aufmerksamkeit erregt, aber es ist Teil eines wachsenden Ökosystems von KI-Musikplattformen.

Da sich diese Plattformen weiterentwickeln und neue entstehen, werden die Anwendungen von KI in der Musik immer vielfältiger. Von einzelnen Musikschaffenden bis hin zu großen Unternehmen reichen die potenziellen Einsatzmöglichkeiten. Dies deutet auf eine Zukunft hin, in der KI eine immer wichtigere Rolle bei der Schaffung und Produktion von Musik spielen könnte.

3. Auswirkungen auf verschiedene Stakeholder

Die Weiterentwicklung der generativen KI hat Auswirkungen auf alle Bereiche der Musikindustrie. Von den Hörern bis hin zu den großen Plattenfirmen erlebt jede Gruppe eine Veränderung in ihrer Beziehung zur Musikproduktion und zum Musikkonsum. Während einige diese Veränderungen mit Sorge betrachten, sehen andere sie als die natürliche Entwicklung einer Branche, die schon immer von technologischen Fortschritten geprägt war.

I. Hörer

Die Reise der Musikkonsumenten ist eine Reise der zunehmenden Personalisierung und Entdeckung. Vor der KI verließen sich die Hörer auf Radio-DJs, Musikzeitschriften und Mundpropaganda, um neue Musik zu entdecken. Playlists wurden mühsam von Hand zusammengestellt und waren oft durch persönliche Musikbibliotheken begrenzt.

Mit dem Aufkommen der KI haben Plattformen wie Spotify Funktionen wie die Discover Weekly im Juli 2015, mit Hilfe von Algorithmen, die die Hörgewohnheiten analysieren und neue Titel vorschlagen. Dies war ein bedeutender Sprung in der personalisierten Musikentdeckung, der den Hörern ein breiteres Spektrum an Künstlern und Genres eröffnete.

Mit der generativen KI stehen wir nun kurz vor einem noch besser zugeschnittenen Erlebnis. LifeScore ist ein System, das nicht nur vorhandene Musik empfiehlt, sondern auch neue Kompositionen auf der Grundlage der Stimmung, der Aktivität oder sogar der biometrischen Daten des Hörers erstellt data. Für einen Jogger könnte ein individueller Soundtrack in Echtzeit erstellt werden, der sich an sein Tempo und seine Herzfrequenz anpasst und seine Lieblingsgenres zu etwas völlig Neuem verbindet.

II. Künstler

Für Musiker war der kreative Prozess schon immer von den verfügbaren Werkzeugen und Technologien beeinflusst. Vor der KI stützte sich die Komposition stark auf traditionelle Instrumente und Aufnahmetechniken. Die Einführung von Synthesizern und digitalen Audio-Workstations (DAWs) im späten 20. Jahrhundert begann bereits, die Art und Weise, wie Musik geschaffen wurde, neu zu gestalten. Wie von Jean-Michel Jarre bemerkt, ein früher Pionier der elektronischen Musik: ”Die Technologie hat schon immer die Stile diktiert und nicht andersherum. Nur weil wir die Geige erfunden haben, hat Vivaldi die Musik gemacht, die er gemacht hat... Für mich ist KI nicht unbedingt eine Gefahr, wenn sie gut eingesetzt wird”.

Kompositionssoftware kann Akkordfolgen oder Melodien vorschlagen und so als Partner im kreativen Prozess dienen.

Mit generativer KI erleben wir das Aufkommen von KI als Co-Writer. Künstler können jetzt eine Grundmelodie oder eine lyrische Idee eingeben und ein KI-System ergänzende Elemente generieren lassen, die möglicherweise neue kreative Richtungen einschlagen. Einige Musiker experimentieren sogar mit Echtzeit-Stilanpassungen bei Live-Auftritten, und nutzen die KI, um ihren Sound auf der Grundlage von audience-Reaktionen zu verändern.

Für Hobbykünstler gibt es zahlreiche Trainings-Apps, die KI nutzen, um interaktive und personalisierte Lernerfahrungen in Echtzeit anzubieten. Mit anderen Tools, die es Ihnen ermöglichen, Arrangements und Bands zu simulieren, wird der Lernaufwand für Kreativität reduziert, so dass mehr Menschen Musik spielen und genießen können.

III. Ingenieure

Die Rolle der Toningenieure war schon immer von ständiger Anpassung an neue Technologien geprägt. Traditionell waren Abmischung und Mastering rein manuelle Prozesse, die ein scharfes Ohr und jahrelange Erfahrung erforderten. Für diesen Artikel befragt, sagte Marius Blanchard, Data Scientist bei Spotify: “KI ist nicht dazu da, um Musiker zu ersetzen, sondern um sie zu befähigen. Sie ist ein Werkzeug, das Künstlern dabei helfen kann, neue kreative Territorien zu erkunden und die Grenzen des Musikschaffens zu erweitern.”

KI hat in diesem Bereich bereits Einzug gehalten, mit Tools wie Neutron von iZotope die intelligente Unterstützung beim Abmischen bieten. Diese Systeme können einen Track analysieren und EQ-Einstellungen, Kompressionsstufen und andere Parameter vorschlagen, um den Abmischungsprozess zu rationalisieren.

Wenn die generative KI immer ausgefeilter wird, werden wir vielleicht vollautomatische Mixing- und Mastering-Systeme sehen, die ein ganzes Album mit minimalem menschlichen Eingriff bearbeiten können. Viele in der Branche argumentieren jedoch, dass die menschliche Note immer notwendig sein wird, um die emotionalen Nuancen einer Performance einzufangen.

IV. Musik & Plattformunternehmen

Plattenfirmen und Musikverlage haben sich lange Zeit auf menschliche Intuition und Marktforschung verlassen, um Trends zu erkennen und neue Talente zu entdecken. A&R-Manager (Artists and Repertoire) durchforsteten Clubs und Demobänder auf der Suche nach dem nächsten großen Ding.

Die Integration von KI hat diesen Prozess in Richtung data-driven-Entscheidungsfindung verlagert. Plattformen analysieren Streaming data, Engagement in den sozialen Medien und andere Metriken, um aufstrebende Künstler zu identifizieren und ihr Hitpotenzial vorherzusagen.

Mit generativer KI erforschen Musikunternehmen sogar noch radikalere Möglichkeiten. Einige experimentieren mit KI-Systemen, die Musik erzeugen können, die auf bestimmte Marktsegmente oder Demografien zugeschnitten ist. Andere nutzen Vorhersagemodelle, um zu prognostizieren, welche Songstrukturen oder lyrischen Themen in den kommenden Monaten bei audiences wahrscheinlich auf Resonanz stoßen werden.

Während sich die Branche mit diesen Veränderungen auseinandersetzt, bleibt die entscheidende Frage bestehen: Wie wird sich das Gleichgewicht zwischen menschlicher Kreativität und KI-Unterstützung entwickeln? Während die einen den Verlust der menschlichen Note in der Musikproduktion befürchten, sehen andere die KI als ein Werkzeug, das die menschliche Kreativität letztlich verbessern und neue Wege für Ausdruck und Zusammenarbeit eröffnen wird.

4. Zukunftsvisionen und Chancen

Während die generative KI die Musikindustrie weiter umgestaltet, müssen sich die Beteiligten mit einer komplexen Landschaft rechtlicher, wirtschaftlicher und ethischer Überlegungen auseinandersetzen. Diese transformative Technologie verspricht, das Musikschaffen zu demokratisieren und gleichzeitig traditionelle Vorstellungen von Kunst und Urheberrecht in Frage zu stellen.

I. Rechtliche & Marktüberlegungen

1. Urheberrecht im Zeitalter der KI

Vor dem Aufkommen der Künstlichen Intelligenz waren die Urheberrechtsgesetze in der Musik relativ einfach zu handhaben. Komponisten und Interpreten hatten die Rechte an ihren Originalwerken und es gab klare Richtlinien für das Sampling und die faire Nutzung. Die Einführung von KI-generierter Musik hat diese Grenzen jedoch erheblich verwischt.

In den USA erstreckt sich der Urheberrechtsschutz auf Originalwerke, während die europäische Doktrin die persönliche Note des Schöpfers betont. Diese Unterscheidung wird entscheidend, wenn es um KI-generierte Musik geht. Das U.S. Copyright Office hat erklärt, dass es keine Werke registrieren wird, die von einer Maschine oder einem rein mechanischen Prozess erzeugt werden, der zufällig oder automatisch ohne kreativen Input oder Intervention eines menschlichen Urhebers funktioniert.

Im Jahr 2023 gab es mindestens einen viel beachteten Fall, in dem es um Urheberrechtsfragen im Zusammenhang mit KI-generierter Musik ging, die beliebte Künstler imitiert. Ein Titel namens “Heart on My Sleeve”, bei dem KI eingesetzt wurde, um die Stimmen von Drake und The Weeknd zu imitieren, wurde auf Streaming-Dienste hochgeladen und dann umgehend entfernt. Universal Music reichte eine Klage bei YouTube ein, woraufhin das Video des Titels vom Netz genommen wurde. Dieser Vorfall warf Fragen zu den Persönlichkeitsrechten und der unerlaubten Nutzung der Stimmen von Künstlern auf, Diese Aktion ist ein Präzedenzfall dafür, wie die Industrie mit KI-erstellten Inhalten umgehen könnte, die den Werken von Künstlern sehr ähnlich sind.

Für Künstler ist die KI ein zweischneidiges Schwert. Einige begrüßen die Technologie als Werkzeug für die Zusammenarbeit, während andere befürchten, dass sie ihr Handwerk abwertet.

Musikunternehmen stehen vor ihren eigenen Herausforderungen.

2. Marktprognosen

Die KI auf dem Musikmarkt ist bereit für ein signifikantes Wachstum. Branchenanalysten erwarten, dass der Sektor bis 2033 auf $38,7 Mrd. ansteigen, gegenüber $3,9 Mrd. im Jahr 2023. Diese Verzehnfachung spiegelt die erwartete breite Anwendung von KI-Tools in verschiedenen Bereichen der Musikproduktion, des Vertriebs und des Konsums wider. Interessant, Künstler suchen verstärkt nach KI-gestützten Tools in der Musikproduktion und im Musikmastering (66%) und nicht für die KI-Musikgenerierung (47%). Kreativitätsfördernde Werkzeuge werden als wichtiger angesehen als reine KI-Generierungswerkzeuge, auch wenn wir uns darauf einstellen müssen, immer mehr KI-generierte Musikextrakte zu hören.

II. Mögliche Transformationen

1. Demokratisierung der Musikproduktion

Die KI senkt die Einstiegshürden für die Musikproduktion. Werkzeuge, die früher teure Studios und eine jahrelange Ausbildung erforderten, sind jetzt über benutzerfreundliche Apps zugänglich. Diese Demokratisierung könnte zu einer Explosion von neuen Musikstilen und Stimmen führen.

Der Gründer und CEO von Boomy, Alex Mitchell, stellt sich eine Zukunft vor, in der jeder ein Komponist sein kann. “Wir beobachten, dass Menschen auf der ganzen Welt mit Boomy sofortige Songs erstellen, sie veröffentlichen und sogar an den Tantiemen verdienen. Das ist das erste Mal, musikalischer Ausdruck ist für eine völlig neue Art von Schöpfer und audience” . Diese Zugänglichkeit könnte die Musiklandschaft grundlegend verändern und möglicherweise Talente ans Tageslicht bringen, die sonst vielleicht unentdeckt geblieben wären.

2. Neue Künstler-Publikum-Interaktionen

KI verändert in der Tat die Art und Weise, wie Künstler mit ihren Fans in Kontakt treten audience. Einige Künstler und Musikplattformen experimentieren bereits mit KI-gesteuerten Chatbots, die es Fans ermöglichen, auf neuartige Weise mit ihrem Musikkatalog zu interagieren. Spotify hat beispielsweise einen KI-gesteuerten Chatbot in seine Anwendung integriert, der mit den Nutzern interagiert, um deren Musikvorlieben, Stimmungen und Hörgewohnheiten zu verstehen. Auf diese Weise kann der Chatbot individuelle Wiedergabelisten zusammenstellen und neue Titel vorschlagen, die auf den individuellen Geschmack des Nutzers zugeschnitten sind.

Diese KI-Chatbots werden eingesetzt, um die Einbindung der Fans zu verbessern, indem sie personalisierte Empfehlungen, Echtzeit-Updates und interaktive Erfahrungen bieten. Sie können Künstler-Updates anbieten, Playlists empfehlen, Ticketkäufe erleichtern und Fananfragen verwalten und so eine tiefere Verbindung zwischen Künstlern und ihren audience fördern.

Eine vorausschauende Künstlerin, Holly Herndon, hat vor kurzem eine KI-Version ihrer Stimme auf den Markt gebracht, mit der Fans zusammenarbeiten können, um personalisierte Tracks zu erstellen. Diese Verschmelzung von menschlicher Kreativität und KI-Fähigkeiten deutet auf eine Zukunft hin, in der die Grenze zwischen Künstler und audience zunehmend fließend wird.

Eine vielschichtige Schlussfolgerung

I. Die Rolle der KI bei der Kreativität

Die Integration von KI in die Musikproduktion wirft tiefgreifende Fragen über das Wesen der Kunst auf. Während die einen argumentieren, dass die KI lediglich ein Werkzeug ist, ähnlich wie ein neues Instrument, befürchten andere, dass sie das menschliche Element, das die Musik emotional mitschwingen lässt, schmälern könnte.

Marius Blanchard, Data-Wissenschaftler an der Columbia University und in der Musikindustrie tätig, bietet eine ausgewogene Perspektive: “Ich glaube nicht, dass KI jemals Künstler ersetzen wird; [...] die audience-Künstler-Verbindung lebt auf vielen verschiedenen Ebenen über die Musik hinaus. Stattdessen hoffe ich, dass die KI den Zugang zu qualitativ hochwertiger Klangproduktion demokratisieren und immer mehr Künstlern einen Kreativitätsschub geben wird, damit sie ihre Kreationen ausdrücken und mit anderen teilen können.”

II. Auswirkungen auf die Arbeitsplätze in der Industrie

Mit dem Ausbau der KI-Fähigkeiten könnten sich bestimmte Funktionen in der Musikindustrie weiterentwickeln oder überflüssig werden. Toningenieure zum Beispiel müssen ihre Fähigkeiten möglicherweise anpassen, um mit KI-Mixing- und Mastering-Tools arbeiten zu können. Es werden aber wahrscheinlich auch neue Berufskategorien entstehen, wie z.B. KI-Musikprogrammierer oder ethische KI-Berater für die Kreativindustrie.

III. Authentizität und emotionale Bindung

Die vielleicht wichtigste Frage, mit der sich die Branche konfrontiert sieht, ist, ob KI-generierte Musik die gleichen emotionalen Verbindungen zu den Hörern herstellen kann wie von Menschen geschaffene Werke. KI kann zwar Muster analysieren und technisch versierte Kompositionen erstellen, aber die unbeschreibliche Qualität der menschlichen Erfahrung, die oft in großartiger Musik steckt, bleibt eine Herausforderung, die es zu reproduzieren gilt.

Elektronikmusiker und KI-Forscher Holly Herndon bietet eine optimistische Sichtweise: “Ich denke, der beste Weg nach vorne ist, dass sich Künstler an die Entwicklungen des maschinellen Lernens anlehnen”, sagte sie und schlug vor, dass sie “über Möglichkeiten nachdenken, andere bedingt zum Experimentieren mit ihnen einzuladen.”

Referenzen

Jeff Ens und Philippe Pasquier, (2020). MMM : Erforschung bedingter Mehrspurigkeit

Musikerzeugung mit dem Transformator. arXiv preprint arXiv:2008.06048 https://arxiv.org/abs/2008.06048

Andrea Agostinelli et al, (2023). MusicLM: Generierung von Musik aus Text. arXiv preprint arXiv:2301.11325 https://arxiv.org/abs/2301.11325

Huang et al, (2018). Music Transformer: Generierung von Musik mit langfristiger Struktur. arXiv preprint arXiv:1809.04281 https://arxiv.org/abs/1809.04281

Ke Chen et al, (2023). MusicLDM: Verbesserung der Neuartigkeit bei der Text-zu-Musik-Generierung durch Beat-synchrone Mixup-Strategien. arXiv preprint arXiv:2308.01546 https://arxiv.org/abs/1809.04281

BLOG

BLOG