Del estudio al streaming: La influencia de la IA en la configuración de la música y su impacto en el mercado

La primera actuación en directo documentada en la que se mezclaron la IA generativa y un músico tuvo lugar en noviembre de 2022, cuando el pianista David Dolan (Guildhall School of Music and Drama) improvisó en diálogo con un sistema de IA semiautónomo diseñado por el compositor Oded Ben-Tal (Universidad de Kingston). Este concierto pionero demostró las posibilidades creativas de la IA como socio colaborador en la música. Desde entonces, músicos e incluso no músicos han adoptado la IA generativa, produciendo composiciones completas con voces, instrumentos e incluso sonidos de instrumentos inexistentes. Esto marca el comienzo de una nueva era en la que la IA está remodelando la creación y producción musical. Mientras la artificial intelligence sigue remodelando las industrias, el mundo de la música está experimentando su propia revolución. Desde los aficionados hasta los grandes sellos discográficos, las partes interesadas de todo el sector están lidiando con las implicaciones de esta tecnología.

La industria musical, históricamente moldeada por los avances tecnológicos, está entrando en una nueva fase de transformación. Con el amplio impacto de la industria musical en el entretenimiento, los medios de comunicación y las plataformas de streaming que albergan millones de canciones, la integración de la IA promete redefinir la forma en que se crea, produce y consume la música.

La IA generativa, la tecnología que está detrás de este cambio sísmico, ha evolucionado rápidamente de la investigación académica a las aplicaciones prácticas. Modelos como Music Transformer y MusicLM están ampliando los límites de lo posible, traduciendo conceptos abstractos en composiciones armoniosas. Estos sistemas de IA, entrenados con vastos datasets de piezas musicales, pueden ahora generar melodías originales, armonías e incluso canciones enteras con una destreza asombrosa.

Sin embargo, como ocurre con cualquier revolución tecnológica, el auge de la IA en la música suscita tanto entusiasmo como ansiedad. Los artistas y los profesionales de la industria están divididos sobre su impacto potencial. Algunos la ven como una poderosa herramienta para la creatividad y la democratización, mientras que otros se preocupan por las implicaciones para el arte humano y la seguridad laboral.

El panorama de la industria musical ya está cambiando. Las plataformas de streaming están aprovechando la IA para crear listas de reproducción personalizadas, mientras que el software de producción está incorporando herramientas de mezcla y masterización asistidas por IA. Incluso los grandes sellos discográficos están explorando el potencial de la IA para la búsqueda de talentos y la predicción de tendencias.

A medida que nos adentramos en esta nueva era, abundan las preguntas. ¿Cómo remodelará la IA las funciones de artistas, productores e ingenieros? ¿Qué consideraciones legales y éticas debemos abordar? Y quizá lo más importante, ¿cómo afectará esta tecnología a la conexión emocional entre los músicos y sus audience?

En este artículo, exploraremos el estado actual de la IA generativa en la música, sus aplicaciones en distintos sectores de la industria y el futuro potencial que anuncia. Desde la tecnología que hay detrás de estos modelos de IA hasta los retos prácticos que plantea su introducción en el mercado, examinaremos cómo esta innovación está preparada para transformar una de las industrias creativas más queridas e influyentes del mundo.

A medida que la industria musical se adentra en esta era impulsada por la IA, es evidente que los futuros compositores podrían no ser únicamente humanos, lo que marca un cambio significativo a medida que la industria navega por esta nueva frontera.

1. La tecnología detrás de la IA generativa para la música

De la composición al código: Los avances de la IA generativa en la música

El viaje desde la composición tradicional a la música generada por IA ha sido poco menos que rompedor. Estamos familiarizados con la generación de textos mediante chatGPT y la generación de imágenes con Stable diffusion y MidJourney. Los mayores avances en la generación de música residen en la adaptación de esos potentes modelos a las especificidades de la música data.

I. GPT para la música (generación discreta)

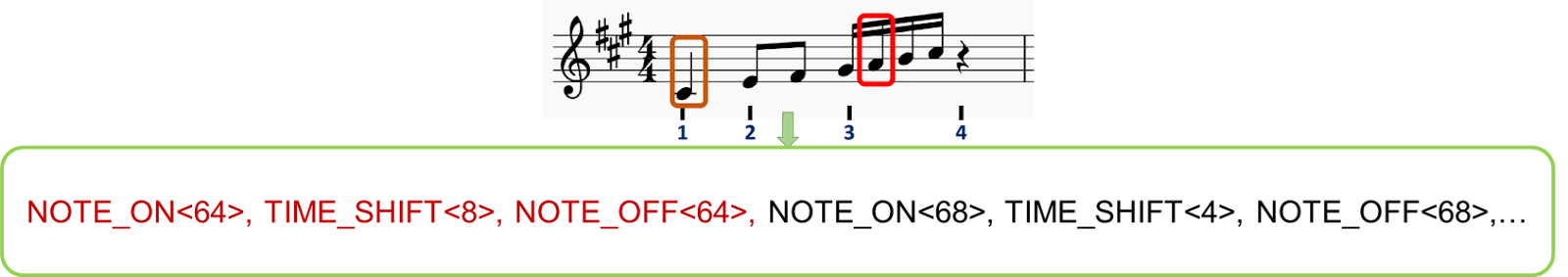

Al igual que los modelos GPT procesan el lenguaje, pueden aplicarse principios similares a los elementos musicales. La clave reside en la tokenización: descomponer la música en unidades discretas y manejables. El proceso de aplicar los modelos GPT a la música mediante la tokenización es un paso crucial para que la IA pueda comprender y generar música. He aquí una explicación más detallada:

1. Tokenización en la música: Al igual que los modelos GPT descomponen el texto en tokens (palabras o subpalabras), la música necesita descomponerse en unidades discretas que la IA pueda procesar. A continuación exploramos dos métodos de tokenización:

i. Las notas pueden verse como un elemento discreto que contiene múltiples informaciones :

a) Tono: La nota concreta que se está tocando (por ejemplo, do, re, mi, etc.)

b) Duración: Cuánto tiempo se mantiene la nota (por ejemplo, negra, blanca)

c) Velocidad: Lo fuerte o suave que se toca la nota

d) Instrumento: Qué instrumento está tocando la nota

ii. Ejemplo : una nota C4 tocada durante un cuarto de tiempo podría representarse con fichas : ; ; , mientras que una nota G3 tocada durante medio tiempo podría tokenizarse en ; ;

( podemos añadir tokens para velocidades, estructuras de compases, instrumentos, géneros,...)

iii. Creación de secuencias numéricas:

A continuación, estas series de notas-tokens se concatenan y ordenan en secuencias, de forma similar a como las palabras forman frases en los modelos lingüísticos. A cada token se le asigna un ID numérico único, lo que permite al modelo GPT recibir una entrada similar a la de la generación de texto.

iv. Ejemplo : Una frase musical tiene el aspecto siguiente [123; 8; 456; 118; 12; 451;...] donde cada número representa un evento musical específico.

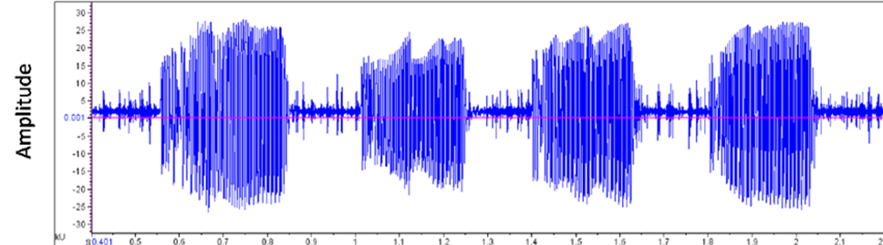

i. Los archivos de audio se almacenan en los ordenadores en un formato de onda, que representa la amplitud de la señal a lo largo del tiempo. Lo que proporciona una representación más rica que las simples partituras.

ii. Esta onda puede dividirse en segmentos que representen el “significado de la música” utilizando un modelo entrenado (similar al BERT para vectores de palabras) que crea una versión tokenizada de la entrada de audio.

iii. Los vectores resultantes pueden condicionarse mediante una incrustación conjunta de audio y texto, creando tokens que representen tanto las características de audio como la descripción textual, lo que permite al usuario utilizar un texto-pista como entrada durante la inferencia.

2. Entrenamiento de la IA:

3. Generación:

Music Transformer, desarrollado por el proyecto Magenta de Google, marcó un hito significativo en este campo. Al ser de los primeros en aplicar el mecanismo de atención del Transformer -una piedra angular de los modelos lingüísticos- a secuencias musicales, consiguió una coherencia notable en composiciones de larga duración. Otros modelos siguieron su ejemplo, cada uno ampliando los límites de lo que la IA podía lograr en la creación musical.

II. Modelos de difusión para la música (Generación continua)

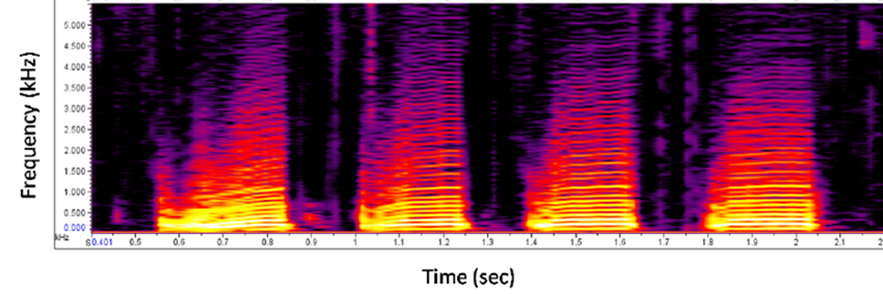

Los modelos de difusión, como MidJourney o Stable Diffusion, han sido ampliamente adoptados y utilizados para la generación de imágenes. Las imágenes generadas son cada vez más detalladas y personalizables, mostrando una gran coherencia a la vez que se añaden detalles de estilo o resolución en un aviso. Esta personalización es una característica interesante también para la generación de música. ¿Cómo podemos convertir la música en una imagen?

La música como imagen:

Al considerar los espectrogramas como imágenes y alinearlos con una descripción de texto, es posible tener un potente control sobre la generación, permitiendo a los usuarios indicar la música que desean como harían con las imágenes con MidJourney.

Acortando distancias entre la innovación y la industria: Retos en la generación de música con IA:

Hemos explorado 2 formas diferentes de generar música utilizando la IA. Todas estas tecnologías dieron lugar a demostraciones impresionantes y entretenidas. Sin embargo, el camino desde los experimentos de laboratorio hasta los productos listos para el mercado está plagado de desafíos. Abundan los obstáculos técnicos, desde garantizar una calidad homogénea en varios estilos musicales hasta gestionar las exigencias informáticas de la generación en tiempo real. Los retos del mercado son igualmente desalentadores, ya que los desarrolladores luchan por encontrar el audience y los casos de uso adecuados para sus compositores de IA.

Las consideraciones legales y de gestión añaden más complejidad. Crear y dirigir equipos en la intersección de la música y la IA requiere una mezcla única de habilidades. Mientras tanto, el panorama ético y jurídico sigue siendo en gran medida inexplorado, planteando cuestiones sobre los derechos de autor, la autoría y la propia naturaleza de la creatividad en la era de la IA.

A medida que profundizamos en las aplicaciones actuales y los productos que surgen de esta revolución tecnológica, queda claro que el impacto de la IA en la industria musical será de gran alcance y afectará a todas las partes interesadas, desde los oyentes hasta los grandes sellos discográficos.

2. Aplicaciones y productos actuales

A medida que la IA generativa sigue desarrollándose, han surgido diversas plataformas y herramientas en la industria musical. Estas innovaciones están pasando de conceptos experimentales a aplicaciones prácticas, y cada una de ellas ofrece diferentes capacidades y usos potenciales.

I. El más utilizado en la actualidad: Suno.AI

En el panorama de la generación de música por IA, Suno.AI ha acaparado una gran atención. La plataforma permite a los usuarios crear música a partir de indicaciones de texto, generando canciones completas que incluyen voces, instrumentación y letras de varios géneros y estilos.

Suno.AI ha registrado una base de usuarios de 12 millones y ha completado con éxito rondas de financiación, alcanzando una valoración de $500 millones. La plataforma ofrece niveles gratuitos y de pago, y la versión gratuita permite a los usuarios crear un número limitado de canciones al día. Sus aplicaciones abarcan desde maquetas de tráilers de películas hasta bandas sonoras de videojuegos.

Un cineasta que trabaje en un cortometraje podría utilizar Suno.AI para generar una banda sonora personalizada cuando no pueda contratar a un compositor. Las agencias de publicidad están explorando la plataforma para crear rápidamente jingles y música de fondo para anuncios, alterando potencialmente su flujo de trabajo para la música en publicidad.

II. Otras plataformas de música con IA

Aunque Suno.AI ha acaparado la atención, forma parte de un ecosistema creciente de plataformas musicales de IA.

A medida que estas plataformas evolucionan y surgen otras nuevas, las aplicaciones de la IA en la música siguen diversificándose. Desde los creadores individuales hasta las grandes corporaciones, los usos potenciales abarcan un amplio abanico, lo que indica un futuro en el que la IA podría desempeñar un papel cada vez más significativo en la creación y producción musical.

3. Impacto en las diferentes partes interesadas

A medida que la IA generativa sigue evolucionando, su impacto reverbera en todas las facetas de la industria musical. Desde los oyentes hasta los grandes sellos discográficos, cada grupo está experimentando un cambio en su relación con la creación y el consumo de música. Mientras que algunos contemplan estos cambios con inquietud, otros los ven como la progresión natural de una industria que siempre ha estado moldeada por los avances tecnológicos.

I. Oyentes

El viaje de los consumidores de música ha sido uno de creciente personalización y descubrimiento. Antes de la IA, los oyentes confiaban en los DJ de la radio, las revistas musicales y el boca a boca para descubrir nueva música. Las listas de reproducción se confeccionaban minuciosamente a mano, a menudo limitadas por las bibliotecas musicales personales.

Con la llegada de la IA, plataformas como Spotify introdujeron funciones como Discover Weekly en julio de 2015, utilizando algoritmos para analizar los hábitos de escucha y sugerir nuevas pistas. Esto supuso un salto significativo en el descubrimiento personalizado de música, exponiendo a los oyentes a una gama más amplia de artistas y géneros.

Ahora, con la IA generativa, estamos a las puertas de una experiencia aún más personalizada. LifeScore es un sistema que no sólo recomienda la música existente, sino que crea nuevas composiciones basadas en el estado de ánimo, la actividad o incluso la data biométrica del oyente. Un corredor podría tener una banda sonora personalizada generada en tiempo real, que se adapte a su ritmo y frecuencia cardiaca, mezclando sus géneros favoritos en algo totalmente nuevo.

II. Artistas

Para los músicos, el proceso creativo siempre ha estado influido por las herramientas y tecnologías disponibles. Antes de la IA, la composición dependía en gran medida de los instrumentos tradicionales y las técnicas de grabación. La introducción de sintetizadores y estaciones de trabajo de audio digital (DAW) a finales del siglo XX ya empezó a remodelar la forma de crear música. Como señaló Jean-Michel Jarre, pionero de la música electrónica : ”La tecnología siempre ha dictado los estilos y no al revés. Gracias a que inventamos el violín, Vivaldi hizo la música que hizo... Para mí, la IA no es necesariamente un peligro si se utiliza bien”.

El software de composición puede sugerir progresiones de acordes o melodías, sirviendo como socio colaborador en el proceso creativo.

Con la IA generativa, estamos asistiendo a la aparición de la co-escritura con IA. Ahora los artistas pueden introducir una melodía básica o una idea lírica y hacer que un sistema de IA genere elementos complementarios, lo que puede dar lugar a nuevas direcciones creativas. Algunos músicos están incluso experimentando con la adaptación del estilo en tiempo real durante las actuaciones en directo, utilizando la IA para transformar su sonido sobre la marcha basándose en las reacciones del audience.

Para los artistas aficionados, múltiples aplicaciones de formación están haciendo un buen uso de la IA para proponer experiencias de aprendizaje en tiempo real, interactivas y personalizadas. Con otras herramientas que permiten simular arreglos y bandas, se reduce el coste de aprendizaje de la creatividad, lo que permite a más personas tocar y disfrutar de la música.

III. Ingenieros

El papel de los ingenieros de audio ha sido el de una adaptación constante a las nuevas tecnologías. Tradicionalmente, la mezcla y la masterización eran procesos totalmente manuales, que requerían un oído agudo y años de experiencia. Interrogado para este artículo, Marius Blanchard, Data Científico de Spotify's mencionó: “La IA no está aquí para sustituir a los músicos, sino para darles poder. Es una herramienta que puede ayudar a los artistas a explorar nuevos territorios creativos y ampliar los límites de la creación musical.”

La IA ya ha hecho incursiones en este ámbito, con herramientas como Neutrón de iZotope que ofrecen asistencia inteligente para la mezcla. Estos sistemas pueden analizar una pista y sugerir ajustes de ecualización, niveles de compresión y otros parámetros, agilizando el proceso de mezcla.

A medida que la IA generativa se vuelva más sofisticada, es posible que veamos sistemas de mezcla y masterización totalmente automatizados que puedan procesar un álbum entero con una intervención humana mínima. Sin embargo, muchos en la industria sostienen que el toque humano siempre será necesario para captar los matices emocionales de una actuación.

IV. Empresas musicales y plataformas

Los sellos discográficos y los editores de música han confiado durante mucho tiempo en la intuición humana y en los estudios de mercado para detectar tendencias y descubrir nuevos talentos. Los ejecutivos de A&R (Artistas y Repertorio) rastreaban los clubes y las cintas de maquetas, en busca de la próxima gran novedad.

La integración de la IA ha desplazado este proceso hacia la toma de decisiones data-driven. Las plataformas analizan el streaming data, la participación en las redes sociales y otras métricas para identificar a los artistas en alza y predecir el potencial de éxito.

Con la IA generativa, las empresas musicales están explorando posibilidades aún más radicales. Algunas están experimentando con sistemas de IA que pueden generar música adaptada a segmentos de mercado o demográficos específicos. Otras están utilizando modelos predictivos para prever qué estructuras de canciones o temas líricos es probable que resuenen entre los audience en los próximos meses.

Mientras la industria lidia con estos cambios, la pregunta clave sigue siendo: ¿Cómo evolucionará el equilibrio entre la creatividad humana y la asistencia de la IA? Mientras que algunos temen la pérdida del toque humano en la creación musical, otros ven la IA como una herramienta que, en última instancia, potenciará la creatividad humana, abriendo nuevas vías de expresión y colaboración.

4. Visiones de futuro y oportunidades

A medida que la IA generativa sigue remodelando la industria musical, las partes interesadas se enfrentan a un complejo panorama de consideraciones jurídicas, económicas y éticas. Esta tecnología transformadora promete democratizar la creación musical al tiempo que desafía las nociones tradicionales de arte y derechos de autor.

I. Consideraciones legales y de mercado

1. Los derechos de autor en la era de la IA

Antes de la aparición de la IA, las leyes de derechos de autor en la música eran relativamente sencillas. Los compositores y los intérpretes tenían derechos sobre sus obras originales, con directrices claras sobre el muestreo y el uso justo. Sin embargo, la introducción de la música generada por IA ha difuminado estas líneas de forma significativa.

En Estados Unidos, la protección de los derechos de autor se extiende a las obras originales de autor, mientras que la doctrina europea hace hincapié en el toque personal del creador. Esta distinción resulta crucial cuando se considera la música generada por IA. La Oficina de Derechos de Autor de EE.UU. ha declarado que no registrará las obras producidas por una máquina o un mero proceso mecánico que funcione de forma aleatoria o automática sin la aportación creativa o la intervención de un autor humano.

En 2023, al menos un caso de gran repercusión puso de manifiesto la preocupación por los derechos de autor en torno a la música generada por IA que imitaba a artistas populares. Un tema llamado “Heart on My Sleeve” que utilizaba IA para imitar las voces de Drake y The Weeknd se subió a los servicios de streaming y luego se retiró rápidamente. Universal Music presentó una reclamación en YouTube, y el vídeo de la pista fue retirado. Este incidente planteó cuestiones en torno a los derechos de la personalidad y el uso no autorizado de las voces de los artistas, Esta acción sentó un precedente sobre cómo la industria podría tratar los contenidos creados por la IA que se asemejen mucho al trabajo de los artistas existentes.

Para los artistas, la IA presenta un arma de doble filo. Algunos abrazan la tecnología como una herramienta de colaboración, mientras que otros temen que pueda devaluar su oficio.

Las compañías musicales se enfrentan a sus propios retos.

2. Proyecciones de mercado

La IA en el mercado de la música está preparada para un crecimiento significativo. Los analistas de la industria proyectan que el sector alcanzará los 1.466T38.700 millones en 2033, frente a los 1.466T3.900 millones de 2023. Esta multiplicación por diez refleja la adopción generalizada prevista de herramientas de IA en diversos aspectos de la producción, la distribución y el consumo de música. Interesante, los artistas buscan más herramientas basadas en IA en la producción musical y la masterización de música (66%) más que para la generación de música por IA (47%). Las herramientas que permiten la creatividad se consideran más importantes que las herramientas de generación de IA pura, aunque tengamos que prepararnos para escuchar cada vez más extractos musicales generados por IA.

II. Transformaciones potenciales

1. Democratización de la producción musical

La IA está reduciendo las barreras de entrada a la creación musical. Las herramientas que antes requerían costosos estudios y años de formación son ahora accesibles a través de aplicaciones fáciles de usar. Esta democratización podría dar lugar a una explosión de nuevos estilos y voces musicales.

Fundador de una startup de tecnología musical, Alex Mitchell, director general de Boomy, imagina un futuro en el que cualquiera pueda ser compositor. “Ahora, estamos viendo a gente de todo el mundo crear canciones instantáneas con Boomy, publicarlas e incluso obtener ingresos por derechos de autor. Por primera vez, expresión musical está al alcance de un tipo de creador totalmente nuevo y audience” . Esta accesibilidad podría alterar fundamentalmente el panorama musical, descubriendo potencialmente talentos que de otro modo podrían haber quedado sin descubrir.

2. Nuevas interacciones artista-público

En efecto, la IA está remodelando la forma en que los artistas conectan con sus audience. Algunos artistas y plataformas musicales ya están experimentando con chatbots impulsados por IA que permiten a los fans interactuar con su catálogo musical de formas novedosas. Por ejemplo, Spotify introdujo en su aplicación un chatbot impulsado por IA que interactúa con los usuarios para comprender sus preferencias musicales, estados de ánimo y hábitos de escucha. Esto permite al chatbot confeccionar listas de reproducción personalizadas y sugerir nuevas canciones adaptadas al gusto único de cada usuario.

Estos chatbots de IA se están utilizando para mejorar el compromiso de los fans proporcionándoles recomendaciones personalizadas, actualizaciones en tiempo real y experiencias interactivas. Pueden ofrecer actualizaciones de los artistas, recomendar listas de reproducción, facilitar la compra de entradas y gestionar las consultas de los fans, fomentando conexiones más profundas entre los artistas y sus audience.

Una artista con visión de futuro, Holly Herndon, lanzó recientemente una versión de su voz hecha con IA con la que los fans pueden colaborar para crear pistas personalizadas. Esta mezcla de creatividad humana y capacidades de IA apunta a un futuro en el que la línea entre artista y audience sea cada vez más fluida.

Una conclusión polifacética

I. El papel de la IA en la creatividad

La integración de la IA en la creación musical plantea profundos interrogantes sobre la naturaleza del arte. Mientras que algunos sostienen que la IA no es más que una herramienta, similar a un nuevo instrumento, otros temen que pueda disminuir el elemento humano que hace que la música sea emocionalmente resonante.

Marius Blanchard, científico Data de la Universidad de Columbia y que trabaja en la industria musical, ofrece una perspectiva equilibrada: “No creo que la IA llegue a sustituir a los artistas; [...] la conexión audience-artista vive en muchos niveles diferentes más allá de la música. En cambio, espero que la IA democratice el acceso a la producción de sonido de calidad y sea un impulso a la creatividad para que cada vez más artistas expresen y compartan sus creaciones.”

II. Impacto en los empleos de la industria

A medida que crecen las capacidades de la IA, ciertos roles dentro de la industria musical pueden evolucionar o quedarse obsoletos. Los ingenieros de sonido, por ejemplo, puede que tengan que adaptar sus habilidades para trabajar con herramientas de mezcla y masterización de IA. Sin embargo, es probable que surjan nuevas categorías laborales, como programadores musicales de IA o consultores éticos de IA para las industrias creativas.

III. Autenticidad y conexión emocional

Quizá la cuestión más importante a la que se enfrenta la industria es si la música generada por IA puede forjar las mismas conexiones emocionales con los oyentes que las obras creadas por humanos. Aunque la IA puede analizar patrones y crear composiciones técnicamente competentes, la inefable calidad de la experiencia humana que a menudo infunde la gran música sigue siendo un reto a replicar.

Músico electrónico e investigador en IA Holly Herndon ofrece una visión optimista: “Creo que la mejor manera de avanzar es que los artistas se apoyen en los desarrollos con aprendizaje automático”, dijo, sugiriendo que “piensen en formas de invitar condicionalmente a otros a experimentar con ellos”.”

Referencias

Jeff Ens y Philippe Pasquier, (2020). MMM : Exploración de la multipista condicional

Generación de música con el transformador. arXiv preprint arXiv:2008.06048 https://arxiv.org/abs/2008.06048

Andrea Agostinelli et al, (2023). MusicLM: Generating Music From Text. arXiv preprint arXiv:2301.11325 https://arxiv.org/abs/2301.11325

Huang et al, (2018). Transformador de Música: Generating Music with Long-Term Structure. arXiv preprint arXiv:1809.04281 https://arxiv.org/abs/1809.04281

Ke Chen et al, (2023). MusicLDM: Enhancing Novelty in Text-to-Music Generation Using Beat-Synchronous Mixup Strategies. arXiv preprint arXiv:2308.01546 https://arxiv.org/abs/1809.04281

BLOG

BLOG