A história até agora: Da correspondência ao raciocínio

- Fundações iniciais (1998-2015): A classificação e a correspondência definiram os primeiros anos do Google. Atualizações como Panda e Penguin impulsionaram o ecossistema em direção à classificação com foco na relevância e qualidade do conteúdo. Seu enorme database, Gráfico de conhecimento, mudou a busca de correspondência de strings para reconhecimento de entidades. O lançamento do E-A-T (Expertise, Authoritativeness, Trustworthiness) enfatizou a importância da conteúdo confiável, preciso e fidedigno, enquanto o RankBrain introduziu o aprendizado de máquina na classificação.

- O salto neural (2017-2019): A arquitetura Transformer do Google possibilitou a compreensão semântica e lançou as bases dos LLMs modernos. O BERT (Bidirectional Encoder Representations from Transformers) do Google ajudou a analisar as nuances das consultas, movendo a pesquisa ainda mais mais próximo da compreensão do idioma.

- Diversificação da plataforma (2010 até agora): Como o comportamento do usuário mudou para o uso mais predominante das mídias sociais, a descoberta se expandiu pelo YouTube, TikTok, Reddit e Pinterest, cada um com audiences e sinais de confiança exclusivos.

- A mudança generativa (2022-2023): Com o lançamento do ChatGPT pela OpenAI, a IA generativa entrou na pesquisa. O Bing integrou o GPT; o Google lançou o Bard e o AI Overviews. A pesquisa começou a “responder”.”

- A SERP com IA em primeiro lugar (2024-2025): O AI Mode e o Overviews reconfiguraram as SERPs (Search Engine Results Pages) em um espaço de trabalho de conversação, onde o raciocínio e a síntese são mais importantes do que a classificação.

“A IA vem moldando a pesquisa há anos, mas o tipo, a escala e a velocidade da mudança que estamos vendo agora são diferentes. Não se trata apenas de uma nova tecnologia; é uma redefinição de como, onde e por que as pessoas pesquisam e como a pesquisa funciona.” - Charlie Kay

Como os LLMs (modelos de linguagem grandes) funcionam e afetam a pesquisa

Os modelos de linguagem ampla, ou LLMs, são os cérebros por trás do ChatGPT, Gemini, Claude e de todos os chatbots ou resumos baseados em IA que o senhor viu aparecer nos mecanismos de pesquisa recentemente. Eles aprendem padrões de linguagem a partir dessa documentação e usam esse conhecimento para:

- Entenda as consultas em linguagem natural,

- Gerar respostas fluentes e semelhantes às humanas,

- Resumir ou reformular o conteúdo,

- Inferir relações entre palavras, conceitos e ideias.

Os LLMs são treinados em vastos datasets, tokenizado em padrões matemáticos. Eles geram texto prevendo tokens ou séries de tokens, às vezes aumentados pela geração aumentada por recuperação (RAG), que combina conhecimento estático com fontes em tempo real.

Diferentemente da pesquisa tradicional, os LLMs não apenas rastreiam a Web para obter resultados; eles criam respostas, muitas vezes raciocinando passo a passo. A visibilidade agora depende de ser estruturada, acessível e “pronta para o raciocínio”.”

O Google lança o AI Overviews e o AI Mode

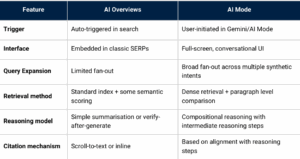

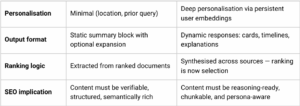

Antes, o SEO se concentrava na otimização de páginas para uma consulta, mas, com a pesquisa generativa, agora temos que otimizar para um espaço que é hiperpersonalizado, que prioriza a intenção, que tem várias consultas e que é orientado pelo raciocínio. As visões gerais de IA e o modo de IA são criados e funcionam de forma diferente da pesquisa tradicional do Google.

- Visão geral da IA: Os resumos extrativos são incorporados nas SERPs, reformulando o conteúdo com citações. As impressões aumentam, mas os cliques diminuem, pois as respostas aparecem diretamente na SERP.

- Modo AI: Uma experiência de conversação em tela cheia, o AI Mode usa expansão de consulta, traços de raciocínio e comparações em nível de parágrafo, criando respostas dinamicamente. O conteúdo não é classificado, mas julgado.

Juntos, eles marcam uma nova lógica: de palavras-chave a clusters de intenção, classificações a raciocínios, cliques a citações.

Modo IA vs. visões gerais de IA: Uma comparação lado a lado

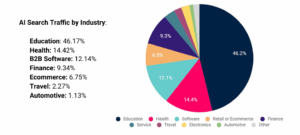

Pesquisa com IA: Quem a está adotando?

Embora a pesquisa com IA continue limitada, ela está crescendo rapidamente. Menos de dois por cento do tráfego orgânico atualmente é proveniente de pesquisas orientadas por IA, embora o tráfego de referência esteja aumentando acentuadamente. ChatGPT e Perplexity dominam as indicações de IA, A adoção é mais forte entre os audiences mais jovens e digitalmente fluentes. A busca tradicional ainda prevalece, mas a trajetória é clara.

Assistentes de IA: Quais estão sendo mais usados?

Apesar de as plataformas de IA representarem apenas uma fração do uso digital total, elas estão, sem dúvida, crescendo, e há líderes nessa corrida.

A Relatório SparkToro x Datos State of Search mostra que o ChatGPT se tornou o assistente de IA dominante em todo o mundo, chegando aos 5 principais destinos visitados a partir de mecanismos de pesquisa tradicionais nos EUA e na Europa - detendo ~30% de participação de IA. Um estudo recente estudo da SEMRush indica que o ChatGPT está realmente expandindo a maneira como as pessoas buscam informações.

De acordo com a pesquisa, 63% dos usuários do ChatGPT têm menos de 34 anos de idade, o que significa que os Millennials e a Geração Z são os maiores grupos de usuários, muitos dos quais são usuários diários. Apenas 13% dos usuários do ChatGPT têm 55 anos ou mais e apenas 5% têm mais de 65 anos.

O que essas estatísticas significam para os profissionais de marketing e as marcas

Há novas métricas de influência e visibilidade. Embora as métricas tradicionais de SEO ainda sejam importantes em circunstâncias específicas, as métricas que são relatadas precisam se adaptar e mudar. Aqui está uma lista do que as marcas e os profissionais de marketing precisam fazer:

- Pesquisa profunda do audience: Vá além das palavras-chave e use fóruns, avaliações e data social.

- Visibilidade e medição de IA: Acompanhe as citações, menções e influência de clique zero, não apenas as classificações.

- Adaptar a estratégia à plataforma: Otimize de forma diferente para Gemini, Copilot, Perplexity e ChatGPT.

- Construção de marca e relações públicas: As menções e a autoridade são sinais essenciais para a inclusão da IA.

- Reputação e confiança: O conteúdo estruturado e factualmente claro se alinha aos princípios do E-E-A-T.

- Otimização semântica e estruturada: O esquema e a clareza auxiliam a recuperação por máquina.

- Conteúdo multimodal: Otimize texto, imagens, vídeo e áudio.

- Arquitetura de conteúdo: Crie conteúdo modular e “fragmentável” que a IA possa usar.

- Capacidade de rastreamento e acesso do agente:Garanta que os assistentes possam acessar feeds e APIs.

- Feedback e monitoramento: Acompanhe como as ferramentas de IA citam e usam seu conteúdo.

- Prontidão de agente: Prepare-se para transações conduzidas por IA, nas quais os assistentes lidam com os fluxos de compra.

Conclusões finais - e um olhar para o futuro

Tanto a pesquisa tradicional quanto a pesquisa com IA estão crescendo: Alguns estudos preveem que a pesquisa com IA ultrapassará a pesquisa tradicional até 2028.

Novas pesquisas sugerem que 20% dos americanos usam ferramentas de IA 10 vezes por mês. O modo e as visões gerais de IA do Google estão mudando comportamentos, e a adoção será acelerada. Por enquanto, o SEO tradicional ainda sustenta a visibilidade da IA: uma boa classificação está correlacionada com a citação em resultados de IA.

Não se trata do fim do SEO, mas de sua evolução. Os profissionais de marketing devem deixar de otimizar as classificações e passar a otimizar o raciocínio, visando à inclusão e à influência nas respostas geradas pela IA. As marcas que prosperarem combinarão fundamentos como produtos fortes, narrativas autênticas e compreensão genuína do cliente com a adaptação à nova lógica de pesquisa da IA.

“As marcas que vencerão nesse novo ecossistema são aquelas que permanecerem visíveis em todas as plataformas, estruturarem seu conteúdo para legibilidade humana e de máquina, evoluírem suas estruturas de medição e priorizarem consistentemente o valor real, a confiança e a usabilidade. O futuro da pesquisa é em camadas, multimodal e agêntico - e a hora de se preparar é agora.” - Charlie Kay

BLOG

BLOG