Generative artificial intelligence (GenAI) ist heute eine der am weitesten verbreiteten und sich schnell entwickelnden Technologien mit einer Marktgröße, die laut einer Branchenstudie in diesem Jahr $42,17 Milliarden erreichen soll [1]. Mit Anwendungen, die von der Nutzung von Chatbots und virtuellen Assistenten bis hin zu vorausschauender Wartung und Betrugserkennung reichen, hat GenAI bereits einen großen Einfluss auf eine Vielzahl von Branchen [2].

Die rasante Entwicklung von GenAI hat jedoch auch Bedenken hinsichtlich ihrer potenziellen Risiken geweckt, was zur Schaffung von Rechtsrahmen wie dem EU-Gesetz zur Künstlichen Intelligenz (KI) [3]. Dieses Rahmenwerk soll sicherstellen, dass KI-Lösungen auf sichere, zuverlässige und ethische Weise entwickelt und eingesetzt werden, indem ein risikobasierter Ansatz eingeführt wird, der KI-Systeme in folgende Kategorien einteilt vier Ebenen nach ihrem potenziellen Risiko: inakzeptabel, hoch, begrenzt und minimal [3] - um die Umsetzung angemessener Schutzmaßnahmen zu erleichtern.

Bedenken gegenüber GenAI-Lösungen rühren daher, dass sie auf nutzergenerierte data und Eingaben angewiesen sind, die oft sensible Nutzerdaten wie Vor- und Nachnamen, IP-Adressen, E-Mail-Konten, Telefonnummern und urheberrechtlich geschützte Inhalte enthalten. Wie bei jeder Lösung, die mit sensiblen data umgeht, gibt dies Anlass zur Skepsis hinsichtlich des Datenschutzes und der Art und Weise, wie data verarbeitet wird. gesammelt, verarbeitet, gespeichert und weitergegeben [4].

Angesichts der Risiken, die mit der Implementierung von GenAI und dem Vertrauen auf den Benutzer data verbunden sind, sollten Unternehmen proaktiv Datenschutz durch Design (PbD) Prinzipien während des gesamten Lebenszyklus der Entwicklung und Bereitstellung ihrer KI-Lösungen. Dazu gehört die Identifizierung und Priorisierung der Kritische Elemente für den Schutz der Privatsphäre der Benutzer, wie die Einholung der Zustimmung der Benutzer, data Transparenz und Rechenschaftspflicht und data Anonymisierung. Indem sie Überlegungen zum Datenschutz in die Grundlagen ihrer GenAI-Systeme einbauen, können Unternehmen Risiken effektiv mindern und das Vertrauen der Nutzer fördern.

Anwendung der Grundsätze des "Privacy by Design": Wesentlich bei der Implementierung von GenAI-Lösungen

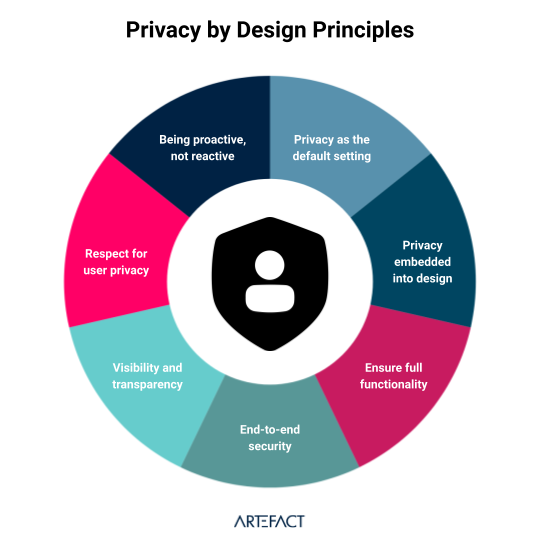

Datenschutz durch Design (PbD) ist ein Rahmenwerk für die Einbettung des Datenschutzes in das Design und die Entwicklung von Informationstechnologien und -lösungen. Es wurde von Dr. Ann Cavoukian entwickelt und veröffentlicht [5]. Wenn Unternehmen diesen Rahmen nutzen, kann er dazu beitragen, die Bedenken der Benutzer hinsichtlich des Datenschutzes bereits zu Beginn des Designprozesses zu berücksichtigen, anstatt zu versuchen, nachträglich Datenschutzfunktionen hinzuzufügen.

Der Rahmen besteht aus den folgenden Elementen sieben Grundprinzipien:

In Anbetracht der Tatsache, dass GenAI-Lösungen oft große Mengen an Nutzerdaten data sammeln und verarbeiten, wird PbD für Unternehmen, die das Vertrauen ihrer Kunden schätzen und einen guten Ruf für die Anwendung von data Best Practices im Bereich des Datenschutzes anstreben, immer wichtiger.

Entscheidende Elemente für den Schutz der Privatsphäre der Benutzer

In Erweiterung der grundlegenden Prinzipien von Privacy by Design haben wir die wichtige Elemente für Unternehmen, die die Privatsphäre der data ihrer Benutzer bei der Entwicklung ihrer GenAI-Lösungen oder jeder anderen Lösung, die sensible data enthält, schützen möchten. Diese drehen sich um effektive data governance, Dies ist eine wesentliche Komponente, um sicherzustellen, dass die Grundsätze des eingebauten Datenschutzes während der Entwicklung und des Einsatzes von GenAI-Lösungen eingehalten werden. Dazu gehört auch die Festlegung klarer Richtlinien für die Erfassung, Verarbeitung, Speicherung, Weitergabe und den Zugriff auf data. Zu diesem Zweck wird die Implementierung eines AI data governance Lösung würde dazu beitragen, den data-Verwaltungsprozess zu standardisieren und zu automatisieren und gleichzeitig die konsequente Einhaltung der PbD-Prinzipien zu gewährleisten.

Einverständnis des Benutzers einholen

Organisationen sollten die ausdrückliche Zustimmung der Nutzer einholen, bevor sie deren persönliche data für GenAI-Zwecke sammeln, verwenden oder weitergeben. Diese Zustimmung sollte in Kenntnis der Sachlage und freiwillig erfolgen, d.h. die Nutzer sollten die Möglichkeit haben, ihre Zustimmung jederzeit zurückzuziehen. Darüber hinaus sollten Organisationen ihre Datenschutzrichtlinien und -praktiken regelmäßig überprüfen und aktualisieren um sicherzustellen, dass sie mit den neuesten Gesetzen und Vorschriften übereinstimmen. Daher ist die Implementierung einer Consent Management Platform (CMP) wichtig, um den Prozess effizienter und zentraler zu gestalten.

Seien Sie transparent und rechenschaftspflichtig bei der Verwendung von data

Bei der Transparenz geht es darum, die Benutzer darüber zu informieren, wie ihr data verwendet wird. Organisationen sollten transparent darüber, wie sie persönliche data für GenAI-Zwecke sammeln, verwenden, speichern und weitergeben. Gleichzeitig sind sie verantwortlich um sicherzustellen, dass dieses data stets auf verantwortungsvolle und ethische Weise verwendet wird.

Optimieren Sie die Erfassung und Speicherung von data

Während Unternehmen oft versuchen, so viel Benutzer data wie möglich zu sammeln, erfordert das Engagement für eine verantwortungsvolle data-Verwaltung und die Grundsätze des Datenschutzes einen stärker datenschutzorientierten und strategischen Ansatz. Dazu gehört es, den Bedarf an personenbezogenen data für jede spezifische GenAI-Anwendung zu bewerten und Maßnahmen zu ergreifen, um die Dauer der Speicherung und Verarbeitung von personenbezogenen data zu optimieren.

Apply data Anonymisierungs- und De-Identifizierungsverfahren

Data Anonymisierung und De-Identifizierung sind Techniken, die dazu beitragen, die Identitäten der Benutzer zu schützen. Zu diesem Zweck sollten sie, wann immer möglich, vor der Verarbeitung personenbezogener Daten (PII) für GenAI-Zwecke eingesetzt werden.

Gewährleistung von Benutzer data und Sicherheit

Für Unternehmen ist es wichtig, Sicherheitsmaßnahmen zu ergreifen, um personenbezogene data vor unbefugtem Zugriff, unbefugter Nutzung oder Offenlegung zu schützen. Diese Sicherheitsmaßnahmen können von der Verwendung von Verschlüsselungsprotokollen und Richtlinien zur Verwaltung des Benutzerzugriffs bis hin zu Durchführung von Datenschutz-Folgenabschätzungen (PIAs), die dabei helfen können, potenzielle Datenschutzrisiken im Zusammenhang mit ihren GenAI-Lösungen zu identifizieren und zu mindern.

Integration des Datenschutzes in GenAI: Ein wesentliches Element für verantwortungsvolle Innovation

Die Anwendung von Privacy by Design (PbD)-Prinzipien bei der Entwicklung und Implementierung von GenAI-Lösungen sowie jeder anderen Lösung, die sensible data verwendet, spiegelt ein proaktives Engagement für den Datenschutz der Benutzer wider. Dieser durchgängige “nutzerzentrierte” Ansatz beinhaltet die Integration von Datenschutzüberlegungen in jeden Schritt des Lebenszyklus einer Lösung. Wenn Unternehmen dem Datenschutz von Anfang an Priorität einräumen, können sie starke, vertrauensvolle Beziehungen zu ihren Nutzern aufbauen und potenzielle Reputations- und Rechtsrisiken auf lange Sicht mindern.

Quellen

[1] Generative KI - Weltweit, Statista

[2] Der Stand der KI im Jahr 2023: Das Jahr des Durchbruchs der generativen KI von McKinsey & Company

[3] EU-Gesetz zur Künstlichen Intelligenz (KI)

[4] Generative KI ist ein juristisches Minenfeld

[5] A. Cavoukian, “Datenschutz durch Design“, Informations- und Datenschutzbeauftragter von Ontario, Kanada, 2009

BLOG

BLOG