La artificial intelligence generativa (GenAI) es una de las tecnologías más prevalentes y de más rápida evolución en la actualidad, con un tamaño de mercado que se espera que alcance los $42.170 millones este año, según las investigaciones del sector [1]. Con aplicaciones que van desde el uso de chatbots y asistentes virtuales hasta el mantenimiento predictivo y la detección de fraudes, la GenAI ya ha tenido un gran impacto en una amplia gama de industrias [2].

Sin embargo, el rápido desarrollo de la GenAI también ha suscitado preocupación por sus riesgos potenciales, lo que ha llevado al establecimiento de marcos jurídicos como el Ley de Inteligencia Artificial (IA) de la UE [3]. Este marco pretende garantizar que las soluciones de IA se desarrollen y desplieguen de forma segura, fiable y ética, introduciendo un enfoque basado en el riesgo que clasifica los sistemas de IA en cuatro niveles según su riesgo potencial: inaceptable, alto, limitado y mínimo [3] - para facilitar la aplicación de las salvaguardias adecuadas.

Las preocupaciones sobre las soluciones GenAI se derivan de su dependencia de la data y las entradas generadas por los usuarios, que a menudo incluyen información sensible del usuario como nombres y apellidos, direcciones IP, cuentas de correo electrónico, números de teléfono y contenidos protegidos por derechos de autor. Como ocurre con cualquier solución que maneje data sensible, esto suscita escepticismo sobre la privacidad personal y sobre cómo se recogidos, procesados, almacenados y compartidos [4].

Dados los riesgos asociados a la implantación de GenAI y la confianza en el usuario data, las organizaciones deben aplicar proactivamente Privacidad por diseño (PdD) principios a lo largo del ciclo de vida de desarrollo y despliegue de sus soluciones de IA. Esto incluye identificar y priorizar las elementos críticos para proteger la privacidad del usuario, como la obtención del consentimiento del usuario, data transparencia y responsabilidad, y data anonimización. Al incorporar consideraciones de privacidad en los cimientos de sus sistemas GenAI, las organizaciones pueden mitigar eficazmente los riesgos y fomentar la confianza de los usuarios.

Adopción de los principios de Privacidad por Diseño: Esencial a la hora de implantar soluciones GenAI

Privacidad por diseño (PbD) es un marco para integrar la privacidad en el diseño y el desarrollo de tecnologías y soluciones de la información. Fue desarrollado y publicado por la Dra. Ann Cavoukian [5]. Cuando lo utilizan las organizaciones, este marco puede ayudar a abordar los problemas de privacidad de los usuarios desde el principio del proceso de diseño, en lugar de intentar añadir características de privacidad con carácter retroactivo.

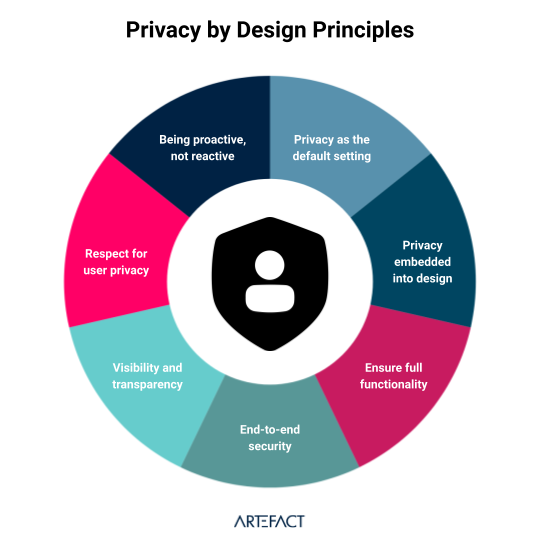

El marco se construye en torno a lo siguiente siete principios fundamentales:

Teniendo en cuenta que las soluciones GenAI a menudo recopilan y procesan grandes cantidades de data de los usuarios, la PbD es cada vez más importante para las organizaciones que valoran la confianza de los clientes y pretenden mantener una sólida reputación por adoptar las mejores prácticas de privacidad data.

Elementos críticos para proteger la privacidad de los usuarios

Ampliando los principios fundacionales de la privacidad desde el diseño, hemos identificado las elementos críticos para organizaciones que quieran proteger la privacidad de los data de sus usuarios mientras desarrollan sus soluciones GenAI, o cualquier solución que implique data sensible. Éstas giran en torno a la eficacia data governance, que es un componente esencial para garantizar que los principios de la PdD se mantengan durante todo el desarrollo y despliegue de las soluciones GenAI, e incluye el establecimiento de directrices claras para la recogida, el procesamiento, el almacenamiento, la puesta en común y el acceso a la data. Con este fin, la implantación de una Solución AI data governance ayudaría a estandarizar y automatizar el proceso de gestión de data, garantizando al mismo tiempo una adhesión coherente a los principios de PbD.

Obtener el consentimiento del usuario

Las organizaciones deben obtener el consentimiento explícito del usuario antes de recopilar, utilizar o compartir sus data personales para fines de GenAI. Este consentimiento debería ser informado y voluntario, lo que significa que los usuarios deberían tener la opción de retirar su consentimiento en cualquier momento. Además, las organizaciones deberían revisar y actualizar periódicamente sus políticas y prácticas de privacidad para asegurarse de que cumplen las últimas leyes y reglamentos. Por ello, la implantación de una Plataforma de Gestión de Consentimientos (CMP) es importante para que el proceso sea más eficaz y centralizado.

Sea transparente y rinda cuentas del uso del data

La transparencia consiste en proporcionar a los usuarios información sobre cómo se está utilizando su data. Las organizaciones deben transparente sobre cómo recopilan, utilizan, almacenan y comparten datos personales data para fines de GenAI. Al mismo tiempo, están responsable para garantizar que este data se utilice siempre de forma responsable y ética.

Garantizar la optimización de la recogida y retención de data

Mientras que las organizaciones a menudo buscan recopilar la mayor cantidad posible de data de los usuarios, demostrar un compromiso con la gestión responsable de la data y los principios de privacidad requiere un enfoque más orientado a la privacidad y estratégico. Esto incluye evaluar la necesidad de data personal para cada aplicación GenAI específica y tomar medidas para optimizar el tiempo de almacenamiento y procesamiento de data personal.

Apply data procesos de anonimización y desidentificación

Data anonimización y desidentificación son técnicas que ayudan a proteger la identidad de los usuarios. A tal fin, deben utilizarse siempre que sea posible antes de procesar información personal identificable (IPI) con fines de GenAI.

Garantizar la data y la seguridad del usuario

Es importante que las organizaciones apliquen medidas de seguridad para proteger los data personales del acceso, uso o divulgación no autorizados. Estas medidas de seguridad pueden ir desde el uso de protocolos de encriptación y políticas de gestión del acceso de los usuarios a realización de evaluaciones de impacto sobre la privacidad (PIA) que pueden ayudar a identificar y mitigar los riesgos potenciales para la privacidad asociados a sus soluciones GenAI.

Integrar la privacidad en la GenAI: un elemento esencial para la innovación responsable

La adopción de los principios de la privacidad por diseño (PbD) en el desarrollo y la implementación de las soluciones GenAI, así como de cualquier otra solución que haga uso de data sensibles, refleja un compromiso proactivo con la privacidad del usuario. Este enfoque “centrado en el usuario” de principio a fin implica integrar las consideraciones de privacidad en cada paso del ciclo de vida de una solución. Al dar prioridad a la privacidad del usuario desde el principio, las organizaciones pueden establecer relaciones sólidas y basadas en la confianza con sus usuarios y mitigar los posibles riesgos legales y de reputación a largo plazo.

Fuentes

[1] IA Generativa - En todo el mundo, Statista

[2] El estado de la IA en 2023: El año de la irrupción de la IA generativa por McKinsey & Company

[3] Ley de Inteligencia Artificial (IA) de la UE

[4] La IA generativa es un campo de minas legal

[5] A. Cavoukian, “Privacidad por diseño“, Comisionado de Información y Privacidad de Ontario Canadá, 2009

BLOG

BLOG