生成式 artificial intelligence(GenAI)是当今最流行、发展最迅速的技术之一,根据行业研究[1],其市场规模预计今年将达到 $421.7 亿美元。GenAI 的应用范围从聊天机器人和虚拟助手的使用到预测性维护和欺诈检测,已经对各行各业产生了重大影响[2]。.

然而,GenAI 的快速发展也引起了人们对其潜在风险的担忧,从而建立了一些法律框架,如《基因人工智能法》。 欧盟人工智能(AI)法 [3].该框架旨在通过引入一种基于风险的方法,将人工智能系统分为以下几类,从而确保以安全、可靠和合乎道德的方式开发和部署人工智能解决方案 四级 根据其潜在风险:不可接受、高、有限和最低[3]--以促进适当保障措施的实施。.

对 GenAI 解决方案的担忧源于它们对用户生成的 data 和输入的依赖,其中通常包括敏感的用户信息,如姓名、IP 地址、电子邮件帐户、电话号码和受版权保护的内容。与任何处理敏感 data 的解决方案一样,这引起了人们对个人隐私和 data 如何处理的怀疑。 收集、处理、存储和共享 [4].

鉴于实施 GenAI 和依赖用户 data 所带来的风险,企业应积极应用 隐私设计(PbD) 在其人工智能解决方案的整个开发和部署生命周期中,都要遵循这些原则。这包括确定和优先考虑 保护用户隐私的关键要素, 例如,获得用户同意、data 透明度和问责制以及 data 匿名化。通过将隐私因素纳入 GenAI 系统的基础,企业可以有效地降低风险并促进用户信任。.

采用隐私设计原则:在实施 GenAI 解决方案时必不可少

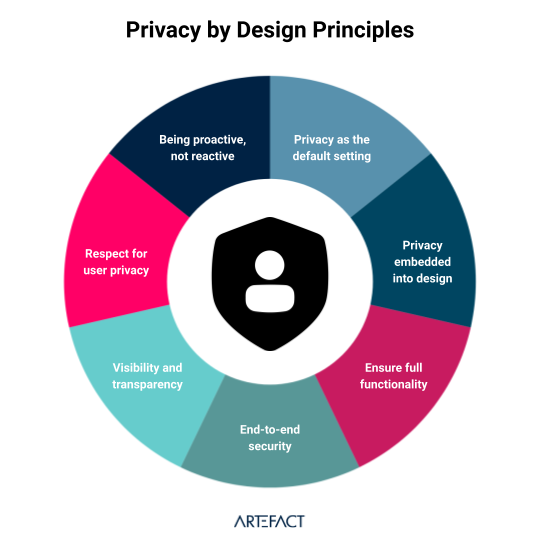

设计隐私 (PbD) 是一个将隐私嵌入信息技术和解决方案的设计与开发的框架。它由 Ann Cavoukian 博士开发并发布[5]。当组织使用该框架时,可以帮助从设计流程的一开始就解决用户隐私问题,而不是试图追溯性地添加隐私功能。.

该框架围绕以下内容建立 七项基本原则:

考虑到 GenAI 解决方案通常会收集和处理大量用户 data 信息,因此对于重视客户信任并希望在采用 data 隐私最佳实践方面保持良好声誉的组织来说,PbD 正变得越来越重要。.

保护用户隐私的关键要素

在 "隐私设计 "基本原则的基础上,我们确定了 关键要素 对于希望在开发 GenAI 解决方案或任何涉及敏感 data 的解决方案时保护其用户 data 隐私的组织而言,《GenAI 解决方案和 data 隐私保护指南》为他们提供了许多帮助。这些都围绕着有效 data governance, 这是确保在开发和部署 GenAI 解决方案的整个过程中坚持 PbD 原则的重要组成部分,包括为收集、处理、存储、共享和访问 data 制定明确的指导方针。为此,应实施 AI data governance 解决方案 这将有助于实现 data 管理流程的标准化和自动化,同时确保始终遵守 PbD 原则。.

获得用户同意

各组织在出于 GenAI 目的收集、使用或共享用户个人 data 信息之前,应征得用户的明确同意。这种同意应是知情和自愿的,也就是说,用户应可随时选择撤销同意。此外,各组织应 定期审查和更新其隐私政策和做法 以确保它们符合最新的法律法规。因此,实施同意管理平台(CMP)对于提高流程的效率和集中化非常重要。.

对 data 的使用情况保持透明并接受问责

透明度就是向用户提供有关如何使用 data 的信息。各组织应 透明 关于他们如何收集、使用、存储和共享个人 data 用于 GenAI 目的。同时,他们 负责 以确保始终以负责任和合乎道德的方式使用 data。.

确保优化 data 的收集和保存

虽然企业通常会尽可能多地收集用户 data,但要表明对负责任的 data 管理和隐私原则的承诺,就需要采取更加注重隐私的战略性方法。这包括评估每个特定 GenAI 应用程序对个人 data 的需求,并采取措施优化个人 data 的存储和处理时间。.

Apply data 匿名和去身份识别程序

Data 匿名化和去标识化技术有助于保护用户身份。为此,在为 GenAI 目的处理个人身份信息 (PII) 之前,应尽可能使用这些技术。.

确保用户 data 和安全

组织必须实施安全措施,保护个人 data 免受未经授权的访问、使用或披露。这些安全措施包括使用加密协议和用户访问管理政策,以及 进行隐私影响评估 (PIAs) 可帮助识别和降低与其 GenAI 解决方案相关的潜在隐私风险。.

将隐私纳入 GenAI:负责任创新的基本要素

在开发和实施 GenAI 解决方案以及任何其他使用敏感 data 的解决方案时采用隐私设计 (PbD) 原则,体现了对用户隐私的积极承诺。这种端到端 “以用户为中心 ”的方法涉及将隐私因素纳入解决方案生命周期的每一个步骤。通过从一开始就优先考虑用户隐私,企业可以与其用户建立牢固的、基于信任的关系,并长期降低潜在的声誉和法律风险。.

资料来源

[2] 2023 年的人工智能发展状况:生成式人工智能的爆发之年 麦肯锡公司

[3] 欧盟人工智能(AI)法

[4] 生成式人工智能是法律雷区

[5] A. Cavoukian,“设计隐私“加拿大安大略省信息与隐私专员,2009 年

博客

博客