No Artefact Conferência sobre IA generativa, realizada em 20 de abril de 2023, os principais participantes do campo da IA generativa compartilharam seus conhecimentos e trocaram ideias sobre essa nova tecnologia e as maneiras como as empresas podem usá-la para aumentar a produtividade de seus negócios.

Os modelos mais recentes de IA generativa são capazes de manter conversas sofisticadas com os usuários, criar conteúdo aparentemente original (imagens, áudio, texto) a partir de seu treinamento data e realizar tarefas manuais ou repetitivas, como escrever e-mails, codificar ou sintetizar documentos complexos. É fundamental que os tomadores de decisão desenvolvam hoje uma estratégia clara e convincente de IA generativa e priorizem o data governance e o design das soluções de negócios da AIGen.

Anfitriões da conferência e palestrantes principais:

IA generativa: explorando novas fronteiras criativas

Em sua introdução à conferência, Vincent Luciani observou: “As pessoas em todos os lugares estão entusiasmadas com essa nova tecnologia e com o impacto que ela terá nas organizações e nos funcionários. Até agora, o que tínhamos em termos de IA eram aplicativos relativamente determinísticos aumentados pelo aprendizado de máquina. Conseguimos prever, personalizar, otimizar, mas não criar de fato.

“Mas hoje, pela primeira vez, estamos vendo uma interação genuína entre homem e máquina. Agora, uma forma real de inteligência está surgindo dessa tecnologia e desses algoritmos, mesmo que a comunidade científica esteja dividida quanto à questão de se tratar de uma revolução ou de uma evolução...

“Já falamos sobre humanos aumentados ou atividades aumentadas: em breve falaremos sobre empresas aumentadas.” Antes de apresentar uma rápida visão geral dos assuntos que seriam abordados na conferência e passar a palavra aos palestrantes principais, ele lembrou ao audience que

“Apesar da chegada constante de novos aplicativos de IA generativa, a contenção é crucial: a transformação bem-sucedida dos negócios não acontece da noite para o dia, ela exige reflexão, pesquisa e preparação.”Vincent Luciani, CEO e cofundador da Artefact

Perspectivas e oportunidades no mercado de IA generativa

O primeiro palestrante, Hanan Ouazan, começou com uma visão geral dos modelos de texto, iniciando com o revolucionário Google 2017 “Atenção é tudo o que o senhor precisa” que levou à criação dos Transformers, que são a base de quase todos os modelos de linguagem grande (LLMs) em uso atualmente. “Como os senhores sabem, a pesquisa leva tempo, mas hoje estamos em um período de aceleração, no qual vemos novos modelos todos os dias que capitalizam o maior acesso ao data e à infraestrutura.”

Hanan explorou várias facetas da democratização e acessibilidade dos modelos de IA generativa, destacando, em particular, a aceleração da adoção da tecnologia: “O ritmo é impressionante: O ChatGPT atingiu 1 milhão de usuários em apenas cinco dias.”

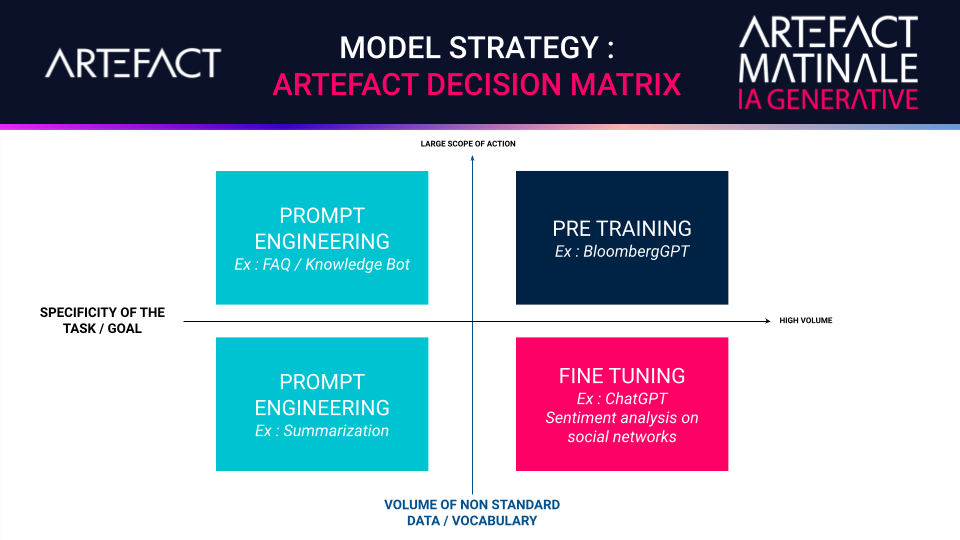

Com relação às estratégias do método de treinamento LLM, ele abordou as vantagens do pré-treinamento, do ajuste fino e da engenharia imediata, citando casos de uso industrial para cada um deles e apresentando a matriz de decisão de estratégia de modelo do Artefact.

Juntamente com o custo de propriedade, o desempenho e as limitações, Hanan também falou sobre o gerenciamento de mudanças e as formas como a IA generativa pode afetar os empregos.

“Isso certamente mudará nossas formas de trabalho, mas na Artefact, não achamos que isso matará as profissões: isso aumentará os humanos que as praticam.”Hanan Ouazan, sócio da Data Science e líder de IA geradora na Artefact

Uma plataforma de fotos gerada por IA para comércio eletrônico

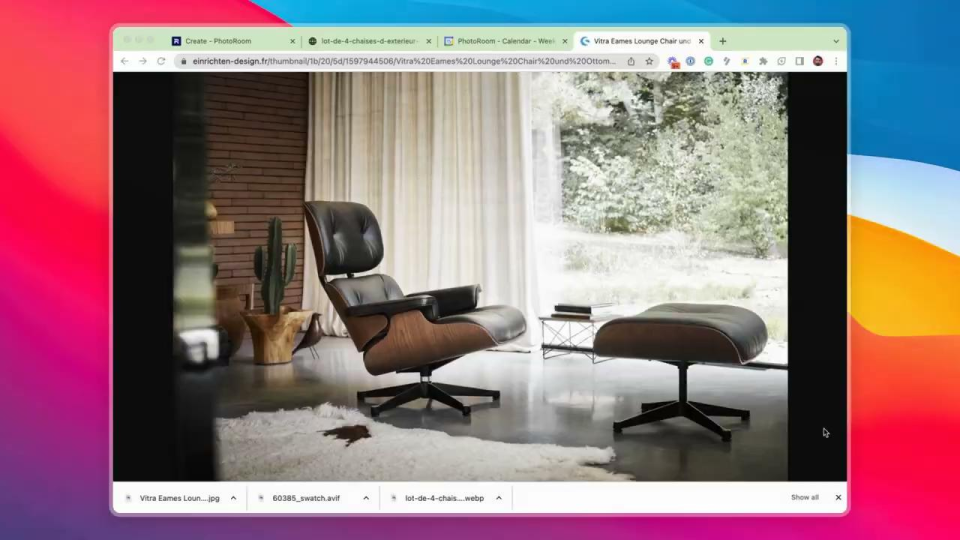

O palestrante principal, Matthieu Rouif, é CEO e cofundador da PhotoRoom, um aplicativo que permite que seus já 80 milhões de usuários criem fotos com qualidade de estúdio com um smartphone, usando o Stable Diffusion, uma tecnologia de IA generativa para imagens.

Desde a explosão dos mercados de comércio eletrônico impulsionada pela pandemia da COVID-19, dois bilhões de fotos são editadas todos os anos. E o aplicativo PhotoRoom está desempenhando um papel importante ao automatizar o recorte, a exibição de sombras e a geração de fundos realistas para os comerciantes. “Usamos IA generativa para oferecer aos clientes fotos que parecem ter sido tiradas por um fotógrafo profissional, até mesmo adicionando fundos exclusivos e realistas gerados por IA em menos de um segundo”, diz Matthieu.

“Ajudamos nossos clientes a expandir seus negócios, fornecendo-lhes fotos abundantes, de alta qualidade e de baixo custo, que respeitam sua marca e apresentam seus produtos da melhor maneira possível para atrair e reter clientes.”Matthieu Rouif, CEO e cofundador da PhotoRoom

Repensando a IA para as empresas

Igor Carron é CEO e cofundador da LightOn, A Paradigm, uma empresa francesa por trás da nova plataforma de IA generativa Paradigm, que é mais poderosa do que a GPT-3. Ela traz os modelos mais avançados para executar servidores e data, garantindo a soberania data para as empresas.

Em seu discurso de abertura, Igor falou sobre as origens de sua empresa. “Quando criamos a LightOn em 2016, estávamos construindo um hardware que usava a luz para fazer cálculos para IA. Era uma abordagem incomum, mas funcionou - nossa Unidade de Processamento Óptico (OPU), o primeiro coprocessador de IA fotônica do mundo, já foi usada por pesquisadores do mundo todo e integrada a um dos maiores supercomputadores do mundo.

“Desde 2020, após o surgimento do GPT, trabalhamos para descobrir como nosso hardware poderia ser usado para criar nossos próprios LLMs - tanto para nosso próprio uso quanto para clientes externos. Aprendemos a criar LLMs e, na verdade, ficamos muito bons nisso. Mas quando falamos pela primeira vez com as pessoas em 2021, 2022, elas não sabiam nada sobre o GPT3, então tivemos que educar nosso alvo audience.

“Trabalhamos com um cliente para criar um modelo maior, lançado recentemente com 40 bilhões, treinado de forma exclusiva para competir com o GPT3, mas usando muito menos parâmetros. Isso significa que o senhor pode ter uma infraestrutura muito menos pesada de hardware e usá-la sem que isso lhe custe um braço e uma perna.”

Igor enfatiza o valor de grandes modelos de linguagem e diz:

“Acredito que, no futuro, a maioria das empresas será baseada em LLM... Essas ferramentas permitirão que elas gerem valor real a partir de seu próprio data.”Igor Carron, CEO e cofundador da LightOn

“O que oferecemos aos clientes hoje é um produto chamado Paradigm: ele permite que as empresas gerenciem seus próprios fluxos de data dentro de suas organizações e reutilizem esse data para retreinar e aprimorar esses modelos. Isso garante que seus processos ou produtos internos possam se beneficiar da inteligência obtida a partir das interações com seus LLMs.

“Muitos no ecossistema francês ou europeu dependem da API Open AI ou de outros concorrentes norte-americanos.” Igor adverte: “O perigo de enviar seu data para uma API pública é que ele será reutilizado para treinar modelos sucessivos. Então, digamos que as pessoas do setor de mineração, que literalmente sabem onde encontrar ouro, enviem seu reports técnico para ela... Em alguns anos, se o senhor perguntar ao ChatGPT-8 ou -9 ou qualquer outro, ‘Onde está o ouro?’, ele lhe dirá onde está o ouro!” Ele recomenda enfaticamente que as empresas comecem a usar o data que geram internamente para treinar seus modelos.

Uma estratégia nacional para a Inteligência Artificial Generativa

Yohann Ralle, o último palestrante, é especialista em IA generativa no Ministério da Economia, Finanças e Soberania Industrial e Digital da França. Ele começou explicando sua “fórmula mágica” para criar um LLM de última geração: poder computacional + datasets + pesquisa fundamental:

“Para poder computacional, o governo francês investiu em um espaço digital comum, o Supercomputador Jean Zay, O sistema foi projetado para atender à comunidade de IA. Ele possibilitou o treinamento do multilíngue europeu BLOOM modelo”.”Yohann Ralle, especialista em IA generativa do Ministério da Economia, Finanças e Soberania Industrial e Digital da França.

“Com relação aos datasets, iniciativas como a Agdatahub ajudaram a agregar, anotar e qualificar o aprendizado e testar data para desenvolver uma IA eficiente e confiável, o que também pode contribuir para a competitividade francesa. Quanto à pesquisa fundamental, a estratégia nacional ajudou a estruturar o ecossistema de pesquisa e desenvolvimento de IA com a criação do 3IA institutos, financiamento de contratos de doutorado, lançamento dos projetos IRT Saint Exupéry e SystemX, vários programas de treinamento de estudantes e muito mais na França e na Europa”.”

Mesa redonda sobre IA generativa conduzida por Vincent Luciani, CEO da Artefact

A IA foi aprovada pelo Teste de Turing (ou seja, a IA atingiu o nível de inteligência humana)?

Embora a pergunta tenha recebido respostas variadas, o consenso geral é que, embora a inteligência esteja de fato presente, a intencionalidade não está.

Matthieu: “Acho que sim... O senhor sente que há alguém lá, desde que não pergunte sobre datas. Há um lado temporal que não funciona.”

Igor: “Minha pergunta é: por que o senhor fez essa pergunta? Porque o teste de Turing não é muito interessante para os negócios. Mas, em termos de interação, sim, o senhor pode dizer que a IA passou no teste.”

Yohann: “O teste de Turing é muito subjetivo. Há um risco quando atribuímos qualidades humanas à IA, quando a antropomorfizamos. Lembre-se do caso do engenheiro do Google Blake Lemoine, que acreditava que o chatbot LaMDA com o qual ele estava conversando havia se tornado senciente... O Teste de Turing é um exercício interessante, nada mais.”

Hanan: “Em relação ao ChatGPT, estamos chegando perto, mas ainda não chegamos lá.”

A chegada do ChatGPT é uma revolução, uma evolução ou parte de um processo contínuo?

Igor: “Embora o impacto de longo prazo do ChatGPT nos LLMs ainda não possa ser totalmente compreendido, com o tempo, surgirão novos usos para essas tecnologias que terão implicações sociais importantes. A discussão é interessante, mas o fator mais importante são os artigos científicos reais que detalharão os aprimoramentos dos LLMs. As aplicações práticas atuais e potenciais desses modelos não devem ser negligenciadas ou subestimadas.”

Quais são os casos de uso mais promissores para as empresas? Bots, geração de imagens?

Hanan: “Obviamente, os chatbots sempre foram importantes na IA e continuarão a ser um caso de uso importante, porque agora, com o ChatGPT, o senhor pode configurar um em 48 horas, conectando-o a um database, é incrível. Outro caso de uso é a criação de agentes autônomos que podem executar tarefas específicas sem intervenção humana, como um agente de viagens que reserva todas as suas passagens para hotéis e restaurantes para uma visita à Itália.”

Yohann: “Vejo muitas oportunidades para plug-ins acionados por CGT, como o Kayak ou o Booking. Acho que isso reestruturará o ambiente digital, onde a OpenAI agregará os agregadores.”

Igor: “Eu imagino a possibilidade de personalizar os LLMs corporativos. Além dos lagos de data, as empresas começarão a entender como usar o data não estruturado e como gerar valor real de seu data internamente com LLMs privados. Ao mesmo tempo, acho que veremos mudanças drásticas na forma como as pessoas pesquisam e usam a Internet graças ao ChatGPT.”

Vincent: Acredito que haverá uma fusão de data corporativo interno e LLMs em uma espécie de ‘Master FAQ+’, que pode ser consultado por agentes de pesquisa ou aumentados. O conceito de consultas está evoluindo: amanhã, as pessoas comprarão uma ou várias palavras-chave, ou comprarão um conceito? Na publicidade, o objetivo sempre foi ser baseado em pessoas, em audience; agora, à medida que protegemos o data pessoal, estamos caminhando para o contexto. E isso pode levar a uma publicidade mais interessante.’

Como a IA generativa está sendo usada nas organizações atualmente? Ela está afetando o emprego?

Matthieu: “Temos sorte, uma de nossas vantagens competitivas é que temos a IA em nosso DNA. Incentivamos o uso de ferramentas mais generativas internamente. Nossa equipe de tecnologia usa o Copilot para desenvolvimento, e nossos programadores usam tanto o ChatGPT quanto o Copilot. Somos mais criativos com essas ferramentas. Quanto ao emprego, estamos crescendo, então planejamos contratar novas pessoas... mas, ao mesmo tempo, quando temos um ótimo software, podemos fazer mais com equipes menores.”

Igor: “Sempre operamos com uma equipe pequena - sete ou oito pessoas - para atingir os mesmos altos níveis de proeza técnica que o Google, por exemplo, onde as equipes são dez vezes maiores. Nossas equipes pequenas têm um efeito completamente desproporcional. É uma falsa ideia acreditar que é preciso ter uma grande equipe para realizar grandes coisas.”

Yohann: “Há dez anos, um estudo dos EUA afirmou que 47% de empregos seriam perdidos devido à IA dentro de 20 anos, mas podemos ver que isso não está acontecendo. Uma pesquisa mais recente da OCDE disse que isso estava mais próximo de 14%. Acho que devemos pensar em termos de tarefas, não de empregos. Conforme mencionado em um estudo recente da OpenAI, 80 a 90% dos empregos serão afetados pela IA generativa, mas isso realmente significa que 90% dos funcionários serão afetados em 10% de suas tarefas. O interessante é que a noção de profissões que pensávamos ser intocáveis pela IA está sendo desafiada, como as dos campos criativo, jurídico, financeiro e outros. O governo francês criou Le LaborIA para ajudar a explorar essas questões”.”

Quais são as limitações em relação à soberania e às regulamentações para esses modelos?

Hanan: “O primeiro limite diz respeito à propriedade intelectual (PI). Hoje, temos três tipos de modelos: modelos públicos, como o ChatGPT, em que o data que o senhor envia pode ser usado para fins comerciais; modelos privados sem proprietário de PI, como a API do Google no Lamba; e modelos de código aberto auto-instalados. A soberania do Data é um problema, pois o GPT e o PaLM não são europeus, mas de propriedade americana.”

Yohann: “As regulamentações são um grande problema na Europa. A Itália tem totalmente proibiu o uso do ChatGPT investigação pendente para saber se o aplicativo está em conformidade com as normas de privacidade do GDPR. A OpenAI precisa ser extremamente clara quanto ao uso do data pessoal, apresentando, por exemplo, um aviso de isenção de responsabilidade informando que usa o data pessoal e permitindo que os usuários optem por não coletar o data e que apaguem seu data. Outro problema com relação às limitações dos LLMs são as alucinações: eles costumam dar respostas erradas, o que pode ser grave se a solicitação se referir a uma figura pública e o modelo gerar uma história de ‘fake news’ que pode causar danos reais à pessoa em questão.”

Vincent: “O senhor já estudou a questão da PI e os problemas levantados pela Processo da Getty Images contra a Stability AI? Há muitas perguntas sobre a busca de imagens na Internet para treinar modelos...”

Yohann: “Estamos pensando nisso. O código aberto pode ser uma maneira de criar bases data e conjuntos data limpos e livres de direitos autorais que respeitem a propriedade intelectual.”

Matthieu: “Com relação ao data pessoal e aos produtos: o que permite que o ChatGPT, o Midjourney ou o PhotoRoom funcionem bem não é o data pessoal, mas o feedback dos clientes.”

Yohann: “O feedback do usuário é ideal, mas coletá-lo é proibitivamente caro no caso dos LLMs.”

Igor: “Onde está o dinheiro? Essa é a minha pergunta. Todos os problemas que o senhor levantou são técnicos e não podemos resolvê-los até que tenhamos os fundos para contratar engenheiros e implantar um ecossistema, e simplesmente ainda não estamos preparados.”

Com mais e mais LLMs sendo construídos, o senhor acha que haverá uma “guerra” de GPUs?

Yohann: “É um risco real. No momento, há um monopólio da NVIDIA aqui, eles controlam o mercado e os preços. Infelizmente, não há concorrentes reais na Europa. É um recurso limitado por definição, um recurso raro, portanto, é uma batalha séria.”

Matthieu: “A falta de disponibilidade de GPUs limita severamente não apenas nossa produtividade, mas o crescimento de empresas em toda a Europa.”

Igor: “Desde que começamos como um produtor de hardware, já enfrentamos esse problema em 2016... Hoje, há pessoas que trabalham com nossos concorrentes cujo trabalho em tempo integral é encontrar GPUs suficientes para treinar modelos... O mercado está explodindo, mas a produção de chips não consegue acompanhar - em nenhum lugar do mundo.”

Hanan: “Haverá inevitavelmente um gargalo de GPU, mas podemos aprender a ser mais eficientes, precisamos aprender. E precisamos ver como podemos integrar o código aberto em nossas empresas, não apenas como usar todas as tecnologias mais recentes.”

Onde o senhor vê mais valor para o futuro? Modelos de código aberto? LLMs?

Matthieu: “Na PhotoRoom, usamos código aberto, o que nos permite ir mais rápido e desenvolver nosso próprio IP. Temos uma ampla Comunidade Hugging Face em Paris, que nos dá um feedback essencial”.”

Igor: “Usamos LLMs, mas não estamos casados com esse modelo de negócios. Poderíamos usar código aberto. O importante é poder e saber como reutilizar nosso data proprietário para treinar modelos futuros. O objetivo é criar um setor que personalize esses modelos para outras empresas.”

Yohann: “Em relação à evolução do código aberto versus proprietário, a IA generativa foi impulsionada. A comunidade de IA trabalhou em conjunto para que outros atores pudessem se beneficiar dessa pesquisa fundamental para criar seus próprios modelos. Questiono se o desempenho desses modelos de código aberto não será inferior ao dos modelos proprietários, mas isso pode mudar. De qualquer forma, é de se perguntar se o Google não se arrepende de ter aberto as portas para sua tecnologia ChatGPT!”

A mesa redonda foi seguida por uma sessão de perguntas e respostas sobre audience, com uma discussão particularmente animada sobre a falta de women na tecnologia. Yohann detalhou várias das medidas que estão sendo tomadas pelo governo francês em relação à educação e que são direcionadas especificamente para meninas e women, enquanto Vincent falou sobre o que está sendo feito pela Artefact Escola de Data, o Women@Artefact e outras empresas de tecnologia para tentar corrigir a situação.

Outras questões foram levantadas sobre a inclusão para o uso de LLMs por pessoas com autismo e outras deficiências; o problema das alucinações de IA; as medidas que as empresas estão planejando implementar para proteger o meio ambiente; o papel da Europa em relação à França no que diz respeito à coleta de dados da Internet para o data. Para ver como os participantes responderam a essas perguntas, assista à conferência replay.

BLOG

BLOG