En el Artefact Conferencia sobre IA Generativa, celebrado el 20 de abril de 2023, los actores clave en el campo de la IA generativa compartieron sus conocimientos e intercambiaron ideas sobre esta nueva tecnología y las formas en que las empresas pueden utilizarla para mejorar la productividad de sus negocios.

Los últimos modelos de IA generativa son capaces de mantener conversaciones sofisticadas con los usuarios, crear contenidos aparentemente originales (imágenes, audio, texto) a partir de su formación data, y realizar tareas manuales o repetitivas como escribir correos electrónicos, codificar o sintetizar documentos complejos. Es vital que los responsables de la toma de decisiones desarrollen hoy una estrategia de IA generativa clara y convincente y den prioridad al data governance y al diseño de soluciones empresariales AIGen.

Anfitriones de la conferencia y ponentes principales:

IA generativa: explorando nuevas fronteras creativas

En su introducción a la conferencia, Vincent Luciani señaló: “La gente de todo el mundo está entusiasmada con esta nueva tecnología y con el impacto que tendrá en las organizaciones y en los empleados. Hasta ahora, lo que teníamos en términos de IA eran aplicaciones relativamente deterministas aumentadas por el aprendizaje automático. Éramos capaces de predecir, personalizar, optimizar, pero no de crear realmente.

“Pero hoy, por primera vez, estamos viendo una auténtica interacción entre el hombre y la máquina. Ahora, una forma real de inteligencia está emergiendo de esta tecnología y estos algoritmos, incluso si la comunidad científica está dividida sobre la cuestión de si es una revolución o una evolución...

“Ya hemos hablado de humanos aumentados o de actividades aumentadas: pronto hablaremos de empresas aumentadas”. Antes de presentar una rápida panorámica de los temas que tocaría la conferencia y ceder la palabra a los ponentes principales, recordó a la audience que

“A pesar de la llegada constante de nuevas aplicaciones de IA generativa, la moderación es crucial: la transformación empresarial con éxito no se produce de la noche a la mañana, requiere reflexión, investigación, preparación”.”Vincent Luciani, director general y cofundador de Artefact

Perspectivas y oportunidades en el mercado de la IA generativa

La primera ponente principal, Hanan Ouazan, comenzó con una visión general de los modelos de texto, empezando por el revolucionario “Atención es todo lo que necesita” paper, que condujo a la creación de los Transformers que son la base de casi todos los grandes modelos lingüísticos (LLM) que se utilizan hoy en día. “Como sabe, la investigación lleva su tiempo, pero hoy nos encontramos en un periodo de aceleración, en el que vemos cada día nuevos modelos que capitalizan un mayor acceso al data y a la infraestructura”.”

Hanan exploró varias facetas de la democratización y accesibilidad de los modelos generativos de IA, destacando en particular la aceleración de la adopción de la tecnología: “El ritmo es asombroso: ChatGPT alcanzó el millón de usuarios en sólo cinco días”.”

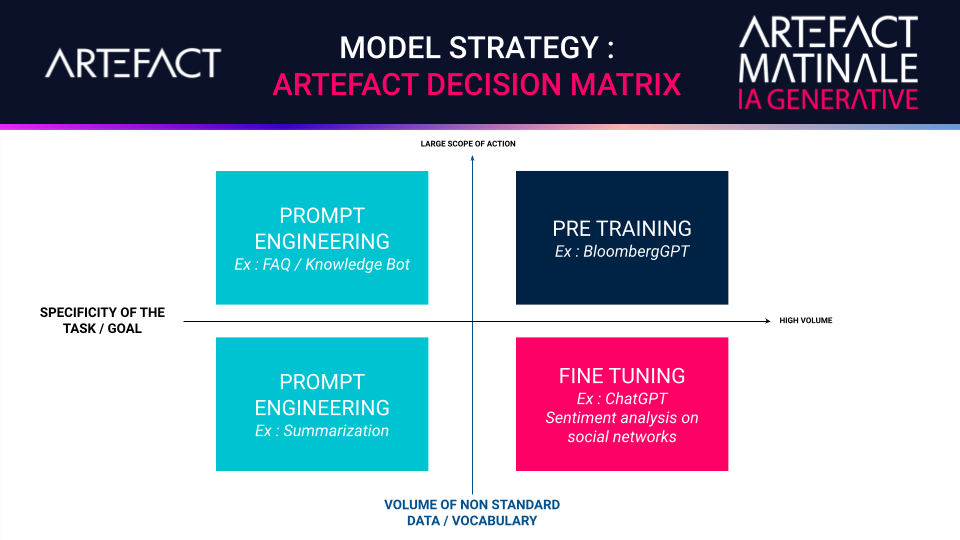

En cuanto a las estrategias del método de formación LLM, cubrió las ventajas del preentrenamiento, el ajuste fino y la ingeniería rápida, citando casos de uso industrial para cada uno y presentando la matriz de decisión de la estrategia de modelos de Artefact.

Junto con el coste de propiedad, el rendimiento y las limitaciones, Hanan también habló de la gestión del cambio y de las formas en que la IA generativa podría afectar a los puestos de trabajo.

“Sin duda cambiará nuestras formas de trabajar, pero en Artefact no creemos que vaya a acabar con las profesiones: aumentará a los humanos que las ejercen”.”Hanan Ouazan, socia Data Science & Lead Generative AI en Artefact

Una plataforma fotográfica generativa impulsada por IA para el comercio electrónico

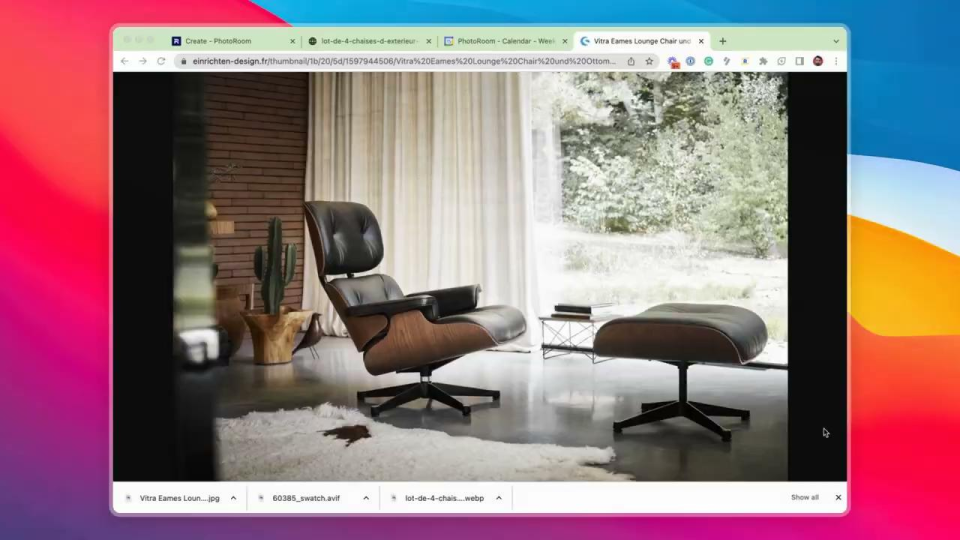

El ponente principal Matthieu Rouif es director general y cofundador de PhotoRoom, una aplicación que permite a sus ya 80 millones de usuarios crear fotos con calidad de estudio con un smartphone, utilizando la Difusión Estable, una tecnología de IA Generativa para imágenes.

Desde la explosión de los mercados de comercio electrónico espoleada por la pandemia del COVID-19, cada año se editan dos mil millones de fotos. Y la aplicación PhotoRoom está desempeñando un papel importante al automatizar el recorte, la visualización de sombras y la generación de fondos realistas para los comerciantes. “Utilizamos IA generativa para ofrecer a los clientes fotos que parecen haber sido tomadas por un fotógrafo profesional, incluso añadiendo fondos únicos y realistas generados por IA en menos de un segundo”, afirma Matthieu.

“Ayudamos a nuestros clientes a hacer crecer sus negocios proporcionándoles fotos abundantes, de alta calidad y bajo coste que respeten su marca y presenten sus productos de la mejor manera posible para atraer y retener a los clientes.”Matthieu Rouif, director general y cofundador de PhotoRoom

Repensar la IA para las empresas

Igor Carron es el director general y cofundador de LightOn, empresa francesa creadora de la nueva plataforma de IA generativa Paradigm, más potente que GPT-3. Aporta los modelos más avanzados para ejecutar servidores y data al tiempo que garantiza la soberanía data para las empresas.

En su discurso de apertura, Igor habló de los orígenes de su empresa. “Cuando creamos LightOn en 2016, estábamos construyendo hardware que utilizaba la luz para realizar cálculos para la IA. Era un enfoque inusual, pero funcionó: nuestra Unidad de Procesamiento Óptico (OPU), el primer coprocesador fotónico de IA del mundo, ha sido utilizado ahora por investigadores de todo el mundo y se ha integrado en uno de los mayores superordenadores del mundo.

“Desde 2020, tras la aparición de GPT, hemos trabajado para averiguar cómo se podía utilizar nuestro hardware para construir nuestros propios LLM, tanto para nuestro propio uso como para clientes externos. Aprendimos a fabricar LLM y, de hecho, se nos dio bastante bien. Pero cuando hablamos por primera vez con la gente en 2021, 2022, no tenían ni idea de GPT3, así que tuvimos que educar a nuestro objetivo audience.

“Trabajamos con un cliente para crear un modelo más grande, recientemente lanzado con 40.000 millones, entrenado de forma única para competir con GPT3, pero utilizando muchos menos parámetros. Esto significa que puede tener una infraestructura mucho menos pesada en cuanto a hardware, y utilizarlo sin que le cueste un ojo de la cara.”

Igor subraya el valor de los grandes modelos lingüísticos y dice:

“Creo que en el futuro, la mayoría de las empresas se basarán en LLM... Estas herramientas les permitirán generar un valor real a partir de su propio data”.”Igor Carron, director general y cofundador de LightOn

“Lo que ofrecemos hoy a los clientes es un producto llamado Paradigm: permite a las empresas gestionar sus propios flujos data dentro de sus organizaciones y reutilizar este data para reciclar y mejorar estos modelos. Esto garantiza que sus procesos o productos internos puedan beneficiarse de la inteligencia obtenida de sus interacciones con sus LLM.

“Muchos en el ecosistema francés o europeo dependen de la API Open AI o de otros competidores norteamericanos”. advierte Igor: “El peligro de enviar su data a una API pública es que se reutilizará para entrenar modelos sucesivos. Así que, digamos que la gente de la industria minera, que sabe literalmente dónde encontrar oro, le envía su reports técnico... Dentro de unos años, si le pregunta a ChatGPT-8 o -9 o lo que sea: ‘¿Dónde está el oro?’, ¡le dirá dónde está el oro!”. Recomienda encarecidamente que las empresas empiecen a utilizar el data que generan internamente para entrenar sus modelos.

Una estrategia nacional para la Inteligencia Artificial Generativa

Yohann Ralle, el último orador principal, es especialista en IA Generativa en el Ministerio de Economía, Finanzas y Soberanía Industrial y Digital de Francia. Comenzó explicando su “fórmula mágica” para construir un LLM de vanguardia: potencia de cálculo + datasets + investigación fundamental:

“Para la potencia de cálculo, el gobierno francés ha invertido en un fondo común digital, el Superordenador Jean Zay, diseñado para servir a la comunidad de la IA. Ha permitido la formación del multilingüe europeo BLOOM modelo”.”Yohann Ralle, especialista en IA Generativa del Ministerio de Economía, Finanzas y Soberanía Industrial y Digital de Francia.

“Con respecto a los datasets, iniciativas como Agdatahub han ayudado a agregar, anotar y cualificar el aprendizaje y las pruebas data para desarrollar una IA eficiente y fiable, lo que también puede contribuir a la competitividad francesa. En cuanto a la investigación fundamental, la estrategia nacional ha ayudado a estructurar el ecosistema de investigación y desarrollo de la IA con la creación del 3IA institutos, la financiación de contratos de doctorado, el lanzamiento del IRT Saint Exupéry y del proyecto SystemX, múltiples programas de formación de estudiantes y mucho más en toda Francia y Europa”.”

Mesa redonda sobre IA generativa dirigida por Vincent Luciani, Director General de Artefact

¿Ha superado la IA el Prueba Turing (es decir, ¿ha alcanzado la IA un nivel de inteligencia humano)?

Aunque la pregunta recibió respuestas contradictorias, el consenso general es que, aunque la inteligencia existe, la intencionalidad no.

Matthieu: “Creo que sí... Sientes que hay alguien ahí, siempre que no preguntes por las fechas. Hay un lado temporal que no funciona”.”

Igor: “Mi pregunta es ¿por qué ha hecho esa pregunta? Porque el test de Turing no es muy interesante para los negocios. Pero, en términos de interacción, sí, se puede decir que la IA ha superado la prueba”.”

Yohann: “La prueba de Turing es muy subjetiva. Existe un riesgo cuando atribuimos cualidades humanas a la IA, cuando antropomorfizamos. Recuerde el caso del ingeniero de Google Blake Lemoine, que creía que el chatbot LaMDA con el que hablaba se había vuelto sintiente... El Test de Turing es un ejercicio interesante, nada más”.”

Hanan: “En cuanto a ChatGPT, nos estamos acercando, pero aún no hemos llegado”.”

¿Es la llegada de ChatGPT una revolución, una evolución o parte de un continuo?

Igor: “Aunque el impacto a largo plazo del ChatGPT en las LLM aún no puede comprenderse del todo, con el tiempo surgirán nuevos usos para estas tecnologías que tendrán importantes implicaciones sociales. El debate es interesante, pero lo más importante son los artículos científicos reales que detallarán las mejoras de los LLM. Las aplicaciones prácticas actuales y potenciales de estos modelos no deben pasarse por alto ni subestimarse.”

¿Cuáles son los casos de uso más prometedores para las empresas? ¿Bots, generación de imágenes?

Hanan: “Obviamente, los chatbots siempre han sido importantes en la IA y seguirán siendo un caso de uso importante, porque ahora, con ChatGPT, puede crear uno en 48 horas conectándolo a una base data, es increíble. Otro caso de uso es la creación de agentes autónomos que puedan realizar tareas específicas sin intervención humana, como un agente de viajes que le reserve todas las entradas a hoteles y restaurantes para una visita a Italia.”

Yohann: “Veo muchas oportunidades para los complementos impulsados por CGT, como Kayak o Booking. Creo que reestructurará el entorno digital, donde OpenAI agregará a los agregadores”.”

Igor: “Preveo la posibilidad de personalizar los LLM empresariales. Más allá de los lagos de data, las empresas empezarán a entender cómo utilizar la data no estructurada y cómo generar valor real a partir de su data internamente con LLM privados. Al mismo tiempo, creo que veremos cambios drásticos en la forma en que la gente busca y utiliza Internet gracias a ChatGPT.”

Vincent: Creo que se producirá una fusión de los data internos de las empresas y los LLM en una especie de ‘FAQ+ maestro’ que podrá ser consultado por agentes de búsqueda o aumentados. El concepto de consulta está evolucionando: mañana, ¿la gente comprará una o muchas palabras clave, o comprará un concepto? En publicidad, el objetivo siempre ha sido basarse en las personas, en el audience; ahora, a medida que protegemos el data personal, nos dirigimos hacia el basado en el contexto. Y eso puede dar lugar a una publicidad más interesante’.”

¿Cómo se utiliza actualmente la IA generativa en las organizaciones? ¿Está afectando al empleo?

Matthieu: “Somos afortunados, una de nuestras ventajas competitivas es que tenemos la IA en nuestro ADN. Fomentamos internamente el uso de herramientas más generativas. Nuestro equipo técnico utiliza Copilot para el desarrollo, y nuestros codificadores utilizan tanto ChatGPT como Copilot. Somos más creativos con estas herramientas. En cuanto al empleo, estamos creciendo, así que tenemos previsto contratar a gente nueva... pero al mismo tiempo, cuando tenemos un gran software, podemos hacer más con equipos más pequeños.”

Igor: “Siempre hemos funcionado con un equipo pequeño -siete u ocho personas- para alcanzar los mismos altos niveles de destreza técnica que Google, por ejemplo, donde los equipos son diez veces mayores. Nuestros pequeños equipos tienen un efecto totalmente desproporcionado. Es una idea falsa creer que se necesita un gran equipo para lograr grandes cosas”.”

Yohann: “Hace diez años, un estudio estadounidense afirmaba que se perderían 47% de empleos debido a la IA en 20 años, pero podemos ver que no está ocurriendo. Un estudio más reciente de la OCDE decía que estaba más cerca de 14%. Creo que deberíamos pensar en términos de tareas, no de puestos de trabajo. Como se menciona en un estudio reciente de OpenAI, entre 80 y 90% de los puestos de trabajo se verán afectados por la IA generativa, pero eso significa realmente que 90% de los empleados se verán afectados en 10% de sus tareas. Lo interesante es que se está cuestionando la noción de profesiones que creíamos intocables por la IA, como las del ámbito creativo, jurídico, financiero y otros. El gobierno francés ha creado Le LaborIA para ayudar a explorar estas cuestiones”.”

¿Cuáles son las limitaciones en torno a la soberanía y las normativas para estos modelos?

Hanan: “El primer límite se refiere a la Propiedad Intelectual (PI). Hoy en día, tenemos tres tipos de modelos: modelos públicos, como ChatGPT, donde el data que envía puede utilizarse con fines comerciales; modelos privados sin propietario de la PI, como la API de Google en Lamba; y modelos de código abierto autoinstalados. La soberanía Data es un problema, ya que GPT y PaLM no son de propiedad europea, sino estadounidense”.”

Yohann: “La reglamentación es un gran problema en Europa. Italia tiene totalmente prohibió el uso de ChatGPT a la espera de que se investigue si la aplicación cumple la normativa sobre privacidad del GDPR. OpenAI tiene que ser extremadamente clara sobre el uso que hace de los data personales presentando, por ejemplo, un descargo de responsabilidad en el que diga que utiliza data personales y que permita a los usuarios optar por no participar en la recopilación de data y permitirles borrar sus data. Otro problema en relación con las limitaciones de los LLM son las alucinaciones: a menudo dan respuestas erróneas, lo que puede ser grave si la solicitud se refiere a una figura pública y el modelo genera una noticia ‘falsa’ que puede perjudicar realmente a la persona en cuestión.”

Vincent: “¿Ha estudiado la cuestión de la propiedad intelectual y los problemas planteados por La demanda de Getty Images contra Stability AI? Hay muchas preguntas sobre la búsqueda de imágenes en Internet para entrenar modelos...”

Yohann: “Estamos pensando en ello. El código abierto podría ser una forma de crear bases y conjuntos data limpios y sin derechos de autor que respeten la propiedad intelectual.”

Matthieu: “En cuanto al data personal y los productos: lo que permite que ChatGPT o Midjourney o PhotoRoom funcionen bien no es el data personal, sino la opinión de los clientes”.”

Yohann: “La opinión de los usuarios es ideal, pero recopilarla resulta prohibitivamente caro en el caso de los LLM”.”

Igor: “¿Dónde está el dinero? Esa es mi pregunta. Todos los problemas que ha planteado son técnicos, y no podremos resolverlos hasta que dispongamos de los fondos para contratar ingenieros y poner en marcha un ecosistema, y sencillamente aún no estamos preparados.”

Con cada vez más LLM en construcción, ¿cree que habrá una “guerra” de GPU?

Yohann: “Es un riesgo real. Ahora mismo, aquí hay un monopolio de NVIDIA, controlan el mercado y los precios. No hay competidores reales en Europa, por desgracia. Es un recurso limitado por definición, un recurso escaso, así que es una batalla seria”.”

Matthieu: “La falta de disponibilidad de GPU limita gravemente no sólo nuestra productividad, sino el crecimiento de las empresas de toda Europa”.”

Igor: “Desde que empezamos como productores de hardware, ya nos enfrentamos a este problema en 2016... Hoy en día, hay personas que trabajan con nuestros competidores cuyo trabajo a tiempo completo es encontrar suficientes GPU para entrenar modelos... El mercado está explotando, pero la producción de chips no puede seguir el ritmo - en cualquier parte del mundo.”

Hanan: “Inevitablemente habrá un cuello de botella en la GPU, pero podemos aprender a ser más eficientes, tenemos que serlo. Y tenemos que ver cómo podemos integrar el código abierto en nuestras empresas, no sólo cómo utilizar todas las últimas tecnologías.”

¿Dónde ve más valor para el futuro? ¿Modelos de código abierto? ¿Los LLM?

Matthieu: “En PhotoRoom utilizamos el código abierto, nos permite ir más rápido, desarrollar nuestra propia propiedad intelectual. Tenemos una amplia Comunidad Cara de Abrazo en París que nos proporciona información esencial”.”

Igor: “Utilizamos LLM, pero no estamos casados con ese modelo de negocio. Podríamos utilizar código abierto. Lo importante es poder y saber reutilizar nuestro data patentado para entrenar futuros modelos. El objetivo es una industria que personalice estos modelos para otras empresas”.”

Yohann: “En cuanto a la evolución del código abierto frente al propietario ha impulsado la IA generativa. La comunidad de la IA colaboró para que otros actores pudieran beneficiarse de esta investigación fundamental para construir sus propios modelos. Me pregunto si el rendimiento de estos modelos de código abierto no será inferior al de los modelos propietarios, pero eso puede cambiar. En cualquier caso, cabe preguntarse si Google no se arrepiente de haber abierto las puertas a su tecnología ChatGPT”.”

La mesa redonda fue seguida de una sesión de preguntas y respuestas audience, con un debate especialmente animado en torno a la falta de women en la tecnología. Yohann detalló varias de las medidas que está tomando el gobierno francés en materia de educación dirigidas específicamente a las niñas y a las women, mientras que Vincent habló de lo que está haciendo el Artefact Escuela de Data, el Women@Artefact y otras empresas tecnológicas para intentar corregir la situación.

También se plantearon otras cuestiones sobre la inclusividad para el uso de los LLM por parte de personas con autismo y otras discapacidades; el problema de las alucinaciones de la IA; las medidas que las empresas tienen previsto poner en marcha para proteger el medio ambiente; el papel de Europa frente al de Francia en relación con el scraping de Internet para data. Para ver cómo respondieron los participantes a estas preguntas, vea la conferencia replay.

BLOG

BLOG