Op de Artefact Conferentie over generatieve AI, dat op 20 april 2023 werd gehouden, deelden belangrijke spelers op het gebied van generatieve AI hun kennis en wisselden ideeën uit over deze nieuwe technologie en de manieren waarop bedrijven deze kunnen gebruiken om hun bedrijfsproductiviteit te verhogen.

De nieuwste generatieve AI-modellen zijn in staat om geavanceerde conversaties met gebruikers te voeren, schijnbaar originele inhoud (afbeeldingen, audio, tekst) te creëren op basis van hun data training en handmatige of repetitieve taken uit te voeren, zoals e-mails schrijven, coderen of complexe documenten samenstellen. Het is voor besluitvormers van vitaal belang om vandaag een duidelijke en overtuigende generatieve AI-strategie te ontwikkelen en prioriteit te geven aan data governance en het ontwerp van AIGen bedrijfsoplossingen.

Conferentiegastheren en keynote sprekers:

Generatieve AI: nieuwe creatieve grenzen verkennen

In zijn inleiding tot de conferentie zei Vincent Luciani: “Overal zijn mensen enthousiast over deze nieuwe technologie en de impact die het zal hebben op organisaties en werknemers. Tot nu toe hadden we op het gebied van AI relatief deterministische toepassingen, aangevuld met machine learning. We konden voorspellen, personaliseren en optimaliseren, maar niet echt creëren.

“Maar vandaag zien we voor het eerst echte interactie tussen mens en machine. Nu komt er een echte vorm van intelligentie voort uit deze technologie en deze algoritmen, ook al is de wetenschappelijke gemeenschap verdeeld over de vraag of het een revolutie of een evolutie is...

“We hebben het al gehad over augmented humans of augmented activities: binnenkort zullen we het hebben over augmented businesses.” Voordat hij een snel overzicht gaf van de onderwerpen die tijdens de conferentie aan bod zouden komen en het woord gaf aan de keynote sprekers, herinnerde hij het audience eraan dat

“Ondanks de constante komst van nieuwe generatieve AI-toepassingen is terughoudendheid cruciaal: succesvolle bedrijfstransformatie gebeurt niet van de ene op de andere dag, het vereist reflectie, onderzoek, voorbereiding.”Vincent Luciani, CEO en medeoprichter van Artefact

Perspectieven en kansen in de markt voor generatieve AI

De eerste keynote spreker, Hanan Ouazan, begon met een overzicht van tekstmodellen, te beginnen met Google's revolutionaire 2017 “Aandacht is alles wat u nodig hebt” document, dat leidde tot de creatie van de Transformers die de basis vormen van bijna alle grote taalmodellen (LLM's) die vandaag de dag gebruikt worden. “Zoals u weet kost onderzoek tijd, maar vandaag de dag bevinden we ons in een periode van versnelling, waarin we elke dag nieuwe modellen zien die profiteren van een grotere toegang tot data en infrastructuur.”

Hanan ging in op verschillende facetten van de democratisering en toegankelijkheid van generatieve AI-modellen, en benadrukte met name de versnelde invoering van de technologie: “Het tempo is duizelingwekkend: ChatGPT bereikte 1 miljoen gebruikers in slechts vijf dagen.”

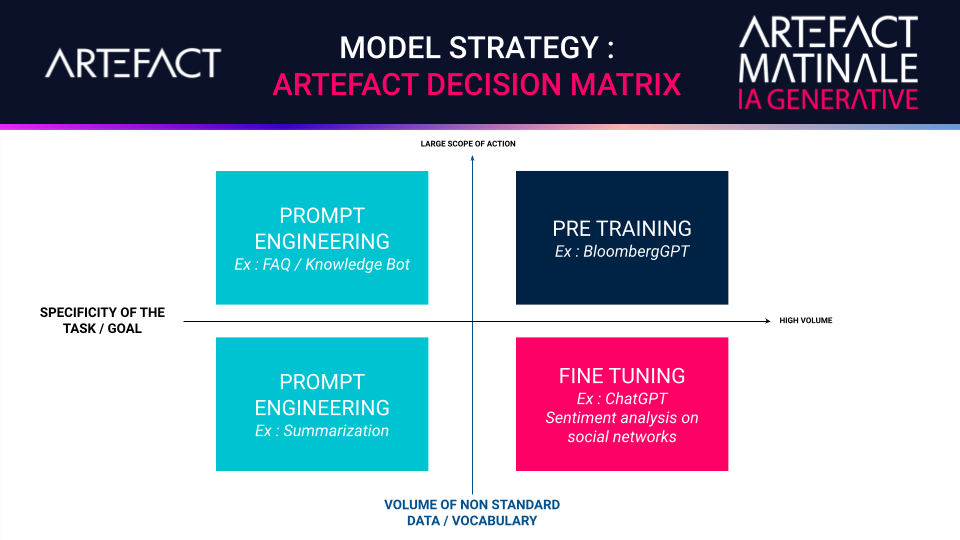

Met betrekking tot de LLM-strategieën voor de trainingsmethode besprak hij de voordelen van pre-training, fine-tuning en prompt engineering, waarbij hij voor elke methode industriële toepassingen noemde en de beslissingsmatrix voor modelstrategieën van Artefact presenteerde.

Naast eigendomskosten, prestaties en beperkingen, sprak Hanan ook over verandermanagement en de manieren waarop generatieve AI banen zou kunnen beïnvloeden.

“Het zal onze manier van werken zeker veranderen, maar bij Artefact denken we niet dat het beroepen zal uitroeien: het zal de mensen die ze uitoefenen juist versterken.”Hanan Ouazan, Partner Data Wetenschap & Lead Generatieve AI bij Artefact

Een generatief AI-gestuurd fotoplatform voor e-commerce

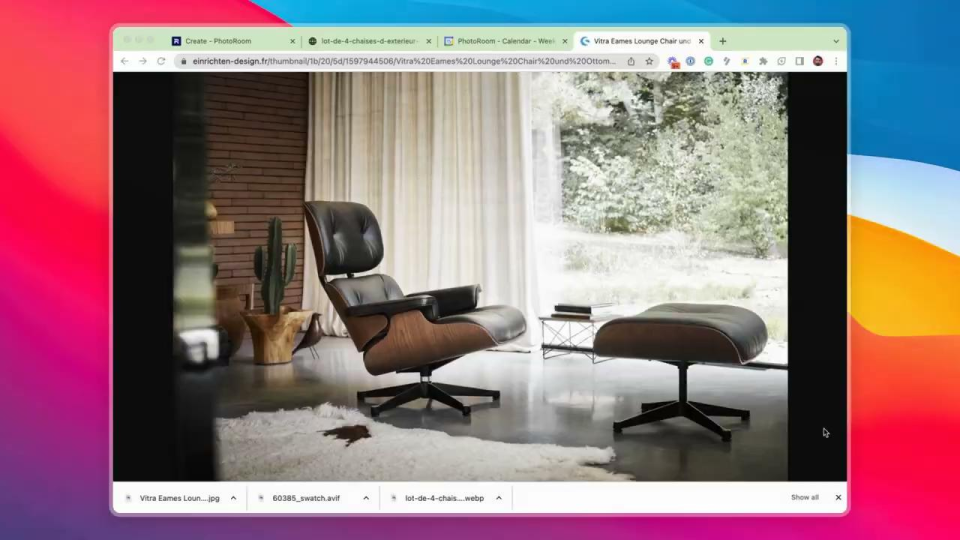

Keynote panellid Matthieu Rouif is de CEO & mede-oprichter van PhotoRoom, een applicatie die haar al 80 miljoen gebruikers in staat stelt om foto's van studiokwaliteit te maken met een smartphone, met behulp van Stable Diffusion, een generatieve AI-technologie voor afbeeldingen.

Sinds de explosieve groei van e-commerce marktplaatsen, aangespoord door de COVID-19 pandemie, worden er elk jaar twee miljard foto's bewerkt. En de app PhotoRoom speelt een grote rol door het automatisch knippen, weergeven van schaduwen en het genereren van realistische achtergronden voor handelaren. “Wij gebruiken generatieve AI om klanten foto's aan te bieden die eruit zien alsof ze door een professionele fotograaf zijn genomen, en voegen zelfs unieke, realistische AI-gegenereerde achtergronden toe in minder dan een seconde,” zegt Matthieu.

“Wij helpen onze klanten hun bedrijf te laten groeien door hen te voorzien van een overvloed aan goedkope foto's van hoge kwaliteit die hun merk respecteren en hun producten in het best mogelijke licht presenteren om klanten aan te trekken en te behouden.”Matthieu Rouif, CEO & medeoprichter van PhotoRoom

Een andere kijk op AI voor bedrijven

Igor Carron is de CEO & medeoprichter van LightOn, een Frans bedrijf achter het nieuwe generatieve AI-platform Paradigm, dat krachtiger is dan GPT-3. Het brengt de meest geavanceerde modellen om servers en data te draaien, terwijl het data soevereiniteit voor bedrijven garandeert.

In zijn keynote besprak Igor de oorsprong van zijn bedrijf. “Toen we LightOn in 2016 oprichtten, bouwden we hardware die licht gebruikte om berekeningen voor AI te maken. Het was een ongebruikelijke aanpak, maar het werkte - onze Optical Processing Unit (OPU), 's werelds eerste fotonische AI co-processor, wordt nu wereldwijd gebruikt door onderzoekers en is geïntegreerd in een van 's werelds grootste supercomputers.

“Sinds 2020, na het verschijnen van GPT, hebben we geprobeerd uit te vinden hoe onze hardware gebruikt kon worden om onze eigen LLM's te bouwen - zowel voor eigen gebruik als voor externe klanten. We leerden hoe we LLM's moesten maken en werden er zelfs behoorlijk goed in. Maar toen we voor het eerst met mensen spraken in 2021, 2022, hadden ze geen idee van GPT3, dus moesten we ons doel audience leren.

“We hebben met een klant samengewerkt om een groter model te maken, dat onlangs is uitgebracht op 40 miljard, op een unieke manier getraind om te concurreren met GPT3, maar met veel minder parameters. Dit betekent dat u een veel minder zware hardware-infrastructuur kunt gebruiken zonder dat het u een arm en een been kost.”

Igor benadrukt de waarde van grote taalmodellen en zegt:

“Ik denk dat de meeste bedrijven in de toekomst LLM-gebaseerd zullen zijn... Deze tools zullen hen in staat stellen om echte waarde te genereren uit hun eigen data.”Igor Carron, CEO & medeoprichter van LightOn

“Wat we klanten vandaag bieden, is een product dat Paradigm heet: het stelt bedrijven in staat om hun eigen data-stromen binnen hun organisaties te beheren en deze data te hergebruiken om deze modellen te hertrainen en te verbeteren. Dit zorgt ervoor dat hun interne processen of producten kunnen profiteren van de intelligentie die is verkregen uit hun interacties met hun LLM's.

“Velen in het Franse of Europese ecosysteem zijn afhankelijk van de Open AI API of andere Noord-Amerikaanse concurrenten.” Igor waarschuwt: “Het gevaar van het sturen van uw data naar een openbare API is dat het hergebruikt zal worden om opeenvolgende modellen te trainen. Dus, stel dat mensen in de mijnindustrie, die letterlijk weten waar ze goud kunnen vinden, hun technische reports ernaar toe sturen... Over een paar jaar, als u ChatGPT-8 of -9 of wat dan ook vraagt, ‘Waar is het goud?’ zal het u vertellen waar het goud is!” Hij raadt bedrijven sterk aan om de data die ze intern genereren te gaan gebruiken om hun modellen te trainen.

Een nationale strategie voor Generatieve Kunstmatige Intelligentie

Yohann Ralle, de laatste keynote spreker, is Generative AI Specialist bij het Ministerie van Economie, Financiën en Industriële en Digitale Soevereiniteit in Frankrijk. Hij begon met het uitleggen van zijn “toverformule” voor het bouwen van een state-of-the-art LLM: rekenkracht + datasets + fundamenteel onderzoek:

“Voor rekenkracht heeft de Franse regering geïnvesteerd in een digitale commons, de Jean Zay supercomputer, ontworpen om de AI-gemeenschap te dienen. Het heeft het trainen van de Europese meertalige BLOEM model.”Yohann Ralle, Generative AI Specialist bij het Ministerie van Economie, Financiën en Industriële en Digitale Soevereiniteit in Frankrijk.

“Wat betreft datasets, initiatieven zoals Ag1TP41Dub hebben geholpen bij het samenvoegen, annoteren en data kwalificeren van leer- en testresultaten om efficiënte en betrouwbare AI te ontwikkelen - wat ook kan bijdragen aan het Franse concurrentievermogen. Wat fundamenteel onderzoek betreft, heeft de nationale strategie geholpen om het ecosysteem voor AI-onderzoek en -ontwikkeling te structureren met de oprichting van het 3IA instituten, de financiering van doctoraatscontracten, de lancering van het IRT Saint Exupéry en het SystemX-project, meerdere opleidingsprogramma's voor studenten en nog veel meer in Frankrijk en Europa.”

Rondetafelgesprek over AI onder leiding van Vincent Luciani, CEO van Artefact

Heeft AI de Turingtest (d.w.z., heeft AI intelligentie van menselijk niveau bereikt)?

Hoewel de vraag gemengde reacties opriep, is de algemene consensus dat intelligentie er wel degelijk is, maar intentionaliteit niet.

Matthieu: “Ik denk dat het... Je hebt het gevoel dat er iemand is, zolang je niet naar afspraakjes vraagt. Er is een tijdelijke kant die niet werkt.”

Igor: “Mijn vraag is waarom u die vraag stelt? Omdat de Turingtest niet erg interessant is voor het bedrijfsleven. Maar in termen van interactie, ja, je kunt zeggen dat AI de test heeft doorstaan.”

Yohann: “De Turingtest is erg subjectief. Er is een risico als we menselijke eigenschappen aan AI toeschrijven, als we antropomorfiseren. Denk aan het geval van Google-ingenieur Blake Lemoine, die geloofde dat de LaMDA chatbot waarmee hij praatte een bewustzijn had gekregen... De Turingtest is een interessante oefening, meer niet.”

Hanan: “Wat ChatGPT betreft, komen we in de buurt, maar we zijn er nog niet.”

Is de komst van ChatGPT een revolutie, een evolutie of een onderdeel van een continuüm?

Igor: “Hoewel de langetermijnimpact van ChatGPT op LLM's nog niet volledig kan worden begrepen, zullen er na verloop van tijd nieuwe toepassingen voor deze technologieën ontstaan die belangrijke maatschappelijke implicaties hebben. De discussie is interessant, maar het belangrijkste zijn de feitelijke wetenschappelijke artikelen die de verbeteringen aan LLM's in detail zullen beschrijven. De huidige en potentiële praktische toepassingen van deze modellen mogen niet over het hoofd gezien of onderschat worden.”

Wat zijn de meest veelbelovende use cases voor bedrijven? Bots, afbeeldingen genereren?

Hanan: “Uiteraard zijn chatbots altijd belangrijk geweest in AI en dat zal ook zo blijven, want nu, met ChatGPT, kunt u er één in 48 uur opzetten door hem aan te sluiten op een database, dat is verbazingwekkend. Een andere use case is het creëren van autonome agents die specifieke taken kunnen uitvoeren zonder menselijke tussenkomst, zoals een reisagent die al uw tickets voor hotels en restaurants reserveert voor een bezoek aan Italië.”

Yohann: “Ik zie veel mogelijkheden voor CGT-aangedreven plugins, zoals Kayak of Booking. Ik denk dat het de digitale omgeving zal herstructureren, waarbij OpenAI de aggregators zal samenvoegen.”

Igor: “Ik voorzie een mogelijkheid voor het aanpassen van enterprise LLM's. Naast data lakes zullen bedrijven gaan begrijpen hoe ze ongestructureerde data kunnen gebruiken, en hoe ze intern echte waarde uit hun data kunnen genereren met privé LLM's. Tegelijkertijd denk ik dat we dankzij ChatGPT dramatische veranderingen zullen zien in de manier waarop mensen zoeken en het internet gebruiken.”

Vincent: Ik denk dat er een samensmelting zal plaatsvinden van interne bedrijfs data en LLM's tot een soort ‘Master FAQ+’’ die kan worden opgevraagd door zoek- of augmented agents. Het concept van zoekopdrachten evolueert: kopen mensen morgen één of meerdere trefwoorden, of kopen ze een concept? In de reclame was het doel altijd om op mensen gebaseerd te zijn, audience-gebaseerd; nu we persoonlijke data beschermen, gaan we in de richting van contextgebaseerd. En dat kan leiden tot interessantere reclame.”

Hoe wordt generatieve AI tegenwoordig gebruikt in organisaties? Heeft het invloed op de werkgelegenheid?

Matthieu: “We hebben geluk, een van onze concurrentievoordelen is dat AI in ons DNA zit. We moedigen het gebruik van meer generatieve tools intern aan. Ons technische team gebruikt Copilot voor ontwikkeling, en onze programmeurs gebruiken zowel ChatGPT als Copilot. We zijn creatiever met deze tools. Wat betreft werkgelegenheid: we groeien, dus we zijn van plan om nieuwe mensen aan te nemen... maar tegelijkertijd, als we geweldige software hebben, kunnen we meer doen met kleinere teams.”

Igor: “We hebben altijd met een klein team gewerkt - zeven of acht mensen - om hetzelfde hoge niveau van technische bekwaamheid te bereiken als bijvoorbeeld Google, waar de teams tien keer zo groot zijn. Onze kleine teams hebben een volledig onevenredig effect. Het is een verkeerd idee om te geloven dat je een groot team nodig hebt om grote dingen te bereiken.”

Yohann: “Tien jaar geleden zei een Amerikaanse studie dat er binnen 20 jaar 47% aan banen verloren zou gaan door AI, maar we zien dat dit niet gebeurt. Een recenter onderzoek van de OESO zei dat het dichter bij 14% lag. Ik denk dat we moeten denken in termen van taken, niet van banen. Zoals vermeld in een recent onderzoek van OpenAI, zal 80 tot 90% van de banen beïnvloed worden door generatieve AI - maar dat betekent eigenlijk dat 90% van de werknemers beïnvloed zal worden op 10% van hun taken. Wat interessant is, is dat het idee van beroepen waarvan we dachten dat ze onaantastbaar waren voor AI op de proef wordt gesteld, zoals beroepen in de creatieve, juridische, financiële en andere sectoren. De Franse regering heeft De LaborIA om deze kwesties te helpen onderzoeken.”

Wat zijn de beperkingen rond soevereiniteit en regelgeving voor deze modellen?

Hanan: “De eerste beperking betreft intellectueel eigendom (IP). Vandaag de dag hebben we drie soorten modellen: openbare modellen, zoals ChatGPT, waarbij de data die u verstuurt gebruikt kan worden voor commerciële doeleinden; privémodellen zonder eigenaar van het IP, zoals Google's API op Lamba; en zelfgeïnstalleerde open-source modellen. Data soevereiniteit is een probleem omdat GPT en PaLM niet Europees maar Amerikaans eigendom zijn.”

Yohann: “Regelgeving is een groot probleem in Europa. Italië heeft totaal het gebruik van ChatGPT verboden in afwachting van een onderzoek naar de vraag of de applicatie voldoet aan de GDPR privacyregelgeving. OpenAI moet extreem duidelijk zijn over hun gebruik van persoonlijke data door bijvoorbeeld een disclaimer te presenteren waarin staat dat ze persoonlijke data gebruiken en gebruikers de mogelijkheid te bieden om af te zien van het verzamelen van data en hen hun data te laten wissen. Een ander probleem met betrekking tot de beperkingen van LLM's zijn hallucinaties: ze geven vaak verkeerde antwoorden, wat ernstig kan zijn als het verzoek een publiek figuur betreft en het model een ‘nepnieuws’ verhaal genereert dat de persoon in kwestie echt schade kan berokkenen.”

Vincent: “Hebt u de kwestie van IP en de problemen die door Rechtszaak van Getty Images tegen Stability AI? Er zijn veel vragen over het schrapen van het internet voor afbeeldingen om modellen te trainen...”.”

Yohann: “We denken erover na. Open source zou een manier kunnen zijn om schone, auteursrechtvrije databasissen en datasets te maken die het intellectuele eigendom respecteren.”

Matthieu: “Wat betreft persoonlijke data en producten: wat ervoor zorgt dat ChatGPT of Midjourney of PhotoRoom goed werken, is niet persoonlijke data, maar feedback van klanten.”

Yohann: “Feedback van gebruikers is ideaal, maar het verzamelen ervan is onbetaalbaar in het geval van LLM's.”

Igor: “Waar is het geld? Dat is mijn vraag. Alle problemen die u naar voren hebt gebracht zijn technisch van aard, en we kunnen ze niet oplossen totdat we het geld hebben om ingenieurs in te huren en een ecosysteem op te zetten, en daar zijn we gewoon nog niet klaar voor.”

Denkt u dat er een GPU “oorlog” zal komen nu er steeds meer LLM's worden gebouwd?

Yohann: “Het is een echt risico. Op dit moment heeft NVIDIA hier een monopolie, zij beheersen de markt en de prijzen. Er zijn helaas geen echte concurrenten in Europa. Het is per definitie een beperkte bron, een zeldzame bron, dus het is een serieuze strijd.”

Matthieu: “Het gebrek aan beschikbaarheid van GPU's beperkt niet alleen onze productiviteit, maar ook de groei van bedrijven overal in Europa.”

Igor: “Aangezien we begonnen zijn als hardwareproducent, werden we in 2016 al met dit probleem geconfronteerd... Vandaag de dag zijn er mensen die bij onze concurrenten werken wier fulltime baan het is om genoeg GPU's te vinden om modellen te trainen... De markt explodeert, maar de chipproductie kan het niet bijhouden - waar ook ter wereld.”

Hanan: “Er zal onvermijdelijk een GPU-bottleneck zijn, maar we kunnen leren om efficiënter te zijn, dat moeten we. En we moeten kijken hoe we open source in onze bedrijven kunnen integreren, niet alleen hoe we alle nieuwste technologieën kunnen gebruiken.”

Waar ziet u de meeste waarde voor de toekomst? Open source modellen? LLM's?

Matthieu: “Bij PhotoRoom gebruiken we open source, waardoor we sneller kunnen werken en onze eigen IP kunnen ontwikkelen. We hebben een breed Knuffelende Gezichtsgemeenschap in Parijs die ons essentiële feedback geeft.”

Igor: “We gebruiken LLM's, maar we zijn niet gebonden aan dat bedrijfsmodel. We zouden open source kunnen gebruiken. Het belangrijkste is dat we onze eigen data kunnen en weten te hergebruiken om toekomstige modellen te trainen. Het doel is een industrie die deze modellen aanpast voor andere bedrijven.”

Yohann: “De evolutie van open source versus propriëtaire heeft generatieve AI aangedreven. De AI-gemeenschap heeft samengewerkt zodat andere actoren van dit fundamentele onderzoek konden profiteren om hun eigen modellen te bouwen. Ik vraag me af of de prestaties van deze open source-modellen niet lager zullen zijn dan die van propriëtaire modellen, maar dat kan veranderen. In ieder geval moet men zich afvragen of Google er geen spijt van heeft dat ze de deuren naar hun ChatGPT-technologie hebben geopend!”

De ronde tafel werd gevolgd door een audience Q & A sessie, met een bijzonder geanimeerde discussie over het gebrek aan women in de techniek. Yohann beschreef een aantal van de maatregelen die door de Franse regering worden genomen met betrekking tot onderwijs die specifiek gericht zijn op meisjes en women, terwijl Vincent sprak over wat er wordt gedaan door de Artefact School van Data, de Women@Artefact initiatief en andere techbedrijven om te proberen de situatie te corrigeren.

Andere vragen gingen over inclusiviteit voor het gebruik van LLM's door mensen met autisme en andere handicaps; het probleem van AI-hallucinaties; de maatregelen die bedrijven van plan zijn te nemen om het milieu te beschermen; de rol van Europa versus Frankrijk met betrekking tot het schrapen van internet voor data. Bekijk de conferentie replay om te zien hoe de deelnemers deze vragen beantwoordden.

BLOG

BLOG