Lors de la conférenceArtefact l'IAArtefact , qui s'est tenue le 20 avril 2023, des acteurs majeurs du secteur de l'IA générative ont partagé leurs connaissances et échangé leurs points de vue sur cette nouvelle technologie et sur la manière dont les entreprises peuvent l'utiliser pour améliorer leur productivité.

Les derniers modèles d'IA générative sont capables d'avoir des conversations sophistiquées avec les utilisateurs, de créer du contenu apparemment original (images, fichiers audio, textes) à partir de leurs data d'entraînement, et d'effectuer des tâches manuelles ou répétitives telles que la rédaction d'e-mails, la programmation ou la synthèse de documents complexes. Il est aujourd'hui essentiel que les décideurs élaborent une stratégie claire et convaincante en matière d'IA générative et accordent la priorité à data ainsi qu'à la conception de solutions commerciales basées sur l'IA générative.

Organisateurs de la conférence et conférenciers principaux :

IA générative : à la découverte de nouvelles frontières créatives

Dans son discours d'ouverture de la conférence, Vincent Luciani a déclaré : « Partout, les gens sont enthousiasmés par cette nouvelle technologie et par l'impact qu'elle aura sur les entreprises et les employés. Jusqu'à présent, ce dont nous disposions en matière d'IA, c'étaient des applications relativement déterministes, enrichies par l'apprentissage automatique. Nous étions capables de prédire, de personnaliser, d'optimiser, mais pas vraiment de créer. »

« Mais aujourd’hui, pour la première fois, nous assistons à une véritable interaction entre l’homme et la machine. Une véritable forme d’intelligence est en train d’émerger de cette technologie et de ces algorithmes, même si la communauté scientifique est divisée sur la question de savoir s’il s’agit d’une révolution ou d’une évolution…

« Nous avons déjà parlé des humains augmentés ou des activités augmentées : bientôt, nous parlerons des entreprises augmentées. » Avant de présenter un bref aperçu des thèmes qui seraient abordés lors de la conférence et de céder la parole aux intervenants principaux, il a rappelé à l’auditoire que

« Malgré l'apparition constante de nouvelles applications d'IA générative, la prudence est de mise : une transformation réussie de l'entreprise ne se fait pas du jour au lendemain, elle nécessite de la réflexion, des recherches et une bonne préparation. »Vincent Luciani, PDG et cofondateur Artefact

Perspectives et opportunités sur le marché de l'IA générative

La première intervenante principale, Hanan Ouazan, a commencé par présenter les modèles textuels, en partant de l’article révolutionnaire de Google publié en 2017, intitulé «Attention is all you need », , qui a conduit à la création des Transformers, à la base de presque tous les grands modèles linguistiques (LLM) utilisés aujourd’hui. « Comme vous le savez, la recherche prend du temps, mais nous sommes aujourd’hui dans une période d’accélération, où nous voyons chaque jour apparaître de nouveaux modèles qui tirent parti d’un accès accru aux data aux infrastructures. »

Hanan a abordé plusieurs aspects de la démocratisation et de l'accessibilité des modèles d'IA générative, soulignant notamment l'accélération de l'adoption de cette technologie : « Le rythme est fulgurant : ChatGPT a atteint le million d'utilisateurs en seulement cinq jours. »

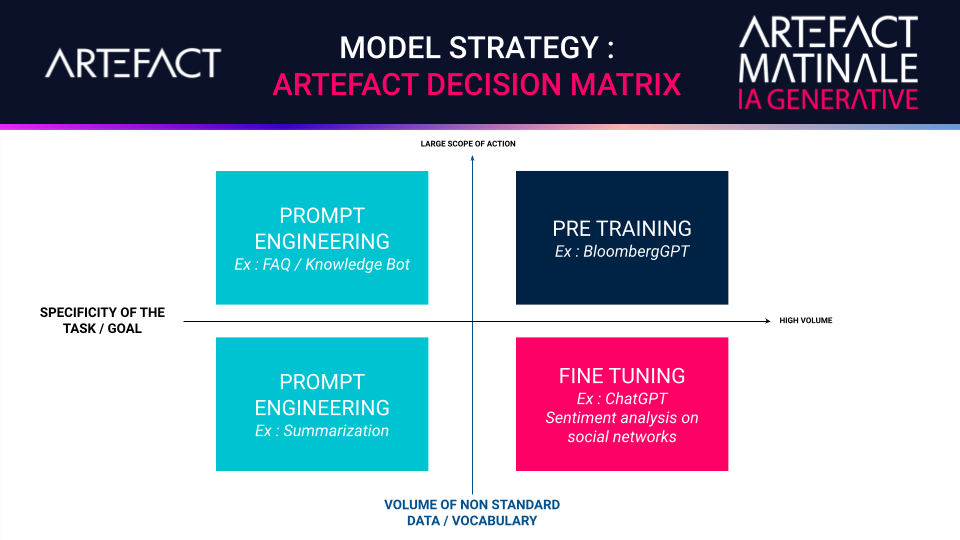

En ce qui concerne les stratégies relatives aux méthodes d'entraînement des modèles de langage (LLM), il a abordé les avantages du pré-entraînement, du réglage fin et de l'ingénierie des prompts, en citant des cas d'utilisation industriels pour chacune de ces techniques et en présentant la matrice décisionnelle Artefactrelative à la stratégie des modèles.

Outre le coût de possession, les performances et les limites, Hanan a également abordé la question de la gestion du changement et les répercussions que l'IA générative pourrait avoir sur l'emploi.

« Cela va certainement transformer nos méthodes de travail, mais chez Artefact, nous ne pensons pas que cela mettra fin à certains métiers : cela permettra plutôt de renforcer les capacités des personnes qui les exercent. »Hanan Ouazan, associée Data et responsable de l'IA générative chez Artefact

Une plateforme photo basée sur l'IA générative pour le commerce électronique

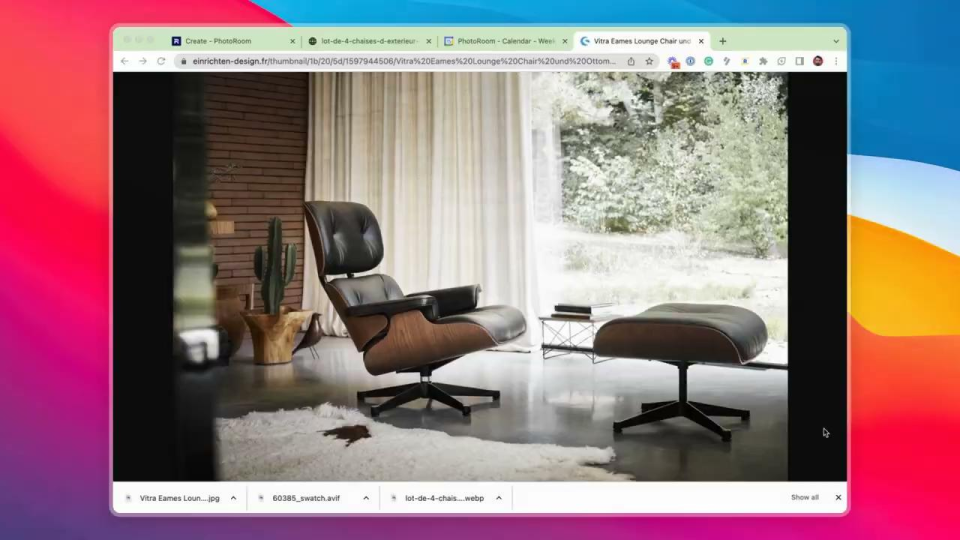

Matthieu Rouif, intervenant principal, est PDG et cofondateur de PhotoRoom, une application qui permet à ses 80 millions d'utilisateurs de créer des photos de qualité professionnelle à l'aide d'un smartphone, grâce à Stable Diffusion, une technologie d'IA générative dédiée à l'image.

Depuis l'explosion des places de marché en ligne provoquée par la pandémie de COVID-19, deux milliards de photos sont retouchées chaque année. Et l'application PhotoRoom joue un rôle majeur en automatisant le détourage, le rendu des ombres et la génération d'arrière-plans réalistes pour les commerçants. « Nous utilisons l'IA générative pour proposer à nos clients des photos qui semblent avoir été prises par un photographe professionnel, en y ajoutant même des arrière-plans uniques et réalistes générés par l'IA en moins d'une seconde », explique Matthieu.

« Nous aidons nos clients à développer leur activité en leur fournissant des photos en nombre, de grande qualité et à moindre coût, qui respectent l'image de leur marque et mettent leurs produits en valeur afin d'attirer et de fidéliser la clientèle. »Matthieu Rouif, PDG et cofondateur de PhotoRoom

Repenser l'IA pour les entreprises

Igor Carron est PDG et cofondateur de LightOn, une entreprise française à l'origine de la nouvelle plateforme d'IA générative Paradigm, plus puissante que GPT-3. Elle propose les modèles les plus avancés pour l'exploitation de serveurs et data garantissant data aux entreprises.

Dans son discours d'ouverture, Igor a évoqué les origines de son entreprise. « Lorsque nous avons créé LightOn en 2016, nous développions du matériel informatique utilisant la lumière pour effectuer des calculs destinés à l'IA. C'était une approche inhabituelle, mais elle a porté ses fruits : notre unité de traitement optique (OPU), le premier coprocesseur photonique dédié à l'IA au monde, est désormais utilisée par des chercheurs du monde entier et a été intégrée à l'un des plus grands supercalculateurs au monde. »

« Depuis 2020, après l'arrivée du GPT, nous nous sommes efforcés de déterminer comment notre matériel pourrait servir à développer nos propres modèles de langage à grande échelle (LLM), tant pour notre usage interne que pour celui de clients externes. Nous avons appris à créer des LLM et sommes même devenus assez doués dans ce domaine. Mais lorsque nous avons commencé à en parler aux gens en 2021 et 2022, ils ne savaient absolument rien de GPT-3, nous avons donc dû informer notre public cible.

« Nous avons collaboré avec un client pour créer un modèle plus puissant, récemment lancé avec 40 milliards de paramètres, entraîné selon une méthode unique afin de rivaliser avec GPT-3, mais en utilisant beaucoup moins de paramètres. Cela signifie que vous pouvez vous contenter d'une infrastructure bien moins gourmande en ressources matérielles et l'utiliser sans que cela ne vous coûte les yeux de la tête. »

Igor souligne l'intérêt des grands modèles linguistiques et déclare :

« Je pense qu'à l'avenir, la plupart des entreprises s'appuieront sur des modèles de langage de grande envergure (LLM)… Ces outils leur permettront de tirer une réelle valeur de leurs propres data. »Igor Carron, PDG et cofondateur de LightOn

« Ce que nous proposons aujourd’hui à nos clients, c’est un produit appelé Paradigm : il permet aux entreprises de gérer leurs propres data au sein de leur organisation et de réutiliser ces data réentraîner et améliorer ces modèles. Cela garantit que leurs processus ou produits internes puissent tirer parti des connaissances acquises grâce à leurs interactions avec leurs modèles de langage de grande envergure (LLM). »

« De nombreux acteurs de l’écosystème français ou européen dépendent de l’API d’OpenAI ou d’autres concurrents nord-américains. » Igor met en garde : « Le danger, quand on envoie ses data une API publique, c’est qu’elles soient réutilisées pour entraîner des modèles successifs. Imaginons que des acteurs du secteur minier, qui savent littéralement où trouver de l’or, y envoient leurs rapports techniques… Dans quelques années, si vous demandez à ChatGPT-8, -9 ou n’importe quelle autre version : « Où se trouve l’or ? », elle vous dira où il se trouve ! » Il recommande vivement aux entreprises de commencer à utiliser les data génèrent en interne pour entraîner leurs modèles.

Une stratégie nationale pour l'intelligence artificielle générative

Yohann Ralle, dernier intervenant principal, est spécialiste en IA générative au ministère de l'Économie, des Finances et de la Souveraineté industrielle et numérique en France. Il a commencé par expliquer sa « formule magique » pour développer un modèle de langage de pointe : puissance de calcul + ensembles de données + recherche fondamentale :

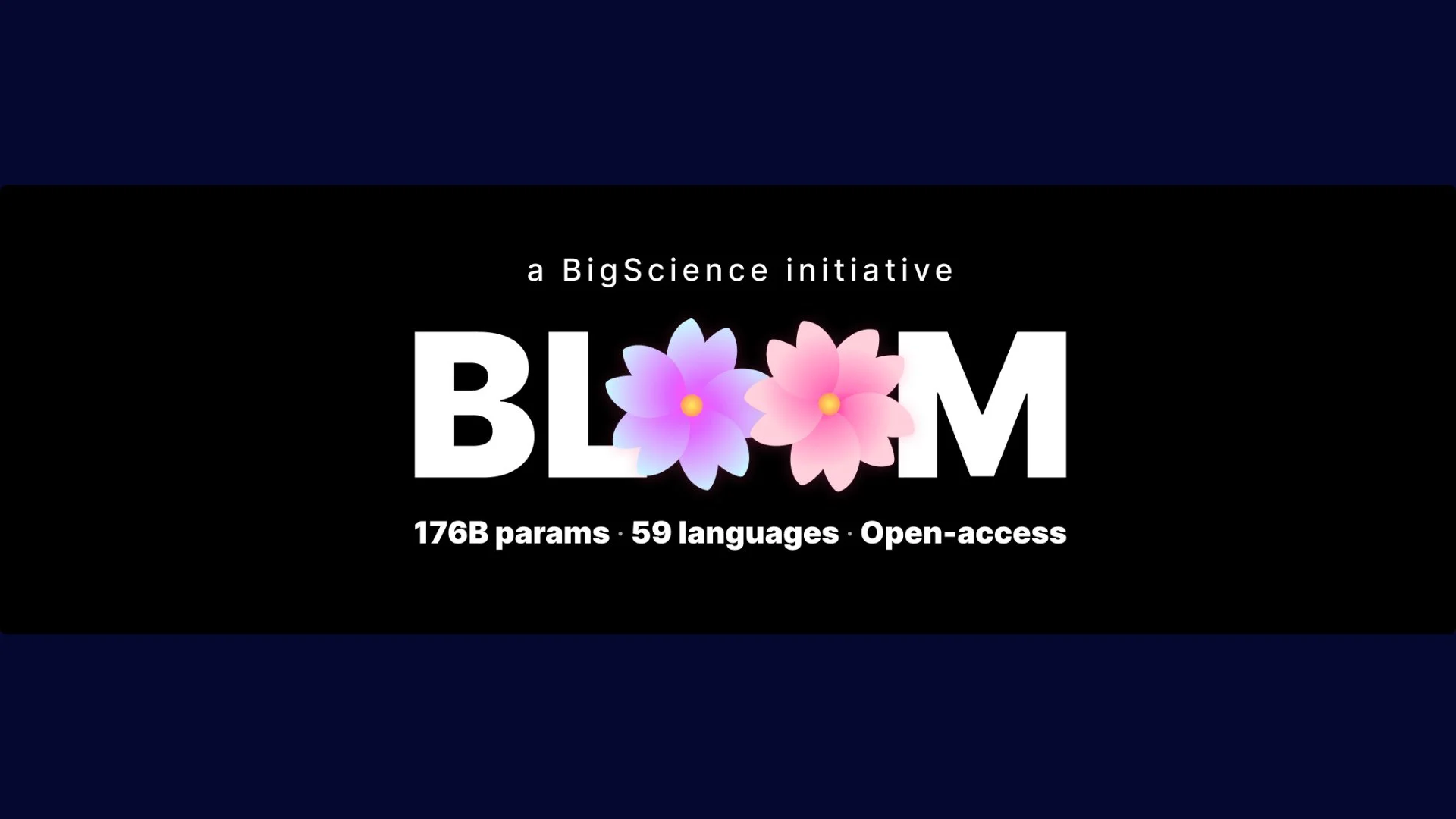

« En matière de puissance de calcul, le gouvernement français a investi dans un bien commun numérique, le supercalculateur Jean Zay, conçu pour servir la communauté de l'IA. Il a permis l'entraînement du modèle multilingue européen BLOOM. »Yohann Ralle, spécialiste en IA générative au ministère de l'Économie, des Finances et de la Souveraineté industrielle et numérique en France.

«En ce qui concerne les ensembles de données, des initiatives telles qu’Agdatahub ont permis d’agréger, d’annoter et de qualifier data d’apprentissage et de test data développer une IA efficace et fiable, ce qui peut également contribuer à la compétitivité française. Quant à la recherche fondamentale, la stratégie nationale a permis de structurer l’écosystème de recherche et développement en IA grâce à la création des instituts 3IA, au financement de contrats de doctorat, au lancement des projets IRT Saint-Exupéry et SystemX, à de multiples programmes de formation d’étudiants et à bien d’autres initiatives encore, tant en France qu’en Europe. »

Table ronde sur l'IA générative animée par Vincent Luciani, PDG Artefact

L'IA a-t-elle réussi le test de Turing (c'est-à-dire, l'IA a-t-elle atteint un niveau d'intelligence équivalent à celui des humains) ?

Si cette question a suscité des réactions mitigées, le consensus général est que, bien que l'intelligence soit bel et bien présente, l'intentionnalité, elle, fait défaut.

Matthieu : « Je pense que oui… On a l’impression qu’il y a quelqu’un en face, tant qu’on ne lui pose pas de questions sur les dates. Il y a un aspect temporel qui ne fonctionne pas. »

Igor : « Ma question est : pourquoi as-tu posé cette question ? Parce que le test de Turing n’est pas très intéressant d’un point de vue commercial. Mais, en termes d’interaction, oui, on peut dire que l’IA a réussi le test. »

Yohann : « Le test de Turing est très subjectif. Il y a un risque lorsque l’on attribue des qualités humaines à l’IA, lorsque l’on anthropomorphise. Rappelez-vous le cas de Blake Lemoine, cet ingénieur de Google qui pensait que le chatbot LaMDA avec lequel il discutait était devenu doué de conscience… Le test de Turing est un exercice intéressant, rien de plus. »

Hanan : « En ce qui concerne ChatGPT, on s'en approche, mais on n'y est pas encore. »

L'arrivée de ChatGPT est-elle une révolution, une évolution ou s'inscrit-elle dans une continuité ?

Igor : « Même si l'impact à long terme de ChatGPT sur les modèles de langage à grande échelle (LLM) ne peut pas encore être pleinement appréhendé, de nouvelles utilisations de ces technologies, aux implications sociétales importantes, verront le jour au fil du temps. Le débat est intéressant, mais ce sont avant tout les articles scientifiques qui détailleront les améliorations apportées aux LLM qui importent. Il ne faut ni négliger ni sous-estimer les applications pratiques actuelles et potentielles de ces modèles. »

Quels sont les cas d'usage les plus prometteurs pour les entreprises ? Bots, génération d'images ?

Hanan : « Il est évident que les chatbots ont toujours joué un rôle important dans le domaine de l'IA et qu'ils continueront d'être un cas d'utilisation majeur, car aujourd'hui, grâce à ChatGPT, on peut en mettre un en place en 48 heures en le connectant à une base de données, c'est incroyable. Un autre cas d'utilisation concerne la création d'agents autonomes capables d'effectuer des tâches spécifiques sans intervention humaine, comme un agent de voyage qui réserve tous vos billets, vos hôtels et vos restaurants pour un séjour en Italie. »

Yohann : « Je vois de nombreuses opportunités pour les plugins basés sur la technologie CGT, comme Kayak ou Booking. Je pense que cela va redéfinir le paysage numérique, où OpenAI deviendra le regroupement des agrégateurs. »

Igor: « J’envisage la possibilité de personnaliser les grands modèles de langage (LLM) d’entreprise. Au-delà data , les entreprises commenceront à comprendre comment exploiter data non structurées et comment générer une réelle valeur ajoutée à partir de leurs data grâce à des LLM privés. Parallèlement, je pense que nous assisterons à des changements radicaux dans la manière dont les gens effectuent des recherches et utilisent Internet grâce à ChatGPT. »

Vincent : Je pense qu’il y aura une fusion entre data internes des entreprises data les LLM pour former une sorte de « Master FAQ+ » qui pourra être interrogée par des agents de recherche ou des agents augmentés. Le concept de requête évolue : demain, les gens achèteront-ils un ou plusieurs mots-clés, ou achèteront-ils un concept ? En publicité, l’objectif a toujours été d’être axé sur les personnes, sur l’audience ; aujourd’hui, alors que nous protégeons data personnelles, nous nous orientons vers une approche contextuelle. Et cela peut déboucher sur une publicité plus intéressante. »

Comment l'IA générative est-elle utilisée aujourd'hui dans les entreprises ? A-t-elle un impact sur l'emploi ?

Matthieu : « Nous avons de la chance : l'un de nos avantages concurrentiels, c'est que l'IA fait partie intégrante de notre ADN. Nous encourageons l'utilisation d'outils plus génératifs en interne. Notre équipe technique utilise Copilot pour le développement, et nos développeurs utilisent à la fois ChatGPT et Copilot. Ces outils nous permettent d’être plus créatifs. En ce qui concerne l’emploi, nous sommes en pleine croissance, nous prévoyons donc de recruter de nouvelles personnes… mais en même temps, lorsque nous disposons d’excellents logiciels, nous pouvons faire plus avec des équipes plus réduites. »

Igor : « Nous avons toujours travaillé avec une petite équipe – sept ou huit personnes – pour atteindre le même niveau d’excellence technique que Google, par exemple, où les équipes sont dix fois plus importantes. Nos petites équipes ont un impact tout à fait disproportionné. C’est une idée fausse de croire qu’il faut une grande équipe pour réaliser de grandes choses. »

Yohann : « Il y a dix ans, une étude américaine prévoyait que 47 % des emplois disparaîtraient à cause de l’IA dans les vingt ans, mais on constate que ce n’est pas le cas. Une enquête plus récente de l’OCDE estime ce chiffre plutôt à 14 %. Je pense qu’il faut raisonner en termes de tâches, et non d’emplois. Comme le mentionne une récente étude d’OpenAI, 80 à 90 % des emplois seront affectés par l’IA générative – mais cela signifie en réalité que 90 % des employés seront concernés pour 10 % de leurs tâches. Ce qui est intéressant, c’est que la notion de professions que nous pensions à l’abri de l’IA est remise en question, comme celles des secteurs créatif, juridique, financier et autres. Le gouvernement français a créé Le LaborIA pour aider à explorer ces questions. »

Quelles sont les contraintes liées à la souveraineté et à la réglementation pour ces modèles ?

Hanan : « La première limite concerne la propriété intellectuelle (PI). Aujourd’hui, il existe trois types de modèles : les modèles publics, comme ChatGPT, où les data envoyez peuvent être utilisées à des fins commerciales ; les modèles privés sans propriétaire de PI, comme l’API de Google sur Lambda ; et les modèles open source que l’on installe soi-même. La Data pose problème, car GPT et PaLM ne sont pas européens, mais appartiennent à des entreprises américaines. »

Yohann : « La réglementation est un enjeu majeur en Europe. L’Italie a totalement interdit l’utilisation de ChatGPT dans l’attente d’une enquête visant à déterminer si l’application respecte les règles de confidentialité du RGPD. OpenAI doit faire preuve d’une extrême transparence quant à son utilisation des data personnelles, par exemple data affichant une clause de non-responsabilité indiquant qu’elle utilise data personnelles data permettant aux utilisateurs de refuser data et en leur donnant la possibilité d’effacer leurs data. Un autre problème lié aux limites des modèles de langage génératifs (LLM) concerne les « hallucinations » : ils donnent souvent des réponses erronées, ce qui peut être grave si la requête concerne une personnalité publique et que le modèle génère une « fausse nouvelle » susceptible de nuire réellement à la personne en question. »

Vincent : « T'es-tu penché sur la question de la propriété intellectuelle et sur les problèmes soulevés par le procès intenté par Getty Images contre Stability AI? Il y a beaucoup de questions concernant la collecte d'images sur Internet pour entraîner des modèles… »

Yohann : « Nous y réfléchissons. L'open source pourrait être un moyen de créer des bases de données et des ensembles de données transparents, libres de droits d'auteur et respectueux de la propriété intellectuelle. »

Matthieu : « En ce qui concerne les data personnelles data les produits : ce qui permet à ChatGPT, Midjourney ou PhotoRoom de bien fonctionner, ce ne sont pas les data personnelles, mais les retours des clients. »

Yohann : « Les retours des utilisateurs sont parfaits, mais leur collecte coûte une fortune dans le cas des grands modèles de langage. »

Igor : « Où est l'argent ? Voilà ma question. Tous les problèmes que vous avez soulevés sont d'ordre technique, et nous ne pourrons les résoudre tant que nous n'aurons pas les fonds nécessaires pour embaucher des ingénieurs et mettre en place un écosystème, et nous n'en sommes tout simplement pas encore prêts. »

Avec la multiplication des grands modèles de langage (LLM), pensez-vous qu'il y aura une « guerre » des GPU ?

Yohann : « C'est un vrai risque. À l'heure actuelle, NVIDIA détient le monopole dans ce domaine : l'entreprise contrôle le marché et les prix. Il n'y a malheureusement pas de véritables concurrents en Europe. C'est une ressource limitée par définition, une ressource rare, donc la bataille s'annonce rude. »

Matthieu : « La pénurie de cartes graphiques freine considérablement non seulement notre productivité, mais aussi la croissance des entreprises partout en Europe. »

Igor : « Comme nous avons commencé en tant que fabricant de matériel, nous avons déjà été confrontés à ce problème en 2016… Aujourd’hui, certains employés de nos concurrents ont pour seule mission de trouver suffisamment de cartes graphiques pour entraîner des modèles… Le marché est en pleine explosion, mais la production de puces ne parvient pas à suivre le rythme, nulle part dans le monde. »

Hanan : « Il y aura inévitablement un goulot d'étranglement au niveau des GPU, mais nous pouvons apprendre à être plus efficaces, et nous devons l'être. Et nous devons réfléchir à la manière d'intégrer l'open source dans nos entreprises, et pas seulement à la façon d'utiliser toutes les technologies de pointe. »

Où voyez-vous le plus grand potentiel pour l'avenir ? Les modèles open source ? Les grands modèles de langage (LLM) ?

Matthieu : « Chez PhotoRoom, nous utilisons l’open source, ce qui nous permet d’avancer plus vite et de développer notre propre propriété intellectuelle. Nous disposons d’une vaste communauté Hugging Face à Paris qui nous apporte des retours d’expérience essentiels. »

Igor : « Nous utilisons des LLM, mais nous ne sommes pas attachés à ce modèle économique. Nous pourrions utiliser l’open source. L’important est d’être capable et de savoir comment réutiliser nos data propriétaires data entraîner de futurs modèles. L’objectif est de créer un secteur qui personnalise ces modèles pour d’autres entreprises. »

Yohann : « L'évolution de l'open source par rapport aux solutions propriétaires a été le moteur de l'IA générative. La communauté de l'IA a collaboré pour permettre à d'autres acteurs de tirer parti de cette recherche fondamentale afin de développer leurs propres modèles. Je me demande si les performances de ces modèles open source ne seront pas inférieures à celles des modèles propriétaires, mais cela pourrait changer. Quoi qu'il en soit, on peut se demander si Google ne regrette pas d'avoir ouvert la voie à sa technologie ChatGPT ! »

La table ronde a été suivie d'une séance de questions-réponses avec le public, au cours de laquelle le manque de femmes dans le secteur des technologies a donné lieu à un débat particulièrement animé. Yohann a présenté en détail plusieurs mesures prises par le gouvernement français en matière d'éducation et destinées spécifiquement aux filles et aux femmes, tandis que Vincent a évoqué les actions menées par Artefact of Data, l'initiative Artefact et d'autres entreprises technologiques pour tenter de remédier à cette situation.

D'autres questions ont été soulevées concernant l'accessibilité des grands modèles de langage (LLM) pour les personnes autistes ou souffrant d'autres handicaps ; le problème des « hallucinations » de l'IA ; les mesures que les entreprises prévoient de mettre en place pour protéger l'environnement ; ainsi que le rôle de l'Europe par rapport à la France en matière de collecte de data sur Internet. Pour découvrir les réponses des participants à ces questions, regardez replay de la conférence.

BLOG

BLOG