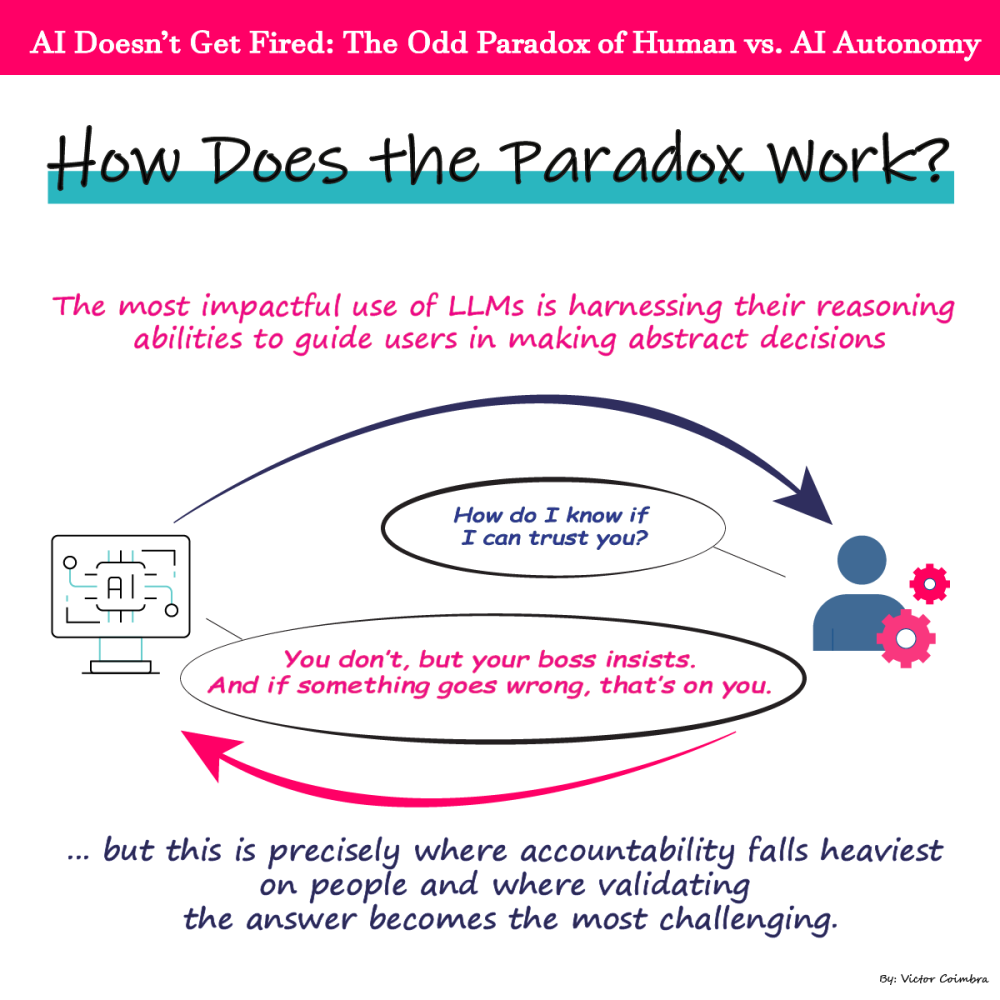

Se o seu chefe lhe pedir um número crítico e o senhor usar o “GPT interno ultra-seguro” da sua empresa para obter as informações, mas o resultado estiver incorreto, de quem é a culpa? A resposta, como todos sabemos, é sua por não validar o resultado. Isso cria um paradoxo: embora as empresas pressionem a IA para acelerar a tomada de decisões, elas atribuem aos seres humanos a responsabilidade final pelos resultados orientados pela IA. A questão então se torna: Qual é o ponto ideal entre a autonomia da IA e a supervisão humana?

Historicamente, consideramos as máquinas como ferramentas binárias - certas ou erradas (por exemplo, uma calculadora que afirmasse que 1+1=3 seria imediatamente considerada quebrada). Mas a IA opera em probabilidades, O senhor pode ter uma visão mais ampla do mundo, muito parecida com o raciocínio humano. Isso exige uma mudança de mentalidade: devemos parar de tratar os resultados da IA como respostas definitivas e começar a tratá-los como entradas para um processo de tomada de decisão mais amplo.

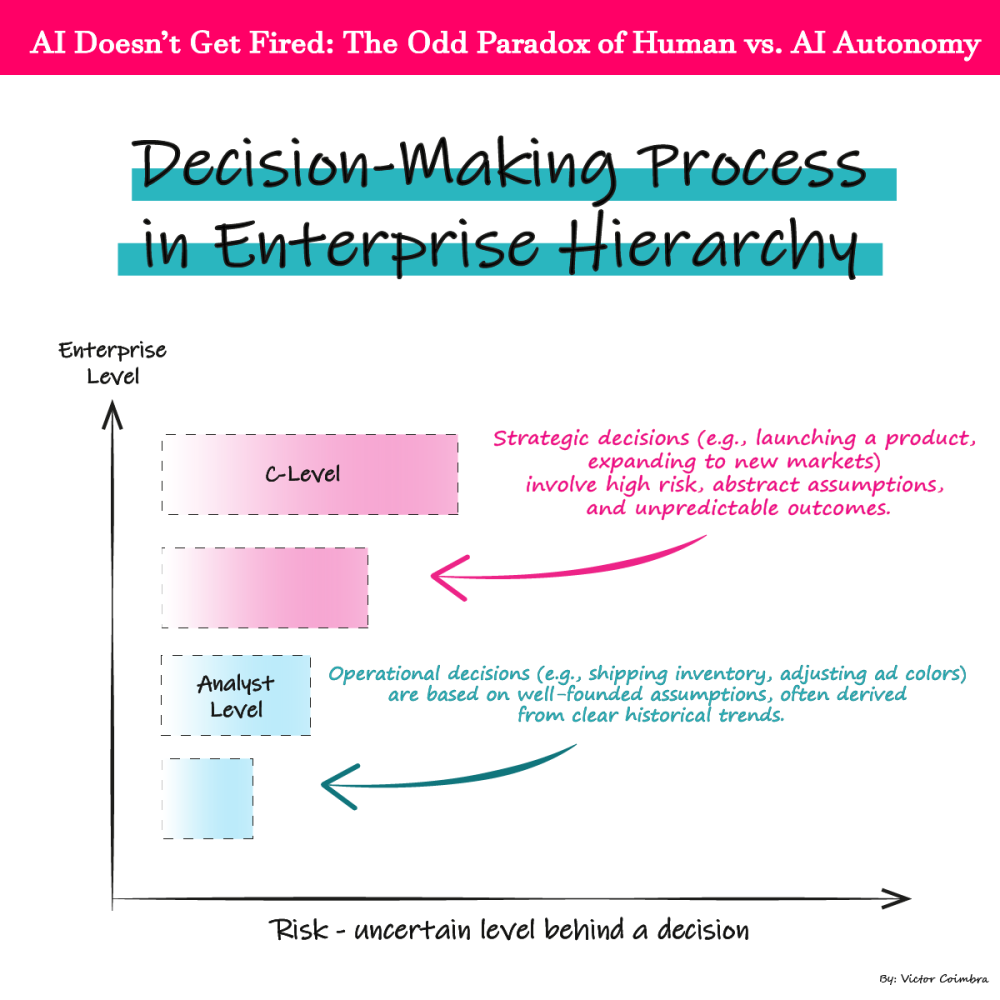

Para refinar esse equilíbrio, precisamos dissecar como as empresas abordam as decisões. Tudo se baseia em uma palavra: risco-Especificamente, o impacto financeiro de estar errado. As hierarquias organizacionais refletem isso claramente:

- Decisões operacionais (por exemplo, envio de estoque, ajuste de cores de anúncios) têm baixo risco e custos reversíveis.

- Decisões estratégicas (por exemplo, o lançamento de um produto, a expansão para novos mercados) envolvem alto risco, suposições abstratas e resultados imprevisíveis.

Os seres humanos seguem a mesma lógica baseada em riscos. Quanto mais abstratas e incertas forem as suposições por trás de uma decisão, maior será o nível organizacional necessário para aprová-la. As escolhas de um CEO (por exemplo, prever mudanças no mercado ou no comportamento do consumidor) dependem de data caótico e ambíguo, enquanto os cálculos de estoque de um gerente usam tendências históricas concretas.

Traduzindo isso para a IA: O nível de responsabilidade humana deve estar correlacionado com a abstração do data e as suposições por trás do resultado da IA. Por exemplo:

- Baixa abstração (por exemplo, previsão de demanda usando o histórico de vendas): Supervisão humana mínima.

- Alta abstração (por exemplo, estratégias de entrada no mercado usando análise de sentimentos): O julgamento humano não é negociável.

O Paradoxo Duplo: A maior força da IA - navegar na ambiguidade - é também sua maior responsabilidade. Seu verdadeiro valor surge em decisões incertas e de alto risco, em que os seres humanos precisam processar grandes quantidades de data. No entanto, paradoxalmente, é também nesse ponto que os seres humanos devem confiar mais no raciocínio probabilístico, mesmo que a responsabilidade recaia mais sobre eles - criando uma tensão inerente:

- Por um lado, A IA se sobressai em cenários caóticos (por exemplo, prever tendências de consumo em um mercado volátil) porque processa grandes datasets que os humanos não conseguem.

- Por outro lado, Se o senhor não tiver a certeza de que o data que o conduz é inerentemente instável, os seres humanos são os únicos responsáveis pelas decisões nesses mesmos cenários.

O poder exclusivo dos modelos de linguagem ampla (LLMs) reside em sua capacidade de simular o raciocínio-e não apenas automatizar tarefas. Se o senhor quiser uma lógica simples do tipo “se isso, então aquilo”, existem ferramentas mais baratas. Os LLMs prosperam onde reina a ambiguidade: eles analisam o data não estruturado, inferem o contexto e geram caminhos probabilísticos que imitam a intuição humana.

Esse paradoxo força uma pergunta crítica: Se os seres humanos continuam sendo responsáveis, por que usar a IA em cenários de alto risco? A resposta está em reformular o papel da IA. Não se trata de terceirizar decisões - trata-se de encolhendo o desconhecido. A IA não elimina o risco; ela oferece aos humanos uma maneira estruturada de interrogar o caos.

Como aproveitar a IA sem abrir mão da agência?

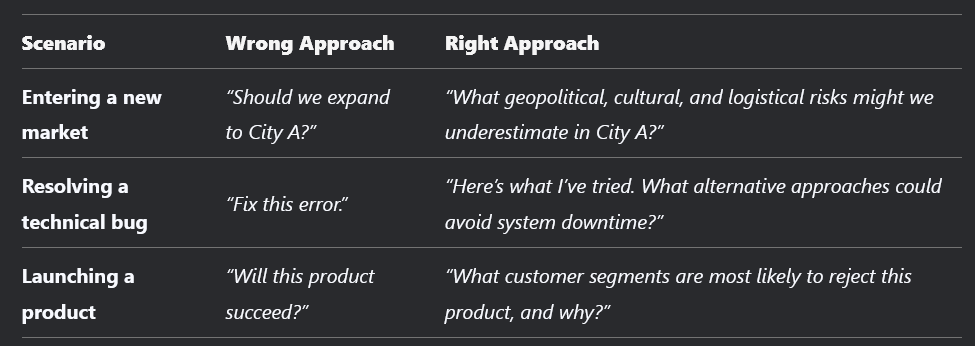

O segredo é tratar a IA como uma desafiador colaborativo, O senhor não é um tomador de decisões. Por exemplo:

O padrão? A IA prospera quando os humanos pedem que ela o faça desafiar as suposições, e não confirmá-las. Isso muda a mentalidade do “Qual é a resposta?” para “O que estamos perdendo?”

O paradoxo é claro: O valor da IA aumenta com a ambiguidade, mas também aumenta a responsabilidade humana. O ponto ideal não é equilibrar a autonomia - é redefinir a colaboração. Use a IA para mapear o campo minado da incerteza, mas deixe que os humanos escolham o caminho.

Se as empresas não treinarem os funcionários para essa mudança, o paradoxo aumentará. As equipes ficarão ressentidas com os resultados da IA, duvidando de todas as respostas e assumindo total responsabilidade pelos resultados. As organizações ficarão estagnadas, perdendo tempo debatendo se devem “confiar” na IA em vez de aproveitá-la para acelerar as decisões. Pior ainda, elas ficarão atrás dos concorrentes que adotam uma verdade simples: A pergunta “Podemos confiar na IA?” é irrelevante - a IA não é responsável e nunca saberemos realmente se ela está “certa” ou “errada”.”

A solução? Normalizar a IA como uma ferramenta de revelação de riscos de resultados probabilísticos:

- Recompensar a curiosidade e as simulações de cenários, O senhor não tem respostas gravadas em pedra.

- Separe a IA da culpa. Rotule suas saídas como “input” (entrada)” (não “aconselhamento”), liberando os seres humanos para criticar sem defensividade.

- Treinar para o pensamento probabilístico. Ensine os funcionários a interpretar intervalos de confiança, faixas de cenários e sinalizadores de viés - não apenas resultados do tipo “sim/não”.

Quando as respostas da IA não são validadas, os humanos são demitidos. Quando os humanos aprendem a usar o poder probabilístico da IA, as empresas transformam a incerteza em estratégia.

BLOG

BLOG