Als uw baas u om een kritisch getal vraagt en u gebruikt de “Ultra Secure Internal GPT” van uw bedrijf om de informatie op te halen, maar het resultaat is fout, wiens fout is het dan? Het antwoord is, zoals we allemaal weten, de uwe omdat u de uitvoer niet gevalideerd heeft. Dit creëert een paradox: terwijl bedrijven AI stimuleren om de besluitvorming te versnellen, leggen ze de uiteindelijke verantwoordelijkheid voor AI-gestuurde resultaten bij mensen. De vraag wordt dan: Wat is de sweet spot tussen AI-autonomie en menselijk toezicht?

Historisch gezien hebben we machines gezien als binaire hulpmiddelen - goed of fout (een rekenmachine die bijvoorbeeld beweert dat 1+1=3 is, zou onmiddellijk als kapot worden beschouwd). Maar AI werkt op waarschijnlijkheden, Net als menselijk redeneren. Dit vereist een mentaliteitsverandering: we moeten stoppen met het behandelen van AI-outputs als definitieve antwoorden en ze gaan behandelen als input voor een breder besluitvormingsproces.

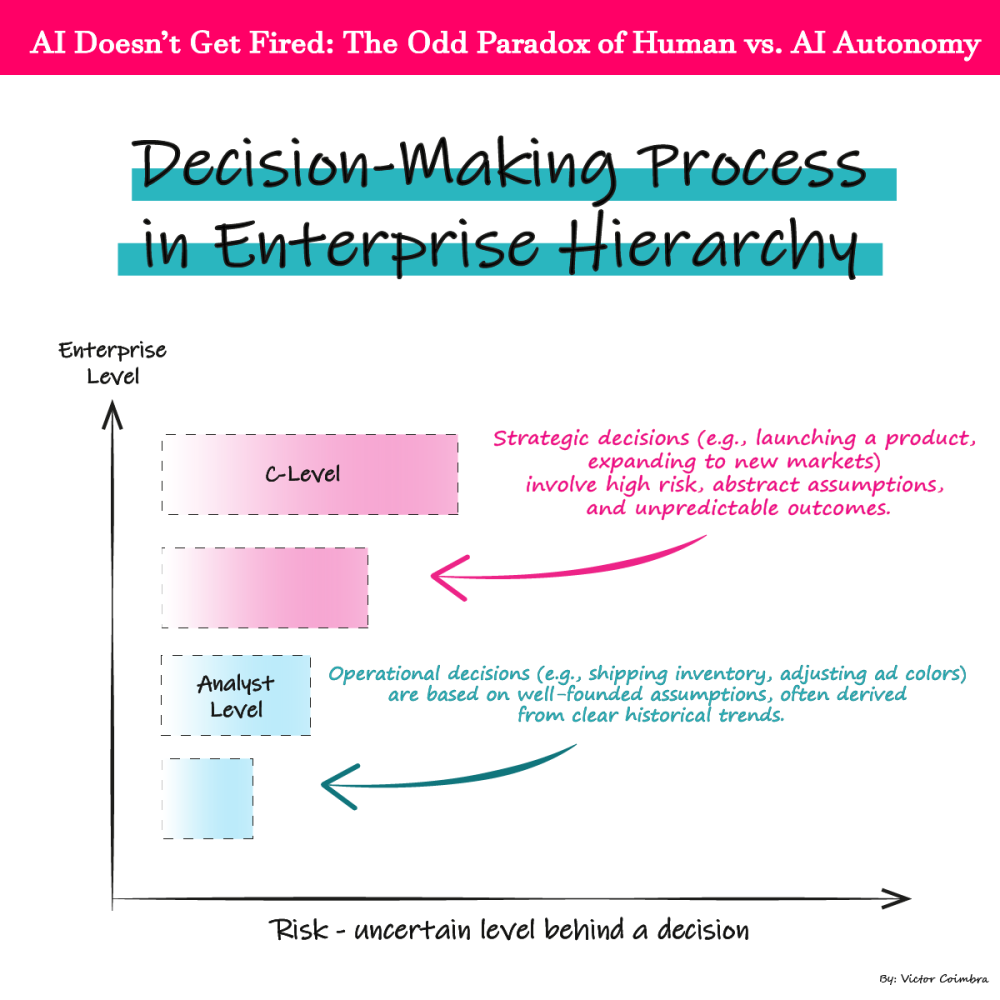

Om deze balans te verfijnen, moeten we ontleden hoe ondernemingen beslissingen benaderen. Het draait allemaal om één woord: risico-specifiek, de financiële impact van het fout hebben. Organisatiehiërarchieën weerspiegelen dit duidelijk:

- Operationele beslissingen (bijv. voorraad verzenden, advertentiekleuren aanpassen) brengen lage risico's en omkeerbare kosten met zich mee.

- Strategische beslissingen (bijv. een product lanceren, uitbreiden naar nieuwe markten) brengen hoge risico's, abstracte veronderstellingen en onvoorspelbare uitkomsten met zich mee.

Mensen volgen dezelfde op risico gebaseerde logica. Hoe abstracter en onzekerder de veronderstellingen achter een beslissing, hoe hoger de organisatorische rang die nodig is om de beslissing goed te keuren. De keuzes van een CEO (bijv. het voorspellen van marktverschuivingen of consumentengedrag) zijn gebaseerd op chaotische, dubbelzinnige data, terwijl de voorraadberekeningen van een manager gebaseerd zijn op concrete historische trends.

Dit vertalen naar AI: Het niveau van menselijke verantwoordelijkheid moet correleren met de abstractie van de data en de aannames achter de uitvoer van de AI. Bijvoorbeeld:

- Lage abstractie (bijv. vraagvoorspelling met behulp van verkoopgeschiedenis): Minimaal menselijk toezicht.

- Hoge abstractie (bijv. markttoegangsstrategieën met behulp van sentimentanalyse): Menselijk oordeel is niet onderhandelbaar.

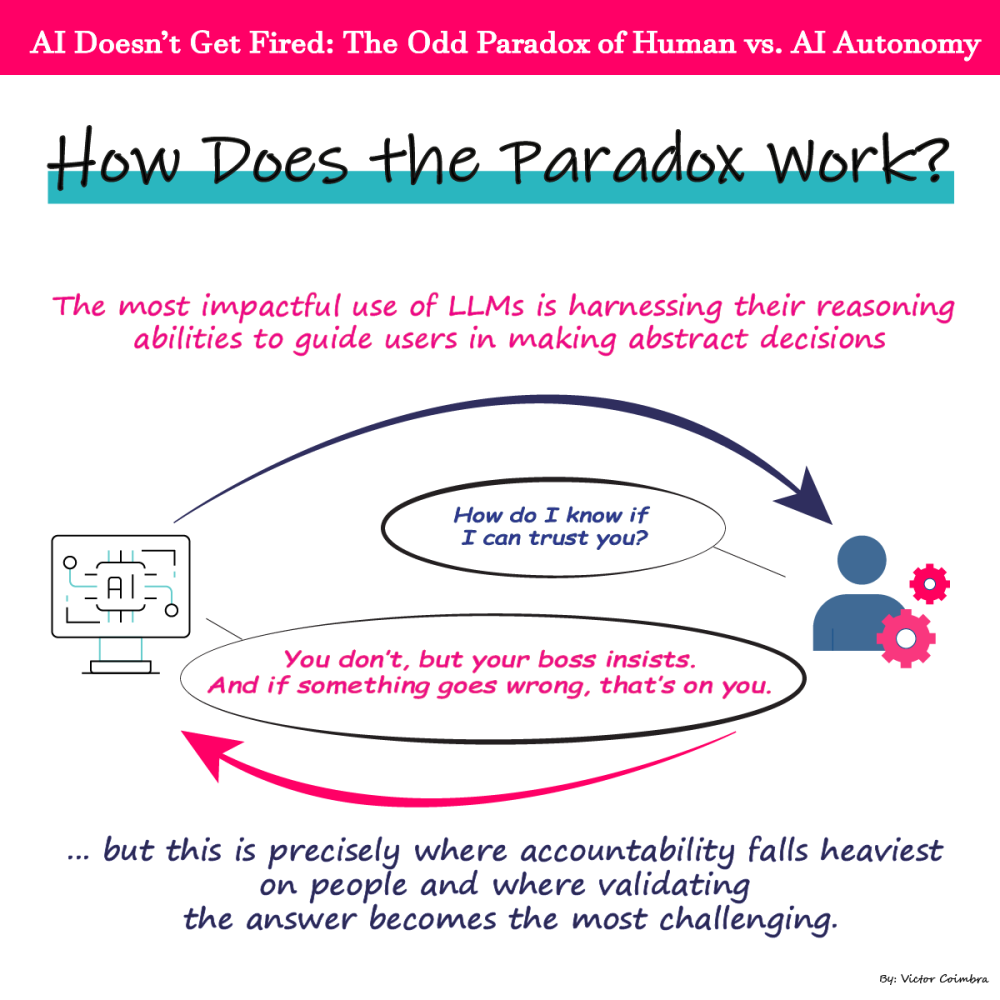

De dubbele paradox: De grootste kracht van AI - het omgaan met ambiguïteit - is ook haar grootste nadeel. De echte waarde van AI komt naar voren bij onzekere beslissingen waarbij veel op het spel staat en waarbij mensen enorme hoeveelheden data moeten verwerken. Maar paradoxaal genoeg is dit ook het moment waarop mensen het meest moeten vertrouwen op probabilistische redeneringen, zelfs als de verantwoordelijkheid het zwaarst op hen rust - wat een inherente spanning creëert:

- Aan de ene kant, AI blinkt uit in chaotische scenario's (bijv. het voorspellen van consumententrends in een volatiele markt) omdat het enorme datasets verwerkt die mensen niet kunnen verwerken.

- Aan de andere kant, De mens is als enige verantwoordelijk voor beslissingen in diezelfde scenario's, ook al is de data die hem aanstuurt inherent instabiel.

De unieke kracht van grote taalmodellen (LLM's) ligt in hun vermogen om redeneren simuleren-niet alleen taken automatiseren. Als u eenvoudige “als-dit-dan-dat” logica wilt, bestaan er goedkopere hulpmiddelen. LLM's doen het goed waar dubbelzinnigheid heerst: ze ontleden ongestructureerde data, leiden context af en genereren probabilistische paden die de menselijke intuïtie nabootsen.

Deze paradox dwingt ons tot een kritische vraag: Als mensen verantwoordelijk blijven, waarom zou u AI dan überhaupt gebruiken in risicovolle scenario's? Het antwoord ligt in het herdefiniëren van de rol van AI. Het gaat niet om het uitbesteden van beslissingen - het gaat om het krimpen van het onbekende. AI elimineert risico's niet; het geeft mensen een gestructureerde manier om chaos te onderzoeken.

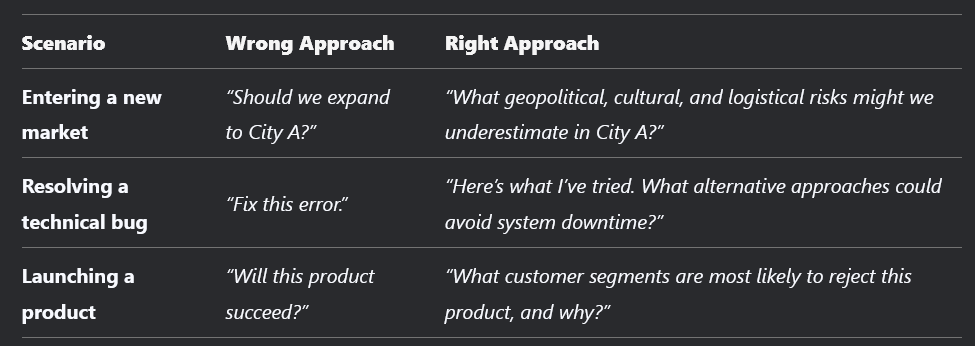

Hoe AI inzetten zonder de controle op te geven?

De sleutel is om AI te behandelen als een gezamenlijke uitdager, geen besluitvormer. Bijvoorbeeld:

Het patroon? AI gedijt als mensen het vragen veronderstellingen aanvechten, in plaats van ze te bevestigen. Dit verandert de manier van denken van “Wat is het antwoord?” naar “Wat missen we?”

De paradox is duidelijk: De waarde van AI groeit met ambiguïteit, maar menselijke verantwoordelijkheid ook. De sweet spot gaat niet over het in evenwicht brengen van autonomie, maar over het herdefiniëren van samenwerking. Gebruik AI om het mijnenveld van onzekerheid in kaart te brengen, maar laat mensen het pad kiezen.

Als bedrijven er niet in slagen om werknemers voor deze verschuiving op te leiden, zal de paradox escaleren. Teams zullen een hekel hebben aan de output van AI en twijfelen aan elk antwoord, terwijl ze de volledige verantwoordelijkheid dragen voor de resultaten. Organisaties zullen stagneren en tijd verspillen met debatteren over de vraag of ze AI moeten “vertrouwen” in plaats van het te gebruiken om sneller beslissingen te nemen. Erger nog, ze zullen achterop raken bij concurrenten die een eenvoudige waarheid omarmen: De vraag “Kunnen we AI vertrouwen?” is irrelevant en we zullen nooit echt weten of AI “goed” of “fout” is.”

De oplossing? Normaliseer AI als een hulpmiddel om risico's van probabilistische uitkomsten te onthullen:

- Nieuwsgierigheid en scenariosimulaties belonen, geen antwoorden die in steen gebeiteld zijn.

- Ontkoppel AI van schuld. Label de uitgangen als “invoer” (niet “advies”), waardoor mensen vrij zijn om kritiek te leveren zonder defensief te worden.

- Train voor probabilistisch denken. Leer werknemers om betrouwbaarheidsintervallen, scenariobereiken en vertekeningsvlaggen te interpreteren - niet alleen “ja/nee” uitkomsten.

Als AI-antwoorden niet gevalideerd worden, worden mensen ontslagen. Als mensen de probabilistische kracht van AI leren gebruiken, zetten bedrijven onzekerheid om in strategie.

BLOG

BLOG