如果你的老板问你一个关键数字,而你使用公司的 “超安全内部 GPT ”来检索信息,结果却不正确,这是谁的错?众所周知,答案是你没有验证输出结果。这就产生了一个悖论:公司在推动人工智能加速决策的同时,却将人工智能驱动结果的最终责任推给了人类。那么问题就来了:人工智能的自主性和人类的监督之间的最佳平衡点是什么?

一直以来,我们都将机器视为二进制工具--对或错(例如,计算器声称 1+1=3 会立即被认为是坏的)。. 但人工智能的运行基础是 概率, 这就像人类的推理一样。这就要求我们转变观念: 我们必须停止把人工智能的结果当作确定的答案,而应把它们当作对更广泛决策过程的投入。.

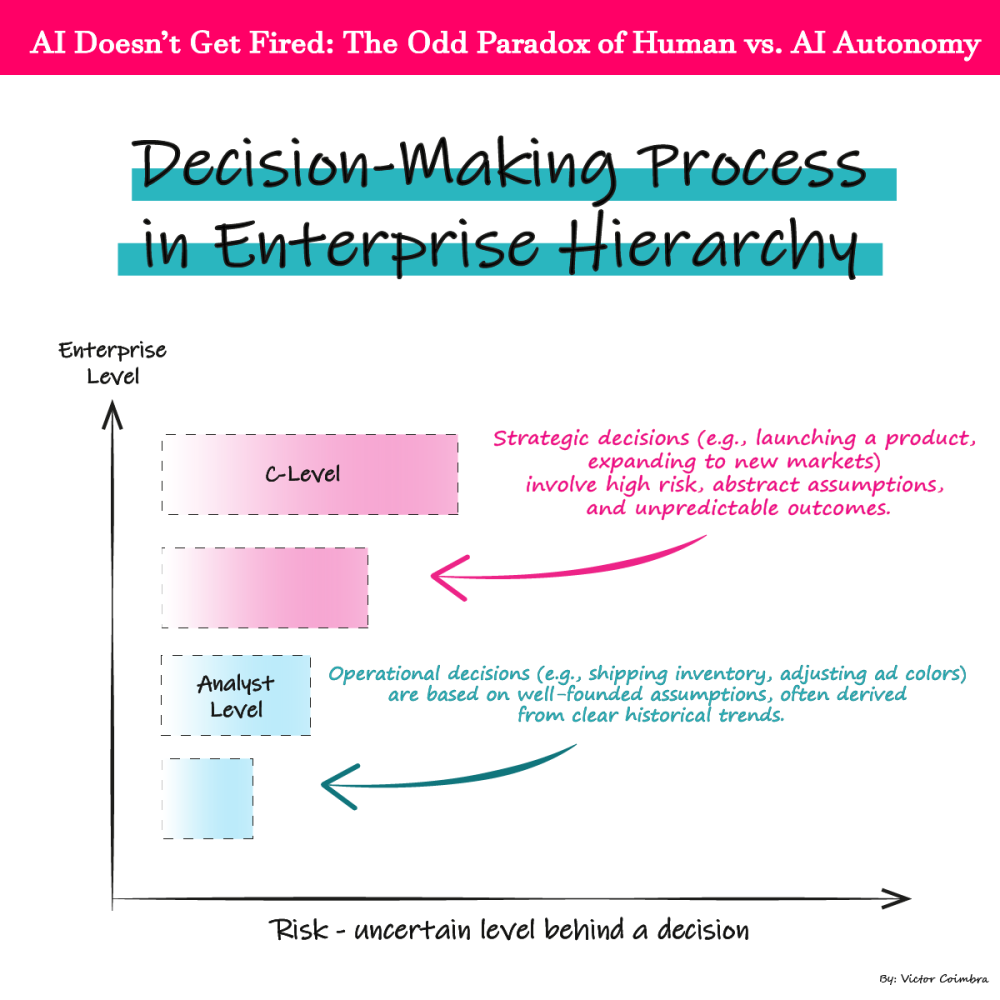

要完善这种平衡,我们需要剖析企业如何对待决策。这一切都取决于一个词: 风险-具体来说,就是错误的财务影响。组织等级制度清楚地反映了这一点:

- 业务决定 (例如,运送库存、调整广告颜色)风险低、成本可逆。.

- 战略决策 (例如,推出产品、拓展新市场)涉及高风险、抽象假设和不可预测的结果。.

人类也遵循同样的风险逻辑。决策背后的假设越抽象、越不确定,批准决策所需的组织级别就越高。首席执行官的选择(如预测市场变化或消费者行为)依赖于混乱、模糊的 data,而经理的库存计算则使用具体的历史趋势。.

将其转化为人工智能: 人的责任程度应与 data 的抽象程度和人工智能输出背后的假设相关联。例如

- 低抽象性 (例如,利用销售历史进行需求预测):尽量减少人为监督。.

- 高度抽象 (例如,利用情感分析制定市场进入战略):人的判断力是不容忽视的。.

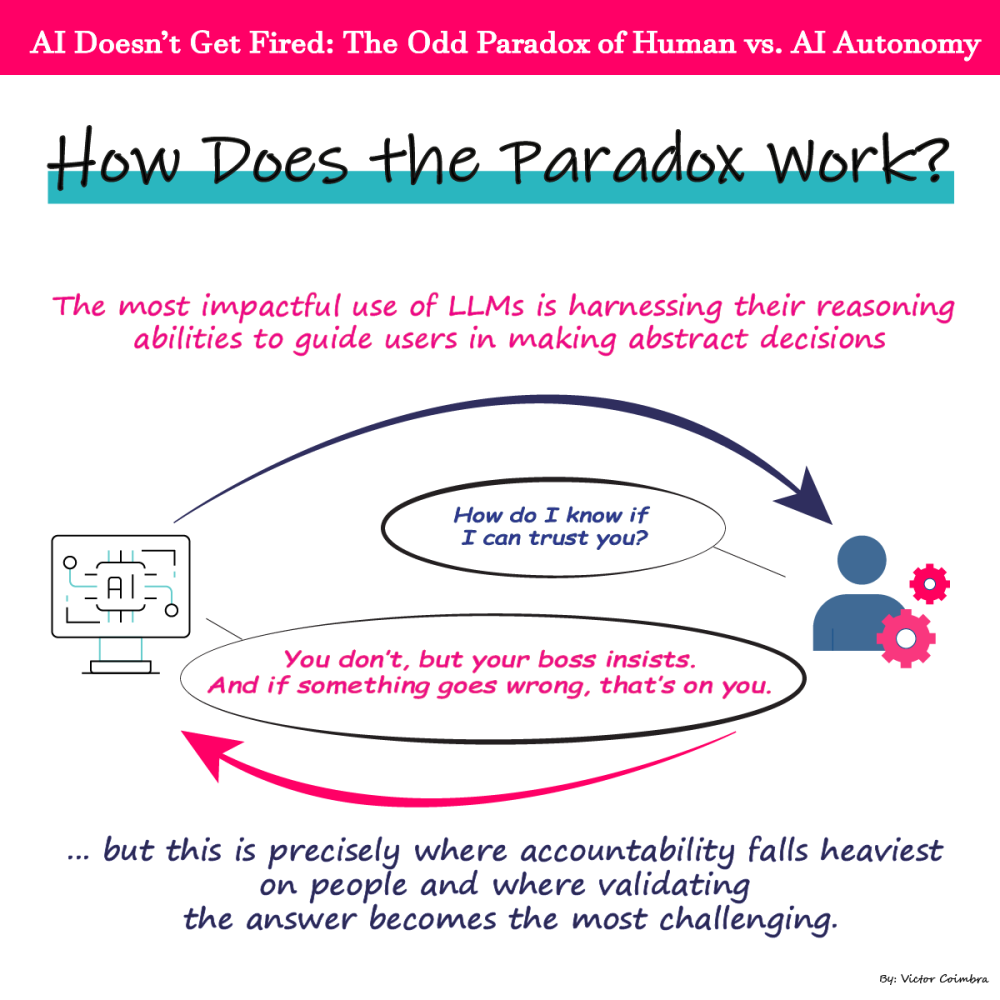

双重悖论 人工智能最大的优势--驾驭模糊性--也是其最大的缺陷。它的真正价值体现在人类必须处理大量 data 的高风险、不确定决策中。然而,矛盾的是,这也是人类必须最信任概率推理的地方,即使他们的责任最重--这就造成了内在的紧张关系:

- 一方面, 人工智能在混乱的场景中(如预测动荡市场中的消费趋势)表现出色,因为它能处理大量人类无法处理的问题。.

- 另一方面, 尽管驱动这些情景的 data 本身并不稳定,但人类仍要对这些情景中的决策负全责。.

大型语言模型(LLM)的独特力量 在于他们能够 模拟推理-而不仅仅是自动执行任务。如果你想要简单的 “如果-此-彼 ”逻辑,可以使用更便宜的工具。LLM 在模棱两可的情况下也能茁壮成长:它们能解析非结构化的 data,推断上下文,并生成模仿人类直觉的概率路径。.

这一悖论提出了一个关键问题: 如果人类仍然要承担责任,那为什么还要在高风险场景中使用人工智能呢? 答案在于重新定位人工智能的角色。这不是外包决策,而是 缩小未知. .人工智能并不能消除风险,它只是为人类提供了一种有条理的方法来审视混乱。.

如何在不放弃代理权的情况下利用人工智能?

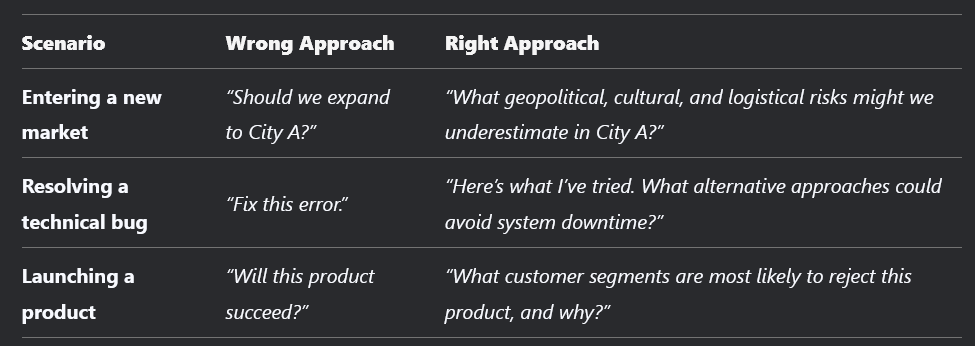

关键是要把人工智能当作 协作挑战者, 而不是决策者。例如

模式? 人工智能在人类的要求下茁壮成长 挑战假设, 而不是确认它们。这就将思维方式从 “答案是什么?” 至 “我们错过了什么?”

悖论显而易见: 人工智能的价值随着模糊性的增加而增加,但人类的责任也是如此. .甜蜜点不在于平衡自主性,而在于重新定义协作。利用人工智能绘制不确定因素的雷区图,但让人类来选择路径。.

如果企业不能对员工进行培训,以适应这种转变,矛盾就会升级. .团队会反感人工智能的产出,怀疑每一个答案,同时对结果承担全部责任。企业将停滞不前,浪费时间争论是否 “信任 ”人工智能,而不是利用它来加速决策。更糟糕的是,它们将落后于那些接受简单真理的竞争对手: “我们能信任人工智能吗?”这个问题无关紧要,人工智能不负责任,我们永远无法真正知道它是 “对 ”还是 “错”。”

解决方案是什么?将人工智能规范化,使其成为揭示概率结果的风险工具:

- 奖励好奇心和情景模拟, 而不是刻在石头上的答案。.

- 让人工智能与责任脱钩. .将其输出标为 “输入” (不是 “建议”),让人类可以毫无防备地进行批评。.

- 训练概率思维. .教会员工解释置信区间、情景范围和偏差标志,而不仅仅是 “是/否 ”输出。.

当人工智能的答案未经验证时,人类就会被解雇。当人类学会利用人工智能的概率能力时,公司就能将不确定性转化为战略。.

博客

博客