Wenn Ihr Chef Sie um eine wichtige Zahl bittet und Sie das “Ultra Secure Internal GPT” Ihres Unternehmens verwenden, um die Informationen abzurufen - nur um dann festzustellen, dass das Ergebnis falsch ist - wessen Schuld ist das? Wie wir alle wissen, sind Sie schuld, weil Sie es versäumt haben, die Ausgabe zu validieren. Daraus ergibt sich ein Paradoxon: Während Unternehmen die KI vorantreiben, um die Entscheidungsfindung zu beschleunigen, übertragen sie die Verantwortung für die KI-gesteuerten Ergebnisse letztlich auf den Menschen. Es stellt sich also die Frage: Was ist der goldene Mittelweg zwischen KI-Autonomie und menschlicher Kontrolle?

In der Vergangenheit haben wir Maschinen als binäre Werkzeuge betrachtet - richtig oder falsch (z.B. würde ein Taschenrechner, der 1+1=3 behauptet, sofort als kaputt gelten). Aber KI arbeitet mit Wahrscheinlichkeiten, ähnlich wie das menschliche Denken. Dies erfordert eine Änderung der Denkweise: müssen wir aufhören, die Ergebnisse der KI als endgültige Antworten zu betrachten, sondern sie als Input für einen umfassenderen Entscheidungsprozess ansehen.

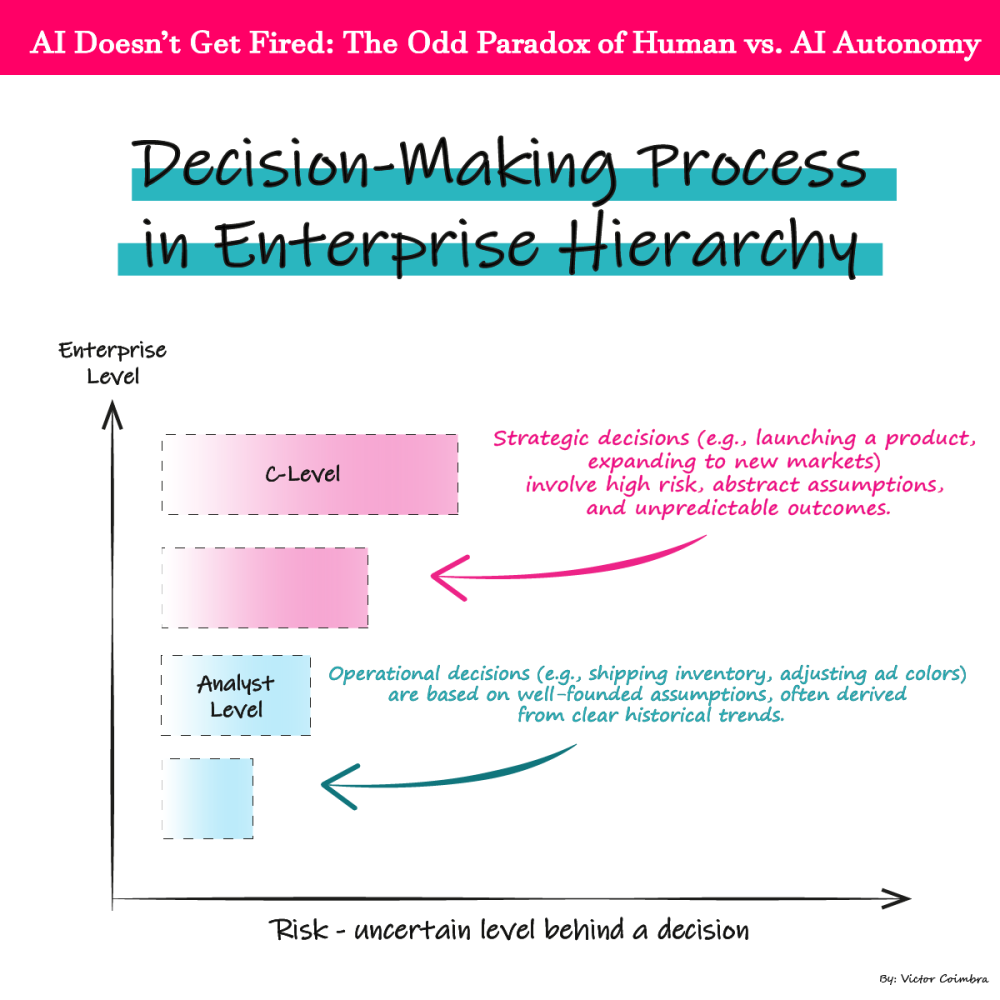

Um dieses Gleichgewicht zu verfeinern, müssen wir analysieren, wie Unternehmen an Entscheidungen herangehen. Es hängt alles von einem Wort ab: Risiko-insbesondere die finanziellen Auswirkungen eines Fehlverhaltens. Organisatorische Hierarchien spiegeln dies deutlich wider:

- Operative Entscheidungen (z.B. Versand von Inventar, Anpassung von Anzeigenfarben) sind mit geringen Risiken und reversiblen Kosten verbunden.

- Strategische Entscheidungen (z.B. Markteinführung eines Produkts, Expansion in neue Märkte) sind mit hohen Risiken, abstrakten Annahmen und unvorhersehbaren Ergebnissen verbunden.

Menschen folgen der gleichen risikobasierten Logik. Je abstrakter und unsicherer die Annahmen sind, die einer Entscheidung zugrunde liegen, desto höher ist der organisatorische Rang, der für die Genehmigung der Entscheidung erforderlich ist. Die Entscheidungen eines CEO (z.B. die Vorhersage von Marktveränderungen oder des Verbraucherverhaltens) beruhen auf chaotischen, mehrdeutigen data, während die Bestandsberechnungen eines Managers auf konkreten historischen Trends basieren.

Übertragen Sie dies auf KI: Der Grad der menschlichen Verantwortlichkeit sollte mit der Abstraktion des data und den Annahmen hinter der KI-Ausgabe korrelieren. Zum Beispiel:

- Niedrige Abstraktion (z.B. Nachfrageprognose anhand der Verkaufshistorie): Minimale menschliche Aufsicht.

- Hohe Abstraktion (z.B. Markteintrittsstrategien mit Hilfe von Stimmungsanalysen): Das menschliche Urteilsvermögen ist nicht verhandelbar.

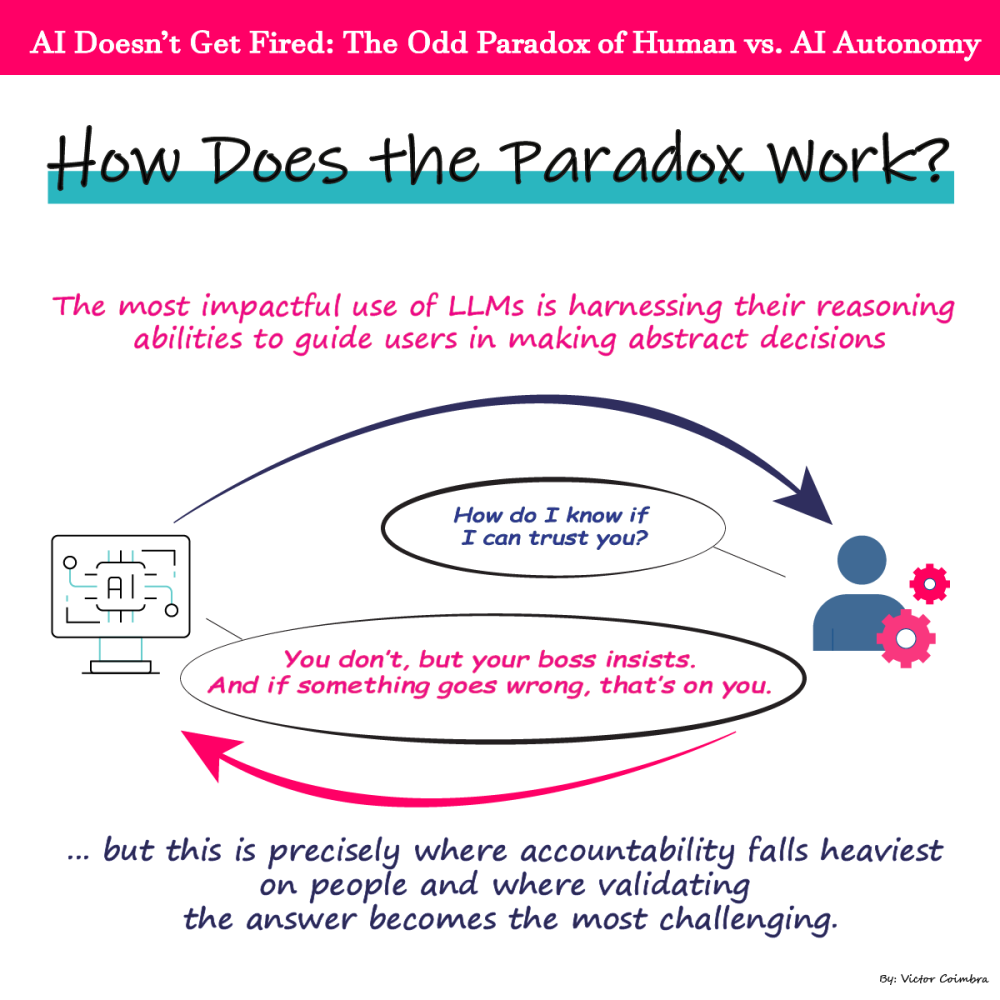

Das doppelte Paradoxon: Die größte Stärke der KI - die Bewältigung von Mehrdeutigkeiten - ist auch ihre größte Belastung. Ihr wahrer Wert zeigt sich bei wichtigen, unsicheren Entscheidungen, bei denen Menschen riesige Mengen von data verarbeiten müssen. Doch paradoxerweise ist dies auch der Bereich, in dem der Mensch am meisten auf probabilistisches Denken vertrauen muss, auch wenn die Verantwortung am stärksten auf ihm lastet - was zu einer inhärenten Spannung führt:

- Einerseits, In chaotischen Szenarien (z.B. bei der Vorhersage von Verbrauchertrends in einem volatilen Markt) ist KI hervorragend, weil sie enorme 1TP41Sätze verarbeitet, die Menschen nicht verarbeiten können.

- Auf der anderen Seite, tragen Menschen die alleinige Verantwortung für Entscheidungen in denselben Szenarien, auch wenn der data, der sie antreibt, von Natur aus instabil ist.

Die einzigartige Leistungsfähigkeit von Large Language Models (LLMs) liegt in ihrer Fähigkeit Argumentation simulieren-nicht nur Aufgaben zu automatisieren. Wenn Sie eine einfache “Wenn-das-dann-das”-Logik wünschen, gibt es billigere Tools. LLMs gedeihen dort, wo Mehrdeutigkeit herrscht: Sie analysieren unstrukturierte data, schließen auf den Kontext und erzeugen probabilistische Pfade, die die menschliche Intuition nachahmen.

Dieses Paradoxon zwingt zu einer kritischen Frage: Wenn der Mensch verantwortlich bleibt, warum dann überhaupt KI in Hochrisikoszenarien einsetzen? Die Antwort liegt in der Neuausrichtung der Rolle der KI. Es geht nicht darum, Entscheidungen auszulagern - es geht um Schrumpfung des Unbekannten. KI eliminiert das Risiko nicht, sondern gibt dem Menschen eine strukturierte Möglichkeit, das Chaos zu durchschauen.

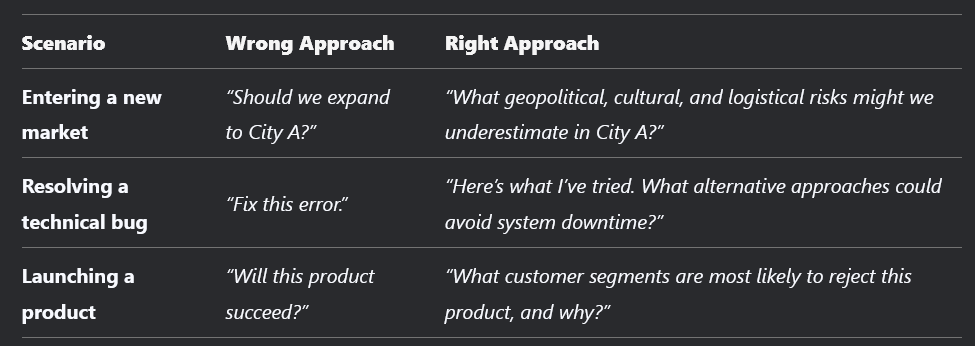

Wie kann man die KI nutzen, ohne die Verantwortung abzugeben?

Der Schlüssel dazu ist, KI als eine kollaborativer Herausforderer, nicht ein Entscheidungsträger. Zum Beispiel:

Das Muster? KI gedeiht, wenn Menschen sie darum bitten Annahmen in Frage stellen, und nicht bestätigen. Dies ändert die Denkweise von “Wie lautet die Antwort?” zu “Was verpassen wir?”

Das Paradoxon ist klar: Der Wert von KI wächst mit der Mehrdeutigkeit, aber auch mit der menschlichen Verantwortlichkeit. Es geht nicht darum, die Autonomie auszubalancieren, sondern darum, die Zusammenarbeit neu zu definieren. Nutzen Sie KI, um das Minenfeld der Ungewissheit zu kartieren, aber lassen Sie den Menschen den Weg wählen.

Wenn Unternehmen es versäumen, ihre Mitarbeiter für diesen Wandel zu schulen, wird das Paradoxon eskalieren. Die Teams werden sich über die Ergebnisse der KI ärgern, jede Antwort anzweifeln und gleichzeitig die volle Verantwortung für die Ergebnisse tragen. Unternehmen werden stagnieren und Zeit damit verschwenden, darüber zu debattieren, ob sie der KI “vertrauen” sollen, anstatt sie zu nutzen, um Entscheidungen zu beschleunigen. Schlimmer noch, sie werden hinter die Konkurrenten zurückfallen, die sich eine einfache Wahrheit zu eigen gemacht haben: Die Frage “Können wir KI vertrauen?” ist irrelevant - KI ist nicht rechenschaftspflichtig und wir werden nie wirklich wissen, ob sie “richtig” oder “falsch” ist.”

Die Lösung? Normalisieren Sie die KI als ein Instrument zur Aufdeckung von Risiken und probabilistischen Ergebnissen:

- Belohnen Sie Neugierde und Szenario-Simulationen, keine in Stein gemeißelten Antworten.

- Entkoppeln Sie KI von Schuldzuweisungen. Beschriften Sie die Ausgaben als “Eingabe” (nicht “Beratung”), was den Menschen die Freiheit gibt, ohne Abwehrhaltung zu kritisieren.

- Trainieren Sie probabilistisches Denken. Bringen Sie Ihren Mitarbeitern bei, Konfidenzintervalle, Szenario-Bereiche und Bias-Flags zu interpretieren - und nicht nur “Ja/Nein”-Ausgaben.

Wenn KI-Antworten nicht validiert werden, werden Menschen entlassen. Wenn Menschen lernen, die probabilistische Kraft der KI zu nutzen, verwandeln Unternehmen Unsicherheit in Strategie.

BLOG

BLOG