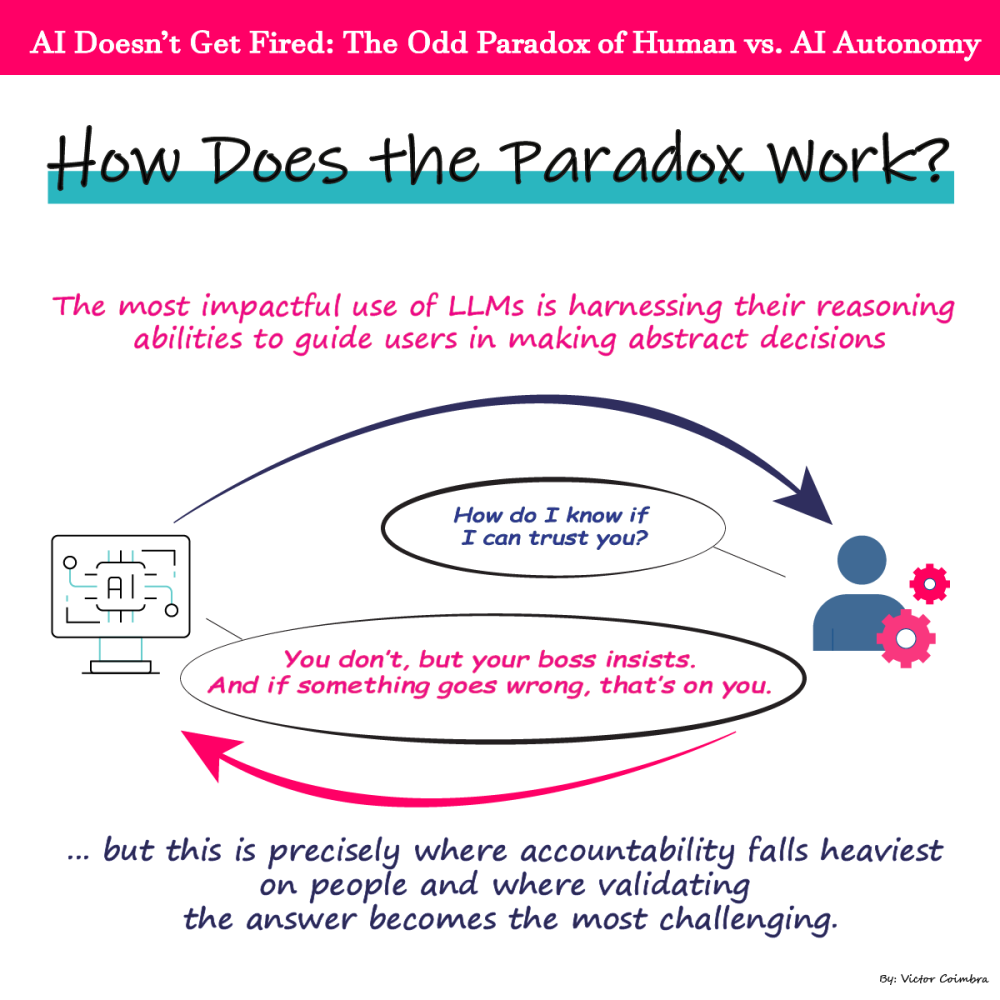

Si votre patron vous demande un chiffre important et que vous utilisez le “GPT interne ultra sécurisé” de votre entreprise pour récupérer l'information - mais que le résultat est incorrect - à qui la faute ? La réponse, comme nous le savons tous, est la vôtre, car vous n'avez pas validé le résultat. Cela crée un paradoxe : alors que les entreprises poussent l'IA à accélérer la prise de décision, elles placent la responsabilité finale des résultats de l'IA sur les humains. La question qui se pose alors est la suivante : Quel est le juste milieu entre l'autonomie de l'IA et la supervision humaine ?

Historiquement, nous avons toujours considéré les machines comme des outils binaires - justes ou faux (par exemple, une calculatrice affirmant que 1+1=3 serait immédiatement considérée comme cassée). Mais l'IA fonctionne sur probabilités, comme dans le cas du raisonnement humain. Cela exige un changement d'état d'esprit : nous devons cesser de considérer les résultats de l'IA comme des réponses définitives et commencer à les considérer comme des éléments d'un processus décisionnel plus large.

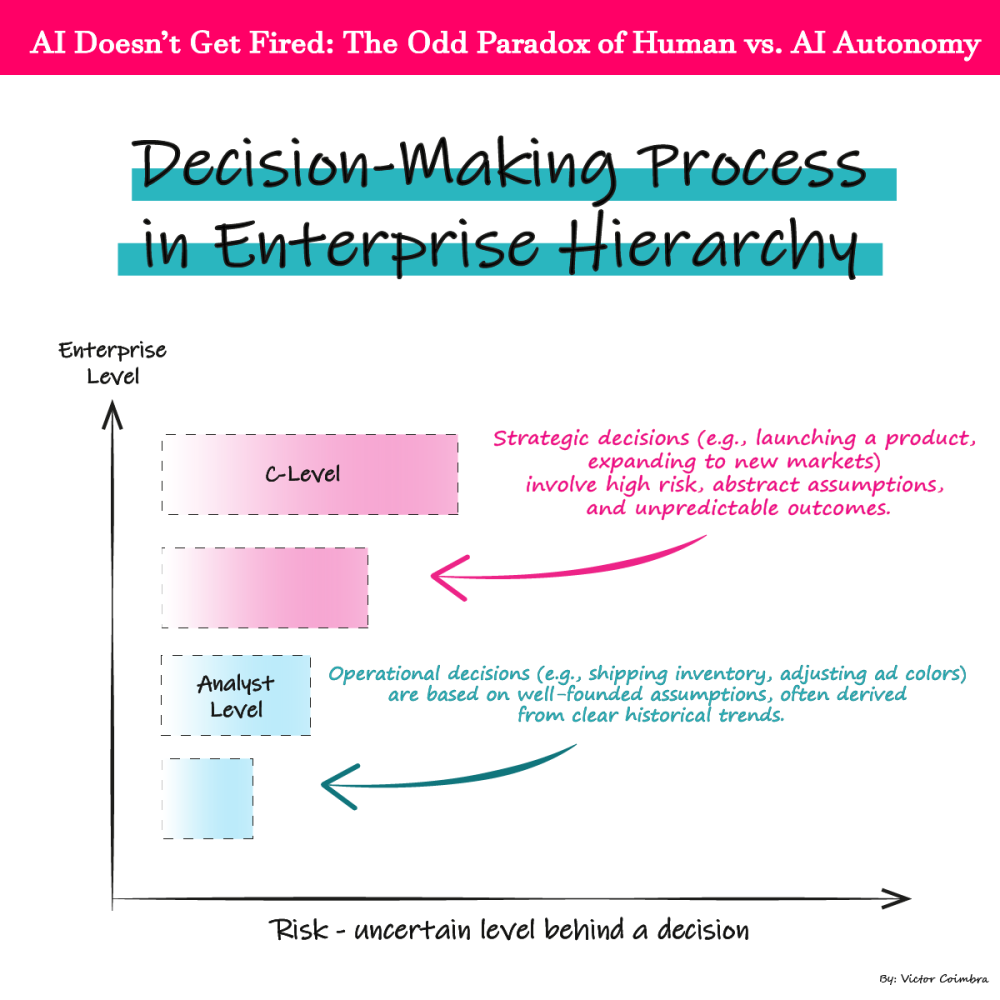

Pour affiner cet équilibre, nous devons analyser la manière dont les entreprises abordent les décisions. Tout repose sur un mot : risque-En particulier, l'impact financier d'une erreur. Les hiérarchies organisationnelles reflètent clairement cet état de fait :

- Décisions opérationnelles (par exemple, l'expédition des stocks, l'ajustement des couleurs des publicités) comportent peu de risques et des coûts réversibles.

- Décisions stratégiques (par exemple, le lancement d'un produit, l'expansion sur de nouveaux marchés) impliquent un risque élevé, des hypothèses abstraites et des résultats imprévisibles.

Les humains suivent la même logique basée sur le risque. Plus les hypothèses qui sous-tendent une décision sont abstraites et incertaines, plus le rang organisationnel requis pour l'approuver est élevé. Les choix d'un PDG (par exemple, prédire l'évolution du marché ou le comportement des consommateurs) reposent sur des data chaotiques et ambiguës, tandis que les calculs d'inventaire d'un gestionnaire s'appuient sur des tendances historiques concrètes.

Traduire cela à l'IA : Le niveau de responsabilité humaine doit correspondre à l'abstraction de la data et aux hypothèses qui sous-tendent les résultats de l'IA. A titre d'exemple :

- Faible abstraction (par exemple, prévision de la demande à partir de l'historique des ventes) : Supervision humaine minimale.

- Haut niveau d'abstraction (par exemple, les stratégies d'entrée sur le marché utilisant l'analyse des sentiments) : Le jugement humain n'est pas négociable.

Le double paradoxe : La plus grande force de l'IA - naviguer dans l'ambiguïté - est aussi son plus grand handicap. Sa véritable valeur apparaît dans les décisions incertaines et à fort enjeu où les humains doivent traiter de grandes quantités de data. Pourtant, paradoxalement, c'est aussi là que les humains doivent faire le plus confiance au raisonnement probabiliste, même si c'est sur eux que repose le plus la responsabilité, ce qui crée une tension inhérente :

- D'une part, L'IA excelle dans les scénarios chaotiques (par exemple, prédire les tendances de consommation dans un marché volatile) parce qu'elle traite de vastes 1TP41Sets que les humains ne peuvent pas traiter.

- D'autre part, L'homme est le seul responsable des décisions prises dans ces mêmes scénarios, même si le data qui les anime est intrinsèquement instable.

La puissance unique des grands modèles linguistiques (LLM) réside dans leur capacité à simuler le raisonnement-et pas seulement automatiser des tâches. Si vous voulez une simple logique du type “si ceci, si cela”, il existe des outils moins coûteux. Les LLM s'épanouissent là où règne l'ambiguïté : ils analysent les données non structurées data, déduisent le contexte et génèrent des voies probabilistes qui imitent l'intuition humaine.

Ce paradoxe soulève une question cruciale : Si les humains restent responsables, pourquoi utiliser l'IA dans des scénarios à haut risque ? La réponse consiste à recadrer le rôle de l'IA. Il ne s'agit pas d'externaliser les décisions, mais d'en faire un outil d'aide à la décision. réduire l'inconnu. L'IA n'élimine pas le risque ; elle donne aux humains un moyen structuré d'interroger le chaos.

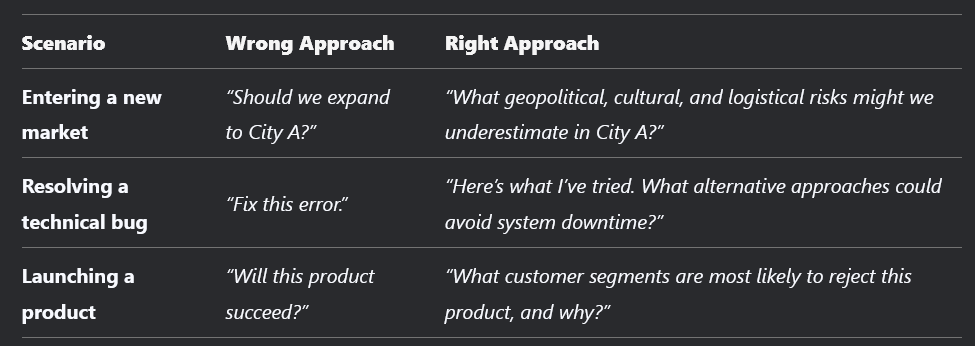

Comment tirer parti de l'IA sans renoncer à l'agence ?

L'essentiel est de traiter l'IA comme un challenger collaboratif, et non un décideur. Par exemple :

Le modèle ? L'IA s'épanouit lorsque les humains lui demandent de le faire remettre en question les hypothèses, et non les confirmer. L'état d'esprit passe ainsi de “Quelle est la réponse ?” à “Qu'est-ce qu'on rate ?”

Le paradoxe est clair : La valeur de l'IA croît avec l'ambiguïté, mais il en va de même pour la responsabilité humaine. Il ne s'agit pas d'équilibrer l'autonomie, mais de redéfinir la collaboration. Utilisez l'IA pour cartographier le champ de mines de l'incertitude, mais laissez les humains choisir le chemin.

Si les entreprises ne forment pas leurs employés à ce changement, le paradoxe s'accentuera. Les équipes n'apprécieront pas les résultats de l'IA, doutant de chaque réponse tout en assumant l'entière responsabilité des résultats. Les organisations stagneront, perdant du temps à débattre de la question de savoir s'il faut “faire confiance” à l'IA au lieu de l'exploiter pour accélérer les décisions. Pire encore, elles se laisseront distancer par des concurrents qui ont adopté une vérité simple : La question de savoir si l'on peut faire confiance à l'IA n'est pas pertinente : l'IA n'est pas responsable et nous ne saurons jamais vraiment si elle est “bonne” ou “mauvaise”.“

La solution ? Normaliser l'IA en tant qu'outil de révélation des risques et des résultats probabilistes :

- Récompenser la curiosité et les simulations de scénarios, Il ne s'agit pas de réponses gravées dans la pierre.

- Découpler l'IA de la responsabilité. Étiqueter ses sorties comme suit “entrée” (pas “conseil”), ce qui permet à l'homme de critiquer sans se défendre.

- S'entraîner à la pensée probabiliste. Apprenez à vos employés à interpréter les intervalles de confiance, les fourchettes de scénarios et les indicateurs de biais, et pas seulement les résultats “oui/non”.

Lorsque les réponses de l'IA ne sont pas validées, les humains sont licenciés. Lorsque les humains apprennent à manier le pouvoir probabiliste de l'IA, les entreprises transforment l'incertitude en stratégie.

BLOG

BLOG