Si su jefe le pide una cifra crítica, y usted utiliza la “GPT interna ultrasegura” de su empresa para recuperar la información -sólo para que el resultado sea incorrecto- ¿de quién es la culpa? La respuesta, como todos sabemos, es suya por no haber validado el resultado. Esto crea una paradoja: mientras las empresas impulsan la IA para acelerar la toma de decisiones, hacen recaer en los humanos la responsabilidad última de los resultados impulsados por la IA. La cuestión se convierte entonces en: ¿Cuál es el punto óptimo entre la autonomía de la IA y la supervisión humana?

Históricamente, hemos considerado las máquinas como herramientas binarias: correctas o incorrectas (por ejemplo, una calculadora que dijera que 1+1=3 se consideraría inmediatamente averiada). Pero la IA opera sobre probabilidades, muy parecido al razonamiento humano. Esto exige un cambio de mentalidad: debemos dejar de tratar los resultados de la IA como respuestas definitivas y empezar a tratarlos como aportaciones a un proceso de toma de decisiones más amplio.

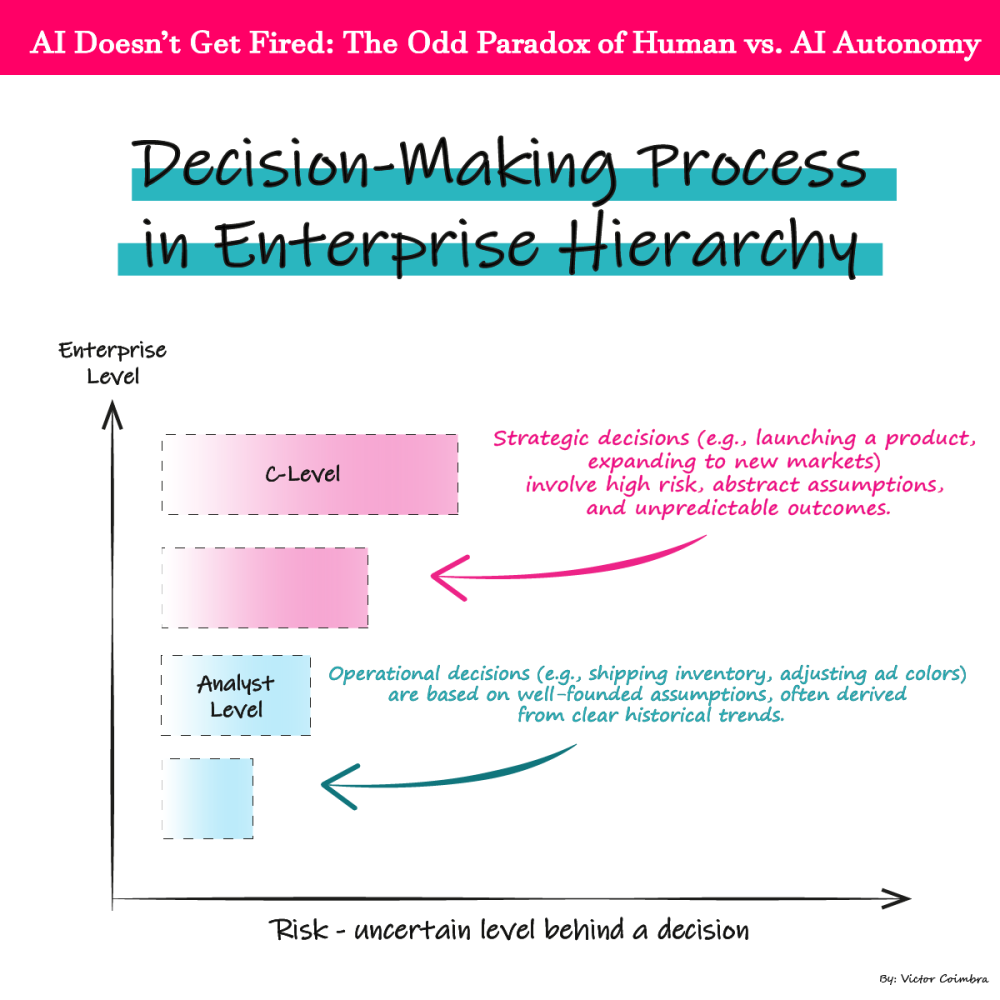

Para afinar este equilibrio, tenemos que diseccionar la forma en que las empresas enfocan las decisiones. Todo gira en torno a una palabra: riesgo-específicamente, el impacto financiero de equivocarse. Las jerarquías organizativas lo reflejan claramente:

- Decisiones operacionales (por ejemplo, enviar el inventario, ajustar los colores de los anuncios) conllevan un bajo riesgo y costes reversibles.

- Decisiones estratégicas (por ejemplo, el lanzamiento de un producto, la expansión a nuevos mercados) implican un alto riesgo, suposiciones abstractas y resultados impredecibles.

Los seres humanos siguen la misma lógica basada en el riesgo. Cuanto más abstractos e inciertos sean los supuestos que subyacen a una decisión, mayor será el rango organizativo necesario para aprobarla. Las decisiones de un director general (por ejemplo, predecir los cambios del mercado o el comportamiento de los consumidores) se basan en data caóticas y ambiguas, mientras que los cálculos de inventario de un gestor utilizan tendencias históricas concretas.

Traduciendo esto a la IA: El nivel de responsabilidad humana debe correlacionarse con la abstracción del data y las suposiciones que subyacen a la salida de la IA. Por ejemplo:

- Baja abstracción (por ejemplo, previsión de la demanda utilizando el historial de ventas): Supervisión humana mínima.

- Alta abstracción (por ejemplo, estrategias de entrada en el mercado utilizando el análisis de sentimientos): El juicio humano no es negociable.

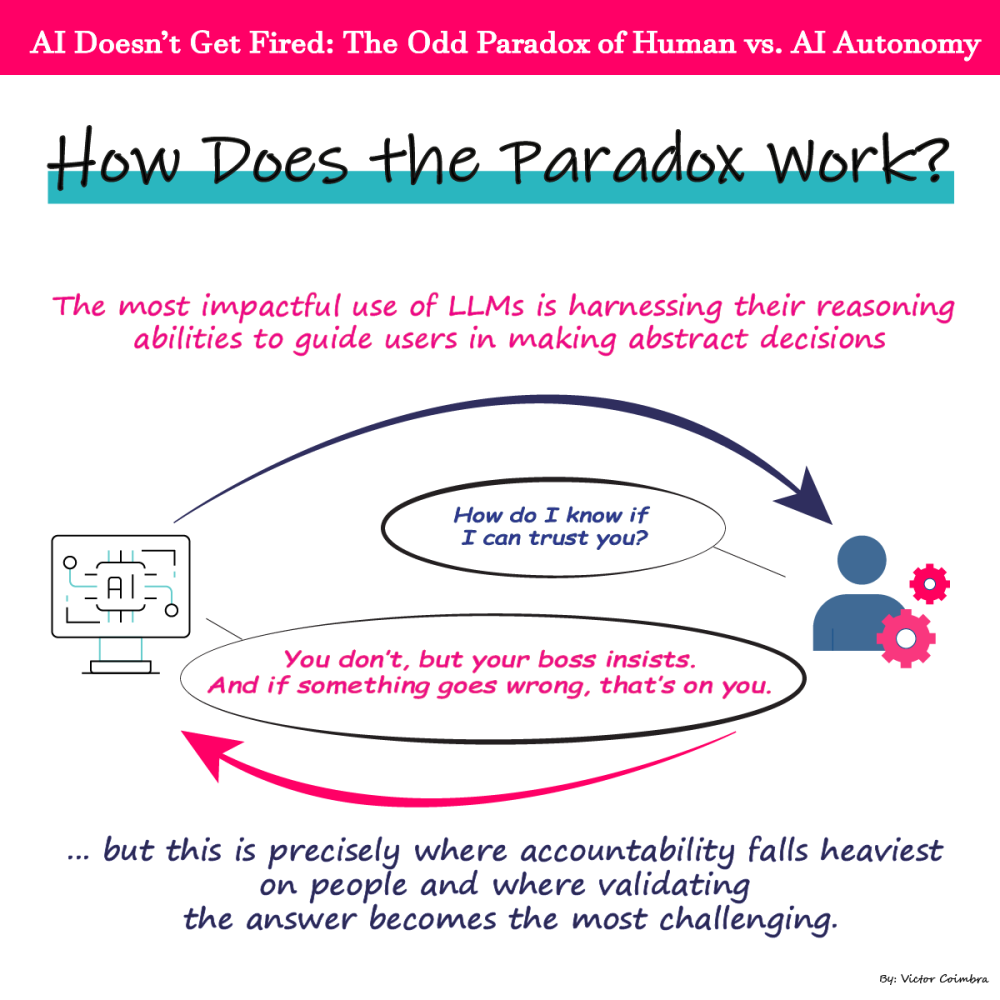

La doble paradoja: La mayor fortaleza de la IA -navegar la ambigüedad- es también su mayor responsabilidad. Su verdadero valor emerge en las decisiones inciertas y de alto riesgo en las que los humanos deben procesar grandes cantidades de data. Sin embargo, paradójicamente, también es aquí donde los humanos deben confiar más en el razonamiento probabilístico, incluso cuando la responsabilidad recae más sobre ellos, lo que crea una tensión inherente:

- Por un lado, la IA destaca en escenarios caóticos (por ejemplo, la predicción de las tendencias de consumo en un mercado volátil) porque procesa enormes datasets que los humanos no pueden.

- Por otra parte, los seres humanos son los únicos responsables de las decisiones en esos mismos escenarios, a pesar de que el data que los impulsa es inherentemente inestable.

El poder único de los grandes modelos lingüísticos (LLM) radica en su capacidad para simular el razonamiento-no sólo automatizar tareas. Si desea una lógica simple del tipo “si-esto-entonces-eso”, existen herramientas más baratas. Los LLM prosperan allí donde reina la ambigüedad: analizan el data no estructurado, infieren el contexto y generan vías probabilísticas que imitan la intuición humana.

Esta paradoja obliga a plantearse una pregunta crítica: Si los humanos siguen siendo responsables, ¿por qué utilizar la IA en escenarios de alto riesgo? La respuesta está en replantear el papel de la IA. No se trata de externalizar las decisiones, sino de reducir lo desconocido. La IA no elimina el riesgo; proporciona a los humanos una forma estructurada de interrogar al caos.

¿Cómo aprovechar la IA sin renunciar a la agencia?

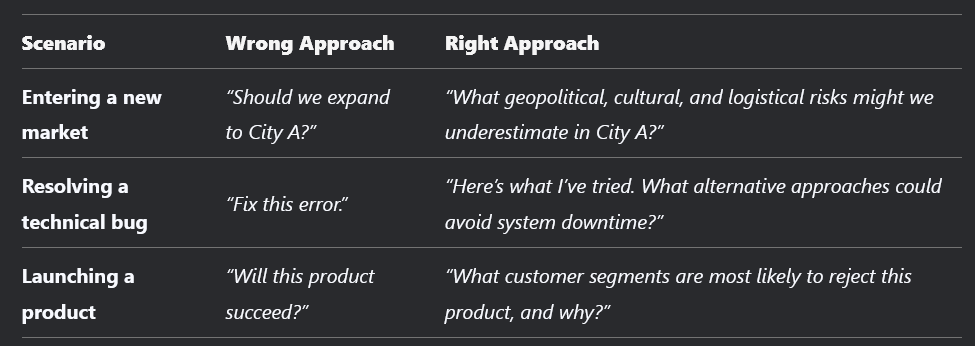

La clave está en tratar la IA como un retador colaborador, no un responsable de la toma de decisiones. Por ejemplo:

¿El patrón? La IA prospera cuando los humanos se lo piden cuestionar los supuestos, no confirmarlas. Esto cambia la mentalidad de “¿Cuál es la respuesta?” a “¿Qué nos estamos perdiendo?”

La paradoja es evidente: El valor de la IA crece con la ambigüedad, pero también lo hace la responsabilidad humana. El punto dulce no consiste en equilibrar la autonomía, sino en redefinir la colaboración. Utilice la IA para trazar el mapa del campo de minas de la incertidumbre, pero deje que los humanos elijan el camino.

Si las empresas no forman a sus empleados para este cambio, la paradoja se agravará. Los equipos se resentirán de los resultados de la IA, dudando de cada respuesta mientras asumen toda la responsabilidad de los resultados. Las organizaciones se estancarán, perdiendo el tiempo debatiendo si “confiar” en la IA en lugar de aprovecharla para acelerar las decisiones. Peor aún, se quedarán rezagadas frente a los competidores que abracen una verdad sencilla: La pregunta “¿Podemos confiar en la IA?” es irrelevante: la IA no es responsable y nunca sabremos realmente si está “bien” o “mal”.”

¿La solución? Normalizar la IA como una herramienta de revelación de riesgos de resultados probabilísticos:

- Recompensar la curiosidad y las simulaciones de escenarios, no respuestas grabadas en piedra.

- Desvincular la IA de la culpa. Etiquete sus salidas como “entrada” (no “consejos”), liberando a los humanos para criticar sin ponerse a la defensiva.

- Entrenar para el pensamiento probabilístico. Enseñe a los empleados a interpretar los intervalos de confianza, los rangos de los escenarios y los indicadores de sesgo, no sólo los resultados “sí/no”.

Cuando las respuestas de la IA no son validadas, los humanos son despedidos. Cuando los humanos aprenden a manejar el poder probabilístico de la IA, las empresas convierten la incertidumbre en estrategia.

BLOG

BLOG