TL;DR

Este artigo apresenta o LLMOps, um ramo especializado que mescla DevOps e MLOps para Gerenciando os desafios apresentados pelos modelos de linguagem de grande porte (LLMs). Os LLMs, como o GPT do OpenAI, usam textos extensos para tarefas como geração de texto e tradução de idiomas. Os LLMOps lidam com questões como personalização, alterações de API, desvio de data, avaliação de modelos e monitoramento por meio de ferramentas como LangSmith, TruLens e W&B Prompts. Ele garante a adaptabilidade, a avaliação e o monitoramento dos LLMs em cenários do mundo real, oferecendo uma solução abrangente para as organizações que utilizam esses modelos avançados de linguagem.

Para guiá-lo nessa discussão, começaremos revisitando os princípios fundamentais de DevOps e MLOps e, em seguida, nos concentraremos no LLMOps, começando com uma breve introdução aos LLMs e sua utilização pelas organizações. Em seguida, vamos nos aprofundar nos principais desafios operacionais apresentados pela tecnologia de LLM e em como o LLMOps os enfrenta de forma eficaz.

Princípios básicos para LLMOps: DevOps e MLOps

DevOps, abreviação de Development and Operations (Desenvolvimento e Operações), é um conjunto de práticas que visa automatizar o processo de entrega de software, tornando-o mais eficiente, confiável e dimensionável. Os princípios fundamentais do DevOps incluem: colaboração, automação, teste contínuo, monitoramento e orquestração da implantação.

MLOps, abreviação de Machine Learning Operations (Operações de aprendizado de máquina), é uma extensão das práticas de DevOps especificamente adaptadas para o gerenciamento do ciclo de vida dos modelos de aprendizado de máquina. Ele aborda os desafios exclusivos apresentados pela natureza iterativa e experimental do desenvolvimento do aprendizado de máquina. Introduzindo tarefas adicionais como versionamento e gerenciamento de data, bem como experimentação e treinamento de modelos.

LLMOps: Gerenciando a implantação e a manutenção de modelos de idiomas grandes

LLMOps, abreviação de Large Language Model Operations (operações de modelos de linguagem grandes), é um ramo especializado de MLOps projetado especificamente para lidar com os desafios e requisitos exclusivos do gerenciamento de modelos de linguagem grandes (LLMs).

Mas, primeiro, o que são exatamente os LLMs?

Os LLMs são um tipo de modelo de aprendizagem profunda que usa grandes quantidades de texto data para estimar bilhões de parâmetros. Esses parâmetros permitem que os LLMs compreendam e gerem textos de qualidade humana, traduzam idiomas, resumam informações complexas e executem várias tarefas de processamento de linguagem natural.

Como as organizações usam os LLMs

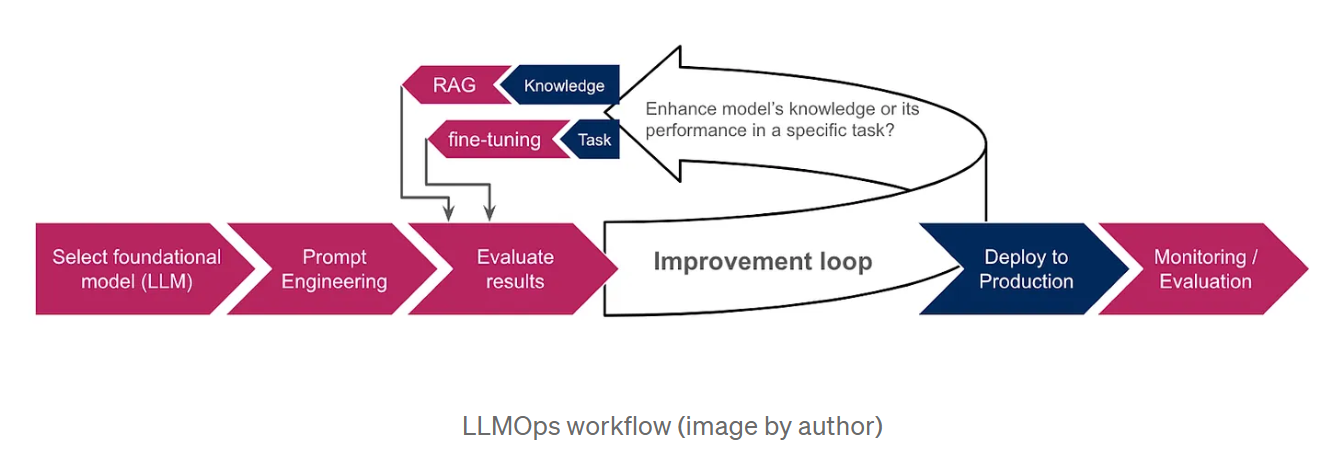

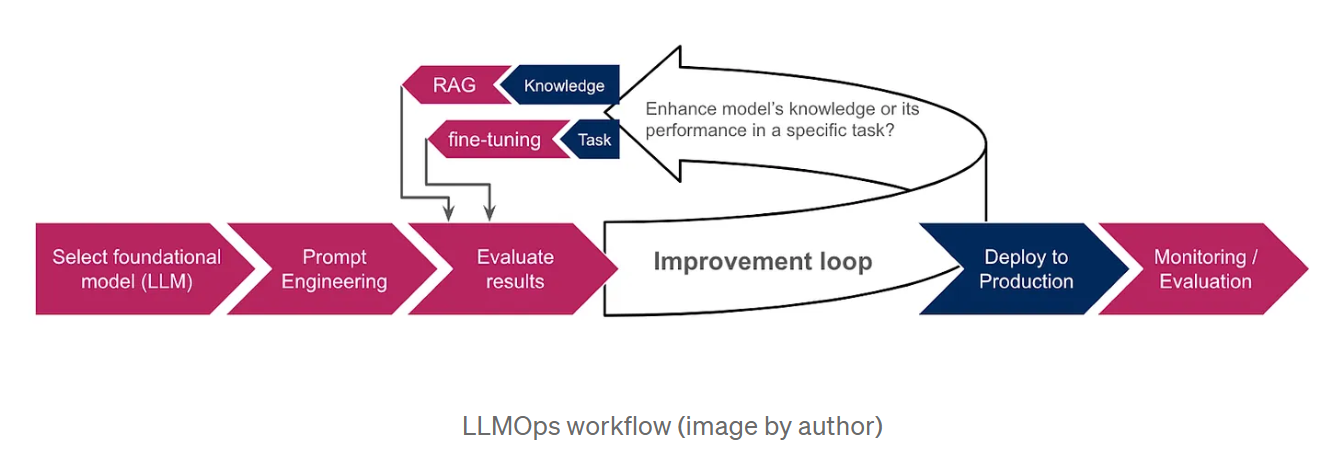

Como o treinamento de LLMs do zero é extremamente caro e demorado, as organizações optam por modelos básicos pré-treinados, como o GPT do OpenAI ou o LaMDA do Google AI, como ponto de partida. Esses modelos, por já terem sido treinados em grandes quantidades de data, possuem amplo conhecimento e podem executar várias tarefas, inclusive gerar texto, traduzir idiomas e escrever diferentes tipos de conteúdo criativo. Para personalizar ainda mais o resultado do LLM para tarefas ou domínios específicos, as organizações empregam técnicas como engenharia de prompts, geração aumentada por recuperação (RAG) e ajuste fino. A engenharia de prompts envolve a elaboração de instruções claras e concisas que orientam o LLM em direção ao resultado desejado, enquanto a RAG fundamenta o modelo em informações adicionais de fontes data externas, melhorando seu desempenho e relevância. O ajuste fino, por outro lado, envolve o ajuste dos parâmetros do LLM usando data adicionais específicos para as necessidades da organização. O esquema abaixo fornece uma visão geral do fluxo de trabalho do LLMOps, ilustrando como essas técnicas se integram ao processo geral.

Por que precisamos de LLMOps

Os rápidos avanços na tecnologia LLM trouxeram à tona vários desafios operacionais que exigem abordagens especializadas.

Alguns desses desafios incluem :

A necessidade de personalização: Embora os LLMs sejam pré-treinados em grandes quantidades de data, a personalização é essencial para o desempenho ideal em tarefas específicas. Isso levou ao desenvolvimento de novas técnicas de personalização, como engenharia imediata, geração aumentada por recuperação (RAG) e ajuste fino. O RAG ajuda a fundamentar o modelo nas informações mais precisas, fornecendo a ele uma base de conhecimento externa, enquanto o ajuste fino é mais adequado quando queremos que o modelo execute tarefas específicas ou adira a um formato de resposta específico, como JSON ou SQL. A escolha entre RAG e ajuste fino depende do objetivo de aprimorar o conhecimento do modelo ou melhorar seu desempenho em uma tarefa específica.

Alterações na API: Diferentemente dos modelos tradicionais de ML, os LLMs geralmente são acessados por meio de APIs de terceiros, que podem ser modificadas ou até mesmo obsoletas, exigindo monitoramento e adaptação contínuos. Por exemplo, Abrir a documentação do AI menciona explicitamente que seus modelos estão sujeitos a atualizações regulares, o que pode exigir que os usuários atualizem seu software ou migrem para modelos ou endpoints mais novos.

Desvio Data, refere-se a uma mudança nas propriedades estatísticas do data de entrada, que ocorre com frequência na produção quando o data encontrado se desvia do data com o qual os LLMs foram treinados. Isso pode levar à geração de informações imprecisas ou desatualizadas. Por exemplo, com o modelo GPT-3.5, suas informações foram limitadas até setembro de 2021, antes que o a data-limite foi prorrogada para janeiro de 2022. Consequentemente, não foi possível responder a perguntas sobre eventos mais recentes, o que levou à frustração do usuário.

Avaliação do modelo: No aprendizado de máquina tradicional, contamos com métricas como acurácia, precisão e recall para avaliar nossos modelos. No entanto, a avaliação de LLMs é muito mais complexa, especialmente na ausência de verdade terrestre data e ao lidar com resultados de linguagem natural em vez de valores numéricos.

Monitoramento: O monitoramento contínuo dos LLMs e dos aplicativos baseados em LLMs é fundamental. Também é mais complicado porque envolve vários aspectos que precisam ser considerados para garantir a eficácia e a confiabilidade gerais desses modelos de linguagem. Discutiremos esses aspectos em mais detalhes na próxima seção.

Como o LLMOps aborda esses desafios

O LLMOps se baseia nos fundamentos do MLOps e introduz componentes especializados adaptados aos LLMs:

Engenharia imediata e gerenciamento de ajustes finos: O LLMOps fornece ferramentas como sistemas de controle de versão imediatos para rastrear e gerenciar diferentes versões de prompts. Ele também se integra ao estruturas de ajuste fino para automatizar e otimizar o processo de ajuste fino. Um exemplo importante dessas ferramentas é o LangSmith, uma estrutura projetada especificamente para gerenciar fluxos de trabalho de LLM. Seus recursos abrangentes incluem controle de versão do prompt, permitindo a experimentação controlada e a reprodutibilidade. Além disso, o LangSmith facilita ajuste fino de LLMs usando runs'data após eventual filtragem e enriquecimento para melhorar o desempenho do modelo.

Gerenciamento de mudanças de API: O LLMOps estabelece processos para monitoramento Alterações na API, alertas operadores a possíveis interrupções, e ativação de reversões se necessário.

Adaptação do modelo às mudanças data: O LLMOps facilita a adaptação dos LLMs aos cenários data em evolução, garantindo que os modelos permaneçam relevantes e com bom desempenho à medida que os padrões data mudam. Isso pode ser alcançado por meio de monitoramento das distribuições do data e acionamento de processos de adaptação quando forem detectadas mudanças significativas. Esses processos podem incluir:

-> Retreinamento ou ajuste fino: Dependendo da extensão do desvio do data e dos recursos disponíveis, o retreinamento ou o ajuste fino podem ser empregados para atenuar seu impacto.

-> Adaptação do domínio: Ajuste fino do LLM em um dataset do domínio de destino.

-> Destilação do conhecimento: Treinamento de um modelo menor, aproveitando o conhecimento e a experiência de um modelo maior, mais avançado e atualizado.

Avaliação específica do LLM: O LLMOps emprega novas ferramentas de avaliação adaptadas aos LLMs. Essas ferramentas incluem:

-> Métricas baseadas em texto, O modelo de texto é um modelo de análise de texto, como a perplexidade, uma medida estatística de quão bem o modelo é capaz de prever a próxima palavra em uma sequência. Assim como as métricas BLEU e ROUGE, que comparam o texto gerado por máquina a um ou mais textos de referência gerados por humanos. Elas são comumente usadas para tarefas de tradução e resumo.

-> Análise de embeddings (representações vetoriais de palavras ou frases), para avaliar a capacidade do modelo de entender palavras específicas do contexto e capturar semelhanças semânticas. As técnicas de visualização e agrupamento também podem nos ajudar na detecção de viés.

-> LLMs avaliadores: Usar outros LLMs para avaliar nosso modelo. Por exemplo, isso pode ser feito atribuindo uma pontuação à saída do modelo avaliado com base em métricas predefinidas, como fluência, coerência, relevância e precisão factual.

-> Integração de feedback humano: O LLMOps incorpora mecanismos para coletar e incorporar o feedback humano no ciclo de vida do ML, melhorando o desempenho do LLM e abordando vieses.

TruLens é uma ferramenta que permite a integração dessas avaliações aos aplicativos do LLM por meio de uma abordagem programática conhecida como Feedback Functions.

Monitoramento específico do LLM: O LLMOps integra o monitoramento contínuo para rastrear as métricas de desempenho do LLM, identificar possíveis problemas e detectar desvios ou tendências de conceito. Isso inclui:

-> Monitoramento funcional; O senhor pode obter informações sobre o número de solicitações, o tempo de resposta, o uso de tokens, as taxas de erro e o custo.

-> Monitoramento imediato; para garantir a legibilidade e detectar toxicidade e outras formas de abuso. Prompts de W&B é um conjunto de ferramentas criadas para monitorar aplicativos baseados em LLM. Ele pode ser usado para analisar as entradas e saídas de seus LLMs, visualizar os resultados intermediários e armazenar e gerenciar com segurança seus prompts.

-> Monitoramento de respostas; O senhor deve ter em mente que o modelo deve ser usado para garantir a relevância e a consistência do modelo. Isso inclui evitar a geração de conteúdo alucinatório ou fictício, bem como garantir a exclusão de material nocivo ou inadequado. A transparência pode nos ajudar a entender melhor a resposta do modelo. Ela pode ser estabelecida revelando as fontes de resposta (no RAG) ou solicitando que o modelo justifique seu raciocínio (cadeia de pensamento).

Esse monitoramento data pode ser utilizado para aumentar a eficiência operacional. Podemos melhorar o gerenciamento de custos implementando alertas sobre o uso de tokens e empregando estratégias como o armazenamento em cache de respostas anteriores. Isso nos permite reutilizá-las para consultas semelhantes sem invocar o LLM novamente. Além disso, podemos minimizar a latência optando por modelos menores sempre que possível e restringindo o número de tokens gerados.

Conclusão

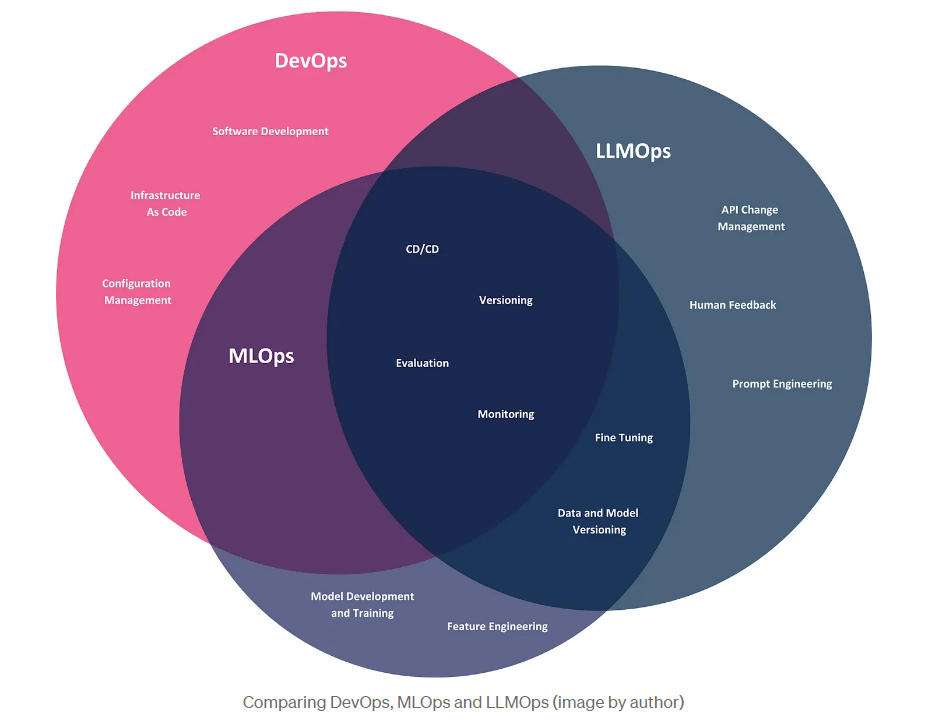

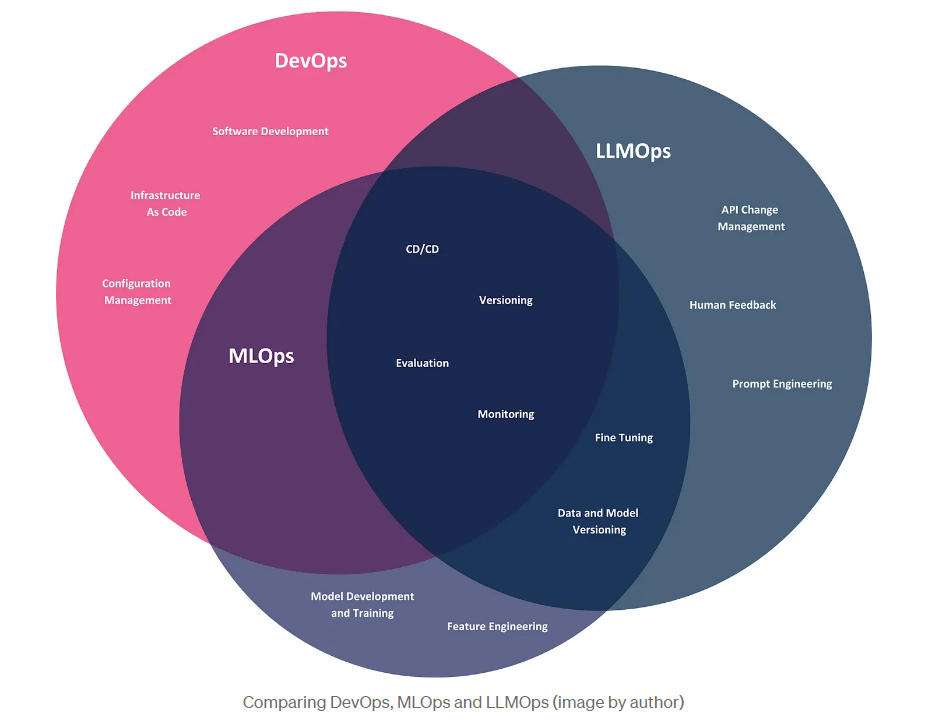

Neste artigo, exploramos o surgimento do LLMOps, um descendente do DevOps e do MLOps, projetado especificamente para lidar com os desafios operacionais impostos por grandes modelos de linguagem. Vamos concluir com uma comparação visual dessas três metodologias, ilustrando seu escopo no contexto das empresas usuárias de LLM, que aproveitam esses modelos para criar produtos e resolver problemas de negócios.

Embora as três metodologias compartilhem práticas comuns, como CI/CD, controle de versão e avaliação, cada uma delas tem áreas de foco distintas. O DevOps abrange todo o ciclo de vida do desenvolvimento de software, desde o desenvolvimento até a implantação e a manutenção. O MLOps amplia o DevOps para abordar os desafios específicos dos modelos de aprendizado de máquina, incluindo a automatização do treinamento, da implantação e do monitoramento do modelo. O LLMOps, a mais recente iteração dessas metodologias, concentra-se especificamente nos LLMs. Embora as empresas usuárias de LLM não precisem desenvolver seus próprios modelos, elas ainda enfrentam desafios operacionais, incluindo o gerenciamento de alterações de API e a personalização de modelos por meio de técnicas como engenharia imediata e ajuste fino.

BLOG

BLOG