简要说明

本文将介绍 LLMOps,这是一个融合了 DevOps 和 MLOps 的专门分支,用于 管理大型语言模型带来的挑战 (LLM)。LLM 与 OpenAI 的 GPT 一样,使用大量文本 data 来完成文本生成和语言翻译等任务。LLMOps 解决的问题包括 定制、API 更改、data 漂移、模型评估和监控 通过 LangSmith、TruLens 和 W&B Prompts 等工具。它可确保 LLM 在实际场景中的适应性、评估和监控,为利用这些先进语言模型的机构提供全面的解决方案。.

为了引导您完成这次讨论,我们将首先重温 DevOps 和 MLOps 的基本原则,然后重点讨论 LLMOps,首先简要介绍 LLM 及其在组织中的应用。接下来,我们将深入探讨 LLM 技术带来的主要运营挑战,以及 LLMOps 如何有效应对这些挑战。.

LLMOps 的基本原则:DevOps 和 MLOps

DevOps 是开发与运营的简称,是一套旨在实现软件交付流程自动化的实践,使其更加高效、可靠和可扩展。DevOps 的核心原则包括:协作、自动化、持续测试、监控和部署协调。.

MLOps 是机器学习运营(Machine Learning Operations)的简称,是 DevOps 实践的延伸,专门为机器学习模型的生命周期管理而定制。它解决了机器学习开发的迭代性和实验性所带来的独特挑战。它引入了额外的任务,如 data 版本和管理,以及实验和模型训练。.

LLMOps:管理大型语言模型的部署和维护

LLMOps 是 Large Language Model Operations(大型语言模型运行)的简称,是 MLOps 的一个专业分支,专门用于应对管理大型语言模型 (LLM) 的独特挑战和要求。.

首先,什么是法学硕士?

LLM 是一种深度学习模型,它使用海量文本 data 来估计数十亿个参数。这些参数使 LLM 能够理解和生成人类质量的文本、翻译语言、总结复杂信息并执行各种自然语言处理任务。.

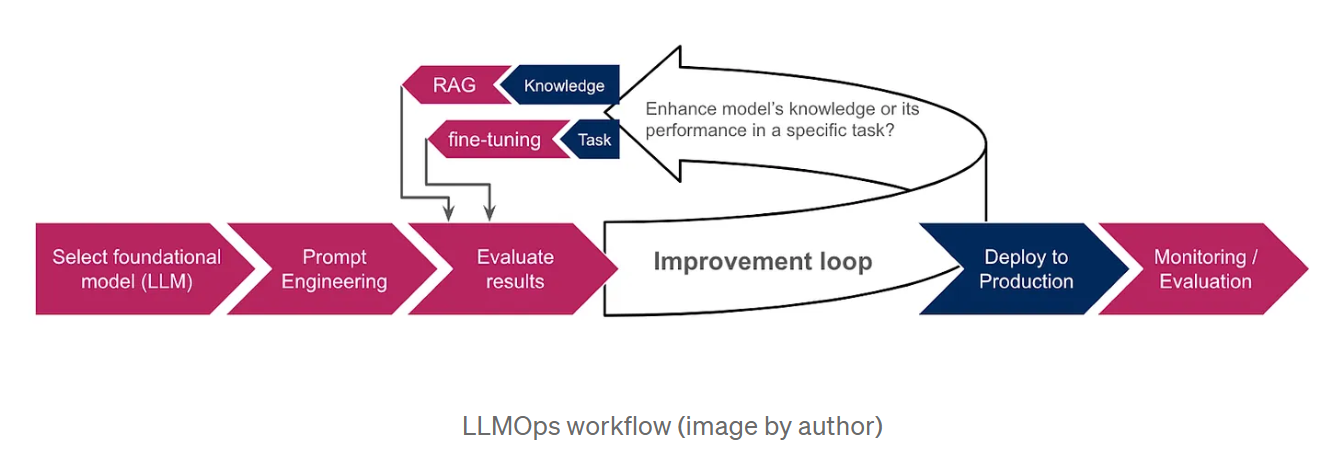

机构如何使用法律硕士

由于从头开始训练 LLM 极其昂贵且耗时,因此企业会选择预先训练好的基础模型作为起点,如 OpenAI 的 GPT 或 Google AI 的 LaMDA。这些模型已经过大量 data 的训练,拥有丰富的知识,可以执行各种任务,包括生成文本、翻译语言和编写不同类型的创意内容。为了根据特定任务或领域进一步定制 LLM 的输出,企业采用了提示工程、检索增强生成 (RAG) 和微调等技术。提示工程包括制作简洁明了的指令,引导 LLM 实现预期结果,而检索增强生成(RAG)则将外部 data 来源的额外信息作为模型的基础,从而提高其性能和相关性。另一方面,微调则是根据组织的具体需求,使用额外的 data 来调整 LLM 的参数。下面的图表概述了 LLMOps 的工作流程,说明了这些技术如何与整个流程相结合。.

为什么我们需要当地联络处

LLM 技术的飞速发展带来了一些操作上的挑战,需要采用专门的方法来解决。.

其中一些挑战包括:

定制需求:虽然 LLM 是在大量 data 上预先训练的,但要在特定任务中获得最佳性能,定制是必不可少的。因此,新的定制技术应运而生,例如 及时工程, ,检索增强生成 (RAG)和 微调. .RAG 通过为模型提供外部知识库,帮助它以最准确的信息为基础,而微调则更适用于我们希望模型执行特定任务或遵循特定响应格式(如 JSON 或 SQL)的情况。在 RAG 和微调之间做出选择,取决于我们的目标是增强模型的知识,还是提高其在特定任务中的性能。.

应用程序接口更改:与传统的 ML 模型不同,LLM 通常通过第三方应用程序接口访问,而这些应用程序接口可能会被修改甚至废弃,因此需要持续监控和调整。例如, 打开人工智能的文档 明确提到其型号会定期更新,这可能要求用户更新软件或迁移到更新的型号或终端。.

Data 漂移, 这是指输入 data 统计属性的变化,经常发生在生产过程中,当遇到的 data 偏离 LLM 所训练的 data 时。这会导致生成不准确或过时的信息。例如,GPT-3.5 模型在 2021 年 9 月之前的信息是有限的。 截止日期延长至 2022 年 1 月. .因此,它无法解决有关近期事件的问题,导致用户感到沮丧。.

模型评估:在传统的机器学习中,我们依靠准确率、精确度和召回率等指标来评估我们的模型。然而,评估 LLM 要复杂得多,尤其是在缺乏地面实况 data 和处理自然语言输出而非数值时。.

监测:持续监控 LLM 和基于 LLM 的应用程序至关重要。这一点也比较复杂,因为它涉及多个方面,需要加以考虑,以确保这些语言模型的整体有效性和可靠性。我们将在下一节详细讨论这些方面。.

LLMOps 如何应对这些挑战

LLMOps 建立在 MLOps 的基础上,同时引入了为 LLM 量身定制的专门内容:

及时的工程和微调管理:LLMOps 提供以下工具 提示版本控制系统 来跟踪和管理不同版本的提示。它还与 微调框架 来自动化和优化微调过程。LangSmith 就是这些工具中的一个突出例子,它是一个专为管理 LLM 工作流程而设计的框架。它的综合功能包括 提示版本控制, 这样就可以进行受控实验和再现。此外,LangSmith 还有助于 微调 在最终过滤和丰富后,使用运行'data 的 LLM,以提高模型性能。.

应用程序接口变更管理:当地劳工管理组织为以下方面制定程序 监测 更改应用程序接口、, 警报 运营者对潜在干扰的应对,以及 启用回滚 如果有必要。.

模型适应不断变化的 data:LLMOps 帮助 LLM 适应不断变化的 data 环境,确保模型在 data 模式变化时保持相关性和性能。这可以通过以下方式实现 监测 data 分布并触发适应过程 当发现重大变化时。这些过程可能包括

-> 再培训或微调:根据 data 漂移的程度和可用资源,可以采用重新培训或微调的方法来减轻其影响。.

-> 领域适应:微调目标域 dataset 上的 LLM。.

-> 知识提炼:利用更大、更强大、更先进的模型的知识和专业技能来培训较小的模型。.

针对法律硕士的评估:当地劳工管理组织采用了适合当地劳工管理的新评估工具。这些工具包括

-> 基于文本的度量, 这些指标包括:perplexity(复杂度)、BLEU 和 ROUGE 指标(将机器生成的文本与人类生成的一个或多个参考文本进行比较)、BLEU 和 ROUGE 指标(将机器生成的文本与人类生成的一个或多个参考文本进行比较)。还有 BLEU 和 ROUGE 指标,它们将机器生成的文本与人类生成的一个或多个参考文本进行比较。它们通常用于翻译和摘要任务。.

-> 分析嵌入 (词或短语的向量表示),以评估模型理解特定上下文词语和捕捉语义相似性的能力。可视化和聚类技术也能帮助我们发现偏差。.

-> 评估员法律硕士:使用其他 LLM 评估我们的模型。例如,可以根据预定义的指标(如流畅性、连贯性、相关性和事实准确性)对被评估模型的输出进行评分。.

-> 人的反馈整合:LLMOps 纳入了收集人类反馈并将其纳入 ML 生命周期的机制,从而提高 LLM 性能并解决偏差问题。.

透镜 是一种工具,可通过一种称为 "反馈功能 "的编程方法,将这些评估整合到学习管理应用中。.

针对当地学习机制的监测:LLMOps 集成了持续监测功能,以跟踪 LLM 性能指标,识别潜在问题,并检测概念漂移或偏差。这包括

-> 功能监测; 通过跟踪请求数量、响应时间、令牌使用情况、出错率和成本。.

-> 及时监测; 确保可读性,并检测毒性和其他形式的滥用。. W&B 提示 是一套专为监控基于 LLM 的应用程序而设计的工具。它可用于分析 LLM 的输入和输出、查看中间结果以及安全地存储和管理提示。.

-> 响应监测; 确保模型的相关性和一致性。这包括防止产生幻觉或虚构内容,以及确保排除有害或不适当的材料。透明度可以帮助我们更好地理解模型的反应。可以通过揭示答案来源(在 RAG 中)或提示模型证明其推理(思维链)来建立透明度。.

这种监控 data 可用于提高运行效率。我们可以通过对令牌使用情况实施警报和采用缓存以前的响应等策略来改进成本管理。这样,我们就可以在类似查询中重复使用它们,而无需再次调用 LLM。此外,我们还可以在可行的情况下选择较小的模型,并限制生成令牌的数量,从而最大限度地减少延迟。.

结论

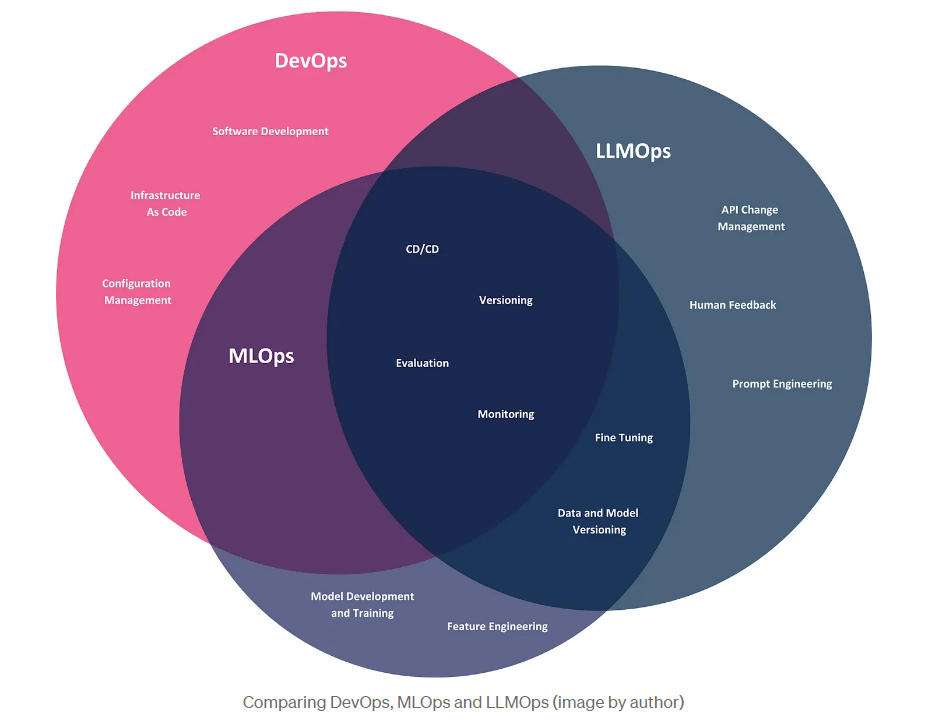

在本文中,我们探讨了 LLMOps 的出现,它是 DevOps 和 MLOps 的后代,专门用于应对大型语言模型带来的运营挑战。最后,让我们对这三种方法进行直观的比较,说明它们在 LLM 用户公司中的应用范围,这些公司利用这些模型创建产品并解决业务问题。.

虽然这三种方法都有共同的实践,如 CI/CD、版本化和评估,但它们各有不同的关注领域。DevOps 涵盖了从开发到部署和维护的整个软件开发生命周期。MLOps 扩展了 DevOps,以应对机器学习模型的特定挑战,包括模型训练、部署和监控的自动化。LLMOps 是这些方法论的最新迭代,专门针对 LLM。尽管 LLM 用户公司不需要开发自己的模型,但他们仍然面临着运营方面的挑战,包括管理 API 变化以及通过提示工程和微调等技术定制模型。.

博客

博客