TL;DR

Dieser Artikel stellt LLMOps vor, einen speziellen Zweig, der DevOps und MLOps für Bewältigung der Herausforderungen, die große Sprachmodelle mit sich bringen (LLMs). LLMs, wie OpenAIs GPT, verwenden umfangreichen Text data für Aufgaben wie Texterstellung und Sprachübersetzung. LLMOps befasst sich mit Themen wie Anpassungen, API-Änderungen, data-Drift, Modellbewertung und Überwachung durch Tools wie LangSmith, TruLens und W&B Prompts. Es gewährleistet die Anpassbarkeit, Bewertung und Überwachung von LLMs in realen Szenarien und bietet eine umfassende Lösung für Unternehmen, die diese fortschrittlichen Sprachmodelle nutzen.

Um Sie durch diese Diskussion zu führen, werden wir zunächst die grundlegenden Prinzipien von DevOps und MLOps wiederholen. Anschließend werden wir uns auf LLMOps konzentrieren und mit einer kurzen Einführung in LLMs und deren Nutzung durch Unternehmen beginnen. Als Nächstes werden wir uns mit den wichtigsten betrieblichen Herausforderungen befassen, die sich durch die LLM-Technologie ergeben, und wie LLMOps diese effektiv angeht.

Grundlegende Prinzipien für LLMOps : DevOps und MLOps

DevOps, die Abkürzung für Development and Operations, ist eine Reihe von Praktiken, die darauf abzielen, den Softwarebereitstellungsprozess zu automatisieren und ihn effizienter, zuverlässiger und skalierbarer zu machen. Zu den Kernprinzipien von DevOps gehören: Zusammenarbeit, Automatisierung, kontinuierliche Tests, Überwachung und Orchestrierung der Bereitstellung.

MLOps, kurz für Machine Learning Operations, ist eine Erweiterung der DevOps-Praktiken, die speziell auf das Lebenszyklusmanagement von Machine Learning-Modellen zugeschnitten ist. Es befasst sich mit den einzigartigen Herausforderungen, die sich aus dem iterativen und experimentellen Charakter der Entwicklung von maschinellem Lernen ergeben. Es werden zusätzliche Aufgaben wie data-Versionierung und -Verwaltung sowie Experimentieren und Modelltraining eingeführt.

LLMOps: Verwaltung der Bereitstellung und Pflege von großen Sprachmodellen

LLMOps, kurz für Large Language Model Operations, ist ein spezialisierter Zweig von MLOps, der speziell für die besonderen Herausforderungen und Anforderungen der Verwaltung großer Sprachmodelle (LLMs) entwickelt wurde.

Aber zunächst einmal: Was genau sind LLMs?

LLMs sind eine Art von Deep-Learning-Modellen, die riesige Mengen von Text data verwenden, um Milliarden von Parametern zu schätzen. Diese Parameter ermöglichen es LLMs, Texte in menschlicher Qualität zu verstehen und zu generieren, Sprachen zu übersetzen, komplexe Informationen zusammenzufassen und verschiedene Aufgaben der natürlichen Sprachverarbeitung durchzuführen.

Wie Organisationen LLMs nutzen

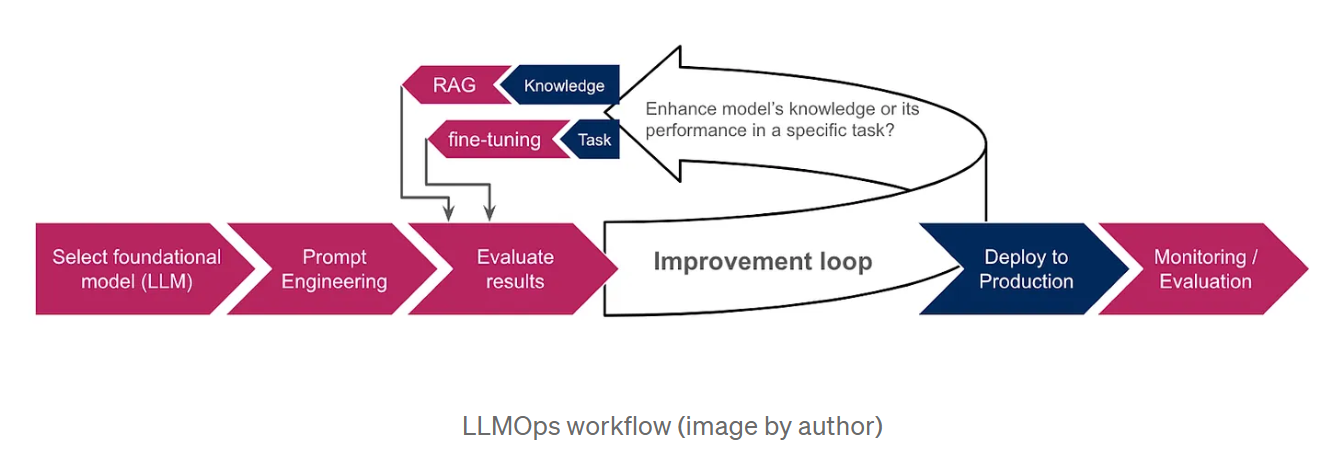

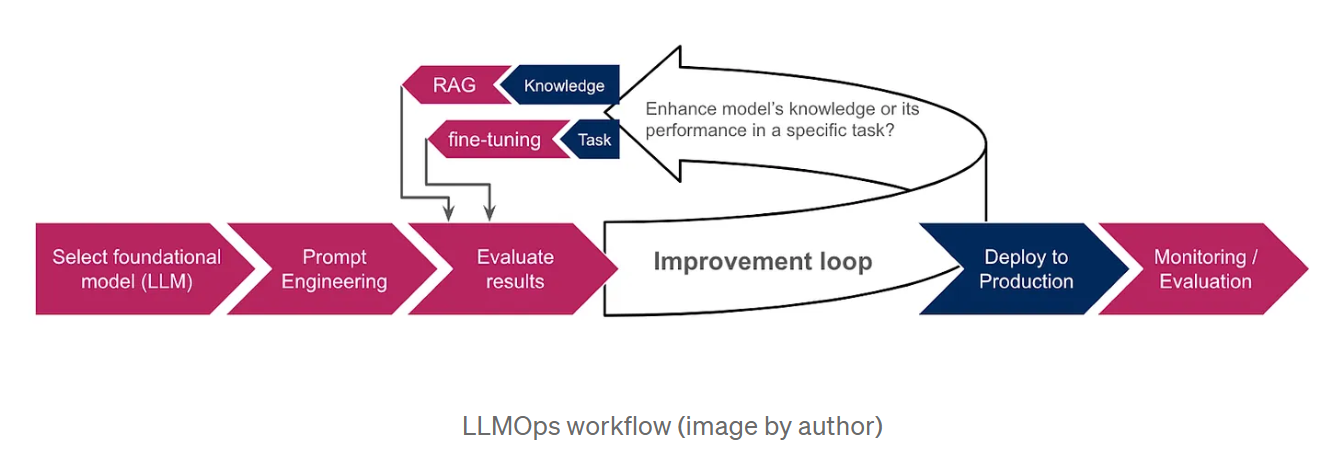

Da es extrem teuer und zeitaufwändig ist, LLMs von Grund auf zu trainieren, entscheiden sich Unternehmen für vortrainierte Basismodelle, wie z.B. GPT von OpenAI oder LaMDA von Google AI, als Ausgangspunkt. Diese Modelle, die bereits auf großen Mengen von data trainiert wurden, verfügen über ein umfangreiches Wissen und können verschiedene Aufgaben ausführen, wie z.B. die Generierung von Text, die Übersetzung von Sprachen und das Schreiben verschiedener Arten von kreativen Inhalten. Zur weiteren Anpassung der LLM-Ausgabe an bestimmte Aufgaben oder Bereiche setzen Unternehmen Techniken wie Prompt Engineering, Retrieval-Augmented Generation (RAG) und Fine-Tuning ein. Prompt Engineering beinhaltet die Erstellung klarer und präziser Anweisungen, die das LLM zum gewünschten Ergebnis führen, während RAG das Modell auf zusätzliche Informationen aus externen data-Quellen stützt und so seine Leistung und Relevanz verbessert. Bei der Feinabstimmung hingegen werden die Parameter des LLM mit zusätzlichen data speziell für die Bedürfnisse des Unternehmens angepasst. Das nachstehende Schema bietet einen Überblick über den LLMOps-Workflow und veranschaulicht, wie diese Techniken in den Gesamtprozess integriert werden.

Warum wir LLMOps brauchen

Die rasanten Fortschritte in der LLM-Technologie haben einige operative Herausforderungen ans Licht gebracht, die spezielle Ansätze erfordern.

Einige dieser Herausforderungen sind:

Der Bedarf an Personalisierung: LLMs sind zwar auf riesigen Mengen von data vortrainiert, aber für eine optimale Leistung bei spezifischen Aufgaben ist eine Anpassung unerlässlich. Dies hat zur Entwicklung von neuen Anpassungstechniken geführt, wie z.B. schnelle Technik, Abruf-erweiterte Generierung (RAG) und Feinabstimmung. RAG hilft dabei, das Modell auf die genauesten Informationen zu gründen, indem es ihm eine externe Wissensbasis zur Verfügung stellt, während die Feinabstimmung besser geeignet ist, wenn wir möchten, dass das Modell bestimmte Aufgaben erfüllt oder ein bestimmtes Antwortformat wie JSON oder SQL befolgt. Die Wahl zwischen RAG und Feinabstimmung hängt davon ab, ob wir das Wissen des Modells erweitern oder seine Leistung bei einer bestimmten Aufgabe verbessern wollen.

API-Änderungen: Im Gegensatz zu herkömmlichen ML-Modellen erfolgt der Zugriff auf LLMs häufig über APIs von Drittanbietern, die geändert oder sogar veraltet sein können, was eine kontinuierliche Überwachung und Anpassung erforderlich macht. Zum Beispiel, Öffnen Sie die Dokumentation von AI weist ausdrücklich darauf hin, dass ihre Modelle regelmäßig aktualisiert werden, was dazu führen kann, dass Benutzer ihre Software aktualisieren oder auf neuere Modelle oder Endgeräte umsteigen müssen.

Data Drift, bezieht sich auf eine Verschiebung der statistischen Eigenschaften des eingegebenen data, die häufig in der Produktion auftritt, wenn der angetroffene data von dem data abweicht, auf dem die LLMs trainiert wurden. Dies kann dazu führen, dass ungenaue oder veraltete Informationen generiert werden. Beim Modell GPT-3.5 zum Beispiel waren die Informationen bis September 2021 begrenzt, bevor der Stichtag wurde bis Januar 2022 verlängert. Folglich konnte es keine Fragen zu neueren Ereignissen beantworten, was zu Frustration bei den Benutzern führte.

Bewertung des Modells: Beim traditionellen maschinellen Lernen verlassen wir uns auf Metriken wie Genauigkeit, Präzision und Wiedererkennung, um unsere Modelle zu bewerten. Die Bewertung von LLMs ist jedoch wesentlich komplizierter, vor allem, wenn keine Grundwahrheit data vorliegt und wenn es sich um natürliche Sprachausgaben und nicht um numerische Werte handelt.

Überwachung: Die kontinuierliche Überwachung von LLMs und LLM-basierten Anwendungen ist entscheidend. Sie ist auch komplizierter, denn sie umfasst mehrere Aspekte, die berücksichtigt werden müssen, um die allgemeine Effektivität und Zuverlässigkeit dieser Sprachmodelle zu gewährleisten. Wir werden diese Aspekte im nächsten Abschnitt näher erläutern.

Wie LLMOps diese Herausforderungen angeht

LLMOps baut auf dem Fundament von MLOps auf und führt gleichzeitig spezielle Komponenten ein, die auf LLMs zugeschnitten sind:

Promptes Management von Technik und Feinabstimmung: LLMOps bietet Tools wie zeitnahe Versionskontrollsysteme um verschiedene Versionen von Prompts zu verfolgen und zu verwalten. Es lässt sich auch integrieren mit Rahmenbedingungen für die Feinabstimmung um den Feinabstimmungsprozess zu automatisieren und zu optimieren. Ein herausragendes Beispiel für diese Tools ist LangSmith, ein Framework, das speziell für die Verwaltung von LLM-Workflows entwickelt wurde. Seine umfassenden Funktionen umfassen Promptes Versionieren, und ermöglicht kontrollierte Experimente und Reproduzierbarkeit. Darüber hinaus erleichtert LangSmith Feinabstimmung von LLMs unter Verwendung von runs'data nach eventueller Filterung und Anreicherung zur Verbesserung der Modellleistung.

Verwaltung von API-Änderungen: LLMOps legt Prozesse fest für Überwachung API-Änderungen, Alarmierung Betreiber auf mögliche Störungen und Rollbacks aktivieren falls erforderlich.

Anpassung des Modells an Veränderungen data: LLMOps erleichtert die Anpassung von LLMs an sich entwickelnde data-Landschaften und stellt sicher, dass die Modelle relevant und leistungsfähig bleiben, wenn sich die data-Muster ändern. Dies könnte erreicht werden durch Überwachung der data-Verteilung und Auslösung von Anpassungsprozessen wenn signifikante Veränderungen festgestellt werden. Diese Prozesse können umfassen:

-> Umschulung oder Feinabstimmung: Je nach Ausmaß der data-Drift und den verfügbaren Ressourcen kann entweder eine Umschulung oder eine Feinabstimmung vorgenommen werden, um die Auswirkungen zu mildern.

-> Domänenanpassung: Feinabstimmung des LLM auf einem dataset aus der Zieldomäne.

-> Wissen destillieren: Trainieren Sie ein kleineres Modell, indem Sie das Wissen und die Erfahrung eines größeren, leistungsfähigeren und aktuelleren Modells nutzen.

LLM-spezifische Bewertung: LLMOps setzt neue, an LLMs angepasste Bewertungsinstrumente ein. Dazu gehören:

-> Textbasierte Metriken, Ein statistisches Maß dafür, wie gut das Modell in der Lage ist, das nächste Wort in einer Sequenz vorherzusagen. Sowie BLEU- und ROUGE-Metriken, die maschinell erstellten Text mit einem oder mehreren von Menschen erstellten Referenztexten vergleichen. Sie werden in der Regel für Übersetzungs- und Zusammenfassungsaufgaben verwendet.

-> Analysieren von Einbettungen (Vektordarstellungen für Wörter oder Phrasen), um die Fähigkeit des Modells zu bewerten, kontextspezifische Wörter zu verstehen und semantische Ähnlichkeiten zu erfassen. Visualisierungs- und Clustering-Techniken können uns auch bei der Erkennung von Verzerrungen helfen.

-> Bewerter LLMs: Verwendung anderer LLMs zur Bewertung unseres Modells. Dies kann z.B. dadurch geschehen, dass wir der Ausgabe des bewerteten Modells eine Punktzahl zuweisen, die auf vordefinierten Metriken basiert, wie z.B. Geläufigkeit, Kohärenz, Relevanz und sachliche Richtigkeit.

-> Integration von menschlichem Feedback: LLMOps beinhaltet Mechanismen, um menschliches Feedback zu sammeln und in den ML-Lebenszyklus einzubeziehen, die LLM-Leistung zu verbessern und Verzerrungen zu beseitigen.

TruLens ist ein Tool, das die Integration dieser Auswertungen in LLM-Anwendungen durch einen programmatischen Ansatz ermöglicht, der als Feedback-Funktionen bekannt ist.

LLM-spezifische Überwachung: LLMOps integriert eine kontinuierliche Überwachung, um LLM-Leistungsmetriken zu verfolgen, potenzielle Probleme zu identifizieren und Konzeptabweichungen oder Verzerrungen zu erkennen. Dies beinhaltet:

-> Funktionelle Überwachung; indem Sie die Anzahl der Anfragen, die Antwortzeit, die Verwendung von Token, die Fehlerraten und die Kosten verfolgen.

-> Prompte Überwachung; um die Lesbarkeit zu gewährleisten und um Toxizität und andere Formen des Missbrauchs zu erkennen. W&B Prompts ist eine Reihe von Tools, die für die Überwachung von LLM-basierten Anwendungen entwickelt wurden. Sie können damit die Eingaben und Ausgaben Ihrer LLMs analysieren, die Zwischenergebnisse einsehen und Ihre Prompts sicher speichern und verwalten.

-> Überwachung der Reaktion; um die Relevanz und Konsistenz des Modells zu gewährleisten. Dazu gehört auch, die Erzeugung halluzinatorischer oder fiktiver Inhalte zu verhindern und den Ausschluss von schädlichem oder unangemessenem Material sicherzustellen. Transparenz kann uns helfen, die Reaktion des Modells besser zu verstehen. Sie kann hergestellt werden, indem man Antwortquellen (in RAG) offenlegt oder das Modell auffordert, seine Argumentation zu begründen (Gedankenkette).

Diese Überwachung data kann zur Verbesserung der betrieblichen Effizienz genutzt werden. Wir können das Kostenmanagement verbessern, indem wir Warnungen über die Verwendung von Token implementieren und Strategien wie das Zwischenspeichern früherer Antworten anwenden. So können wir sie für ähnliche Abfragen wiederverwenden, ohne den LLM erneut aufrufen zu müssen. Außerdem können wir die Latenzzeit minimieren, indem wir uns für kleinere Modelle entscheiden, wann immer dies möglich ist, und die Anzahl der generierten Token einschränken.

Fazit

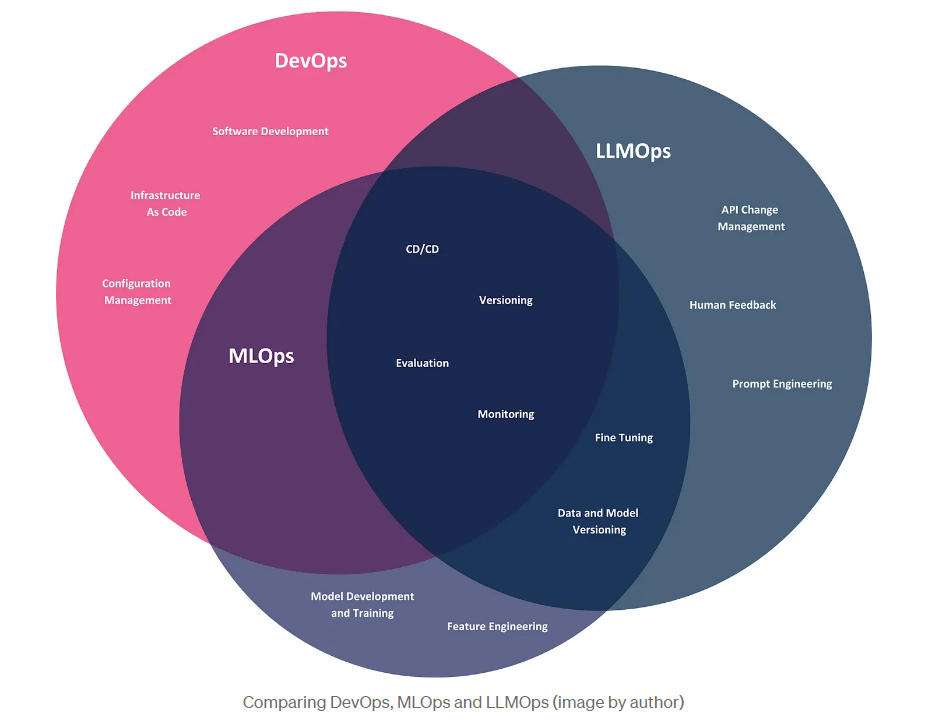

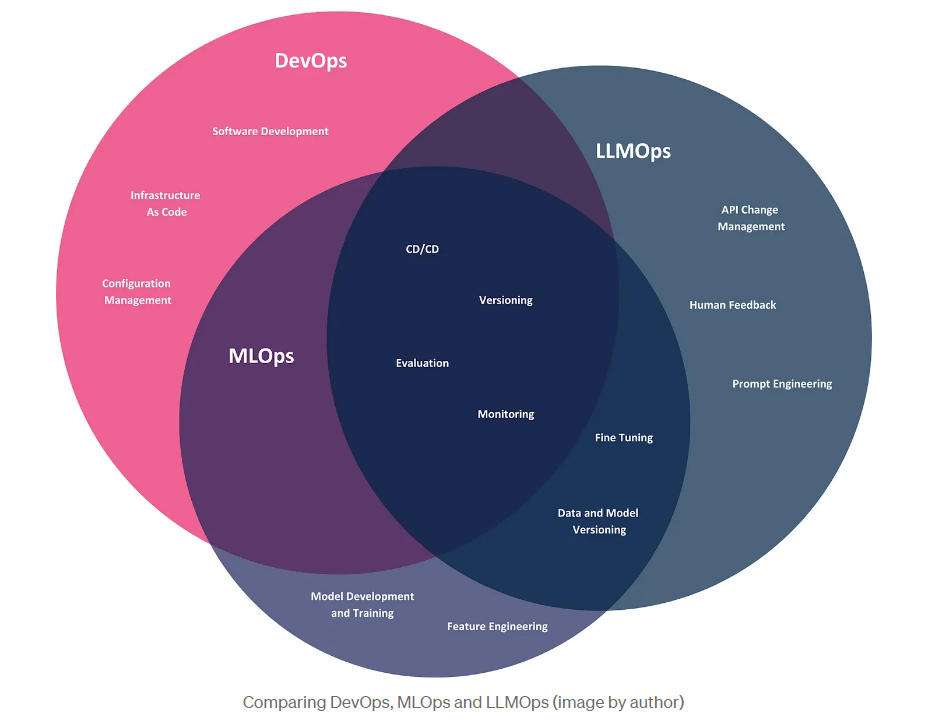

In diesem Artikel haben wir uns mit der Entstehung von LLMOps beschäftigt, einem Abkömmling von DevOps und MLOps, der speziell für die Bewältigung der operativen Herausforderungen großer Sprachmodelle entwickelt wurde. Lassen Sie uns abschließend einen visuellen Vergleich dieser drei Methoden anstellen, um ihren Anwendungsbereich im Kontext von LLM-Anwenderunternehmen zu veranschaulichen, die diese Modelle zur Erstellung von Produkten und zur Lösung von Geschäftsproblemen einsetzen.

Die drei Methoden haben zwar gemeinsame Praktiken wie CI/CD, Versionierung und Evaluierung, aber sie haben jeweils unterschiedliche Schwerpunkte. DevOps umfasst den gesamten Lebenszyklus der Softwareentwicklung, von der Entwicklung bis zur Bereitstellung und Wartung. MLOps erweitert DevOps, um die spezifischen Herausforderungen von Modellen für maschinelles Lernen anzugehen, einschließlich der Automatisierung von Modelltraining, Bereitstellung und Überwachung. LLMOps, die jüngste Weiterentwicklung dieser Methoden, konzentriert sich speziell auf LLMs. Auch wenn LLM-Anwenderunternehmen keine eigenen Modelle entwickeln müssen, stehen sie dennoch vor operativen Herausforderungen, einschließlich der Verwaltung von API-Änderungen und der Anpassung von Modellen durch Techniken wie Prompt Engineering und Feinabstimmung.

BLOG

BLOG