En resumen

Este artículo presenta LLMOps, una rama especializada que fusiona DevOps y MLOps para gestionar los retos que plantean los modelos de lenguaje a gran escala (LLM). Los LLM, como el GPT de OpenAI, utilizan grandes volúmenes data de texto data tareas como la generación de texto y la traducción. LLMOps aborda cuestiones como la personalización, los cambios en las API, data , la evaluación de modelos y la supervisión mediante herramientas como LangSmith, TruLens y W&B Prompts. Garantiza la adaptabilidad, la evaluación y la supervisión de los LLM en escenarios del mundo real, ofreciendo una solución integral para las organizaciones que aprovechan estos modelos de lenguaje avanzados.

Para guiarle a lo largo de este debate, comenzaremos por repasar los principios fundamentales de DevOps y MLOps; a continuación, nos centraremos en LLMOps, empezando por una breve introducción a los modelos de lenguaje grande (LLM) y su uso en las organizaciones. Después, analizaremos los principales retos operativos que plantea la tecnología de los modelos de lenguaje grande y cómo LLMOps los aborda de manera eficaz.

Principios fundamentales de LLMOps: DevOps y MLOps

DevOps, abreviatura de «Desarrollo y Operaciones», es un conjunto de prácticas cuyo objetivo es automatizar el proceso de entrega de software, haciéndolo más eficiente, fiable y escalable. Los principios fundamentales de DevOps incluyen: colaboración, automatización, pruebas continuas, supervisión y coordinación de la implementación.

MLOps, abreviatura de «Machine Learning Operations» (operaciones de aprendizaje automático), es una extensión de las prácticas de DevOps diseñada específicamente para la gestión del ciclo de vida de los modelos de aprendizaje automático. Aborda los retos específicos que plantea el carácter iterativo y experimental del desarrollo del aprendizaje automático, incorporando tareas adicionales como data y la gestión data , así como la experimentación y el entrenamiento de modelos.

LLMOps: Gestión de la implementación y el mantenimiento de modelos de lenguaje a gran escala

LLMOps, abreviatura de «Large Language Model Operations», es una rama especializada de MLOps diseñada específicamente para abordar los retos y requisitos específicos que plantea la gestión de modelos de lenguaje a gran escala (LLM).

Pero, antes de nada, ¿qué son exactamente los LLM?

Los modelos de lenguaje grande (LLM) son un tipo de modelo de aprendizaje profundo que utiliza enormes cantidades de data de texto data estimar miles de millones de parámetros. Estos parámetros permiten a los LLM comprender y generar texto con calidad humana, traducir idiomas, resumir información compleja y realizar diversas tareas de procesamiento del lenguaje natural.

Cómo utilizan las organizaciones los modelos de lenguaje grande (LLM)

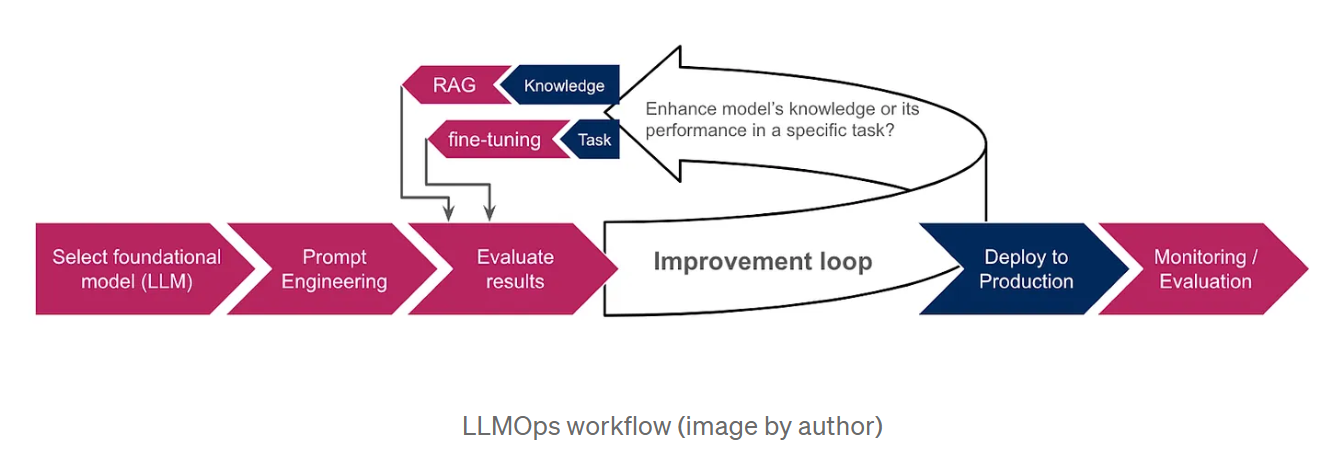

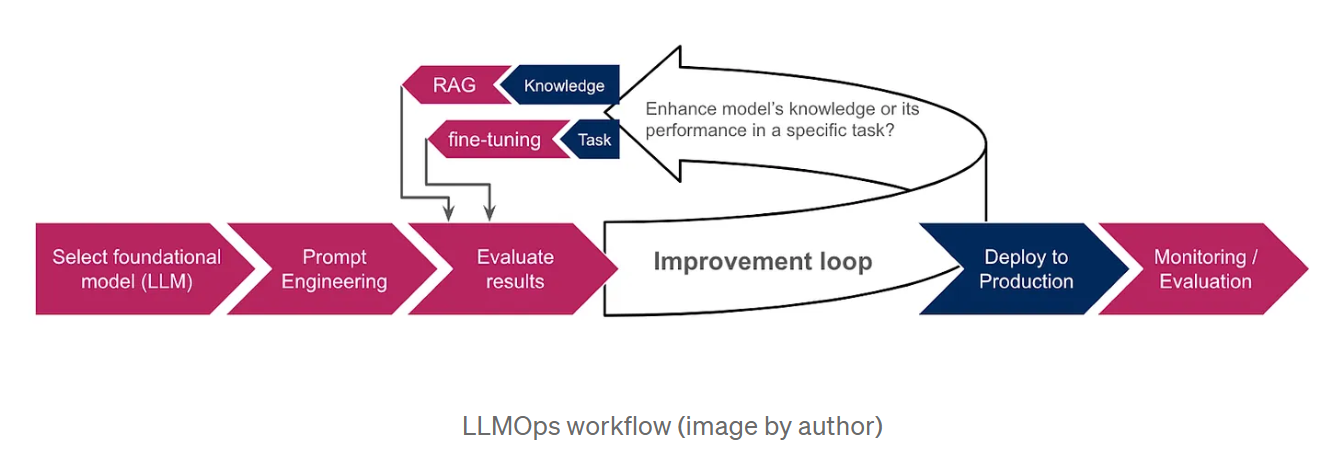

Dado que entrenar modelos de lenguaje grande (LLM) desde cero resulta extremadamente costoso y requiere mucho tiempo, las organizaciones optan por modelos base preentrenados, como el GPT de OpenAI o el LaMDA AIGoogle AI, como punto de partida. Estos modelos, al haber sido entrenados con grandes cantidades de data, poseen amplios conocimientos y pueden realizar diversas tareas, entre ellas generar texto, traducir idiomas y redactar diferentes tipos de contenido creativo. Para personalizar aún más los resultados del LLM para tareas o ámbitos específicos, las organizaciones emplean técnicas como la ingeniería de prompts, la generación aumentada por recuperación (RAG) y el ajuste fino. La ingeniería de prompts consiste en elaborar instrucciones claras y concisas que guíen al LLM hacia el resultado deseado, mientras que la RAG fundamenta el modelo en información adicional procedente de data externas, mejorando su rendimiento y relevancia. El ajuste fino, por su parte, consiste en ajustar los parámetros del LLM utilizando data adicionales data para las necesidades de la organización. El esquema que se muestra a continuación ofrece una visión general del flujo de trabajo de LLMOps, ilustrando cómo estas técnicas se integran en el proceso global.

Por qué necesitamos LLMOps

Los rápidos avances en la tecnología de los modelos de lenguaje grande (LLM) han puesto de manifiesto varios retos operativos que requieren enfoques especializados.

Algunos de estos retos son:

La necesidad de personalización: aunque los modelos de lenguaje grande (LLM) se entrenan previamente con enormes cantidades de data, la personalización es esencial para obtener un rendimiento óptimo en tareas específicas. Esto ha llevado al desarrollo de nuevas técnicas de personalización, como la ingeniería de prompts, la generación aumentada por recuperación (RAG) y el ajuste fino. La RAG ayuda a basar el modelo en la información más precisa al proporcionarle una base de conocimientos externa, mientras que el ajuste fino es más adecuado cuando queremos que el modelo realice tareas específicas o se adhiera a un formato de respuesta concreto, como JSON o SQL. La elección entre la RAG y el ajuste fino depende de si nuestro objetivo es ampliar los conocimientos del modelo o mejorar su rendimiento en una tarea específica.

Cambios en las API: A diferencia de los modelos de aprendizaje automático tradicionales, el acceso a los modelos de lenguaje grande (LLM) suele realizarse a través de API de terceros, que pueden modificarse o incluso quedar obsoletas, lo que exige una supervisión y adaptación continuas. Por ejemplo, la documentación AI menciona explícitamente que sus modelos están sujetos a actualizaciones periódicas, lo que puede obligar a los usuarios a actualizar su software o a migrar a modelos o puntos de conexión más recientes.

Data se refiere a un cambio en las propiedades estadísticas de data de entrada, algo que ocurre con frecuencia en entornos de producción cuando los data encontrados data de data se entrenaron data LLM data . Esto puede dar lugar a la generación de información inexacta u obsoleta. Por ejemplo, en el caso del modelo GPT-3.5, su información estaba limitada hasta septiembre de 2021, antes de que la fecha límite se ampliara a enero de 2022. En consecuencia, no podía responder a preguntas sobre acontecimientos más recientes, lo que provocaba la frustración de los usuarios.

Evaluación de modelos: En el aprendizaje automático tradicional, nos basamos en métricas como la exactitud, la precisión y la recuperación para evaluar nuestros modelos. Sin embargo, la evaluación de los modelos de lenguaje grande (LLM) es considerablemente más compleja, sobre todo cuando no se dispone de data de referencia data se trabaja con resultados en lenguaje natural en lugar de con valores numéricos.

Supervisión: La supervisión continua de los modelos de lenguaje grandes (LLM) y de las aplicaciones basadas en ellos es fundamental. Además, resulta más compleja, ya que implica múltiples aspectos que deben tenerse en cuenta para garantizar la eficacia y la fiabilidad generales de estos modelos de lenguaje. Analizaremos estos aspectos con más detalle en la siguiente sección.

Cómo aborda LLMOps estos retos

LLMOps se basa en los fundamentos de MLOps e introduce componentes especializados diseñados específicamente para los modelos de lenguaje grande (LLM):

Ingeniería de prompts y gestión del ajuste fino: LLMOps ofrece herramientas como sistemas de control de versiones de prompts para realizar un seguimiento y gestionar las diferentes versiones de los mismos. Además, se integra con marcos de trabajo de ajuste fino para automatizar y optimizar dicho proceso. Un ejemplo destacado de estas herramientas es LangSmith, un marco diseñado específicamente para gestionar flujos de trabajo de LLM. Sus completas funciones incluyen el control de versiones de las indicaciones, lo que permite la experimentación controlada y la reproducibilidad. Además, LangSmith facilita el ajuste fino de los LLM utilizandodata su posterior filtrado y enriquecimiento para mejorar el rendimiento del modelo.

Gestión de cambios en las API: LLMOps establece procesos para supervisar los cambios en las API, alertar a los operadores de posibles interrupciones y permitir la reversión de los cambios si fuera necesario.

Adaptación de modelos a data cambiantes: LLMOps facilita la adaptación de los modelos de lenguaje a gran escala (LLM) a data en constante evolución, garantizando que los modelos sigan siendo relevantes y eficaces a medida que cambian data . Esto podría lograrse supervisando data y activando procesos de adaptación cuando se detecten cambios significativos. Estos procesos pueden incluir:

-> Reentrenamiento o ajuste fino: dependiendo del alcance de data y de los recursos disponibles, se puede recurrir al reentrenamiento o al ajuste fino para mitigar su impacto.

-> Adaptación al dominio: Ajustar el LLM sobre un conjunto de datos del dominio de destino.

-> Destilación de conocimiento: Entrenar un modelo más pequeño aprovechando el conocimiento y la experiencia de un modelo más grande, potente y actualizado.

Evaluación específica para modelos de lenguaje grande (LLM): LLMOps utiliza nuevas herramientas de evaluación adaptadas a los LLM. Entre ellas se incluyen:

-> Métricas basadas en texto, como la perplejidad, una medida estadística que indica la capacidad del modelo para predecir la siguiente palabra de una secuencia. También se incluyen las métricas BLEU y ROUGE, que comparan el texto generado por la máquina con uno o varios textos de referencia generados por humanos. Se utilizan habitualmente en tareas de traducción y resumen.

-> Análisis de incrustaciones (representaciones vectoriales de palabras o frases), para evaluar la capacidad del modelo de comprender palabras específicas del contexto y captar similitudes semánticas. Las técnicas de visualización y agrupación también pueden ayudarnos a detectar sesgos.

-> LLM evaluadores: uso de otros LLM para evaluar nuestro modelo. Por ejemplo, esto puede hacerse atribuyendo una puntuación a la salida del modelo evaluado basándose en métricas predefinidas, como la fluidez, la coherencia, la relevancia y la precisión factual.

-> Integración de comentarios humanos: LLMOps incorpora mecanismos para recopilar e incorporar comentarios humanos en el ciclo de vida del aprendizaje automático, mejorando el rendimiento de los LLM y abordando los sesgos.

TruLens es una herramienta que permite integrar estas evaluaciones en aplicaciones de LLM mediante un enfoque programático conocido como «funciones de retroalimentación».

Supervisión específica para modelos de lenguaje grande (LLM): LLMOps integra una supervisión continua para realizar un seguimiento de las métricas de rendimiento de los LLM, identificar posibles problemas y detectar desviaciones conceptuales o sesgos. Esto incluye:

-> Supervisión funcional: mediante el seguimiento del número de solicitudes, el tiempo de respuesta, el uso de tokens, las tasas de error y el coste.

-> Supervisión de prompts; para garantizar la legibilidad y detectar toxicidad y otras formas de abuso. W&B Prompts es un conjunto de herramientas diseñadas para supervisar aplicaciones basadas en LLM. Se puede utilizar para analizar las entradas y salidas de sus LLM, ver los resultados intermedios y almacenar y gestionar de forma segura sus prompts.

-> Supervisión de respuestas; para garantizar la relevancia y la coherencia del modelo. Esto incluye evitar la generación de contenido alucinatorio o ficticio, así como garantizar la exclusión de material dañino o inapropiado. La transparencia nos ayuda a comprender mejor la respuesta del modelo. Se puede lograr revelando las fuentes de las respuestas (en RAG) o solicitando al modelo que justifique su razonamiento (cadena de pensamiento).

Estos data de supervisión data utilizarse para mejorar la eficiencia operativa. Podemos mejorar la gestión de costes implementando alertas sobre el uso de tokens y aplicando estrategias como el almacenamiento en caché de respuestas anteriores. Esto nos permite reutilizarlas para consultas similares sin necesidad de volver a invocar el modelo de lenguaje grande (LLM). Además, podemos minimizar la latencia optando por modelos más pequeños siempre que sea posible y limitando el número de tokens generados.

Conclusión

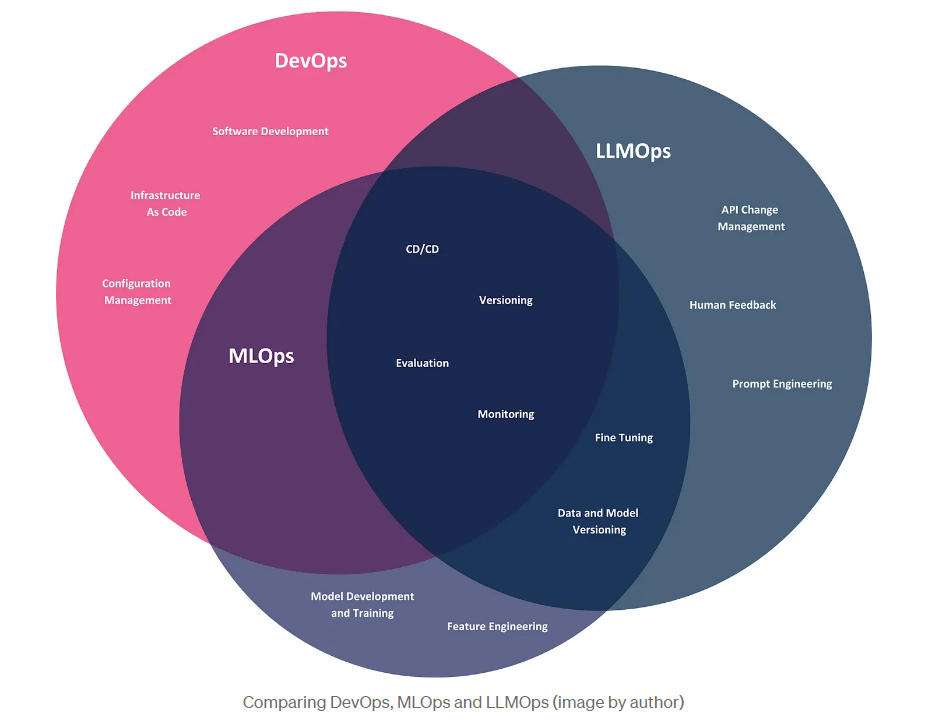

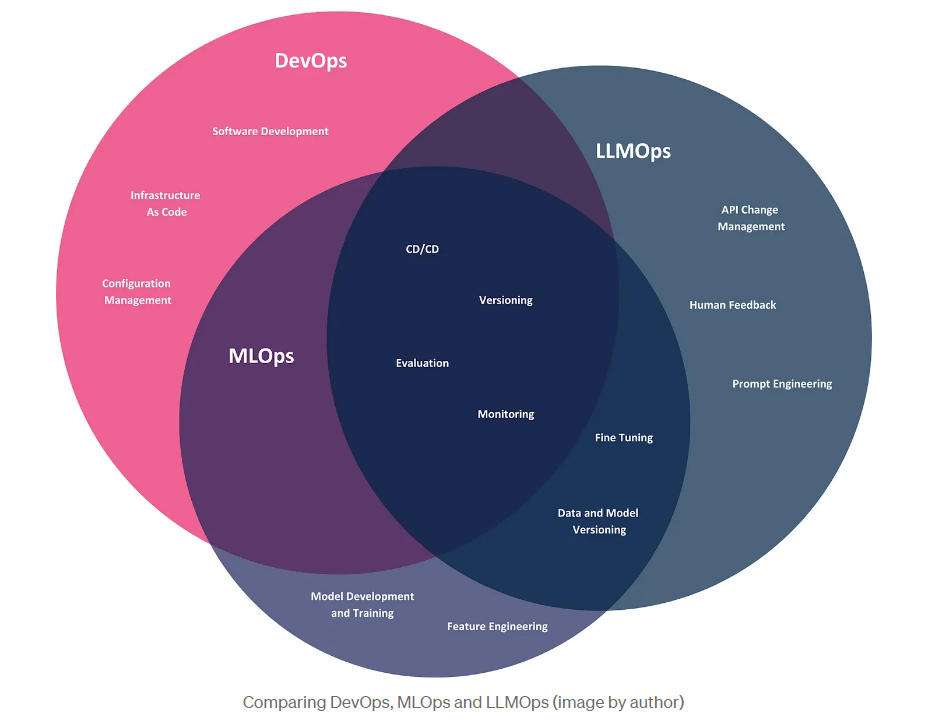

En este artículo hemos analizado el surgimiento de LLMOps, una variante de DevOps y MLOps diseñada específicamente para abordar los retos operativos que plantean los modelos de lenguaje a gran escala. Concluyamos con una comparación visual de estas tres metodologías, que ilustra su alcance en el contexto de las empresas usuarias de modelos de lenguaje a gran escala, las cuales aprovechan estos modelos para crear productos y resolver problemas empresariales.

Aunque las tres metodologías comparten prácticas comunes como CI/CD, el control de versiones y la evaluación, cada una de ellas se centra en áreas distintas. DevOps abarca todo el ciclo de vida del desarrollo de software, desde el desarrollo hasta la implementación y el mantenimiento. MLOps amplía DevOps para abordar los retos específicos de los modelos de aprendizaje automático, incluyendo la automatización del entrenamiento, la implementación y la supervisión de los modelos. LLMOps, la última versión de estas metodologías, se centra específicamente en los LLM. Aunque las empresas usuarias de LLM no necesitan desarrollar sus propios modelos, siguen enfrentándose a retos operativos, como la gestión de los cambios en las API y la personalización de los modelos mediante técnicas como la ingeniería de prompts y el ajuste fino.

BLOG

BLOG