TL;DR

Dit artikel introduceert LLMOps, een gespecialiseerde tak die DevOps en MLOps samenvoegt voor De uitdagingen van grote taalmodellen beheren (LLM's). LLM's, zoals GPT van OpenAI, gebruiken uitgebreide tekst data voor taken zoals tekstgeneratie en taalvertaling. LLMOps pakt problemen aan zoals aanpassing, API-wijzigingen, data drift, modelevaluatie en bewaking via tools zoals LangSmith, TruLens en W&B Prompts. Het zorgt voor aanpasbaarheid, evaluatie en bewaking van LLM's in real-world scenario's, en biedt een allesomvattende oplossing voor organisaties die gebruik maken van deze geavanceerde taalmodellen.

Om u door deze discussie te leiden, gaan we eerst in op de basisprincipes van DevOps en MLOps, waarna we ons richten op LLMOps, te beginnen met een korte introductie van LLM's en het gebruik ervan door organisaties. Vervolgens gaan we dieper in op de belangrijkste operationele uitdagingen van LLM-technologie en hoe LLMOps deze effectief aanpakt.

Basisprincipes voor LLMOps: DevOps en MLOps

DevOps, een afkorting van Development and Operations, is een verzameling praktijken die tot doel hebben het softwareleveringsproces te automatiseren, waardoor het efficiënter, betrouwbaarder en schaalbaarder wordt. De kernprincipes van DevOps zijn onder andere: samenwerking, automatisering, continu testen, bewaking en implementatie-orkestratie.

MLOps, kort voor Machine Learning Operations, is een uitbreiding van DevOps-praktijken die specifiek is afgestemd op het levenscyclusbeheer van modellen voor machinaal leren. Het richt zich op de unieke uitdagingen die de iteratieve en experimentele aard van de ontwikkeling van machine learning met zich meebrengt. Het introduceert extra taken zoals data versiebeheer, experimenteren en modeltraining.

LLMOps: Beheer van de implementatie en het onderhoud van grote taalmodellen

LLMOps, kort voor Large Language Model Operations, is een gespecialiseerde tak van MLOps die speciaal ontworpen is om de unieke uitdagingen en vereisten van het beheren van grote taalmodellen (LLM's) aan te kunnen.

Maar eerst, wat zijn LLM's precies?

LLM's zijn een soort deep learning-modellen die enorme hoeveelheden tekst data gebruiken om miljarden parameters te schatten. Dankzij deze parameters kunnen LLM's tekst van menselijke kwaliteit begrijpen en genereren, talen vertalen, complexe informatie samenvatten en verschillende taken op het gebied van natuurlijke taalverwerking uitvoeren.

Hoe organisaties LLM's gebruiken

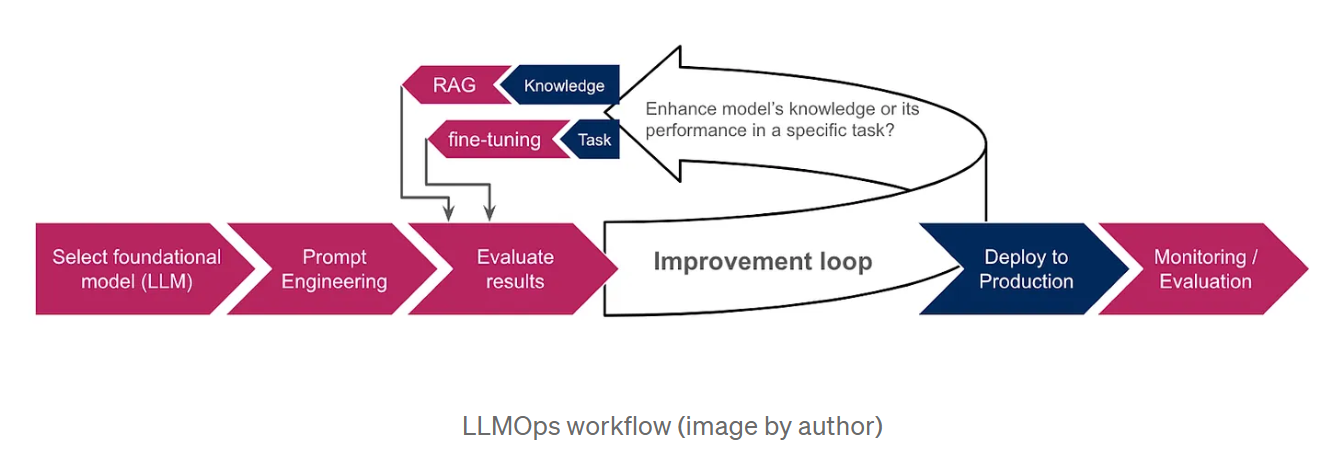

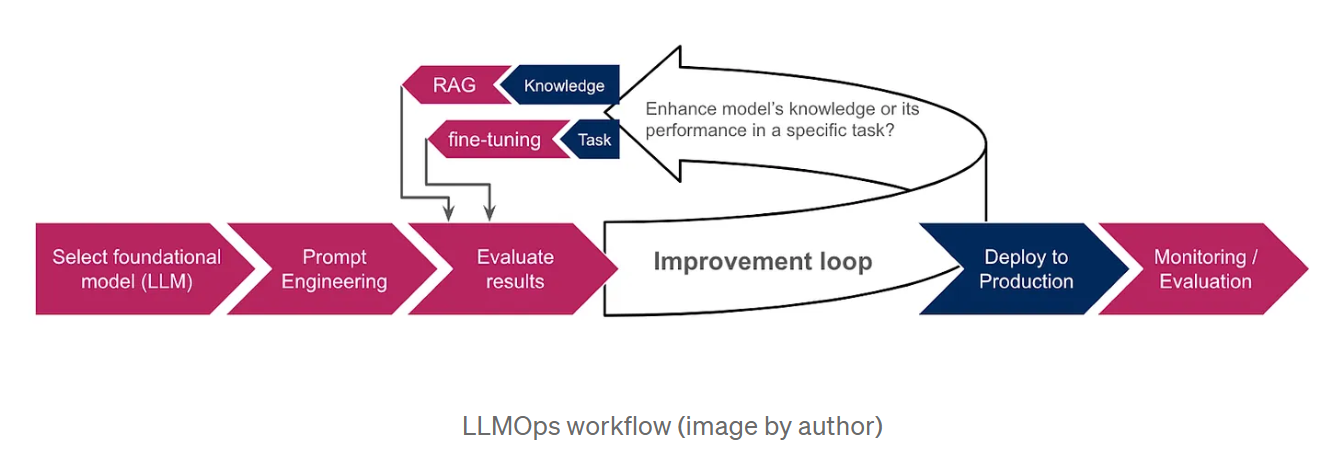

Omdat het trainen van LLM's vanaf nul extreem duur en tijdrovend is, kiezen organisaties voor voorgetrainde basismodellen, zoals GPT van OpenAI of LaMDA van Google AI, als uitgangspunt. Deze modellen, die al getraind zijn op grote hoeveelheden data, beschikken over uitgebreide kennis en kunnen verschillende taken uitvoeren, zoals het genereren van tekst, het vertalen van talen en het schrijven van verschillende soorten creatieve content. Om de output van de LLM verder aan te passen aan specifieke taken of domeinen, maken organisaties gebruik van technieken zoals prompt engineering, retrieval-augmented generation (RAG) en fine-tuning. Prompt engineering omvat het maken van duidelijke en beknopte instructies die de LLM naar het gewenste resultaat leiden, terwijl RAG het model baseert op aanvullende informatie van externe data bronnen, waardoor de prestaties en relevantie worden verbeterd. Bij fine-tuning worden de parameters van de LLM aangepast met behulp van extra data die specifiek zijn voor de behoeften van de organisatie. Het onderstaande schema geeft een overzicht van de LLMOps workflow en laat zien hoe deze technieken in het algemene proces geïntegreerd zijn.

Waarom we LLMOps nodig hebben

De snelle vooruitgang in de LLM-technologie heeft verschillende operationele uitdagingen aan het licht gebracht die een gespecialiseerde aanpak vereisen.

Enkele van deze uitdagingen zijn :

De behoefte aan maatwerk: Hoewel LLM's vooraf getraind zijn op enorme hoeveelheden data, is aanpassing essentieel voor optimale prestaties bij specifieke taken. Dit heeft geleid tot de ontwikkeling van nieuwe aanpassingstechnieken, zoals snelle engineering, ophalen-ondersteund genereren (RAG) en fijnafstemming. RAG helpt het model om zich te baseren op de meest nauwkeurige informatie door het te voorzien van een externe kennisbank, terwijl fijnafstemming meer geschikt is als we willen dat het model specifieke taken uitvoert, of zich houdt aan een bepaald antwoordformaat zoals JSON of SQL. De keuze tussen RAG en fine-tuning hangt af van de vraag of we de kennis van het model willen vergroten of de prestaties ervan in een specifieke taak willen verbeteren.

API-wijzigingen: In tegenstelling tot traditionele ML-modellen, zijn LLM's vaak toegankelijk via API's van derden, die kunnen worden gewijzigd of zelfs afgeschaft, waardoor voortdurende controle en aanpassing nodig is. Bijvoorbeeld, Open AI's documentatie vermeldt expliciet dat hun modellen regelmatig worden bijgewerkt, waardoor gebruikers mogelijk hun software moeten bijwerken of moeten migreren naar nieuwere modellen of eindpunten.

Data afwijking, verwijst naar een verschuiving in de statistische eigenschappen van input data, die vaak optreedt in de productie wanneer de aangetroffen data afwijkt van de data waarop de LLM's getraind zijn. Dit kan leiden tot het genereren van onnauwkeurige of verouderde informatie. Bij het GPT-3.5-model was de informatie bijvoorbeeld beperkt tot september 2021 voordat de sluitingsdatum werd verlengd tot januari 2022. Daardoor kon het vragen over recentere gebeurtenissen niet beantwoorden, wat leidde tot frustratie bij gebruikers.

Modelevaluatie: Bij traditioneel machinaal leren vertrouwen we op metrieken als acccuracy, precision en recall om onze modellen te beoordelen. Het evalueren van LLM's is echter aanzienlijk ingewikkelder, vooral bij het ontbreken van ground truth data en wanneer we te maken hebben met natuurlijke taaluitvoer in plaats van numerieke waarden.

Bewaking: Voortdurende bewaking van LLM's en op LLM gebaseerde toepassingen is van cruciaal belang. Het is ook gecompliceerder omdat er meerdere aspecten bij komen kijken die overwogen moeten worden om de algehele effectiviteit en betrouwbaarheid van deze taalmodellen te garanderen. We zullen deze aspecten in meer detail bespreken in het volgende gedeelte.

Hoe LLMOps deze uitdagingen aanpakt

LLMOps bouwt voort op het fundament van MLOps en introduceert gespecialiseerde onderdelen op maat van LLM's :

Snel engineering- en afstemmingsbeheer: LLMOps biedt hulpmiddelen zoals snelle versiebeheersystemen om verschillende versies van prompts bij te houden en te beheren. Het integreert ook met kaders verfijnen om het fine-tuning proces te automatiseren en te optimaliseren. Een prominent voorbeeld van deze hulpmiddelen is LangSmith, een framework dat speciaal is ontworpen voor het beheer van LLM-workflows. De uitgebreide functies omvatten prompt versiebeheer, waardoor gecontroleerde experimenten en reproduceerbaarheid mogelijk zijn. LangSmith vergemakkelijkt bovendien fijnafstemming van LLM's met runs'data na eventuele filtering en verrijking om de modelprestaties te verbeteren.

API-veranderingsbeheer: LLMOps stelt processen vast voor bewaking API wijzigingen, waarschuwen exploitanten voor potentiële onderbrekingen, en rollbacks inschakelen indien nodig.

Modelaanpassing aan veranderende data: LLMOps vergemakkelijkt de aanpassing van LLM's aan evoluerende data-landschappen, door ervoor te zorgen dat modellen relevant en performant blijven als data-patronen verschuiven. Dit kan worden bereikt door bewaking van data-distributies en het in gang zetten van aanpassingsprocessen wanneer er significante veranderingen worden gedetecteerd. Deze processen kunnen het volgende omvatten:

-> Omscholing of afstemming: Afhankelijk van de mate van data drift en de beschikbare middelen, kan herscholing of fijnafstelling worden toegepast om de gevolgen te beperken.

-> Domeinaanpassing: Fijnafstemming van de LLM op een dataset van het doeldomein.

-> Destillatie van kennis: Een kleiner model trainen door gebruik te maken van de kennis en expertise van een groter, krachtiger, up-to-date model.

LLM-specifieke evaluatie: LLMOps gebruikt nieuwe evaluatie-instrumenten die aangepast zijn aan LLLM's. Deze omvatten:

-> Op tekst gebaseerde statistieken, Zoals perplexiteit; een statistische maat voor hoe goed het model het volgende woord in een reeks kan voorspellen. Net als BLEU- en ROUGE-metriek, die machinaal gegenereerde tekst vergelijken met een of meer referentieteksten die door mensen zijn gegenereerd. Ze worden vaak gebruikt voor vertaal- en samenvat taken.

-> Inbeddingen analyseren (vectorrepresentaties voor woorden of zinnen), om het vermogen van het model te beoordelen om contextspecifieke woorden te begrijpen en semantische overeenkomsten vast te leggen. Visualisatie- en clusteringstechnieken kunnen ons ook helpen bij het detecteren van vertekeningen.

-> Evaluator LLM's: Andere LLM's gebruiken om ons model te evalueren. Dit kan bijvoorbeeld worden gedaan door een score toe te kennen aan de uitvoer van het geëvalueerde model op basis van vooraf gedefinieerde metriek, zoals vloeiendheid, samenhang, relevantie en feitelijke nauwkeurigheid.

-> Integratie van menselijke feedback: LLMOps bevat mechanismen voor het verzamelen en opnemen van menselijke feedback in de ML-levenscyclus, waardoor de prestaties van LLM worden verbeterd en vooroordelen worden aangepakt.

TruLens is een hulpmiddel dat integratie van deze evaluaties in LLM-toepassingen mogelijk maakt via een programmatische aanpak die bekend staat als Feedbackfuncties.

LLM-specifieke bewaking: LLMOps integreert continue bewaking om de prestatiecijfers van LLM bij te houden, mogelijke problemen te identificeren en conceptdrift of vooringenomenheid te detecteren. Dit omvat:

-> Functionele bewaking; door het aantal aanvragen, de responstijd, het tokengebruik, het foutenpercentage en de kosten bij te houden.

-> Prompt toezicht; om de leesbaarheid te garanderen en om toxiciteit en andere vormen van misbruik op te sporen. W&B-prompts is een set hulpmiddelen die is ontworpen voor het bewaken van LLM-gebaseerde toepassingen. Het kan worden gebruikt om de invoer en uitvoer van uw LLM's te analyseren, de tussenresultaten te bekijken en uw prompts veilig op te slaan en te beheren.

-> Responscontrole; om de relevantie en consistentie van het model te garanderen. Dit omvat het voorkomen van het genereren van hallucinante of fictieve inhoud, evenals het garanderen van de uitsluiting van schadelijk of ongepast materiaal. Transparantie kan ons helpen om het antwoord van het model beter te begrijpen. Dit kan worden bewerkstelligd door antwoordbronnen te onthullen (in RAG) of door het model te vragen om zijn redenering te rechtvaardigen (denkketen).

Deze monitoring data kan gebruikt worden om de operationele efficiëntie te verbeteren. We kunnen het kostenbeheer verbeteren door waarschuwingen over tokengebruik te implementeren en strategieën toe te passen zoals het cachen van eerdere antwoorden. Hierdoor kunnen we deze hergebruiken voor soortgelijke query's zonder de LLM opnieuw aan te roepen. Daarnaast kunnen we de latentie minimaliseren door waar mogelijk voor kleinere modellen te kiezen en het aantal gegenereerde tokens te beperken.

Conclusie

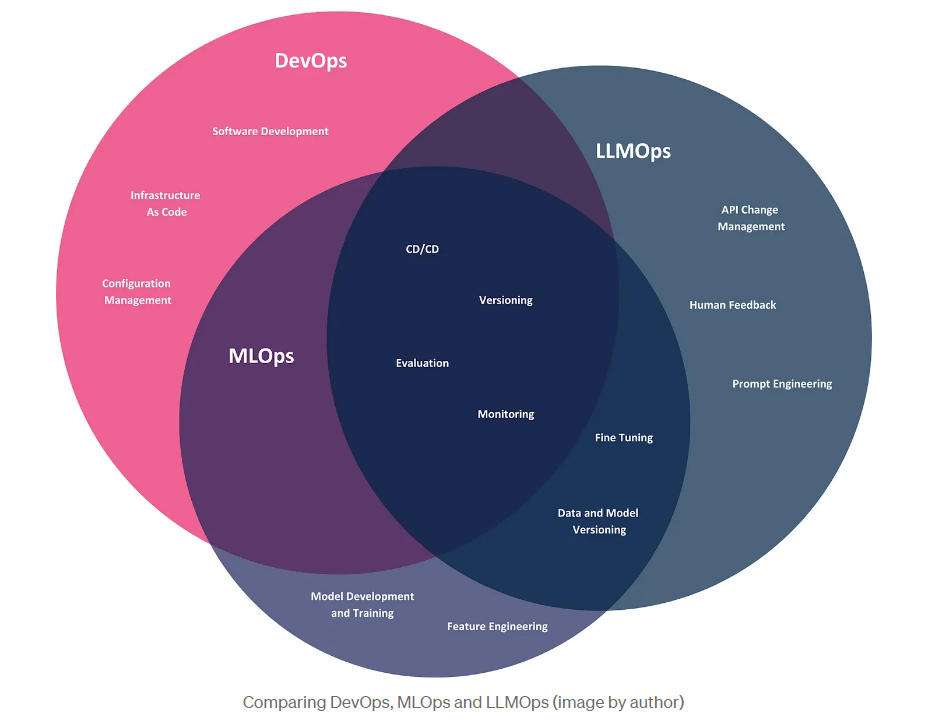

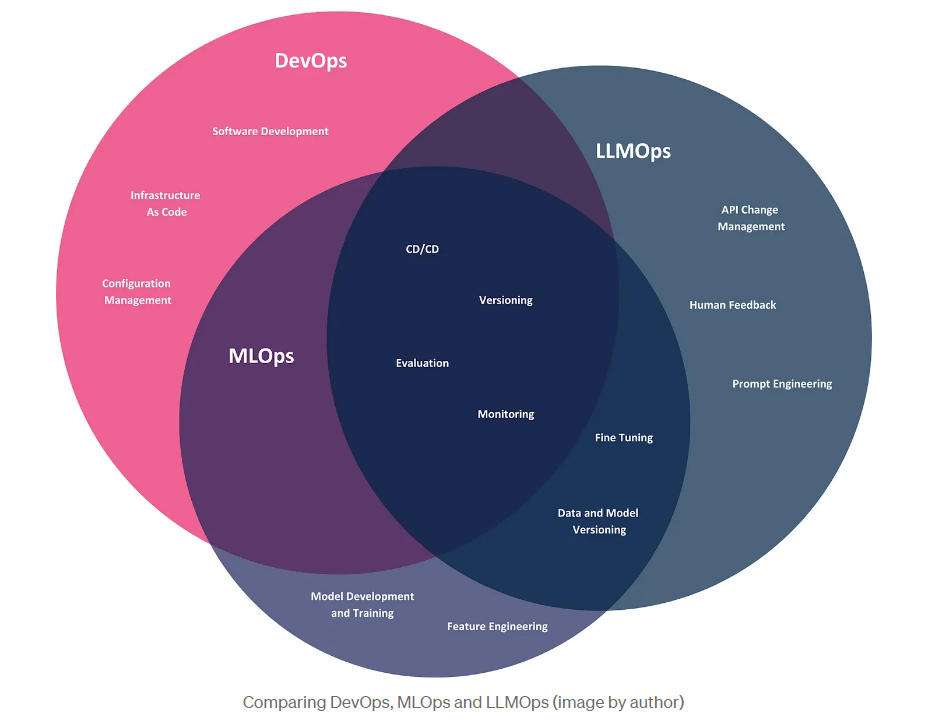

In dit artikel onderzochten we de opkomst van LLMOps, een afstammeling van DevOps en MLOps, speciaal ontworpen om de operationele uitdagingen van grote taalmodellen aan te pakken. Laten we afsluiten met een visuele vergelijking van deze drie methodologieën, waarbij we hun reikwijdte illustreren binnen de context van bedrijven die gebruik maken van LLM, die deze modellen gebruiken om producten te maken en bedrijfsproblemen op te lossen.

Hoewel de drie methodologieën gemeenschappelijke praktijken delen, zoals CI/CD, versiebeheer en evaluatie, hebben ze elk hun eigen aandachtsgebieden. DevOps omvat de volledige levenscyclus van softwareontwikkeling, van ontwikkeling tot implementatie en onderhoud. MLOps breidt DevOps uit om de specifieke uitdagingen van machine-learningmodellen aan te pakken, waaronder het automatiseren van modeltraining, implementatie en bewaking. LLMOps, de nieuwste iteratie van deze methodologieën, richt zich specifiek op LLM's. Hoewel LLM-gebruikers hun eigen modellen niet hoeven te ontwikkelen, hebben ze nog steeds te maken met operationele uitdagingen, zoals het beheren van API-wijzigingen en het aanpassen van modellen via technieken zoals prompt engineering en fine-tuning.

BLOG

BLOG