Dieser Artikel wurde von Artefact-Experten in Zusammenarbeit mit der French Tech Corporate Community für den Medium-Blog geschrieben.

Die Fülle und Vielfalt der Reaktionen auf ChatGPT und andere generative KI, ob skeptisch oder enthusiastisch, zeigen die Veränderungen, die sie mit sich bringen, und die Auswirkungen, die sie weit über die üblichen Technologiekreise hinaus haben. Dies steht in krassem Gegensatz zu früheren Generationen von KI, die im Wesentlichen prädiktiv waren und in der Regel Gegenstand von Artikeln oder Thesen waren, die sich auf den Bereich der Forschung und Innovation beschränkten.

Für Unternehmen unterscheidet sich die generative KI auch von früheren artificial intelligences. Wenn wir sie mit den ähnlichsten Technologien vergleichen, wie z.B. der natürlichen Sprachverarbeitung (NLP) für Textkorpora oder der Computer Vision für audiovisuelle data, bringt die generative KI vier wesentliche Veränderungen mit sich, derer sich die Unternehmen bewusst werden, während sie mit ihnen experimentieren.

Erstens beschleunigt die generative KI im Vergleich zur bisherigen KI den Einsatz von Anwendungsfällen in dem Sinne, dass sie den Proof of Concept beschleunigt. Zweitens eröffnen sie neue Möglichkeiten, indem sie eine einfachere, effizientere und weniger kostspielige Anreicherung von unstrukturierten data ermöglichen. Darüber hinaus sind die mit generativer KI erzielten Ergebnisse in Bezug auf Qualität, Quantität und Vielfalt neuartig im Vergleich zu den bisher verwendeten Modellen. All diese Faktoren bedeuten, dass wir uns mit den gestiegenen Erwartungen der Endnutzer auseinandersetzen müssen, die durch den Hype um diese Technologie angeheizt wurden. Wir erläutern diese vier Punkte im Folgenden.

Generative KI ermöglicht ein schnelleres Testen des Mehrwerts von Anwendungsfällen

Im Bereich der generativen KI ist die Entwicklung von Anwendungsfällen oft schneller und weniger arbeitsintensiv als bei bisherigen KI-Lösungen. Der Ansatz der generativen KI wird häufig mit dem Zusammenbau von Legos verglichen, bei dem bereits vorhandene Komponenten kombiniert werden können, um neue Ergebnisse zu erzielen. Diese Leichtigkeit des Experimentierens und der Implementierung kann kürzere Entwicklungszyklen ermöglichen. Außerdem beschleunigt die Interaktion mit dem Benutzer die Akzeptanz.

Ein data Anwendungsfall lässt sich auf ein Geschäftsproblem, data, ein Modell und eine Eingabeaufforderung reduzieren. Traditionell ist das Erstellen und Optimieren des Modells der komplexeste und zeitaufwändigste Teil des Prozesses. Mit generativer KI wird dieser Schritt einfacher. Generative KI bietet vorgefertigte, gebrauchsfertige Modelle, so dass Unternehmen von fortgeschrittenem Fachwissen profitieren können, ohne viel Zeit in die Entwicklung und Verfeinerung von Modellen zu investieren. In der Praxis sind die Modelle (wie GPT 4.0 von Azure) “on-demand” verfügbar oder können über APIs bereitgestellt werden (wie Gemini Pro BARD von Google). Einige Anbieter bieten sogar speziell abgestimmte Modelle für bestimmte Bereiche an, z. B. für die Erstellung von Texten aus den Bereichen Recht, Medizin oder Finanzen.

Sobald das Modell eingesetzt wird, besteht die einzige verbleibende Aufgabe darin, das generative KI-Modell zu “erden”, d.h. die vom Modell erzeugten Ergebnisse mit Informationen aus der realen Welt zu verknüpfen, um das Modell zu zwingen, innerhalb eines bestimmten Rahmens zu reagieren. Dies beinhaltet oft das Hinzufügen von Einschränkungen oder zusätzlichen Informationen, um das Modell zu Ergebnissen zu führen, die in einem bestimmten Kontext kohärent und relevant sind. Dies ist jedoch weit entfernt von der Zeit, die wir für das Training der KI-Modelle benötigen, die wir bisher verwendet haben.

Nehmen wir zur Veranschaulichung das Beispiel eines Anwendungsfalls zur Analyse des Wortlauts in einem Callcenter. Laut einer Artefact-Studie dauerte die Entwicklung dieser Art von Anwendungsfall mit Modellen, die auf früherer KI basierten, in der Regel drei bis vier Wochen ab dem Zeitpunkt, an dem die data abgerufen und nutzbar gemacht wurde. Heute dauert dieser Prozess dank der generativen KI nur noch eine Woche, was einen Beschleunigungsfaktor von mehr als drei bedeutet. Die größte Herausforderung besteht darin, die geeignete Geschäftsklassifizierung für die Anpassung des Modells zu wählen.

Generative KI erweitert den Anwendungsbereich der KI auf bisher wenig oder falsch genutzte data

Einige Ölfelder sind nur profitabel, wenn die Ölpreise in die Höhe schießen. Das gleiche Prinzip kann auf data angewendet werden. Bestimmte unstrukturierte data können jetzt dank generativer KI abgebaut werden. Damit eröffnet sich ein ganz neues Feld nutzbarer data für das Training oder die Feinabstimmung von Modellen und bietet zahlreiche Perspektiven für Anwendungen, die sich auf bestimmte Bereiche spezialisieren.

Und es gibt ein neues Versprechen: das der generativen KI, die in der Lage ist, jede Art von data in ihren Trainingsprozessen zu verarbeiten und zu kombinieren und dabei die zeitraubende und mühsame Arbeit der Strukturierung und Verbesserung der Qualität von data des Unternehmens zu umgehen, um sie nutzbar zu machen. Ein Versprechen, das nach den derzeitigen Beobachtungen noch nicht eingelöst ist.

Die generative KI hat nicht nur von einem echten Durchbruch bei den Aufmerksamkeitsmechanismen profitiert. Sie hat auch von der ständig wachsenden - und notwendigen - Leistung von Maschinen profitiert.

Aufmerksamkeitsmechanismen funktionieren ähnlich wie die Fähigkeit eines Menschen, sich auf einen wichtigen Teil eines Bildes oder Textes zu konzentrieren, wenn er versucht, etwas zu verstehen oder zu erschaffen. Stellen Sie sich vor, Sie versuchen, eine Landschaft von einem Foto zu zeichnen. Anstatt das ganze Bild auf einmal zu betrachten, konzentrieren Sie sich auf bestimmte Teile, die Ihnen wichtig erscheinen, wie Berge oder Bäume. So können Sie wichtige Details besser erkennen und eine genauere Zeichnung erstellen. In ähnlicher Weise ermöglichen Aufmerksamkeitsmechanismen dem Modell, sich bei der Erstellung von Inhalten auf bestimmte Teile eines Bildes oder Textes zu konzentrieren. Anstatt die gesamte Eingabe auf einmal zu verarbeiten, kann sich das Modell auf die relevantesten und wichtigsten Teile konzentrieren, um genauere und aussagekräftigere Ergebnisse zu erzielen. So kann es lernen, Bilder, Text oder andere Arten von Inhalten effizienter und realistischer zu erstellen.

Aufmerksamkeitsmechanismen lassen sich sehr gut parallelisieren. Die Verwendung mehrerer Aufmerksamkeitsmechanismen bietet eine reichhaltigere und robustere Darstellung von data, was zu einer besseren Leistung bei verschiedenen Aufgaben wie maschineller Übersetzung, Texterzeugung, Sprachsynthese, Bilderzeugung und vielen anderen führt.

Infolgedessen sind Anwendungsfälle, die vor nicht allzu langer Zeit noch unmöglich schienen, nun vollständig zugänglich geworden. Das gilt zum Beispiel für die Berechnung der Redezeit in den Medien während des Präsidentschaftswahlkampfs. Noch vor zwei Jahren war die genaue Berechnung der Redezeit der einzelnen Kandidaten ein mühsames Unterfangen. Heute ist dies dank der generativen KI möglich.

Was die Rechenkapazitäten angeht, hat OpenAI vor sechs Jahren eine Analyse veröffentlicht, aus der hervorgeht, dass der Rechenaufwand für die wichtigsten KI-Trainingseinheiten seit 2012 exponentiell gestiegen ist, mit einer Verdopplungszeit von 3,4 Monaten (zum Vergleich: Moore's Law hatte eine Verdopplungszeit von zwei Jahren). Seit 2012 hat sich dieses Maß um mehr als das 300.000-fache erhöht (eine Verdopplungszeit von zwei Jahren würde nur eine Versiebenfachung bedeuten).

Generative KI-Modelle benötigen oft enorme Mengen an Rechenleistung für das Training, insbesondere da die Modelle so konzipiert sind, dass sie generalistisch sind und große Mengen an Inhalten für das Training benötigen. Für die Verarbeitung großer data-Sets und die Ausführung komplexer Optimierungsalgorithmen werden leistungsstarke Rechenressourcen wie High-End-GPUs oder TPUs benötigt. Die neue NVIDIA A100 Tensor Core GPU scheint eine noch nie dagewesene Beschleunigung zu bieten. Laut Nvidia bietet der A100 eine bis zu 20 Mal höhere Leistung als die vorherige Generation und kann in sieben GPU-Instanzen partitioniert werden, um sich dynamisch an wechselnde Anforderungen anzupassen. Berichten zufolge bietet sie außerdem die weltweit schnellste Speicherbandbreite mit über zwei Terabyte pro Sekunde (TB/s) für die Ausführung der größten Modelle und data-Sets.

Es sei darauf hingewiesen, dass Verbesserungen in der Datenverarbeitung ein Schlüsselelement für den Fortschritt von artificial intelligence waren. Solange dieser Trend anhält, sollten wir auf die Auswirkungen von Systemen vorbereitet sein, die weit über die heutigen Möglichkeiten hinausgehen und die Grenzen weiter verschieben werden. Dabei müssen wir den Wert, den diese Systeme bringen, gegen die Kosten abwägen, die sie verursachen, insbesondere in Bezug auf Energie und Umwelt. Wir werden diese Punkte in einem zukünftigen Artikel diskutieren.

Generative KI verbessert die Vielfalt, Qualität und Quantität der erzielten Ergebnisse

Generative KI unterscheidet sich deutlich von früherer KI durch ihre Auswirkungen auf die von ihren Modellen erzeugten Ergebnisse. Nicht nur die Quantität der erzeugten Ergebnisse ist gestiegen, sondern auch ihre Qualität und Vielfalt. All diese positiven Aspekte müssen jedoch durch eine geringere Reproduzierbarkeit der generativen KI-Modelle relativiert werden.

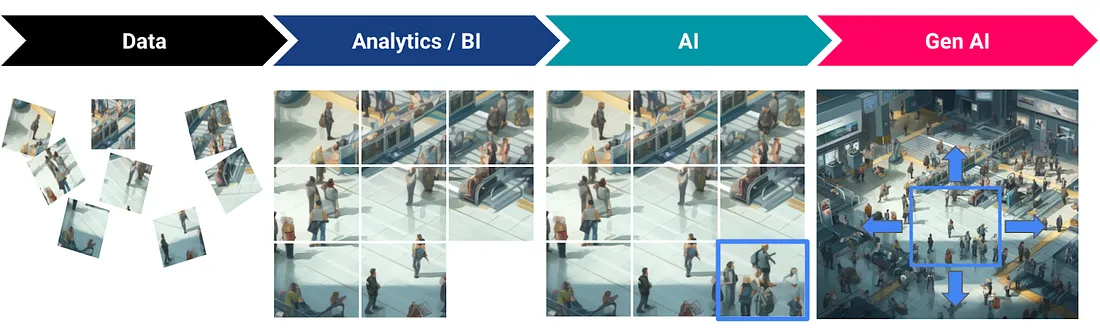

Betrachten wir das Bild eines Puzzles, so kann die Analyse von data mit dessen Zusammenbau verglichen werden, bei dem jedes Teil von data ein Teil darstellt, das zu einem kohärenten Bild zusammengesetzt werden muss. Die KI spielt eine entscheidende Rolle bei dem Versuch, das fehlende data zu ergänzen, indem sie die verfügbaren Informationen nutzt, um die fehlenden Teile abzuleiten und neu zu erstellen. Generative KI geht über die bloße Vervollständigung bestehender data hinaus, indem sie neue data schafft, die von dem inspiriert sind, was bereits existiert. Dieser Prozess erweitert die Analysemöglichkeiten und ermöglicht die Entdeckung neuer Informationen aus bestehenden data, wodurch der generative Aspekt in den Vordergrund rückt.

Im Gegensatz zu früheren KI-Generationen, die dazu neigen, oft ähnliche Ergebnisse zu produzieren, sind generative KI-Modelle in der Lage, eine größere Vielfalt an Ergebnissen zu erzeugen, indem sie verschiedene Varianten und Alternativen erkunden. Diese größere Vielfalt macht es möglich, reichhaltigere, abwechslungsreichere Inhalte zu generieren, die vom quantitativen zum qualitativen Bereich übergehen und ein breiteres Spektrum an Bedürfnissen und Vorlieben abdecken.

OpenAI war kürzlich in Hollywood, um sein neuestes Modell namens “Sora” vorzustellen, das Videos aus Text generieren kann. “Zu hören, dass es all diese Dinge kann, ist eine Sache, aber die Fähigkeiten tatsächlich zu sehen, war erstaunlich”, sagte Hollywood-Produzent Mike Perry und hob die Vielfalt und Qualität der Fähigkeiten hervor, die die generative KI bietet.

Da generative KI-Modelle jedoch einen größeren Möglichkeitsraum erforschen können, sind sie weniger reproduzierbar als frühere KI-Modelle, und die Genauigkeit der Ergebnisse ist beeinträchtigt. Konkret bedeutet dies, dass es schwieriger ist, bei jedem Durchlauf des Modells genau dieselben Ergebnisse zu reproduzieren, was bei bestimmten geschäftskritischen Anwendungen zu Problemen in Bezug auf Zuverlässigkeit und Vorhersagbarkeit führen kann.

Diese Einschränkung stellt eine große Herausforderung für Anwendungen der generativen KI dar, die präzise Antworten erfordern. Und es ist ein Bereich, an dem Unternehmen in ihren aktuellen Entwicklungen arbeiten: um Modelle in hochspezifischen Bereichen besser zu spezialisieren, um die Genauigkeit der Antworten zu verbessern, und um die Robustheit von regelbasierten Modellen oder Abfragen auf strukturierten data mit der Benutzerfreundlichkeit und Interaktion mit den Nutzern generativer KI zu kombinieren, indem letztere mit den Ausgaben der ersteren verbunden werden.

Gestiegene Erwartungen der Endverbraucher

Wenn es darum geht, die Erwartungen und die Beziehung der Endnutzer zur Technologie zu managen, stellt generative KI einige besondere Herausforderungen dar. Aufgrund ihrer Fähigkeit, schnell Ergebnisse zu erzielen, kann generative KI besonders hohe Erwartungen wecken. Umgekehrt kann das Auftreten von Halluzinationen und unerwünschten Ergebnissen das Vertrauen der Benutzer in diese Lösungen stark untergraben.

Generative KI ist in der Lage, schnell und automatisiert Ergebnisse zu liefern, was bei den Endnutzern den Eindruck erwecken kann, dass die Technologie alle ihre Probleme sofort und effizient lösen kann. Dies kann zu unverhältnismäßig hohen Erwartungen an die tatsächlichen Fähigkeiten der generativen KI führen und zu Enttäuschungen, wenn die Ergebnisse diese hohen Erwartungen nicht vollständig erfüllen.

Generative KI ist natürlich nicht perfekt und kann manchmal unerwartete oder unerwünschte Ergebnisse produzieren, wie z. B. inkonsistente, falsche oder unangemessene Inhalte. Das Auftreten solcher unerwünschten Ergebnisse kann dazu führen, dass der Endnutzer das Vertrauen in die Technologie verliert und ihre Zuverlässigkeit und Nützlichkeit in Frage stellt. Es kann auch Bedenken hinsichtlich der data Sicherheit und des Datenschutzes aufkommen lassen, wenn unerwartete Ergebnisse die Integrität der durch generative KI erzeugten Informationen gefährden.

Im Februar 2023 gab der Chatbot Bard von Google (umbenannt in Gemini) falsche Informationen, als er nach den Entdeckungen des James Webb Space Telescope der NASA gefragt wurde. Er behauptete fälschlicherweise, das Teleskop habe die ersten Fotos eines Exoplaneten aufgenommen. Diese Aussage ist falsch, denn die ersten Fotos eines Exoplaneten stammen aus dem Jahr 2004, während das James Webb Teleskop erst 2021 gestartet wurde (Quelle: CNET France Team, 2024).

Es ist daher von entscheidender Bedeutung, dass sich die Endnutzer generativer KI-Systeme ihrer Grenzen bewusst sind. Daher bemühen sich die meisten Unternehmen, die diese Lösungen einsetzen, die Benutzer bei der Nutzung zu unterstützen: Schulung in der Kunst der Eingabeaufforderung, Erläuterung der Grenzen dieser Systeme, Klärung, welche Erwartungen erfüllt werden können und welche nicht, und Erinnerung an die geltenden Regeln in Bezug auf den data-Schutz.

Mehr als ein Jahr nach der Veröffentlichung von ChatGPT sind die Erwartungen an diese neue Technologie so hoch wie eh und je. Der mit ihr verbundene Nutzen muss sich jedoch erst noch in konkreten Anwendungsfällen zeigen. In unserem nächsten Artikel werden wir uns mit den Themen befassen, die mit der Einführung der Technologie in Unternehmen zusammenhängen und wie sie im gesamten Unternehmen verbreitet wird.

Unter der Leitung von:

BLOG

BLOG