Cloud y certificaciones

Impulsamos tu negocio con cloud flexible y segura, acompañándote desde la migración hasta la optimización.

Impulsa tu negocio con Cloud .

En una era de rápida transformación digital, cloud es esencial para mantener la competitividad. Cloud proporcionan la infraestructura escalable y segura que su empresa necesita para adaptarse rápidamente a las cambiantes exigencias del mercado.

Tanto si está migrando a la cloud, optimizando su entorno actual o creando una solución híbrida, nuestros completos servicios de consultoría le ayudarán a alcanzar la flexibilidad y la agilidad necesarias para prosperar.

Una Cloud ofrece una mayor escalabilidad, rentabilidad y una mejor colaboración.

Nuestros AI Cloud en AI .

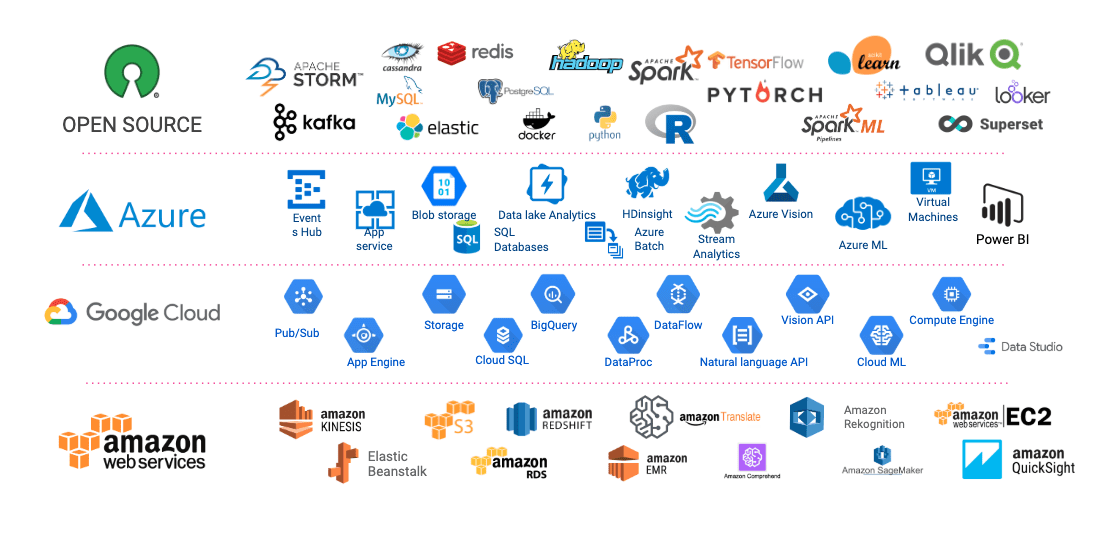

No nos limitamos a una tecnología concreta, sino que trabajamos con todo tipo de infraestructuras de los clientes, ya sean cloud, híbridas o locales.

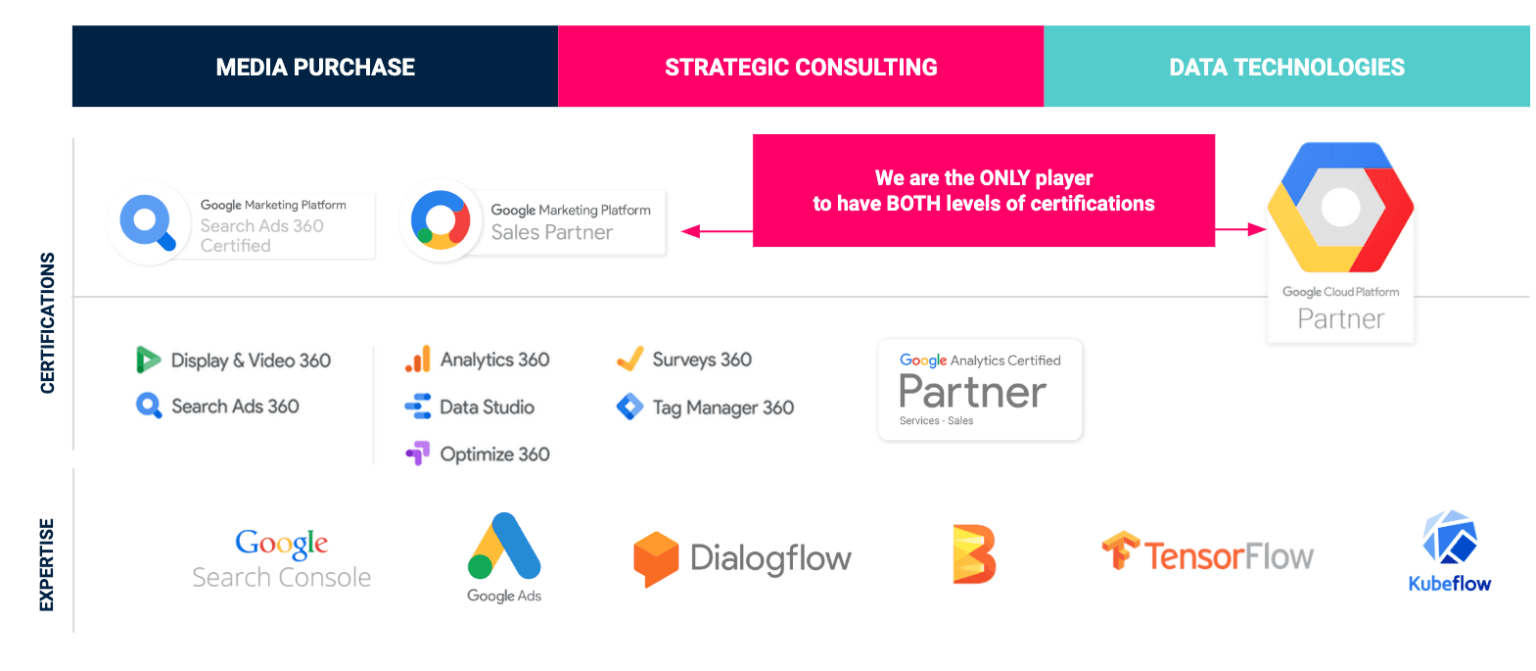

Artefact socio certificado de ambas plataformas de Google:

Google Marketing Platform (GMP) y Google Cloud (GCP).

Presentamos SKAFF, nuestra plataforma de código abierto de AI .

SKAFF se compone de AI independientes y reutilizables. Estos aceleradores pueden compararse con piezas de Lego, ya que cada una de ellas realiza una tarea concreta, como conectores, bibliotecas y modelos predefinidos.

Hemos agrupado estos «módulos» para que puedan reutilizarse según sea necesario, de modo que nuestros clientes puedan configurarlos y montarlos de forma eficiente. Nuestra solución se integra a la perfección en los sistemas heredados existentes, lo que permite una rápida escalabilidad y potencia data .

Artículos del blog Medium escritos por nuestros expertos en tecnología

¿ AI el futuro de AI agentiva de los grafos de conocimiento?

A medida que las empresas se apresuran a poner en práctica AI, la mayoría descubre que su data nunca se diseñó para el razonamiento autónomo. Hoy en día, hasta el 80 % de AI ...

Mejorar la experiencia del bricolaje: cómo ADEO utiliza AI conectar contenidos y conocimientos

La optimización del surtido es un proceso fundamental en el sector minorista que consiste en seleccionar la combinación ideal de productos para satisfacer la demanda de los consumidores, teniendo en cuenta los numerosos aspectos logísticos...

MotherDuck al detalle: cómo encaja esta solución AI análisis de última generación en tu Data

MotherDuck amplía el rendimiento analítico de DuckDB a la cloud funciones colaborativas, ofreciendo un rendimiento cuatro veces superior al de BigQuery y un ahorro de costes respecto a data tradicionales gracias a...

Optimización de surtidos con modelos de elección discreta en Python

La optimización del surtido es un proceso fundamental en el sector minorista que consiste en seleccionar la combinación ideal de productos para satisfacer la demanda de los consumidores, teniendo en cuenta los numerosos aspectos logísticos...

¿Es la alineación de preferencias siempre la mejor opción para mejorar la traducción basada en modelos de lenguaje grande? Un análisis empírico

Las métricas neuronales para la evaluación de la traducción automática (MT) han cobrado cada vez más importancia debido a su mayor correlación con las valoraciones humanas en comparación con las métricas léxicas tradicionales

Choice-Learn: Modelización de decisiones a gran escala para contextos operativos desde la perspectiva del aprendizaje automático

Los modelos de elección discreta tienen como objetivo predecir las decisiones que toman las personas al elegir entre un conjunto de alternativas, denominado «surtido». Entre los casos de uso más conocidos se encuentra la predicción de...

La era de AI generativa: qué está cambiando

La abundancia y diversidad de las reacciones ante ChatGPT y otras IA generativas, ya sean escépticas o entusiastas, ponen de manifiesto los cambios que están provocando y el impacto...

Cómo Artefact consiguió desarrollar un sistema de carrera justo y sencillo para los ingenieros de software.

En el dinámico y siempre cambiante sector tecnológico actual, la trayectoria profesional puede parecer a menudo un camino sinuoso que atraviesa un denso bosque de oportunidades. Con los rápidos...

Por qué necesita LLMOps

Este artículo presenta LLMOps, una rama especializada que fusiona DevOps y MLOps para gestionar los retos que plantean los grandes modelos lingüísticos (LLM)...

Liberar la potencia del lenguaje de expresión LangChain (LCEL): de la prueba de concepto a la producción

LangChain se ha convertido en menos de un año en una de las bibliotecas de Python más utilizadas para interactuar con los modelos de lenguaje grande (LLM), pero LangChain era principalmente una biblioteca...

Cómo gestionamos la conciliación de ID de perfiles utilizando Treasure Data y SQL

En este artículo explicamos los retos que plantea la conciliación de identificadores y mostramos nuestro enfoque para crear un identificador de perfil unificado en Data de clientes, concretamente...

Snowday ’23 de Snowflake: un efecto bola de nieve hacia el éxito en Data

Al reflexionar sobre las ideas compartidas durante el evento «Snowday», celebrado los días 1 y 2 de noviembre, surge una cascada de revelaciones apasionantes sobre el futuro de...