Artefact Research Center

Acortando la brecha entre la academia y las aplicaciones industriales.

Investigación sobre modelos más transparentes y éticos para fomentar la adopción del modelo AI por parte de las empresas.

Ejemplos de sesgos AI

- AppleCard otorga hipotecas basadas en criterios racistas

- Lensa AI sexualiza los selfies de women

- Clasificación racista de imágenes de Facebook con afroamericanos como monos

- El chatbot de Twitter de Microsoft se volvió nazi, sexista y agresivo

- Los buenos científicos son hombres blancos

Desafío actual

Los modelos AI son precisos y fáciles de implementar en muchos casos de uso, pero siguen siendo incontrolables debido a las «cajas negras» y a cuestiones éticas.

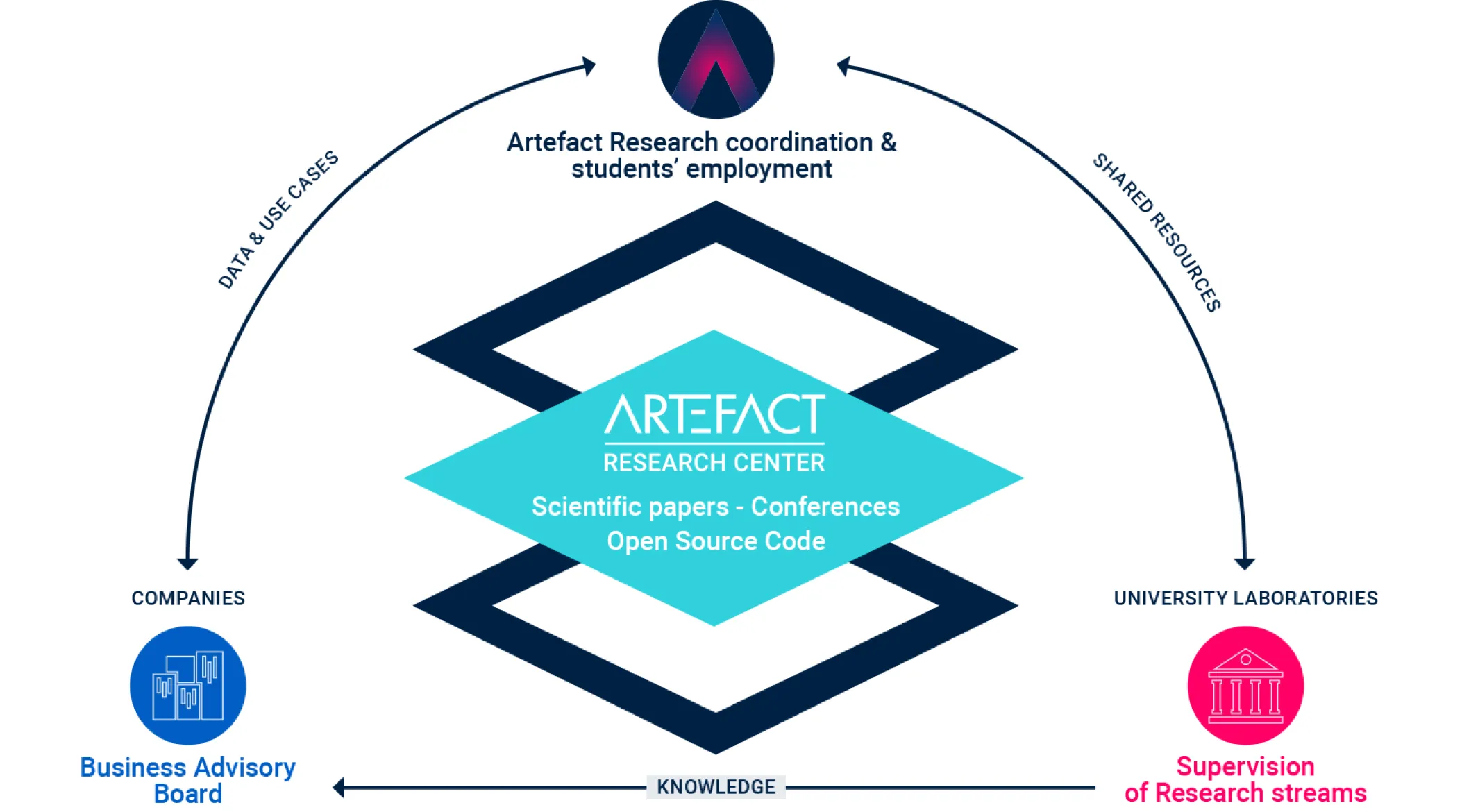

La misión del Artefact y el Research Center.

Un ecosistema completo que une la brecha entre

investigación fundamental y aplicaciones industriales tangibles.

Emmanuel MALHERBE

Jefe de Investigación

Campo de investigación: Aprendizaje Profundo, Aprendizaje Automático

Desde que comenzó su doctorado sobre modelos de PLN adaptados a la selección de personal online, Emmanuel siempre ha buscado un equilibrio eficaz entre la investigación pura y las aplicaciones de gran impacto. Su experiencia en investigación incluye la predicción de series temporales en 5G para Huawei Technologies y modelos de visión artificial para clientes de peluquería y maquillaje en L’Oréal. Antes de incorporarse a Artefact, trabajó en Shanghái como director de investigación de AI para L’Oréal Asia. Hoy en día, su puesto en Artefact es una oportunidad perfecta y un entorno ideal para tender puentes entre el mundo académico y la industria, y para fomentar su investigación aplicada al mundo real al tiempo que influye en las aplicaciones industriales.

Lee nuestras últimas noticias sobre el Artefact y el Research Center

Campos de investigación transversales

Gracias a nuestro posicionamiento único, nuestro objetivo es abordar los retos generales del programa AI, ya sea en el ámbito de la modelización estadística o de la investigación en gestión.

Esas preguntas son transversales a todas nuestras asignaturas y nutren nuestra investigación.

Un ecosistema completo que une la brecha entre la investigación fundamental y las aplicaciones tangibles de la industria.

Asignaturas

Trabajamos en varios temas de doctorado en la intersección de casos de uso industrial y limitaciones de última generación.

Para cada asignatura, colaboramos con profesores universitarios y contamos con acceso a la infraestructura industrial data, lo que nos permite abordar las principales áreas de investigación en un contexto real concreto.

1 — Pronóstico y precios

Modele la serie temporal en su conjunto con un modelo de pronóstico multivariado y controlable. Dicho modelado nos permitirá abordar la planificación de precios y promociones encontrando los parámetros óptimos que aumenten la previsión de ventas. Con un enfoque tan holístico, nuestro objetivo es capturar la canibalización y la complementariedad entre productos. Nos permitirá controlar la previsión con garantías de que las predicciones se mantendrán consistentes.

2 — Puntuación explicable y controlable

Una familia de modelos de aprendizaje automático muy utilizada se basa en los árboles de decisión: los bosques aleatorios y el boosting. Aunque su precisión suele ser de vanguardia, estos modelos adolecen de una sensación de «caja negra», lo que limita el control del usuario. Nuestro objetivo es aumentar su explicabilidad y transparencia, normalmente mejorando la estimación de los valores SHAP en el caso de conjuntos de datos desequilibrados data. También pretendemos ofrecer ciertas garantías para estos modelos, por ejemplo, para muestras ajenas al entrenamiento o mediante la aplicación de mejores restricciones monótonas.

3 — Optimización del surtido

La gestión del surtido es un problema empresarial fundamental para los minoristas que surge a la hora de seleccionar el conjunto de productos que se venderán en las tiendas. Mediante el uso de grandes conjuntos de datos industriales y redes neuronales, nuestro objetivo es crear modelos más sólidos e interpretables que reflejen mejor las decisiones de los clientes ante una variedad de productos. Abordar la canibalización y las complementariedades entre productos, así como comprender mejor los grupos de clientes, es clave para encontrar un conjunto de productos más óptimo en una tienda.

4 — Adopción de AI en las empresas

El reto para lograr una mejor adopción de AI en las empresas consiste, por un lado, en mejorar los modelos AI y, por otro, en comprender los aspectos humanos y organizativos. En la encrucijada entre la investigación cualitativa en gestión y la investigación social, este eje pretende explorar dónde encuentran dificultades las empresas a la hora de adoptar herramientas de AI. Los marcos existentes sobre la adopción de innovaciones no son del todo adecuados para las innovaciones en aprendizaje automático, ya que existen diferencias típicas en materia de regulación, formación del personal o sesgos en lo que respecta a AI, y más aún con el AI generativo.

5 — Sostenibilidad impulsada por Data

El proyecto movilizará métodos de investigación cualitativa y cuantitativa y abordará dos preguntas clave: ¿Cómo pueden las empresas medir eficazmente el desempeño en sostenibilidad social y ambiental? ¿Por qué las medidas de sostenibilidad a menudo no logran generar cambios significativos en las prácticas organizacionales?

Por un lado, el proyecto tiene como objetivo analizar los parámetros data-driven e identificar indicadores que permitan armonizar los procedimientos organizativos con los objetivos de sostenibilidad social y medioambiental. Por otro lado, el proyecto se centrará en convertir estas medidas de sostenibilidad en acciones concretas dentro de las empresas.

6 — Sesgo en visión por computadora

Cuando un modelo realiza una predicción basándose en una imagen —por ejemplo, en la que aparece un rostro—, tiene acceso a información sensible, como el origen étnico, el género o la edad, que puede sesgar su razonamiento. Nuestro objetivo es desarrollar un marco para medir matemáticamente ese sesgo y proponer metodologías para reducirlo durante el entrenamiento del modelo. Además, nuestro enfoque detectaría estadísticamente las zonas de mayor sesgo para explicar, comprender y controlar en qué puntos dichos modelos refuerzan el sesgo presente en el data.

7 — LLM para recuperación de información

Una aplicación importante de los LLM es cuando se combinan con un corpus de documentos, que representan algún conocimiento o información industrial. En tal caso, hay un paso de recuperación de información, para el cual los LLM muestran algunas limitaciones, como el tamaño del texto de entrada, que es demasiado pequeño para indexar documentos. De manera similar, el efecto de alucinación también puede ocurrir en la respuesta final, que pretendemos detectar utilizando el documento recuperado y la incertidumbre del modelo en el momento de la inferencia.

Investigadores a tiempo parcial de Artefact

Además de nuestro equipo dedicado a la investigación, tenemos varios colaboradores que dedican tiempo a la investigación científica y a la publicación de artículos. Al trabajar también como consultores, los inspiramos con problemas del mundo real encontrados con nuestros clientes.

Publicaciones

Artículos de Medium de nuestros expertos en tecnología.

Detectando alucinaciones en LLMs, un token a la vez

Los modelos de lenguaje grandes son asombrosamente capaces. Resumen, traducen, razonan y codifican (mejor que yo). Pero a diferencia de mí, también se han hecho notorios por inventar...

¿Dependerá el futuro de Agentic AI de los grafos de conocimiento?

A medida que las empresas se apresuran a poner en práctica el modelo AI, la mayoría descubre que su infraestructura data nunca se diseñó para el razonamiento autónomo. Hoy en día, hasta el 80% de las implementaciones de AI...

Enriquecer la experiencia del bricolaje: cómo ADEO utiliza AI para conectar contenidos y conocimientos

La optimización del surtido es un proceso crítico en el comercio minorista que implica la curación de la combinación ideal de productos para satisfacer la demanda del consumidor teniendo en cuenta la logística...

MotherDuck al detalle: cómo encaja la solución de análisis y AI de última generación en tu entorno Data

MotherDuck amplía el rendimiento analítico de DuckDB al modelo cloud con funciones colaborativas, ofreciendo un rendimiento cuatro veces superior al de BigQuery y un ahorro de costes respecto a los almacenes de datos tradicionales data gracias a...

Optimización de surtido con modelos de elección discreta en Python

La optimización del surtido es un proceso crítico en el comercio minorista que implica la curación de la combinación ideal de productos para satisfacer la demanda del consumidor teniendo en cuenta la logística...

¿Es la Alineación de Preferencias Siempre la Mejor Opción para Mejorar la Traducción Basada en LLM? Un Análisis Empírico

Las métricas neuronales para la evaluación de la traducción automática (TA) se han vuelto cada vez más prominentes debido a su superior correlación con el juicio humano en comparación con las métricas léxicas tradicionales.

Choice-Learn: Modelado de elección a gran escala para contextos operativos a través de la lente del aprendizaje automático

Los modelos de elección discreta tienen como objetivo predecir las decisiones de elección tomadas por los individuos a partir de un menú de alternativas, llamado surtido. Los casos de uso conocidos incluyen la predicción de un...

La era de la IA generativa AI: qué está cambiando

La abundancia y diversidad de las reacciones ante ChatGPT y otros modelos generativos de IA, ya sean escépticas o entusiastas, ponen de manifiesto los cambios que están provocando y el impacto...

Cómo Artefact logró desarrollar un sistema de desarrollo profesional justo y sencillo para los ingenieros de software

En la dinámica y siempre cambiante industria tecnológica de hoy, una trayectoria profesional a menudo puede sentirse como un camino sinuoso a través de un denso bosque de oportunidades. Con el rápido...

¿Por qué necesitas LLMOps?

Este artículo presenta LLMOps, una rama especializada que fusiona DevOps y MLOps para gestionar los desafíos que plantean los Modelos de Lenguaje Grandes (LLM)...

Desatando el poder del LangChain Expression Language (LCEL): de la prueba de concepto a la producción

LangChain se ha convertido en una de las bibliotecas de Python más utilizadas para interactuar con LLMs en menos de un año, pero LangChain fue principalmente una biblioteca...

Cómo gestionamos la conciliación de ID de perfiles utilizando Treasure Data Unification y SQL

En este artículo explicamos los retos que plantea la conciliación de identificadores y mostramos nuestro enfoque para crear un identificador de perfil unificado en la plataforma Customer Data, concretamente...