Introducción

Desde su irrupción fulgurante a mediados de 2022, AI generativa AI captado rápidamente la atención mundial. Lo que inicialmente se centró en la modalidad del lenguaje se ha expandido desde entonces hacia nuevas y emocionantes vías, incluyendo modelos de imagen, audio y vídeo. A principios de 2023, crecieron las especulaciones sobre el impacto potencial de la tecnología en empresas de diversos sectores, acompañadas de interesantes casos de adopción temprana. A medida que más desarrolladores comenzaron a crear soluciones con estos modelos, la percepción general se desplazó hacia la aparición continua de versiones más nuevas, más grandes y, con suerte, mejores de los modelos más utilizados.

Al entrar en 2024, ha surgido una idea clave: implementar AI simplemente en adoptar el modelo más reciente y de mayor tamaño que haya disponible en el mercado. Aunque es habitual pensar que AI vienen ya preparadas o que aumentar el tamaño del modelo conduce automáticamente a mejores resultados, este enfoque rara vez satisface las necesidades específicas de la mayoría de las empresas. En realidad, las aplicaciones exitosas requieren AI personalizadas, flexibles y eficientes.

Para lograrlo, recurrimos a AI compuestos. A diferencia de los modelos únicos y monolíticos, AI compuestos integran múltiples AI especializados, cada uno de ellos optimizado para una función específica. Esta estructura garantiza un alto grado de personalización, adaptabilidad y precisión, lo que transforma AI una herramienta general en una solución diseñada específicamente para un fin concreto. Al combinar AI más pequeños e interconectados, las empresas pueden alcanzar un rendimiento y unos resultados que superan con creces el alcance de los modelos estándar por sí solos. Por lo tanto, para lograr un impacto empresarial óptimo en todos los sectores, defendemos que una visión estratégica debe dar prioridad a diseños de sistemas más inteligentes en lugar de limitarse a construir modelos más grandes y que requieran mayor capacidad computacional.

Comprender AI compuestos

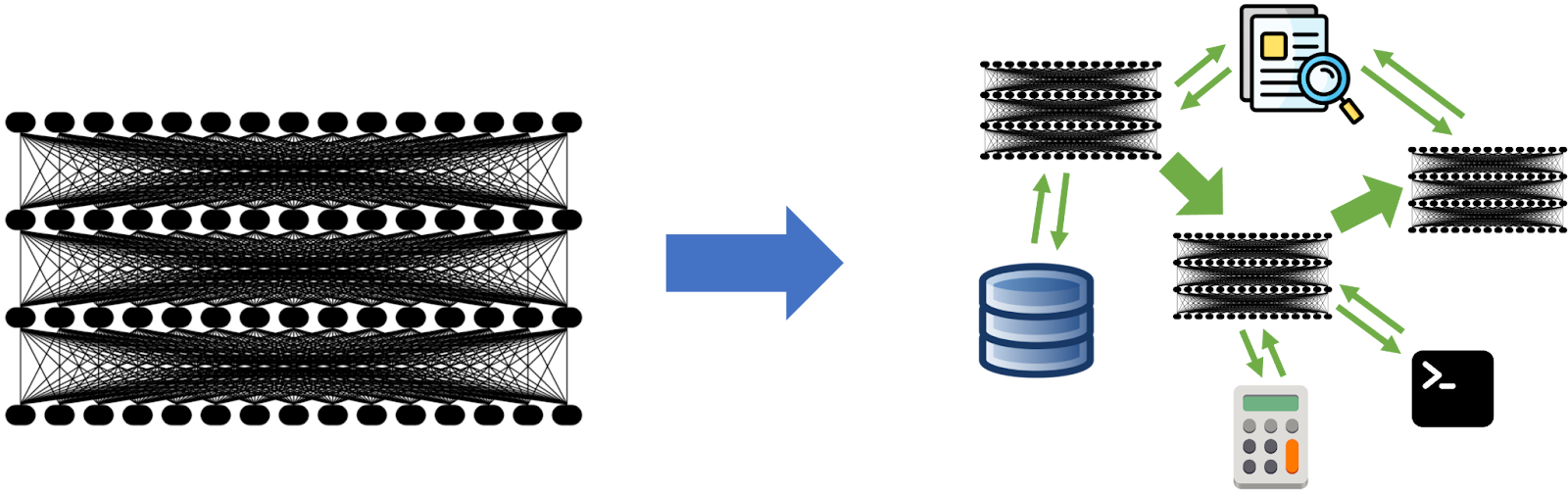

El Laboratorio Inteligencia Artificial de Berkeley (BAIR) define un AI compuesto como un sistema «que aborda AI utilizando múltiples componentes que interactúan entre sí, incluyendo múltiples llamadas a modelos, mecanismos de recuperación de información o herramientas externas». Por ejemplo, el sistema de Generación Aumentada por Recuperación (RAG) es un sistema compuesto que combina un modelo de lenguaje grande (LLM), un mecanismo de recuperación de información y una base de datos vectorizada. Por el contrario, un AI generativa es un modelo estadístico; por ejemplo, un LLM predice el siguiente token en un texto basándose en data de entrenamiento.

En este contexto, un modelo puede considerarse como un único bloque, mientras que un AI compuesto se asemeja más a una máquina formada por múltiples bloques de construcción, cada uno de los cuales cumple una función específica para alcanzar el objetivo general del sistema.

Modelos frente a sistemas AI . Fuente

¿En qué consisten estos sistemas?

Especialización: un martillo grande no es la herramienta adecuada para todo

Cuando se abordan aplicaciones específicas o necesidades del sector, puede que no sea suficiente recurrir a un AI de uso general como GPT-4. Aunque son muy potentes, estos modelos están diseñados para gestionar una amplia gama de tareas y pueden carecer de los conocimientos especializados que requieren aplicaciones concretas, lo que da lugar a una disminución de los beneficios a partir de cierto punto.

Por ejemplo, una entidad financiera que desee desarrollar un chatbot para el análisis de inversiones o la gestión patrimonial necesita un sistema que incorpore tanto conocimientos especializados como experiencia específica de la empresa. Dada la naturaleza del sector, surgirían preocupaciones en torno a la privacidad (la empresa podría requerir soluciones locales y el uso exclusivo de modelos abiertos), la precisión (las soluciones deben ser impecablemente precisas) y la eficiencia. Utilizar incluso los modelos de lenguaje más potentes como solución independiente no sería, sin duda, la opción óptima. En cambio, un AI compuesto podría resultar muy eficaz al integrar múltiples componentes especializados, como los sistemas de generación aumentada por recuperación (RAG) y AI personalizados. Este enfoque garantiza que cada parte del sistema esté optimizada para su función específica.

Flexibilidad: los sistemas modulares se adaptan fácilmente a las necesidades cambiantes

Cuando un sistema se construye utilizando componentes modulares, sustituir o actualizar piezas individuales resulta mucho más sencillo. El mismo principio se aplica a AI compuestos, que se construyen a partir de múltiples bloques. Si un componente de una AI compuesta queda obsoleto o deja de cumplir los nuevos requisitos de cumplimiento normativo, puede sustituirse sin necesidad de una revisión completa de todo el sistema. Por ejemplo, si surge un modelo nuevo más adecuado, puede integrarse en el sistema para sustituir a la versión anterior. Del mismo modo, si se desarrolla un mecanismo de recuperación de información más eficiente, puede incorporarse sin alterar toda la configuración. Esta flexibilidad se extiende más allá de los modelos y los sistemas de recuperación a otros componentes, como las unidades data , los motores de análisis o los módulos de cumplimiento normativo.

Escalabilidad: los enjambres de componentes inteligentes superan a un único gigante

La naturaleza modular de AI compuestos Servicios ventajas en cuanto a escalabilidad. Al permitir que los componentes individuales se adapten de forma independiente, estos sistemas pueden gestionar de manera eficiente el aumento data y la complejidad data sin necesidad de una revisión completa.

Un sistema puede ampliarse replicándolo en una red de sistemas, lo que, en teoría, permite una escalabilidad infinita. Por eso, un único modelo lingüístico, por muy grande o potente que sea (a día de hoy), no puede buscar de forma eficaz una información concreta en una base de datos muy grande. Para ampliar las capacidades de búsqueda de un modelo, será inevitable crear un sistema multicomponente que mejore la función de búsqueda. Si ni siquiera las tareas más sencillas, como la recuperación de información, pueden ampliarse de forma eficaz con un único modelo, queda claro que los componentes individuales, por sí solos, no pueden soportar aplicaciones complejas a gran escala.

Por qué AI combinada tienen sentido desde el punto de vista empresarial

Desde una perspectiva empresarial, la adopción AI compuestos va más allá de la sofisticación técnica: ofrece ventajas estratégicas que se ajustan directamente a los objetivos empresariales. Se podría incluso argumentar que, si una empresa desea aprovechar AI generativa, no tiene más remedio que desarrollar (o adquirir) un sistema compuesto. Aunque esto pueda parecer sencillo, pone en tela de juicio la creencia empresarial generalizada de que los modelos independientes y listos para usar son suficientes para satisfacer demandas especializadas.

Mayor satisfacción del cliente

AI más avanzados, por sí solos, no pueden crear una experiencia personalizada. Esto solo se puede lograr mediante un sistema integrado que permita ofrecer experiencias de cliente altamente personalizadas y contextualmente relevantes. Por ejemplo, Custom Neural Voice de Microsoft combina modelos de lenguaje grande (LLM) generales con entrenamiento de voz personalizado, lo que permite a las marcas crear asistentes digitales que se ajustan con precisión a su tono y estilo únicos. Este nivel de personalización resulta especialmente eficaz en sectores orientados al cliente, como la publicidad, donde los clientes responden positivamente al sentirse especiales y comprendidos. Desde una perspectiva empresarial, combinar esta tecnología con la capacidad de añadir contexto da lugar a resultados personalizados, lo que, en última instancia, impulsa la satisfacción del cliente.

Rentabilidad

A diferencia de los modelos individuales, que ofrecen un nivel fijo de calidad a un coste fijo, AI Servicios permite configuracionesServicios de coste y calidad. Por ejemplo, las empresas pueden integrar un modelo más pequeño, optimizado para tareas específicas, con componentes especializados —como heurísticas de búsqueda— para obtener resultados de alta calidad a un coste menor en comparación con modelos independientes de mayor tamaño. Esta flexibilidad permite utilizar modelos más pequeños, posiblemente de código abierto, que, con una ingeniería específica, pueden ofrecer resultados comparables a los de soluciones más costosas.

Mayor control y confianza

Para las empresas, la fiabilidad y la credibilidad de AI son fundamentales. Depender únicamente de modelos individuales puede dificultar la obtención de resultados consistentemente veraces y bien formateados. Por ejemplo, un antiguo cliente del sector educativo solicitó en su día una solución para rellenar automáticamente formularios basándose en data información de su centro educativo. Al principio, dediqué meses a diseñar un sistema secuencial basado en ingeniería avanzada de prompts, sin utilizar un enfoque combinado. Los resultados mejoraron, pero nunca se acercaron lo suficiente a lo que podríamos presentar como solicitudes completamente cumplimentadas. No fue hasta que se introdujo el concepto de RAG cuando empezaron a surgir resultados totalmente controlados. Sin embargo, ni siquiera el RAG por sí solo fue suficiente; se necesitaron componentes adicionales para categorizar la información, mantener la coherencia del contexto y gestionar otros matices. Solo entonces logramos la fiabilidad y la precisión que el cliente necesitaba.

Conclusión

Al analizar el panorama actual de AI las aplicaciones industriales, se observa una tendencia clara: confiar en un único modelo para realizar funciones complejas suele resultar poco fiable. A medida que los casos de uso se vuelven más complejos y crece la adopción por parte de las empresas, la demanda de AI altamente especializadas y eficaces está llamada a aumentar. Para satisfacer esta demanda, es necesario diseñar una arquitectura de soluciones que incorpore modelos mejorados y especializados, evitando el error de limitarse a un ámbito de aplicación estrecho y unilateral.

La comunidad de desarrolladores está en plena efervescencia gracias a una serie de aplicaciones apasionantes que abarcan desde la medicina hasta el comercio minorista, todas ellas creadas mediante la combinación de componentes más pequeños y especializados para dar lugar a soluciones potentes y a medida.

Ni siquiera AI, por sí sola, es lo suficientemente inteligente como para alcanzar objetivos empresariales estratégicos. Debe complementarse con una forma superior de inteligencia coordinada.

Apéndice

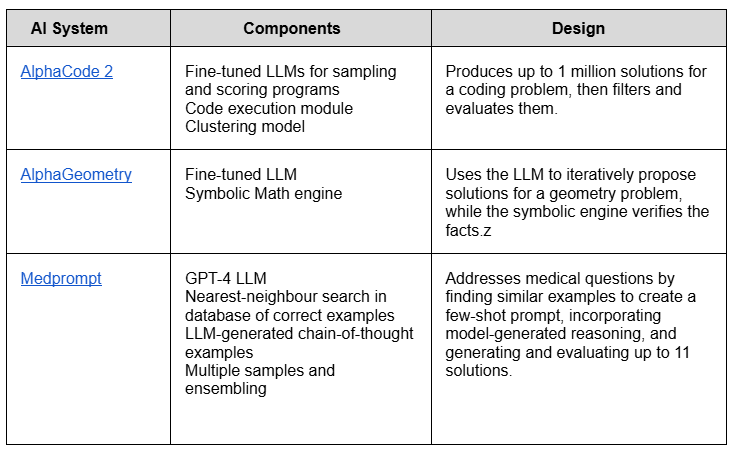

Ejemplos de AI compuestos

A continuación se presenta una recopilación de AI compuestos, impactantes e interesantes, que ponen de relieve la utilidad de este concepto. Independientemente de la infraestructura que utilicen los desarrolladores, el objetivo es observar cómo la combinación de varios AI con otras herramientas puede servir para alcanzar un propósito muy concreto.

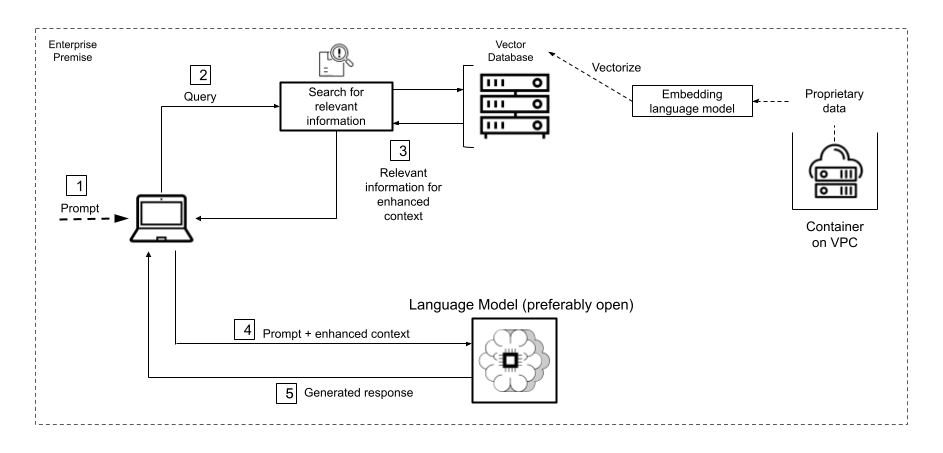

RAG mejora los resultados de un modelo de lenguaje grande (LLM) al proporcionar un contexto específico obtenido de una base de datos vectorizada que se encuentra fuera de data de entrenamiento originales del modelo. Si bien los LLM se entrenan con enormes conjuntos de datos y utilizan miles de millones de parámetros para generar respuestas, RAG va un paso más allá. Permite al LLM acceder y consultar información específica y actualizada, ya sea propia de un ámbito concreto o procedente de la base de conocimientos interna de una organización. Este proceso mejora significativamente la relevancia, la precisión y la utilidad del contenido generado, todo ello sin necesidad de volver a entrenar el modelo.

Las empresas que cuentan con grandes conjuntos de datos y necesitan un método eficaz para organizar su conocimiento interno pueden implementar esta solución de forma local, utilizando el modelo que prefieran, para recuperar información concreta. Por ejemplo, los analistas financieros pueden localizar rápidamente data relevantes data reports históricos reports necesidad de revisarlos manualmente uno por uno. El modelo, mejorado gracias a esta información contextual, también genera respuestas más precisas y útiles, lo que agiliza todo el proceso de recuperación de información.

A continuación se muestra una arquitectura RAG típica:

Arquitectura general de RAG

A continuación se muestra una tabla con algunos AI compuestos habituales (fuente):

BLOG

BLOG