Artefact Research Center

缩小学术界与工业应用之间的差距。.

研究更加透明和道德的模式,促进 AI 业务的采用。.

AI 偏差示例

- AppleCard 根据种族主义标准发放抵押贷款

- Lensa AI 将 women 的自拍照性化

- 种族主义 Facebook 图片分类,非洲裔美国人是猴子

- 微软推特聊天机器人变得纳粹、性别歧视和咄咄逼人

- 编写代码说明优秀科学家都是白人男性的 ChatGPT

当前的挑战

AI 模型准确且易于在许多使用案例中部署,但由于黑盒和道德问题,仍然无法控制。.

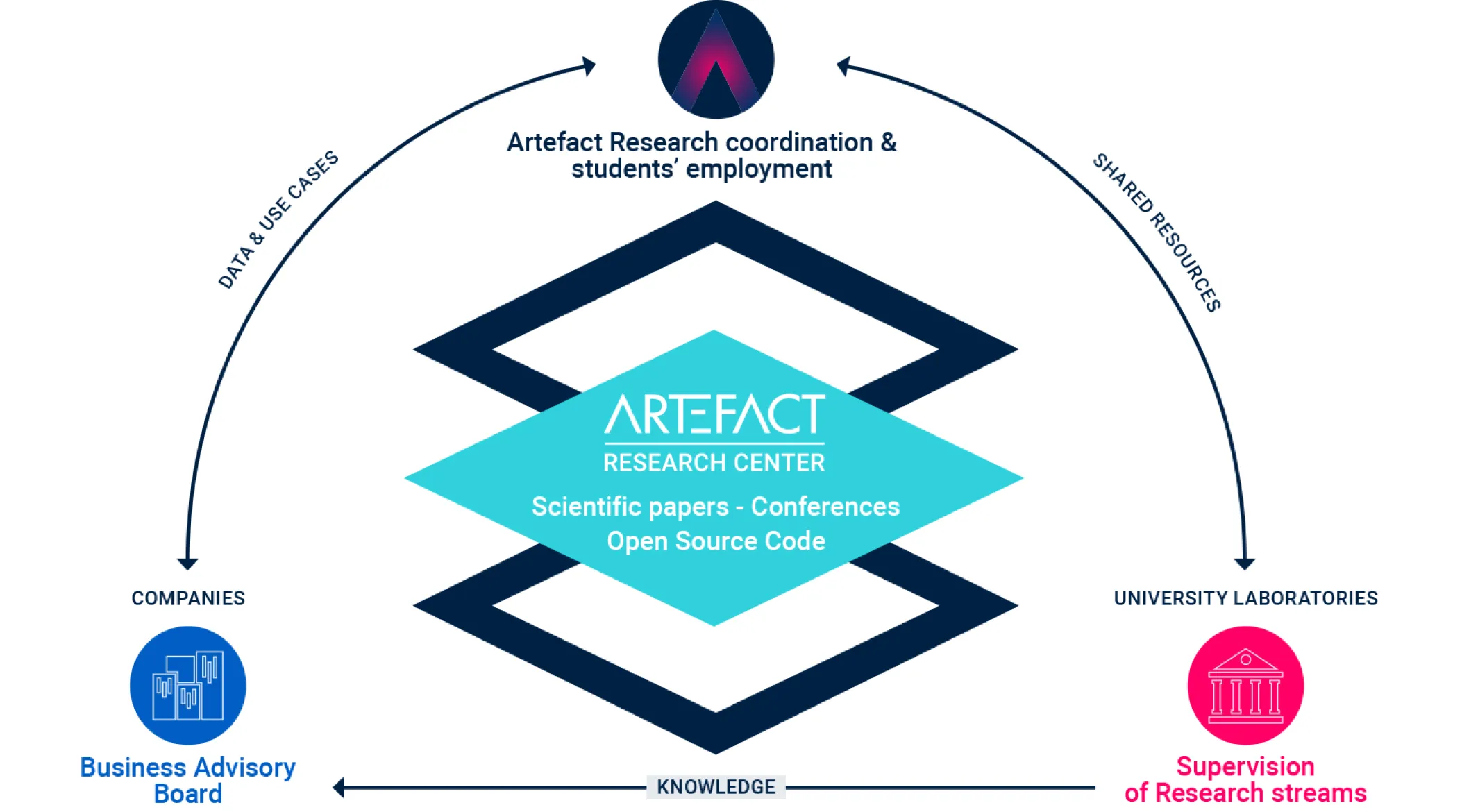

Artefact Research Center 的任务。.

一个完整的生态系统,在以下方面架起了桥梁

基础研究和实际工业应用。.

埃马纽埃尔-马勒贝

研究负责人

研究领域:深度学习、机器学习

埃马纽埃尔从攻读适用于电子招聘的 NLP 模型的博士学位开始,一直在纯粹的研究和有影响力的应用之间寻求有效的平衡。他的研究经验包括为华为技术公司提供 5G 时间序列预测,以及为欧莱雅公司的美发和化妆客户提供计算机视觉模型。加入 Artefact 之前,他在上海担任欧莱雅亚洲 AI 研究负责人。如今,他在 Artefact 的职位是一个绝佳的机会和理想的环境,可以在学术界和工业界之间架起一座桥梁,促进他的实际研究,同时影响工业应用。.

阅读我们最新的 Artefact Research Center 新闻

横向研究领域

凭借独特的定位,我们的目标是应对 AI 的普遍挑战,无论是统计建模还是管理研究。.

这些问题贯穿于我们所有的课题,并促进我们的研究。.

一个完整的生态系统,在基础研究和工业实际应用之间架起了一座桥梁。.

主题

我们的几个博士课题涉及工业用例和最先进限制的交叉点。.

对于每个课题,我们都与大学教授合作,并可使用工业 data,使我们能够在给定的现实世界场景中解决主要研究领域的问题。.

1 - 预测与定价

用可控的多元预测模型对时间序列进行整体建模。通过这种建模,我们可以找到提高销售预测的最佳参数,从而解决定价和促销规划问题。通过这种整体方法,我们的目标是捕捉产品之间的蚕食和互补。这将使我们能够控制预测,并保证预测保持一致。.

2 - 可解释和可控制的评分

广泛使用的机器学习模型系列以决策树为基础:随机森林、提升。虽然这些模型的准确性往往达到了最先进的水平,但却给人一种黑箱的感觉,用户的控制能力有限。我们的目标是提高这些模型的可解释性和透明度,特别是在 datasets 不平衡的情况下改进 SHAP 值的估计。我们还致力于为此类模型提供一些保证,例如,针对训练外样本或通过更好的单调性约束。.

3 - 组合优化

对于零售商来说,商品分类是一个主要的商业问题,它是在选择商店销售的商品集合时出现的。利用大型工业 datasets 和神经网络,我们的目标是建立更稳健、更可解释的模型,以更好地捕捉顾客在面对琳琅满目的产品时的选择。处理产品之间的蚕食和互补问题,以及更好地了解客户集群,是在商店中找到更优化的产品集的关键。.

4 - 企业采用 AI

在企业中更好地采用 AI 的挑战在于,一方面要改进 AI 模型,另一方面要了解人和组织方面的情况。在定性管理研究和社会研究的交叉点上,本研究轴试图探讨企业在采用 AI 工具时面临的困难。现有的创新采用框架并不完全适用于机器学习创新,因为在涉及 AI 时,存在着监管、人员培训或偏见方面的典型差异,而对于生成式 AI 而言更是如此。.

5 - Data 驱动的可持续性

该项目将采用定性和定量研究方法,解决两个关键问题:公司如何有效衡量社会和环境可持续性绩效?为什么可持续发展措施往往不能给组织实践带来重大变化?

一方面,该项目旨在探索 data-driven 指标并确定指标,使组织程序与社会和环境可持续发展目标保持一致。另一方面,该项目将侧重于把这些可持续发展措施转化为公司内部的具体行动。.

6 - 计算机视觉中的偏差

当模型根据图像(例如显示人脸的图像)进行预测时,它可以获取敏感信息,例如种族、性别或年龄,这些信息可能会使其推理产生偏差。我们的目标是开发一个框架来从数学角度衡量这种偏差,并提出在模型训练过程中减少这种偏差的方法。此外,我们的方法将从统计学角度检测出强烈偏差的区域,以解释、理解和控制这些模型在哪些方面强化了 data 中存在的偏差。.

7 - 用于信息检索的 LLM

LLMs 的一个主要应用是与代表某些行业知识或信息的文档语料库相结合。在这种情况下,需要进行信息检索,而 LLMs 在这方面有一些局限性,例如输入文本的大小太小,无法为文档编制索引。同样,幻觉效应也可能发生在最终答案中,我们的目标是在推理时利用检索到的文档和模型的不确定性来检测幻觉效应。.

Artefact 的兼职研究员

除了专门从事研究的团队,我们还有几位合作者,他们花了一些时间从事科学研究并发表论文。通过顾问工作,他们也能从客户遇到的实际问题中得到启发。.

出版物

我们的技术专家撰写的 Medium 博客文章。.

一次一个令牌地检测 LLM 中的幻觉

大型语言模型的能力令人惊叹。它们总结、翻译、推理和编码(比我做得更好)。但与我不同的是,它们也因发明...

未来的代理 AI 是否会依赖于知识图谱?

随着企业急于将 AI 投入运行,大多数企业发现他们的 data 基础设施根本不是为自主推理而设计的。如今,多达 80% 的 AI 实施...

丰富 DIY 体验:ADEO 如何使用 AI 连接内容和知识

分类优化是零售业的一个关键流程,它涉及到策划理想的产品组合以满足消费者需求,同时考虑到许多物流因素。.

MotherDuck 解读:新一代 AI 和分析解决方案如何融入您的 Data 堆栈

MotherDuck 通过协作功能将 DuckDB 的分析性能扩展到 cloud,提供比 BigQuery 快 4 倍的性能,并通过...

利用 Python 中的离散选择模型进行分类优化

分类优化是零售业的一个关键流程,它涉及到策划理想的产品组合以满足消费者需求,同时考虑到许多物流因素。.

偏好对齐总是增强基于 LLM 翻译的最佳选择吗?实证分析

用于机器翻译(MT)评估的神经指标因其与人类判断的相关性优于传统词汇指标而日益突出。

选择-学习:从机器学习的角度为业务环境建立大规模选择模型

离散选择模型的目的是预测个人从被称为 "品种 "的备选方案中做出的选择决定。著名的应用案例包括预测...

生成式 AI 时代:正在发生的变化

对 ChatGPT 和其他生成性 AI 的大量和多样化回应,无论是怀疑还是热情,都表明了它们正在带来的变化和影响。.

Artefact 如何为软件工程师开发公平而简单的职业系统

在当今充满活力、不断发展的科技行业中,职业道路往往会让人感觉像在机会密林中蜿蜒曲折。随着科技行业的快速发展,我们的职业生涯也在不断变化。.

为什么需要 LLMOps

本文介绍了 LLMOps,这是一个融合了 DevOps 和 MLOps 的专业分支,用于管理大型语言模型(LLM)带来的挑战...

释放 LangChain Expression Language (LCEL) 的力量:从概念验证到产品化

在不到一年的时间里,LangChain 已成为与 LLM 交互的最常用 Python 库之一,但 LangChain 主要是一个库...

我们如何使用 Treasure Data Unification 和 SQL 处理配置文件 ID 调节

在本文中,我们将解释 ID 协调所面临的挑战,并展示我们在客户 Data 平台中创建统一配置文件 ID 的方法,特别是...