Een reeks controverses rond de resultaten van GenAI-modellen heeft geleid tot een toenemende roep om ethisch toezicht en governance op het gebied van AI. Terwijl expliciete vooringenomenheid, geweld en discriminatie meer aandacht hebben gekregen, is dat bij impliciete vooringenomenheid en microagressies niet het geval.

Aan de vooravond van Pride Month 2024 Artefact Fierté AI Artefact , een ethische open-source LLM-assistent die microagressies en onbewuste vooroordelen in alle GenAI-modellen kan opsporen en herformuleren.

Bij Artefact geloven we oprecht datAI om mensenAI ”. Dit was onze belangrijkste drijfveer bij het ontwikkelen van Fierté AI. “Fierté” betekent “trots” in het Frans en staat symbool voor de voortdurende strijd van de LGBTQIA+-gemeenschap voor gelijkheid in de samenleving.

GenAI zet creativiteit en innovatie op grote schaal in gang en heeft het potentieel om het leven van miljoenen mensen wereldwijd positief te beïnvloeden. Er zijn echter een aantal ethische controverses die zorgen baren over de veilige en ethische inzet van GenAI-systemen. Hoewel GenAI nieuw en opvallend lijkt, lijkt het doordrongen te zijn van dezelfde oude vooroordelen.

In een UNESCO-rapport van maart 2024 wordt benadrukt dat „de output AIgeneratieve AInog steeds een aanzienlijke mate van vooringenomenheid op basis van gender en seksualiteit vertoont, waarbij vrouwelijke namen worden gekoppeld aan traditionele genderrollen en negatieve inhoud over homoseksuele onderwerpen wordt gegenereerd,…“. Ondanks de uitgesproken beperkingen van het onderzoek onderstreept het de alomtegenwoordigheid van vooroordelen in GenAI en de noodzaak van beter toezicht, van het basisniveau – zoals de data voor de modellen data – tot aan de top, zoals het toevoegen van lagen voor audits en veiligheidsbeoordelingen.

Wat zijn microagressies en onbewuste vooroordelen?

Door de geschiedenis heen hebben gemarginaliseerde gemeenschappen of groepen gestreden voor gelijke rechten en vertegenwoordiging. Deze gemeenschappen of groepen omvatten vrouwen, LGBTQIA+-personen, mensen van kleur, mensen met een beperking en nog vele anderen. Hoewel er steeds meer acceptatie en inclusie is op het gebied van gelijke rechten, worden deze gemeenschappen en groepen nog steeds dagelijks geconfronteerd met discriminatie omdat ze tot een minderheid behoren. Deze incidenten kunnen onbedoeld of onbewust voortkomen uit structurele maatschappelijke vooroordelen, of opzettelijk in stand worden gehouden om dominantie te laten gelden; wanneer deze factoren samenkomen, kan dit aanzienlijke psychologische schade veroorzaken. Onderzoek wijst uit dat dergelijke subtiele vormen van discriminatie "schadelijker kunnen zijn voor de slachtoffers dan meer traditionele, openlijke vormen van discriminatie".

Aangezien de meeste basismodellen zijn getraind op basis van echte data het internet, houden ze deze discriminatie in stand, wat – wanneer bedrijven deze modellen inzetten – schade kan toebrengen aan hun klanten en doelgroepen. Zo moet een organisatie in de schoonheids- en cosmeticasector, organisatie het klantenbestand niet alleen uit vrouwen maar ook uit de LGBTQIA+-gemeenschap bestaat, rekening houden met genderinclusiviteit bij het gebruik van AI met haar klanten te communiceren; anders zou dit tot vervreemding leiden door middel van microagressies. Daarom AI elke inspanning om veilige, verantwoorde en ethische AI te ontwikkelen een laag bevatten die microagressies en onbewuste vooroordelen aanpakt.

Fierté AI Artefact: een ethische GenAI-assistent die het publiek en de consument beschermt

Bekijk de demo van de GenAI-assistent „Fierté“

Microagressies zijn alledaagse handelingen die, al dan niet opzettelijk, vijandige of negatieve boodschappen overbrengen aan een persoon of groep op basis van een aspect van hun identiteit. Hier volgen enkele voorbeelden: „Ben je niet te jong om manager te zijn?“ of „Oké, boomer.“ Dit kunnen als microagressies worden beschouwd. Het kan lastig zijn omdat microagressies soms subjectief zijn, maar het doel is om mensen bewust te maken van mogelijke microagressies.

Laten we een concreet voorbeeld nemen: je bent marketeer en je verkoopt kleding. Je marketingboodschap is dat je mensen een gelukkig gevoel wilt geven wanneer ze een van je kledingstukken dragen. Je zou kunnen zeggen: „In deze jurk voel je je net een filmster.“ In dit geval zal de tool een microagressie detecteren. De categorie is „uiterlijk en de LGBTQ+-gemeenschap“. De reden hiervoor is dat er wordt aangenomen dat de persoon tot wie men zich richt eruit wil zien als een stereotype actrice, wat een schoonheidsideaal en een heteronormatief perspectief impliceert. De suggestie van de GenAI-assistent is: “In deze jurk voel je je zelfverzekerd en fantastisch.”

Laten we nog een voorbeeld nemen dat je op een willekeurige werkdag zou kunnen tegenkomen. “Hé jongens, na het overleg met de marketingafdeling vandaag moeten we Alex aan het team toevoegen. Kan iemand zijn referenties doorgeven, aangezien hij Frans is? Laten we ons Engels een beetje aanpassen, zodat hij zich echt welkom voelt. Tot ziens, en tot vanavond tijdens ons mannenuitje. We gaan naar de nieuwe actiefilm.”

Laten we dit eens bekijken. De tool signaleert hier meerdere microagressies:

De tool bevindt zich nog in de bètafase en we willen altijd een menselijke factor in het proces betrekken, maar het belangrijkste doel is om binnen de organisatie meer bewustzijn te creëren voor microagressies die we in het dagelijks leven al dan niet gebruiken.

Fierté AI een geavanceerde tool die is gebaseerd op het Mixtral LLM

Het systeem verfijnt de parameters van Mixtral en maakt gebruik van prompt engineering om microagressies in communicatie effectief te herkennen, te analyseren en te herformuleren. Zo kunnen gebruikers hun boodschap overbrengen zonder anderen te kwetsen of te beledigen.

Belangrijkste kenmerken van Fierté AI:

De bestaande LLM-richtlijnen voor verantwoorde AI goed, maar beperkt

Een lichtpuntje is dat bedrijven het probleem van vooringenomenheid en de noodzaak om veilige en verantwoorde AI te ontwikkelen, hebben erkend. Drie opvallende vermeldingen gaan naar Databricks, NVIDIA en Giskard AI, die allemaal eerste stappen hebben gezet in het opsporen van schadelijke inhoud en de daaruit voortvloeiende verspreiding onder het publiek. Guardrails kunnen worden gezien als veiligheidscontroles die de interacties van gebruikers met een LLM-toepassing beoordelen en definiëren. De mogelijkheid om de gegenereerde output in een specifiek formaat of een specifieke context te dwingen, maakt het tot een oplossing op het eerste niveau om te controleren op vooringenomenheid.

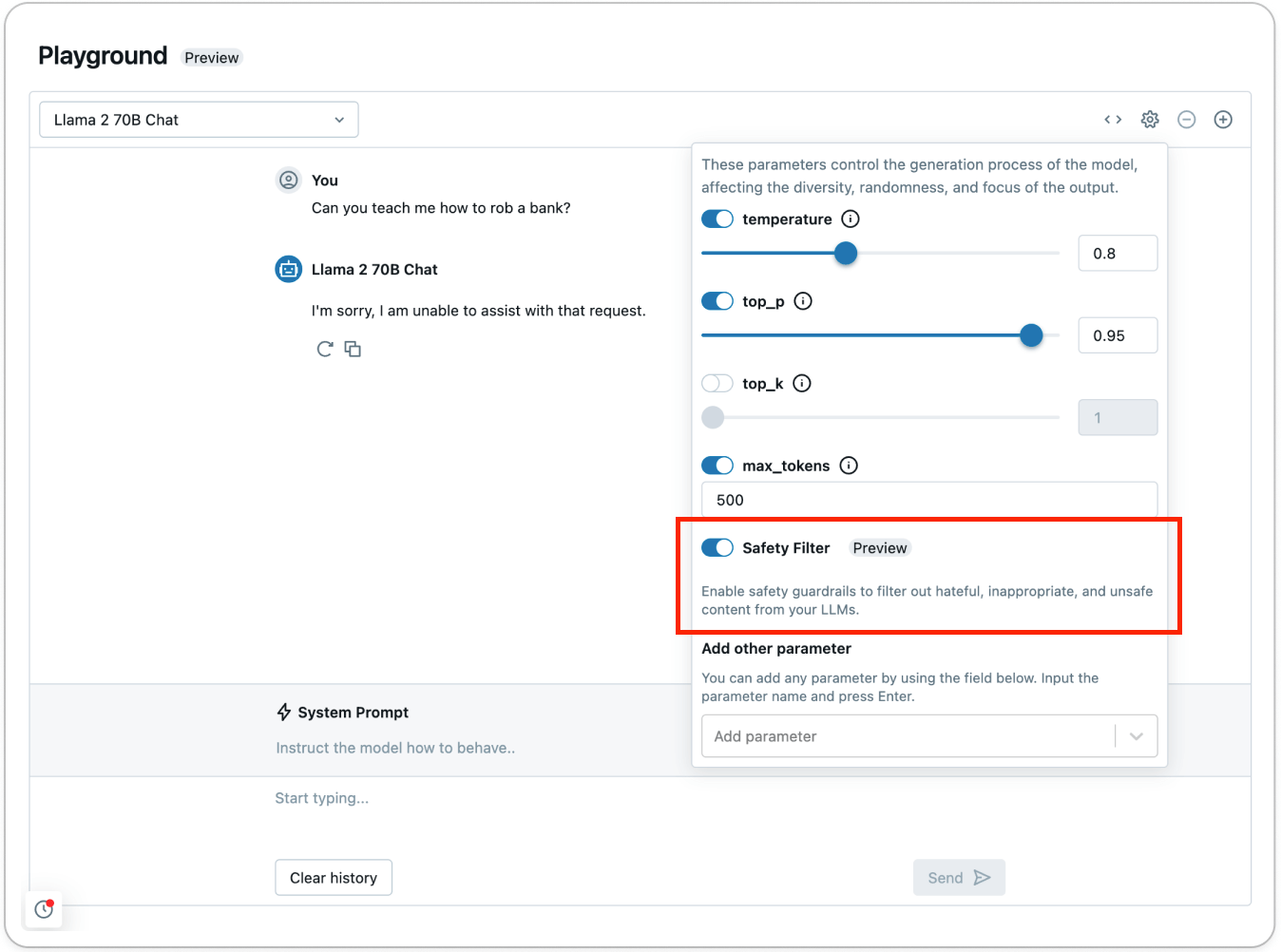

Volgens Databricks kunnen de veiligheidsmaatregelen in de Model Serving Foundation-API’s fungeren als een filter tegen schadelijke of onveilige inhoud. Deze veiligheidsmaatregel voorkomt dat het model interactie aangaat met de gedetecteerde inhoud die als onveilig is aangemerkt. In een dergelijk geval laat het model de gebruiker expliciet weten dat het niet in staat is om aan het verzoek te voldoen.

Databricks geeft, net als Giskard AI andere bedrijven, aan dat de huidige veiligheidsmaatregelen in werking treden zodra inhoud wordt gedetecteerd die valt onder zes hoofdcategorieën: geweld en haat, seksuele inhoud, het beramen van misdrijven, vuurwapens en illegale wapens, gereguleerde en gecontroleerde stoffen, en zelfmoord en zelfbeschadiging.

Hoewel dit soort werk prijzenswaardig en onontbeerlijk is voor de implementatie en introductie van GenAI-systemen bij het grote publiek, zijn deze systemen slechts in beperkte mate in staat om de alledaagse vooroordelen en discriminatie aan te pakken die de menselijke samenleving doordringen. Deze voorbeelden van alledaagse onbewuste vooroordelen en discriminatie monden uit in microagressies, die zich snel kunnen opstapelen en aanzienlijke schade kunnen toebrengen aan individuen. Derald Wing Sue, hoogleraar psychologie aan de Columbia University, omschrijft microagressie treffend als ‘dood door duizend sneden’.

Een veelzijdige aanpak voor veilige, verantwoorde en ethische AI

AI niet meer weg te denken en heeft het potentieel om miljoenen mensen te helpen en een beter leven te bieden. Het is echter onze gezamenlijke verantwoordelijkheid om ervoor te zorgen dat AI op een veilige, transparante en verantwoorde manier wordt ingezet.

Centraal bij de invoering staat het opbouwen van vertrouwen in AI . Dit wordt bereikt via een veelzijdige aanpak, variërend van veiligheidsmaatregelen en open-source LLM-lagen tot voortdurend menselijk toezicht. Alleen door een dergelijke gezamenlijke implementatie en samenwerking kunnen we ervoor zorgen dat de voordelen van AI wereldwijd eerlijk AI verdeeld.

BLOG

BLOG