Una serie de polémicas en torno a los resultados de los modelos de IA generativa ha impulsado el llamamiento a favor de una supervisión ética y una gobernanza de AI. Si bien han aumentado los casos de sesgos explícitos, violencia y discriminación, no ha ocurrido lo mismo con los sesgos implícitos y las microagresiones.

En vísperas del Mes del Orgullo 2024, Artefact Fierté AI, un asistente LLM de código abierto y ético capaz de detectar y reformular microagresiones y sesgos inconscientes en todos los modelos de GenAI.

En Artefact, creemos firmemente queAI con las personas». Esta ha sido nuestra principal motivación para crear Fierté AI. «Fierté» significa «orgullo» en francés y representa la lucha constante de la comunidad LGBTQIA+ por la igualdad en la sociedad.

La IA generativa está dando rienda suelta a la creatividad y la innovación a gran escala, con el potencial de influir positivamente en la vida de millones de personas en todo el mundo. Sin embargo, una serie de controversias éticas ha suscitado inquietudes sobre la implementación segura y ética de los sistemas de IA generativa. Aunque la IA generativa parece nueva y llamativa, parece estar plagada de los mismos viejos prejuicios.

Un informe de la UNESCO de marzo de 2024 destaca que «los resultados AIgenerativa siguen reflejando un sesgo considerable basado en el género y la sexualidad, al asociar nombres femeninos con roles de género tradicionales y generar contenidos negativos sobre temas relacionados con la homosexualidad…». A pesar de las limitaciones expresadas del estudio, este subraya la omnipresencia de los sesgos en la IA generativa y la necesidad de una mejor supervisión desde la base —como los data de entrenamiento data para los modelos— hasta los niveles más altos, como la incorporación de capas para auditorías y revisiones de seguridad.

¿Qué son las microagresiones y los prejuicios inconscientes?

A lo largo de la historia, las comunidades o grupos marginados han luchado por la igualdad de derechos y la representación. Estas comunidades o grupos incluyen a las mujeres, las personas LGBTQIA+, las personas de color, las personas con discapacidad y muchos otros. Aunque cada vez hay más aceptación e inclusión de la igualdad de derechos, estas comunidades y grupos siguen enfrentándose a la discriminación cotidiana por el hecho de ser una minoría. Estos incidentes pueden estar motivados de forma accidental o inconsciente por prejuicios sociales sistémicos, o perpetuarse intencionadamente para afirmar el dominio, lo que, al acumularse, puede causar un daño psicológico significativo. Las investigaciones sugieren que estos actos sutiles de discriminación pueden ser «más perjudiciales para las víctimas que las formas más tradicionales y evidentes de discriminación».

Dado que la mayoría de los modelos fundacionales se entrenan con data del mundo real data Internet, perpetúan esta discriminación que, cuando las empresas los implementan, puede causar daño a sus consumidores y público. Por ejemplo, una Compañia de belleza y cosmética Compañia base de consumidores incluya no solo a mujeres, sino también a la comunidad LGBTQIA+, debe tener en cuenta la inclusividad de género al utilizar AI comunicarse con sus consumidores, ya que, de lo contrario, provocaría alienación a través de microagresiones. Por lo tanto, cualquier esfuerzo por crear AI segura, responsable y ética AI incluir un nivel que aborde las microagresiones y los sesgos inconscientes.

Fierté AI Artefact: un asistente de IA generativa ético que protege a las audiencias y a los consumidores

Mira la demostración del asistente GenAI «Fierté»

Las microagresiones son acciones cotidianas que, de forma intencionada o no, transmiten mensajes hostiles o negativos hacia una persona o un grupo en función de algún aspecto de su identidad. He aquí algunos ejemplos: «¿No eres demasiado joven para ser jefe?» o «Vale, boomer». Estas frases pueden considerarse microagresiones. Puede resultar complicado, ya que a veces las microagresiones son subjetivas, pero el objetivo es crear conciencia sobre las posibles microagresiones.

Pongamos un ejemplo concreto: eres un profesional del marketing y vendes ropa. Tu mensaje de marketing es que quieres que la gente se sienta feliz cuando lleva puesta una de tus prendas. Podrías decir: «Este vestido te hará sentir como una estrella de cine». En este caso, la herramienta detectará una microagresión. La categoría es «aspecto físico y la comunidad LGBTQ+». El motivo es que da por sentado que la persona a la que se dirige quiere parecerse a una actriz estereotipada, lo que implica un canon de belleza y una perspectiva heteronormativa. La sugerencia del asistente de GenAI es: «Este vestido te hará sentir segura y fabulosa».

Veamos otro ejemplo que podrías encontrarte cualquier día en el trabajo. «Hola, chicos, tras la reunión de hoy con el departamento de marketing, tenemos que incorporar a Alex al equipo. ¿Alguien puede explicarle cómo funciona todo, ya que es francés? Intentemos expresarnos en un inglés claro para que se sienta de verdad bienvenido. Adiós, y nos vemos esta noche en nuestra salida de chicos. Vamos a ver la nueva película de acción».

Analicemos esto. La herramienta detecta varias microagresiones aquí:

La herramienta se encuentra en fase beta y siempre queremos que haya un factor humano en el proceso, pero el objetivo principal es crear conciencia sobre las microagresiones dentro de la organización, que podamos o no utilizar en nuestra vida cotidiana.

Fierté AI una herramienta avanzada basada en el modelo de lenguaje grande (LLM) Mixtral

Ajusta los parámetros de Mixtral y utiliza la ingeniería de prompts para detectar, analizar y reformular eficazmente las microagresiones en la comunicación. De este modo, se garantiza que los usuarios puedan transmitir sus mensajes sin causar daño ni ofender a nadie.

Características principales de Fierté AI:

Las medidas de protección existentes en el ámbito de los modelos de lenguaje grande (LLM) para AI responsable AI adecuadas, pero tienen sus limitaciones

Por el lado positivo, las empresas han reconocido el problema de los sesgos y la necesidad de desarrollar AI segura y responsable. Cabe destacar a Databricks, NVIDIA y Giskard AI, que han dado los primeros pasos en la detección de contenido perjudicial y su consiguiente difusión al público. Los «guardrails» pueden entenderse como controles de seguridad que revisan y definen las interacciones de los usuarios con una aplicación de LLM. La capacidad de forzar que la salida generada tenga un formato o contexto específico le permite actuar como una solución de primera línea para detectar sesgos.

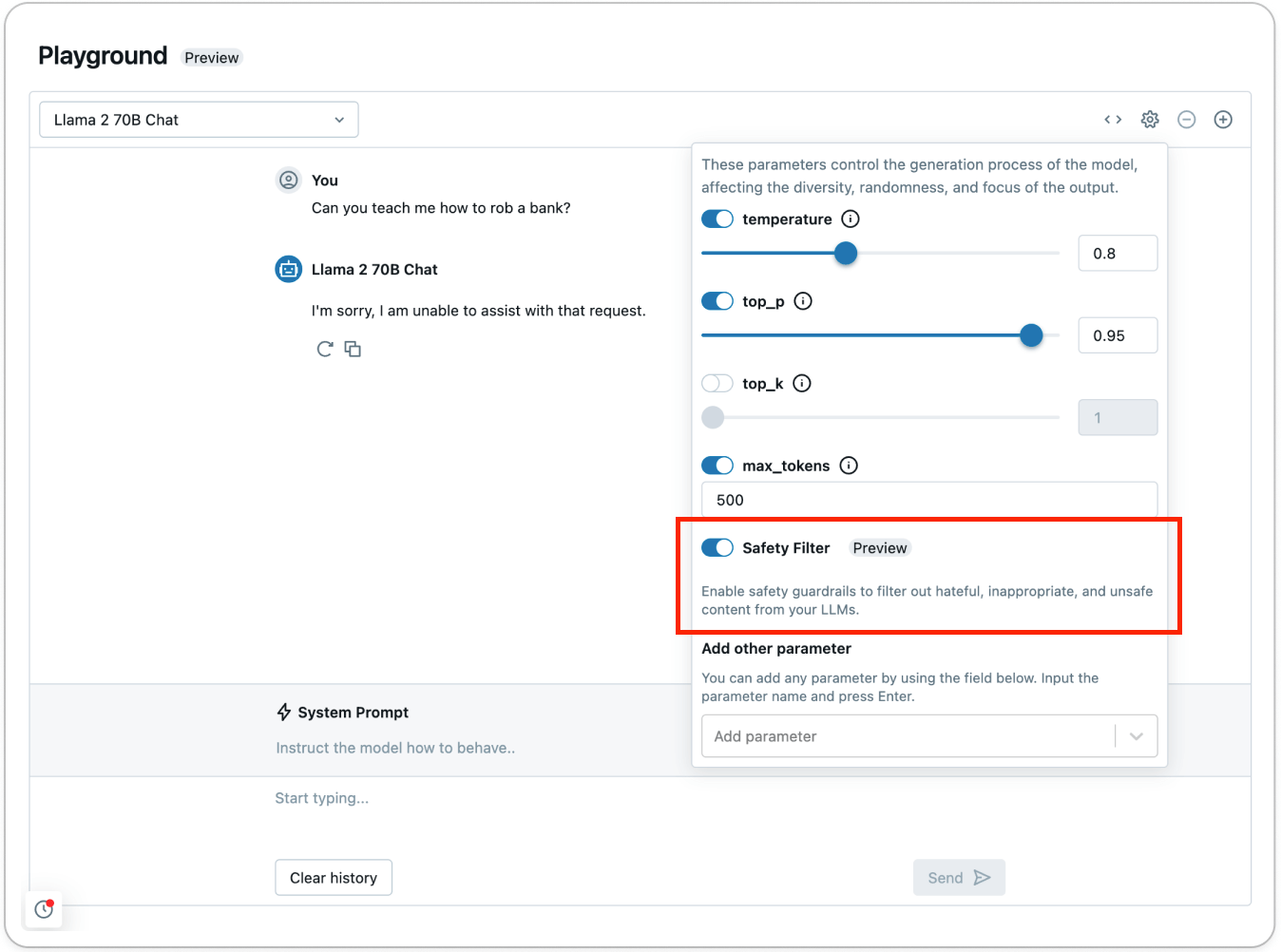

Según Databricks, los mecanismos de protección de las API de Model Serving Foundation pueden actuar como un filtro de seguridad frente a cualquier contenido tóxico o peligroso. Estos mecanismos impiden que el modelo interactúe con el contenido detectado que se haya considerado peligroso. En tal caso, el modelo responde al usuario indicando explícitamente que no puede atender su solicitud.

Databricks, al igual que Giskard AI otras empresas, afirma que los mecanismos de control actuales se activan cuando se detecta contenido perteneciente a seis categorías principales: violencia y discurso de odio, contenido sexual, planificación de delitos, armas de fuego y armas ilegales, sustancias reguladas y controladas, y suicidio y autolesiones.

Aunque este trabajo es loable y imprescindible para la implantación o el lanzamiento de sistemas de IA general al público, su capacidad para hacer frente a los prejuicios y la discriminación cotidianos que impregnan la sociedad humana es limitada. Estos casos de prejuicios y discriminación inconscientes del día a día se convierten en microagresiones, que pueden acumularse rápidamente hasta causar un daño significativo a las personas. Derald Wing Sue, profesor de Psicología en la Universidad de Columbia, describe acertadamente las microagresiones como «la muerte por mil cortes».

Un enfoque múltiple para AI segura, responsable y ética

AI para quedarse y tiene el potencial de beneficiar y mejorar la vida de millones de personas. Sin embargo, es nuestra responsabilidad colectiva garantizar que AI implantación se realice de forma segura, transparente y responsable.

Un aspecto fundamental para la adopción de AI es generar confianza en AI , lo cual se logra mediante un enfoque múltiple que abarca desde medidas de seguridad hasta capas de modelos de lenguaje grandes (LLM) de código abierto y una supervisión humana continua. Solo mediante esa implementación y colaboración colectivas podremos garantizar que los beneficios de AI distribuyan de forma equitativa en todo el mundo.

BLOG

BLOG