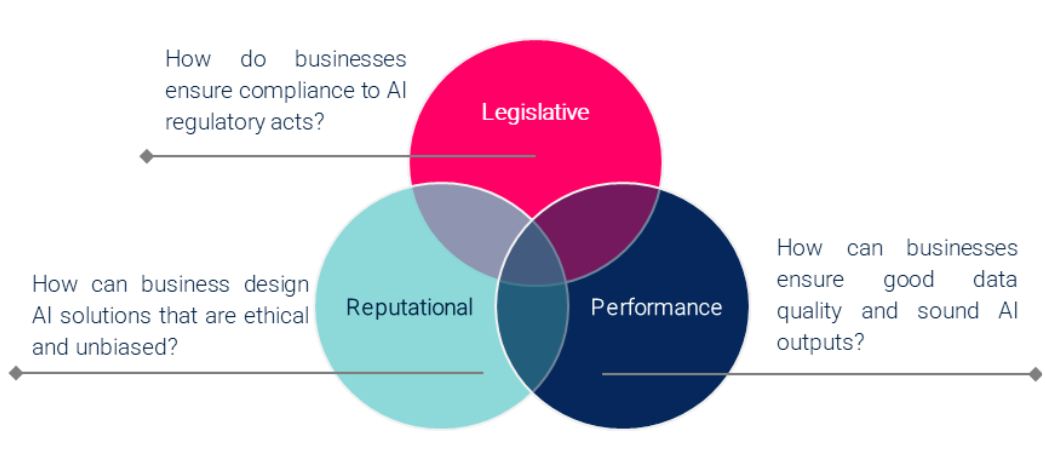

随着人们对人工智能解决方案的关注度不断提升以及其应用日益普及,企业亟需采取相关举措,以确保对人工智能的设计和使用进行妥善治理。

如果人工智能治理不力,组织将面临无法遵守监管要求、决策过程受损以及无法满足客户期望的风险。

例如,对人工智能相关法规缺乏了解可能会导致无意中的违规行为,从而使企业面临巨额罚款。此外,数据管理不善会降低数据质量,进而对人工智能模型的输出结果产生负面影响,进而影响决策和运营效率,最终导致财务损失。

最后,在缺乏严格伦理考量的情况下使用人工智能,可能会损害企业的信誉,并在与客户之间造成信任鸿沟,例如使用基于人口统计数据而无意中产生歧视的算法。企业必须应对这些治理挑战,以确保负责任且符合伦理地使用人工智能,从而保障其运营并维持利益相关者的信任。

“《人工智能法案》规定了数据质量、透明度、人类监督以及人工智能问责制的相关规则。Artefact我们建议客户遵循七项原则,以设计符合法规要求的AI解决方案。”NawrasArtefact 数据战略顾问

新兴人工智能立法:规范企业对人工智能的使用与应用

人工智能治理最具挑战性的方面之一,在于企业能否遵守有关其使用和实施的法规。其中最引人注目的法规是欧盟委员会于2021年提出的《欧盟人工智能法案》。 该法案旨在为人工智能开发者、部署者和使用者确立明确的要求和义务,同时减轻行政和财务负担,特别是对中小企业(SMEs)而言。尽管该法案尚待欧盟立法机构正式通过,但各方已达成临时协议,预示着其有望成为法律。专家预计该法案将于2024年年中正式通过,并计划于2026年初开始实施。

《人工智能法案》就人工智能系统的数据质量、透明度、人类监督及问责机制制定了相关规定。该法案还建立了一个框架,用于根据人工智能系统对健康、安全及基本人权的潜在影响对其风险进行分类。该法案将人工智能解决方案划分为四个风险类别:

Artefact核心原则:符合规范的 AI 解决方案的特征

基于《欧盟人工智能法案》的要求以及我们在数据和人工智能治理与合规方面的经验,我们建议客户在设计或部署任何人工智能解决方案时,务必考虑以下七项不可或缺的要务:

为了有效开发和部署符合这些设计原则的人工智能解决方案,并确保实施适当的人工智能治理以规避法律、性能和声誉风险,许多企业将需要进行重大的组织变革。这些变革包括:

在所有这些组织支柱中推行变革可能是一个艰难且耗时的过程,Artefact 企业着手制定并整合人工智能治理框架。这将确保符合未来的监管要求,并有助于满足客户的期望。

迫在眉睫的需求:积极采用合规的人工智能解决方案的重要性

在人工智能技术日新月异的领域中,企业领导者必须采取积极主动的姿态,将各自组织定位为负责任地应用人工智能的先行者。这将使他们能够在推动创新的同时,履行道德义务并遵守法规。在这个技术飞速发展、法规不断演变的时代,采取战略性且坚定不移的人工智能治理方法,将成为实现可持续成功的关键要素。

想进一步了解如何应对这一问题吗?敬请期待本系列的第二部分,届时我们将深入探讨企业可用于在组织内部建立完善的人工智能治理框架。

博客

博客