A medida que crece el interés por AI y su integración, existe una necesidad apremiante de que las empresas pongan en marcha iniciativas que garanticen una gestión adecuada del AI y el uso AI .

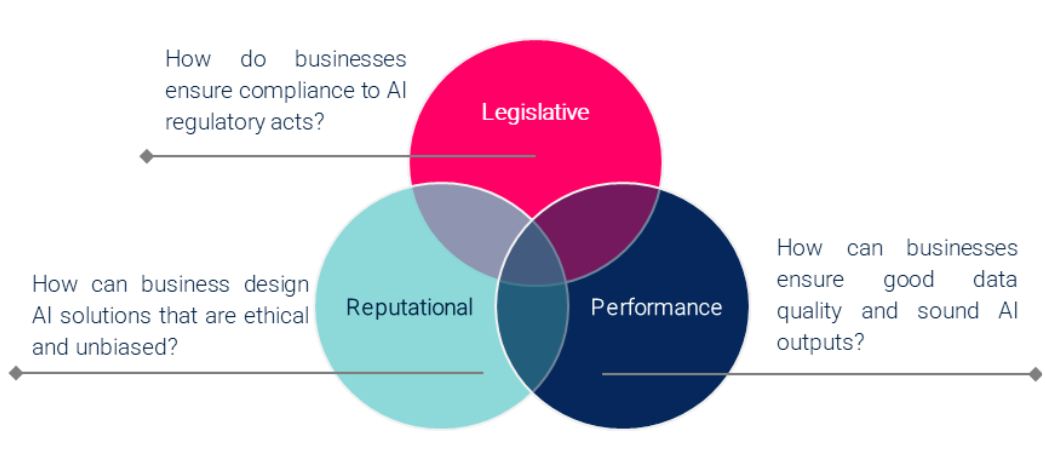

Una gestión inadecuada de AI las organizaciones al riesgo de incumplir los requisitos normativos, lo que pone en peligro su proceso de toma de decisiones y les impide satisfacer las expectativas de los clientes.

Por ejemplo, el desconocimiento de la legislación que regula AI dar lugar a infracciones involuntarias que pueden acarrear multas considerables para las empresas. Además, una gestión deficiente data data , lo que afecta negativamente a los resultados de AI y, por consiguiente, a la toma de decisiones y a la eficiencia operativa, lo que, en última instancia, provoca pérdidas económicas.

Por último, el uso AI situaciones en las que no se tienen muy en cuenta las consideraciones éticas puede dañar la credibilidad Compañiay generar una brecha de confianza con los clientes, como ocurre, por ejemplo, cuando se utilizan algoritmos que discriminan involuntariamente en función de data demográficos. Las empresas deben abordar estos retos de gobernanza para garantizar un uso responsable y ético de AI, protegiendo así sus operaciones y manteniendo la confianza de las partes interesadas.

AI establece normas relativas a data , la transparencia, la supervisión humana y AI . En Artefact, recomendamos a nuestros clientes que sigan siete principios fundamentales para diseñar AI que cumplan con la normativa».Nawras Akroush, consultor Data en Artefact

Nueva AI : regulación del uso y la adopción de AI las empresas

Uno de los aspectos más complejos de AI es la capacidad de las empresas para cumplir con la normativa que regula su uso e implementación. La normativa más destacada es la AI de la UE, propuesta por la Comisión Europea en 2021. Esta ley tiene por objeto establecer requisitos y obligaciones claros para AI , los implementadores y los usuarios AI , al tiempo que alivia las cargas administrativas y financieras, especialmente para las pequeñas y medianas empresas (pymes). Aunque se espera su adopción formal por parte de los legisladores de la UE, se ha alcanzado un acuerdo provisional, lo que indica que se prevé su aprobación como ley. Los expertos esperan que se adopte plenamente a mediados de 2024, y que su aplicación esté prevista para principios de 2026.

AI establece normas relativas a data , la transparencia, la supervisión humana y la rendición de cuentas de AI . Asimismo, establece un marco para clasificar el riesgo de AI en función de su posible impacto en la salud, la seguridad y los derechos humanos fundamentales. La ley define cuatro categorías de riesgo para AI :

Los requisitos Artefact: características de una AI conforme a la normativa

Teniendo en cuenta los requisitos de la AI de la UE y nuestra experiencia en materia de AI y cumplimiento normativo en el ámbito de data AI , recomendamos a nuestros clientes que tengan en cuenta siete requisitos imprescindibles a la hora de diseñar o implementar AI de AI :

Para desarrollar e implementar de manera eficaz AI que se ajusten a estos imperativos de diseño y garantizar AI adecuada AI con el fin de evitar riesgos legales, de rendimiento y de reputación, muchas empresas tendrán que llevar a cabo cambios organizativos significativos. Entre ellos se incluyen:

La implementación de cambios en todos estos pilares de la organización puede ser un proceso difícil y que requiere mucho tiempo, por lo que Artefact las empresas a empezar a desarrollar e integrar marcos AI . Esto garantizará el cumplimiento de la normativa futura y ayudará a satisfacer las expectativas de los clientes.

Necesidad urgente: la importancia de adoptar de forma proactiva AI que cumplan con la normativa

En el dinámico mundo de AI , los líderes empresariales deben adoptar una postura proactiva para posicionar a sus organizaciones como referentes en AI responsable AI . Esto les permitirá fomentar la innovación sin dejar de cumplir con las obligaciones éticas y normativas. En esta era de rápido desarrollo tecnológico y normativas en constante evolución, un enfoque estratégico y comprometido con AI será un elemento clave para el éxito sostenible.

¿Quieres saber más sobre cómo abordar esta cuestión? No te pierdas la segunda parte de esta serie, en la que profundizaremos en un marco que las empresas pueden utilizar para establecer AI adecuada AI dentro de sus organizaciones.

BLOG

BLOG