Un algoritmo para generar sucesos raros sintéticos de todo tipo

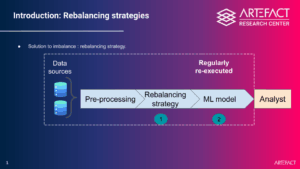

Una aplicación común del artificial intelligence es asignar una probabilidad, o puntuación, a personas o acontecimientos de interés. Este problema de puntuación se aplica a muchos ámbitos, como la detección de enfermedades, el mantenimiento predictivo en las fábricas, la propensión de los visitantes en línea a realizar compras o el riesgo de perder abonados. En estas situaciones, los eventos de interés son muy superiores al total disponible data. Este desequilibrio hace que el entrenamiento de los modelos de aprendizaje automático sea especialmente complejo, ya que tienden a centrarse en la mayoría de los casos e ignoran o subestiman los casos raros, lo que plantea múltiples problemas operativos si se despliega la IA. Existen algunos algoritmos, pero no están adaptados al data categórico y, por lo general, no consiguen mejorar la precisión del modelo final.

Para hacer frente a este reto, Centro de investigación de Artefact propuso un nuevo método de reequilibrio para tabular data, teniendo en cuenta tanto las variables numéricas como las categóricas. Probado en el código abierto data, este enfoque muestra mejoras significativas en términos de rendimiento, al tiempo que mantiene la coherencia, verosimilitud e interpretabilidad del data, un aspecto que a menudo pasan por alto los métodos existentes. El reequilibrio Data requiere la creación de ejemplos ficticios, que corren el riesgo de ser inverosímiles, como perfiles de clientes que no existen. Este riesgo repercute directamente en la adopción de artificial intelligence en los casos en los que los analistas deben validar manualmente los ejemplos más probables preseleccionados por el modelo. El Artefact resuelve este problema creando únicamente data plausibles durante el reajuste, lo que facilita su adopción por parte de las empresas.

Una asociación de investigación llave en mano con aplicaciones para casos de uso de Societe Generale

Este trabajo es el resultado de una asociación a tres bandas entre la Artefact Research Center, el Laboratorio de Probabilidad, Estadística y Modelización (LPSM) de la Universidad de la Sorbona y Societe Generale. La colaboración permitió definir un tema de investigación de tres años que establece un equilibrio entre los retos estadísticos e informáticos y los problemas concretos a los que se enfrentan los equipos comerciales y para los que no existen soluciones de vanguardia. En efecto, en el caso de esta aplicación, varios expertos en ventas habían señalado el problema de la incoherencia de los perfiles bancarios generados por los enfoques existentes, lo que limitaba su adopción de una herramienta basada en la IA, planteando así el reto de manteniendo sugerencias plausibles durante el algoritmo de reequilibrio.

Gracias a esta colaboración, los investigadores del Artefact y de la Universidad de la Sorbona pudieron probar sus métodos en el banco real data, lo que validó la precisión estadística del algoritmo propuesto. Además, un elemento único para probar el rendimiento del método propuesto fue la ampliación a millones de puntos data procesarse en un tiempo razonable, superando así el tamaño de los conjuntos data equivalentes de código abierto. El código es de código abierto y la metodología se explica detalladamente en el artículo científico, permitiendo que el mayor número posible de personas utilice el enfoque para otros casos de uso de la puntuación.

Etienne GUIBOUT, Director de IA del Grupo Societe Generale, explica:

“Esta colaboración permite a Societe Generale acceder a los conocimientos complementarios del mundo académico. Promueve la innovación incorporando una variedad de perspectivas destinadas a identificar soluciones cada vez más adaptadas a nuestros problemas. La aceptación en una conferencia de nivel A es una marca de calidad para los equipos de Societe Generale. Demuestra el reconocimiento del impacto del trabajo llevado a cabo por compañeros y expertos del sector. Participar en este tipo de eventos nos permite compartir nuestras investigaciones, sin dejar de formar parte del ecosistema. Los equipos de negocio de Societe Generale, en particular los de cumplimiento, participaron en la elaboración de este artículo. Su experiencia en el sector y sus comentarios confirmaron la pertinencia y aplicabilidad del contenido presentado. Esta colaboración interdisciplinar garantiza que el artículo refleje las realidades del mercado y responda ante todo a nuestras necesidades y a las de nuestros clientes.”

Emmanuel Malherbe, director del Artefact Research Center:

“Se trata de una asociación ideal para nuestro centro de investigación, que ilustra perfectamente nuestra visión de la investigación aplicada, útil y compartida. El aprendizaje automático es un campo que siempre parte de data y un problema real. A través de esta colaboración, hemos podido centrarnos en la cuestión mal resuelta de la puntuación en data tabular desequilibrada, que sin embargo es un problema recurrente en los negocios y plantea muchas cuestiones estadísticas. Poder probar y validar el enfoque en data reales también fue clave para lograr un algoritmo rápido, eficaz y preciso.”

Enlace al artículo científico y al código del algoritmo:

- Abdoulaye Sakho, Emmanuel Malherbe, Carl-Erik Gauthier y Erwan Scornet.

“Aprovechamiento de características mixtas para el sobremuestreo de desequilibrios Data: Aplicación a la calificación de clientes bancarios”.” En Conferencia conjunta europea sobre aprendizaje automático y descubrimiento de conocimientos en bases Data (2025) - https://github.com/artefactory/mgs-grf

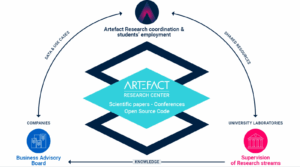

El centro de investigación de Artefact como puente entre el mundo académico y la industria

Somos un equipo de 20 científicos investigadores que trabajan en los campos del aprendizaje automático, la informática y las ciencias de la gestión. Nos dedicamos a mejorar los modelos de IA, ya sea haciéndolos más interpretables y controlables o estudiando su uso dentro de las empresas. Todo nuestro trabajo es de código abierto, con presentaciones en conferencias internacionales revisadas por expertos, publicaciones científicas, libros blancos y código disponible libremente. Colaboramos estrechamente con profesores universitarios de renombre. Nuestra filosofía es tender un puente entre la industria y el mundo académico. Nuestras áreas de investigación se inspiran en problemas del mundo real encontrados en proyectos Artefact con nuestros clientes, y estamos continuamente creando asociaciones industriales para probar nuestras metodologías en casos de uso y conjuntos data reales.

Un ejemplo crucial se refiere a la explicabilidad de los modelos estadísticos. La adopción de modelos de aprendizaje automático se ve obstaculizada en muchos casos de uso por la naturaleza de “caja negra” de ciertos modelos, o dicho de otro modo, por su falta de transparencia y comprensibilidad. Por tanto, es necesario proponer modelos más transparentes, minimizando al mismo tiempo la degradación asociada del rendimiento predictivo. A través de las soluciones que propone, el centro de investigación está mejorando la adopción de la IA al ofrecer las garantías deseadas por la industria.

BLOG

BLOG